Clear Sky Science · de

Chrysanthemenklassifikation mittels Farbraum‑Fusions‑Transformer

Warum Herkunft und Farbe einer Blüte wirklich wichtig sind

Chrysanthemen sind mehr als nur hübsche Blumen für Herbststräuße. In China sind sie zudem ein klassisches Heilmittel und eine wertvolle Nutzpflanze; ihre Heilwirkung und ihr Marktwert hängen jedoch stark von Sorte und Anbauort ab. Heutzutage erfordert die Unterscheidung medizinischer Chrysanthemen oft Expertenblick, chemische Tests oder genetische Analysen — Verfahren, die langsam, teuer und für den Feldeinsatz schwer anzuwenden sind. Diese Studie stellt eine kamera-basierte Methode vor, mit der ein Computer Chrysanthemen schnell und präzise allein aus Bildern sortieren kann, indem er die Farbe auf eine neue Weise besonders genau betrachtet.

Blumen sehen, wie es eine Kamera tut

Die meisten digitalen Fotos speichern Farbe als Mischung aus Rot, Grün und Blau (RGB). Das eignet sich gut für die Darstellung, entspricht aber nicht immer der menschlichen Wahrnehmung von Helligkeit und feinen Farbnuancen, besonders bei wechselnder Beleuchtung. Die Autoren nehmen die üblichen RGB-Bilder von Chrysanthemenköpfen — insbesondere die Rückseiten der Blüten, die reiche strukturelle und farbliche Hinweise bieten — und wandeln sie in ein zweites Farbsystem namens LAB um. In LAB beschreibt ein Kanal Hell versus Dunkel, während die anderen beiden darstellen, wie Farben entlang rötlich–grünlich und gelblich–bläulich differieren. Durch das gleichzeitige Arbeiten in beiden Systemen kann die Methode die feinen Details des Originalfotos bewahren und zugleich stabilere, menschlichere Farbdifferenzen zwischen ähnlichen Blumen erfassen.

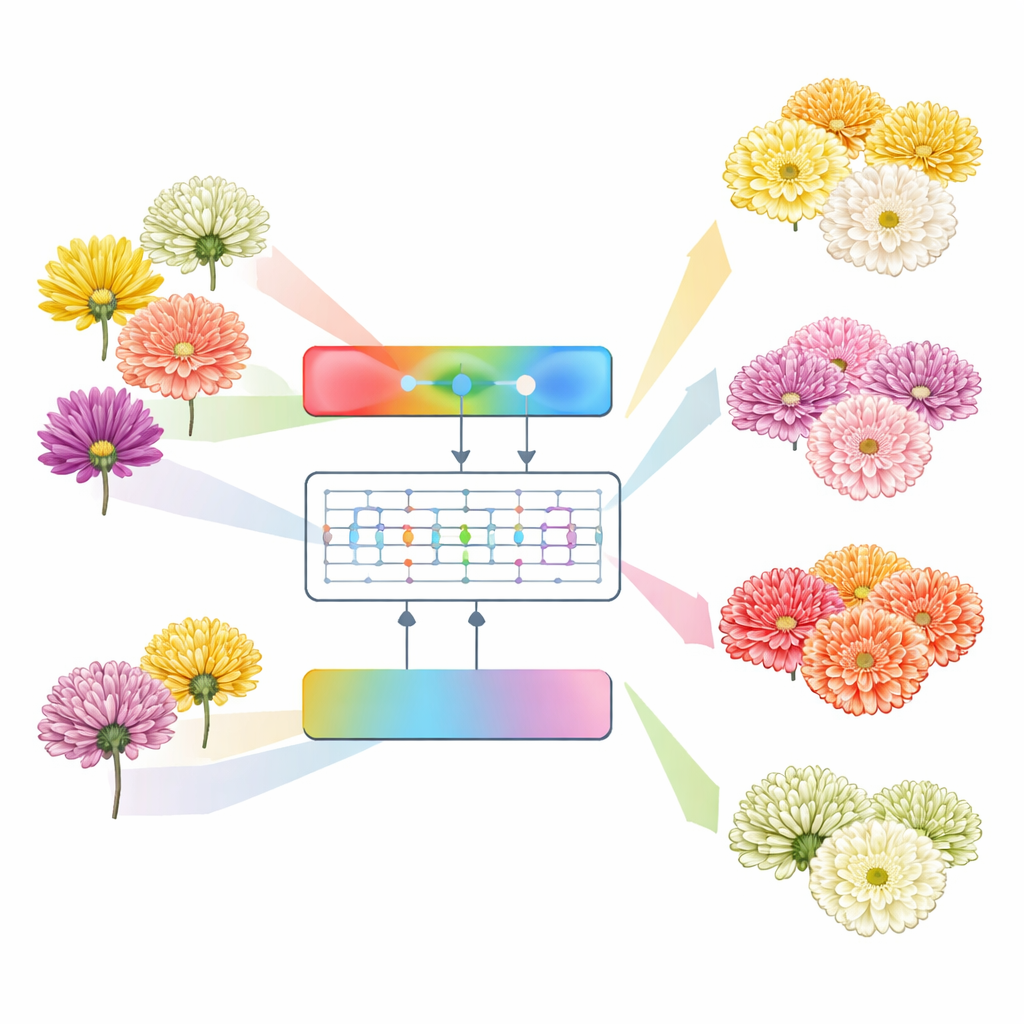

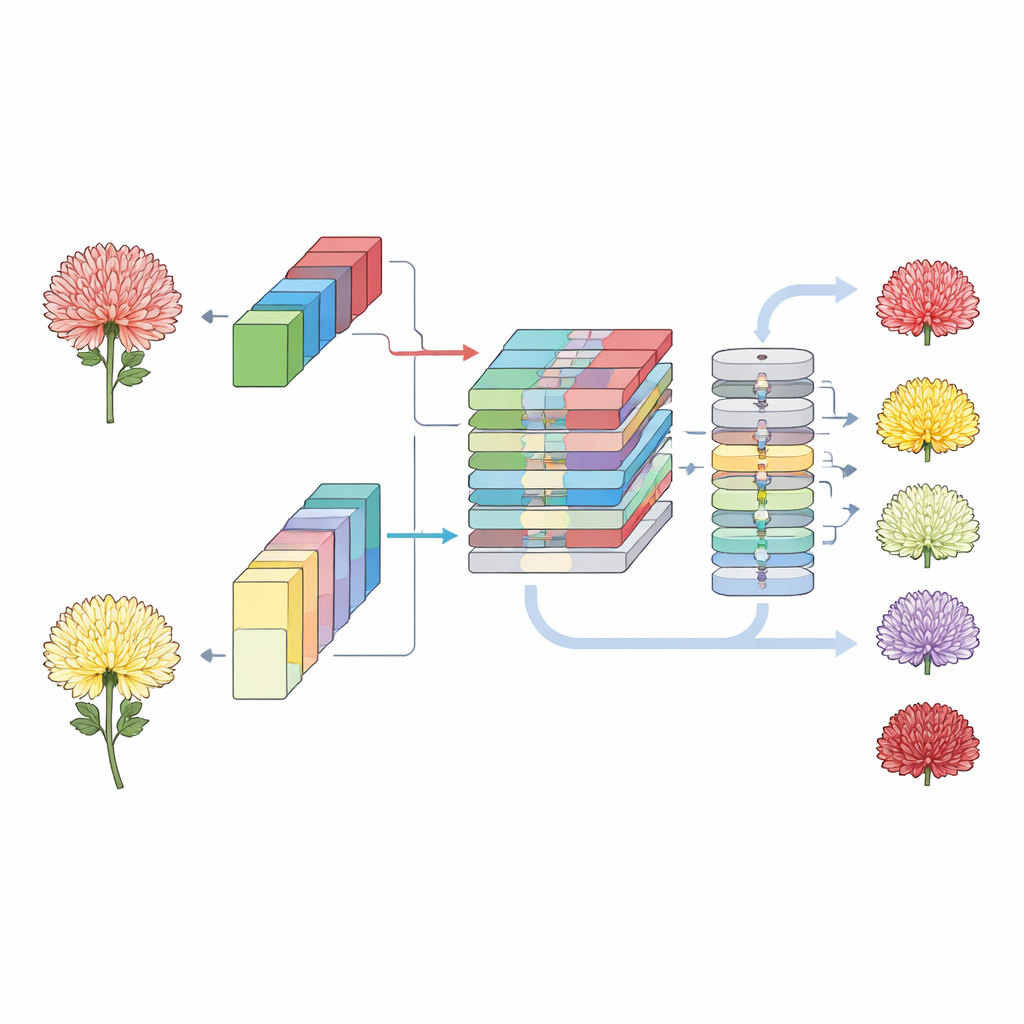

Zwei parallele Blickwinkel auf dieselbe Blüte

Um diese komplementären Ansichten optimal zu nutzen, entwerfen die Forschenden ein „Mehrweg“-Netzwerk — im Grunde zwei Expertenspuren, die parallel arbeiten. Eine Spur untersucht die RGB-Version jedes Bildes, die andere analysiert die LAB-Version. Jede Spur basiert auf modernen Faltungsblöcken, einer Deep‑Learning‑Struktur, die besonders gut Kanten, Texturen und Formen erkennt. Frühe Schichten achten auf Blütenblattkonturen und kleine Texturmuster, tiefere Schichten fassen breitere Strukturen zusammen. In mehreren Phasen verschmilzt das Netzwerk die Erkenntnisse der beiden Spuren, indem es deren Feature‑Maps übereinanderlegt. So kann das Modell scharfe Konturen aus RGB mit glatteren, beleuchtungsrobusten Farbstrukturen aus LAB abwägen und zu einem reicheren inneren Bild jeder Blüte kombinieren.

Die Aufmerksamkeit Details finden lassen

Nachdem die parallelen Spuren die Blumenbilder in kompakte Merkmalskarten verdichtet haben, übernimmt ein zweiter Modelltyp: ein Vision Transformer. Transformer wurden ursprünglich für Sprache entwickelt, wo sie Langstreckenbeziehungen besonders gut erfassen, und spielen inzwischen eine wachsende Rolle in der Bildanalyse. Hier werden die verschmolzenen Chrysanthemen‑Features in viele kleine Patches zerteilt und dem Transformer zugeführt, der mithilfe eines „Attention“-Mechanismus entscheidet, welche Patches am wichtigsten sind, um Sorten zu unterscheiden. Diese globale Sicht hilft dem Netzwerk, subtile Farbdifferenzen nahe der Blütenblattbasis mit Mustern weiter außen am Blütenkopf zu verbinden, was zu einer zuverlässigeren Bestimmung von Typ und Herkunft jeder Blüte führt.

Das System auf die Probe gestellt

Das Team stellte eine umfangreiche Bildsammlung zusammen: mehr als 9.000 Fotos von Rück‑ und Vorderseiten von Blüten aus 18 Chrysanthemen‑Typen und 15 Anbauregionen, wobei einige Sorten — etwa die Hangbai‑Chrysantheme — in vielen verschiedenen Regionen vertreten sind. Sie trainierten und bewerteten ihr Modell an diesem Datensatz und verglichen es mit bekannten Deep‑Learning‑Architekturen, die in der Bilderkennung weit verbreitet sind. Die Ergebnisse sind eindrucksvoll: Bei Rückansichten erzielte die neue Methode eine Genauigkeit von etwa 96–97 % auf ihrem eigenen Chrysanthemen‑Datensatz und mehr als 99 % auf einem standardisierten öffentlichen Blumenbild‑Benchmark. Sie übertraf mehrere starke Konkurrenten, darunter reine Faltungsnetze und reine Transformer‑Modelle, und hielt nicht nur hohe Genauigkeit, sondern auch stabile Leistung über viele Chrysanthemenkategorien hinweg.

Was das für Züchter und die Kräutermedizin bedeutet

Alltäglich gesprochen zeigt die Studie, dass ein sorgfältig gestaltetes Bildanalyse‑System die Zuverlässigkeit aufwändigerer Laborverfahren zur Erkennung medizinischer Chrysanthemen erreichen — und in einigen Fällen übertreffen — kann. Durch die Kombination von zwei Farbrepräsentationen mit zwei komplementären Typen neuronaler Netze kann die Methode feine visuelle Hinweise erkennen, die sich äußerlich sehr ähnliche Blumen aus unterschiedlichen Regionen unterscheiden. Dies könnte schnelle Qualitätskontrollen auf Märkten unterstützen, helfen, die tatsächliche Herkunft getrockneter Blütenköpfe nachzuverfolgen, und sich schließlich auf andere Heilpflanzen ausdehnen, die eine präzise Sortenbestimmung erfordern. Wenn solche Werkzeuge vom Labor in Handgeräte oder Sortiermaschinen übergehen, könnten sie das „geschulte Auge“ eines Experten überall dort verfügbar machen, wo Heilpflanzen angebaut, gehandelt oder verordnet werden.

Zitation: Jiang, J., Yang, X., Wang, T. et al. Chrysanthemum classification via color space fusion transformer. Sci Rep 16, 9397 (2026). https://doi.org/10.1038/s41598-026-40027-2

Schlüsselwörter: Chrysanthemenklassifikation, Pflanzenbilderkennung, Farbraumfusion, Vision Transformer, Heilkräuter