Clear Sky Science · de

Ein maschinelles Lernverfahren zur verbesserten Erkennung von Positionsfälschungsangriffen in vehikulären Ad‑hoc‑Netzen

Schlauere Autos, die Betrüger entlarven

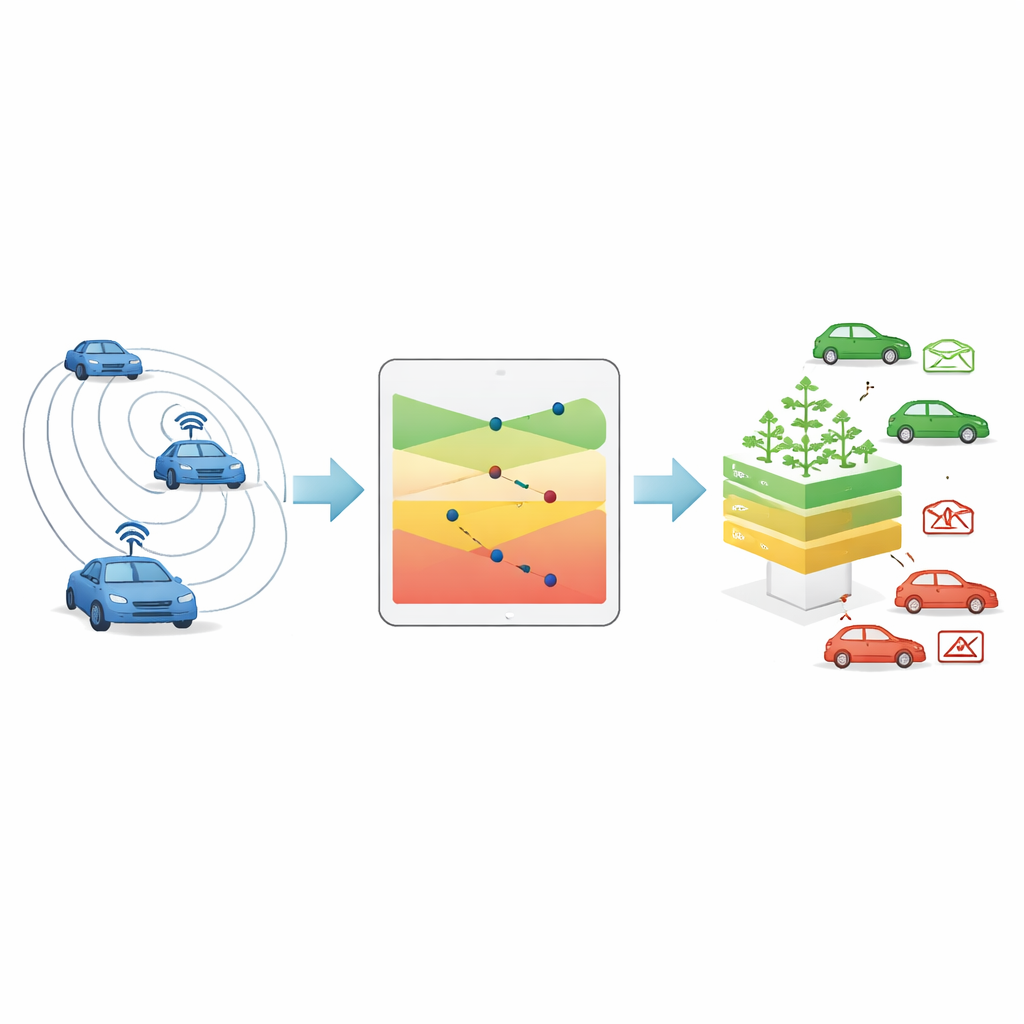

Moderne Autos beginnen, miteinander zu kommunizieren und vor starkem Bremsen, Unfällen in der Nähe oder gesperrten Fahrspuren zu warnen. Diese drahtlosen Unterhaltungen können die Straßen sicherer machen – vorausgesetzt, die geteilten Informationen sind ehrlich. Die Studie beschäftigt sich mit einem ernsten Problem: Was passiert, wenn ein Fahrzeug über seinen Standort lügt? Die Autorinnen und Autoren zeigen, wie eine speziell angepasste Form des maschinellen Lernens Fahrzeuge erkennen kann, die ihre Position fälschen, wodurch vernetzte Fahrzeugnetze vertrauenswürdiger werden und potenziell Unfälle durch falsche Daten verhindert werden können.

Warum lügende Autos so gefährlich sind

Fahrzeuge in sogenannten vehikulären Ad‑hoc‑Netzen senden ständig kurze Sicherheitsnachrichten aus, die ihre Position, Geschwindigkeit und Richtung enthalten. Nahegelegene Fahrzeuge und Straßenstationen nutzen diesen Strom von Aktualisierungen, um zu entscheiden, wann Fahrer gewarnt oder automatische Reaktionen ausgelöst werden sollen. Meldet ein bösartiges Fahrzeug eine gefälschte Position, kann es andere dazu verleiten, unnötig abzubremsen, die Spur zu wechseln oder umzulenken. Im schlimmsten Fall könnte dadurch eine Kollisionswarnung nicht rechtzeitig ausgelöst werden. Weil Fahrzeuge schnell unterwegs sind und Verbindungen sich ständig ändern, ist die Erkennung eines solchen Fehlverhaltens schwierig, und bestehende Methoden übersehen noch zu viele Angriffe.

Radiosignale als Vertrauenshinweis nutzen

Die Kernidee der Arbeit ist, das, was ein Fahrzeug behauptet, mit dem abzugleichen, was das Funksignal still verrät. Jede drahtlose Nachricht kommt mit einer messbaren Signalstärke an. Im Allgemeinen schwächt sich das Signal mit wachsender Entfernung ab, obwohl reale Straßen Rauschen durch Reflexionen, Gebäude und Verkehr hinzufügen. Anstatt die Signalstärke naiv in eine exakte Distanz umzuwandeln, untersuchen die Autorinnen und Autoren zunächst viele ehrliche Nachrichten, um zu lernen, wie stark das Signal in verschiedenen Reichweiten typischerweise ist. Für jede Entfernungszone berechnen sie drei verschachtelte Bereiche plausibler Signalwerte: einen engen, einen mittleren und einen weiten Vertrauensbereich. Wenn eine neue Nachricht eingeht, prüft das System, ob ihr Signal innerhalb eines dieser Bereiche für die behauptete Entfernung liegt, und vergibt entsprechend eine einfache Vertrauenswertung von klar plausibel bis stark verdächtig.

Ein digitales Waldmodell lehrt Fälschungen zu erkennen

Allein die Signalstärke reicht nicht aus, daher kombinieren die Autorinnen und Autoren diese Vertrauenswertung mit weiteren leicht verfügbaren Informationen aus den Sicherheitsnachrichten – etwa der gemeldeten Position und Geschwindigkeit des Fahrzeugs, deren zeitlicher Änderung und dem tatsächlichen Abstand zwischen Sender und Empfänger. Aus diesen Merkmalen bauen sie drei alternative Merkmalsbündel und trainieren mehrere gebräuchliche maschinelle Lernalgorithmen an einem öffentlichen Datensatz, der realistischen Verkehr und fünf Arten von Positionsbetrug simuliert. Unter den getesteten Modellen lieferte eine Technik namens Random Forest – im Grunde ein Abstimmungskomitee vieler einfacher Entscheidungsbäume – gepaart mit einem bestimmten Merkmalsbündel die beste Balance aus Genauigkeit und Geschwindigkeit. Sie identifizierte nahezu alle gefälschten Positionsmeldungen über alle Angriffstypen hinweg und hielt dabei die Rechenlast niedrig genug, um in fahrenden Fahrzeugen einsetzbar zu sein.

Erprobung des neuen Merkmals

Um zu zeigen, dass ihre signalbasierte Vertrauenswertung tatsächlich einen Mehrwert bringt, verglichen die Forschenden das vollständige Modell mit einer Version, die exakt dieselben Informationen verwendet außer diesem neuen Merkmal. Evaluierte auf einem separaten Simulationslauf, den es zuvor nie gesehen hatte, blieb das vollständige Modell deutlich genauer, insbesondere bei Angriffen, bei denen ein Fahrzeug weiterhin eine feste falsche Position sendet oder plötzliches Anhalten vortäuscht. In einigen dieser Fälle war die Verbesserung einer wichtigen Leistungskennzahl dramatisch, was bedeutet, dass das System deutlich weniger bösartige Nachrichten verfehlte, ohne die Zahl an Fehlalarmen stark zu erhöhen. Statistische Tests bestätigten, dass der Unterschied zwischen den beiden Modellen nicht bloß zufällig ist.

Was das für sicherere Straßen bedeutet

Aus Sicht eines Nicht‑Spezialisten zeigt die Arbeit, dass Fahrzeuge das natürliche Verhalten von Funksignalen als unabhängige Überprüfung dessen nutzen können, was Nachbarfahrzeuge über sich selbst behaupten. Indem diese Überprüfung in ein leichtgewichtiges, auf jedem Fahrzeug laufendes maschinelles Lernmodell integriert wird, kann das System lügende Fahrzeuge deutlich zuverlässiger erkennen als frühere Methoden auf demselben Benchmark‑Datensatz. Obwohl die Ergebnisse aus Simulationen und nicht aus Feldversuchen stammen, zeigen sie einen klaren Weg zu intelligenteren, selbstschutzfähigen Verkehrsnnetzen, in denen bereits kleine Verbesserungen bei der Erkennung von Fehlverhalten in geretteten Leben resultieren könnten.

Zitation: Abdelkreem, E., Hussein, S. & Tammam, A. A machine learning based scheme for enhancing the detection of position falsification attacks in vehicular ad hoc networks. Sci Rep 16, 8950 (2026). https://doi.org/10.1038/s41598-026-39867-9

Schlüsselwörter: vernetzte Fahrzeuge, kabellose Verkehrssicherheit, Sicherheit im maschinellen Lernen, Standort‑Spoofing, Fahrzeugnetzwerke