Clear Sky Science · de

Verbessertes Brustkrebs-Erkennungsframework basierend auf YOLOv11n mit multiskaliger Merkmalskalibrierung

Warum das Finden winziger Warnsignale wichtig ist

Brustkrebs lässt sich deutlich leichter behandeln, wenn er früh entdeckt wird, aber die frühesten Warnzeichen können selbst für geschulte Expertinnen und Experten nahezu unsichtbar sein. Auf Objektträgern unter dem Mikroskop können gefährliche Zellen winzig, unregelmäßig geformt und im umgebenden Gewebe verschwommen erscheinen. Diese Studie stellt ein künstliches Intelligenz-(KI-)System vor, das speziell darauf ausgelegt ist, diese subtilen Veränderungen zuverlässiger und schneller zu erkennen und so Ärztinnen und Ärzten zu helfen, Krebs früher und mit größerer Sicherheit zu diagnostizieren.

Die Herausforderung, das Beinahe-Unsichtbare zu sehen

Traditionelle Bildgebungsverfahren, von Mammographien bis zu mikroskopischen Schnitten, hängen stark von der Erfahrung und der momentanen Aufmerksamkeit der Ärztin oder des Arztes ab. Kleine Tumore oder Grenzfälle können sich in dichtem Gewebe verstecken oder sehr ähnlich aussehen wie harmlose Veränderungen. Computer-Vision-Werkzeuge unterstützen bereits, aber viele bestehende Systeme haben Schwierigkeiten mit den kleinsten Läsionen, Tumoren mit ungewöhnlichen Formen und unscharfen Rändern, die gesundes und abnormales Gewebe nicht klar trennen. Diese Schwächen sind besonders gravierend bei mittelgradigen Tumoren, die sowohl häufig als auch klinisch bedeutend, aber schwer zu unterscheiden sind.

Ein KI-Modell, zugeschnitten auf Brustgewebeabbildungen

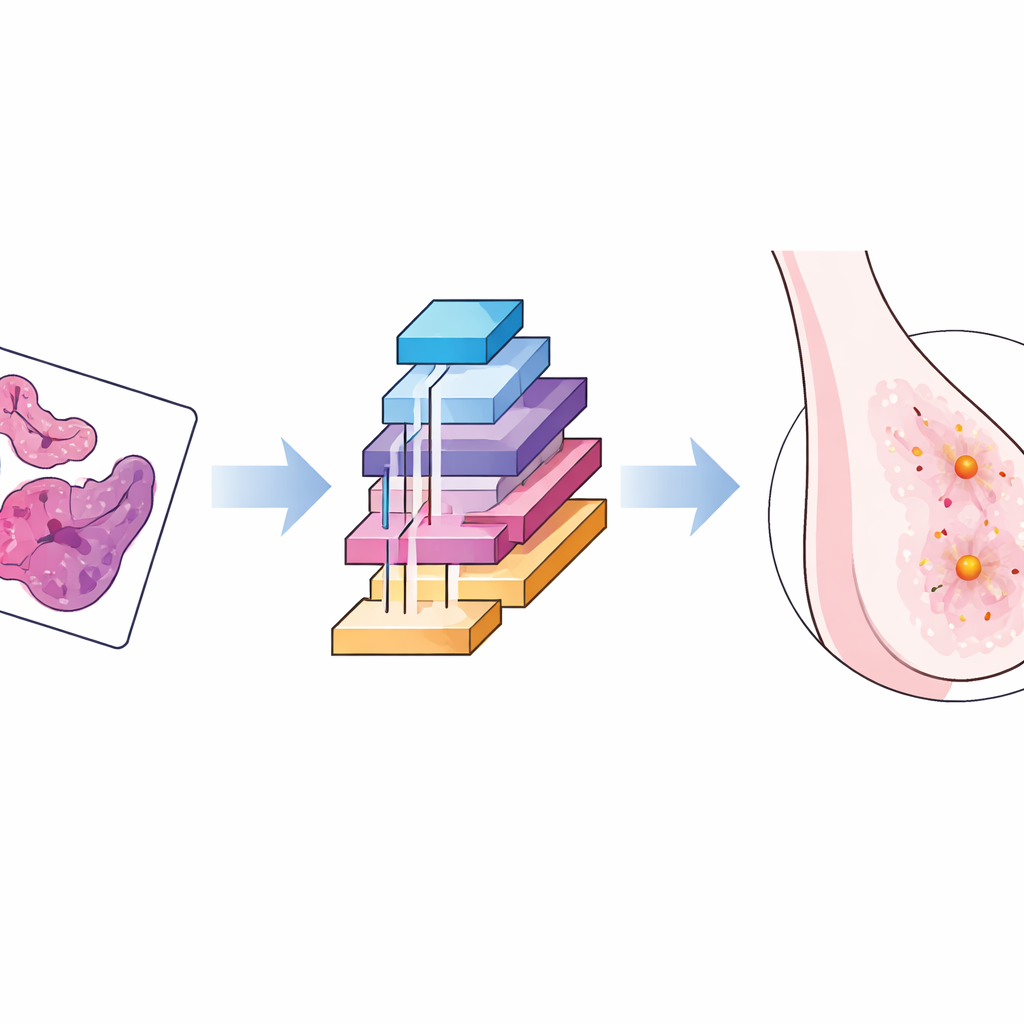

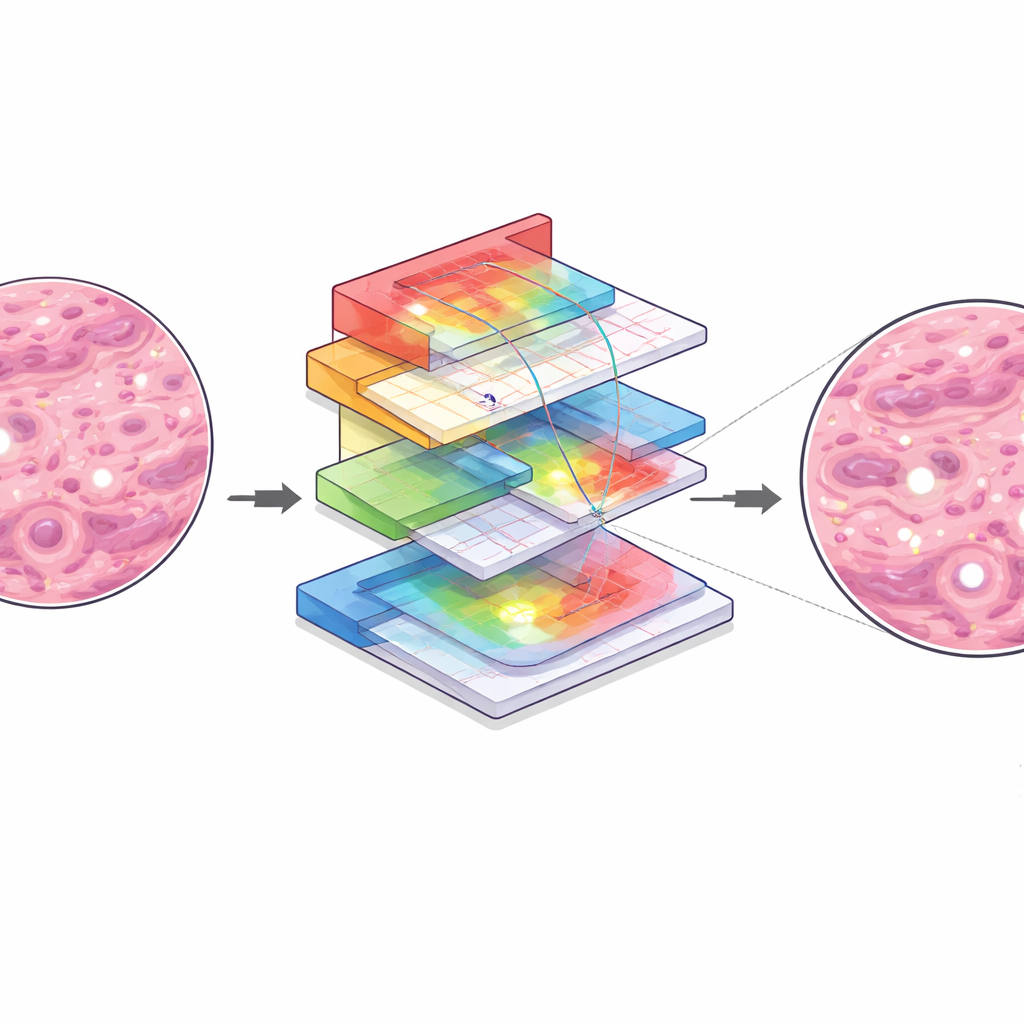

Die Forschenden bauten auf einer schnellen Familie von Objekterkennungsalgorithmen namens YOLO auf und wählten eine leichtgewichtige Version, die auch auf bescheidener Hardware zügig läuft. Anschließend passten sie die interne Struktur so an, dass sie besser zu den Besonderheiten von mikroskopischen Brustkrebsbildern passt. Das neue Framework fügt drei zentrale Bausteine hinzu, die zusammenwirken: einen, der sich an Verzerrungen und Maßstabsänderungen anpasst; einen, der lernt, die informativsten Kanäle der visuellen Daten zu betonen und Hintergrundstörungen zu unterdrücken; und einen, der Kontext und räumliche Details fein kalibriert, sodass kleine Läsionen deutlicher aus der Umgebung hervortreten.

Wie das intelligentere Sehsystem im Inneren funktioniert

Vereinfacht gesagt erlaubt das erste Modul der KI, ihr Sichtfenster zu „flexen“ und anzupassen, wie ein Bild abgetastet wird, sodass sowohl winzige Punkte als auch größere Strukturen gleichermaßen sorgfältig analysiert werden. Das zweite Modul wirkt wie ein Set einstellbarer Scheinwerfer, die Bildmuster hervorheben, die am ehesten auf Erkrankung hinweisen, während unbrauchbare Texturen abgedimmt werden. Das dritte Modul betrachtet die weitere Nachbarschaft um jedes Pixel und justiert dann die Ausrichtung zwischen groben, hochrangigen Mustern und feinkörnigen Details, sodass die interne Karte „verdächtiger“ Regionen der KI näher an den tatsächlichen Läsionsgrenzen liegt. Zusammen helfen diese Schritte der KI, sehr ähnliche Tumorgrade besser zu unterscheiden und Verwechslungen zwischen abnormem Gewebe und normalem Hintergrund zu reduzieren.

Das System auf dem Prüfstand

Zur Bewertung ihres Ansatzes nutzten die Autorinnen und Autoren eine öffentliche Sammlung von über fünftausend hochaufgelösten Brustpathologie-Bildern, die gutartige Proben sowie mehrere Grade bösartiger Tumore abdecken. Sie trainierten und testeten ihr Modell unter denselben Bedingungen wie mehrere moderne Detektoren, einschließlich neuerer YOLO-Versionen und eines verbreiteten transformerbasierten Verfahrens. Das verbesserte System erzielte die beste Gesamtgenauigkeit, mit höherer Präzision und einem stärkeren Durchschnittswert über alle Kategorien. Besonders wirksam war es bei den schwierigen mittelgradigen Tumoren, wo die Erkennungswerte im Vergleich zum ursprünglichen YOLO-Modell deutlich anstiegen. Wichtig ist auch, dass die Verarbeitungsgeschwindigkeit sehr hoch blieb, was darauf hindeutet, dass das System große Objektträger-Sammlungen oder Echtzeit-Workloads in Kliniken bewältigen könnte.

Robustheit, Schwächen und nächste Schritte

Das Team untersuchte außerdem, wie sich das System verhält, wenn Bilder durch Rauschen, Unschärfe oder Helligkeitsänderungen beeinträchtigt sind – häufige Probleme in der klinischen Routine. Zwar ging die Leistung, wie zu erwarten, etwas zurück, doch die neuen Module halfen der KI, robuster als das Basismodell zu degradieren und mehr korrekte Erkennungen kleiner Läsionen beizubehalten. Gleichzeitig weisen die Autorinnen und Autoren auf verbleibende Schwächen hin: Das System kann weiterhin in Grenzfällen zwischen bestimmten Tumorgraden Schwierigkeiten haben, Läsionsgrenzen verschieben, wenn Gewebestrukturen sich überlagern, und gelegentlich Färbeartefakte mit Krebs verwechseln. Sie betonen, dass die Studie auf einem einzigen Datensatz und retrospektiven Tests beruht, sodass breitere klinische Studien und Daten aus mehreren Krankenhäusern erforderlich sind, bevor ein routinemäßiger Einsatz sinnvoll ist.

Was das für Patientinnen, Patienten und Ärztinnen und Ärzte bedeutet

Für eine nichtfachliche Leserschaft ist die Kernbotschaft, dass diese Arbeit eine KI-gestützte „zweite Sicht“ verfeinert, um kleine und subtile Brustkrebs-Läsionen besser zu erfassen – besonders jene, die sowohl für Menschen als auch für Maschinen am schwierigsten zu klassifizieren sind. Indem verdächtige Bereiche auf Pathologiefolien zuverlässiger markiert werden und das bei sehr hoher Geschwindigkeit, können solche Systeme Pathologinnen und Pathologen dabei unterstützen, früher und genauer zu diagnostizieren. Dieses Werkzeug ersetzt zwar nicht das fachliche Urteil, stellt aber einen Schritt in Richtung sichererer, konsistenterer Befundung dar und könnte letztlich zu besseren Behandlungsergebnissen beitragen, indem verpasste Krebserkrankungen reduziert und rechtzeitige Therapien ermöglicht werden.

Zitation: He, Z., Zhang, C., Liang, C. et al. Enhanced breast cancer detection framework based on YOLOv11n with multi-scale feature calibration. Sci Rep 16, 8535 (2026). https://doi.org/10.1038/s41598-026-39723-w

Schlüsselwörter: Brustkrebs-Erkennung, medizinische Bildgebung KI, Pathologie Deep Learning, Erkennung kleiner Läsionen, YOLO Objekterkennung