Clear Sky Science · de

Ein flexibles Rahmenwerk zur Hyperparameter-Optimierung mithilfe von Homotopie und Surrogatmodellen

Warum das Einstellen der Stellschrauben der KI wichtig ist

Moderne Systeme der künstlichen Intelligenz beruhen nicht nur auf cleveren Algorithmen und riesigen Datenmengen, sondern auch auf einer überraschend heiklen Schicht von Einstellungen, den sogenannten „Hyperparametern“. Das sind die Stellschrauben, die bestimmen, wie groß ein Modell sein soll, wie schnell es lernt und wie es mit verrauschten Daten umgeht. Werden sie falsch gesetzt, kann ein vielversprechendes System versagen. Dieses Paper stellt HomOpt vor, eine neue Methode, diese Stellschrauben effizienter und verlässlicher zu justieren — besonders dann, wenn der Suchraum groß und unübersichtlich ist. Damit ist sie für alle attraktiv, die KI mit weniger Trial-and-Error besser funktionieren lassen wollen.

Ein neuer Weg, die Suche zu steuern

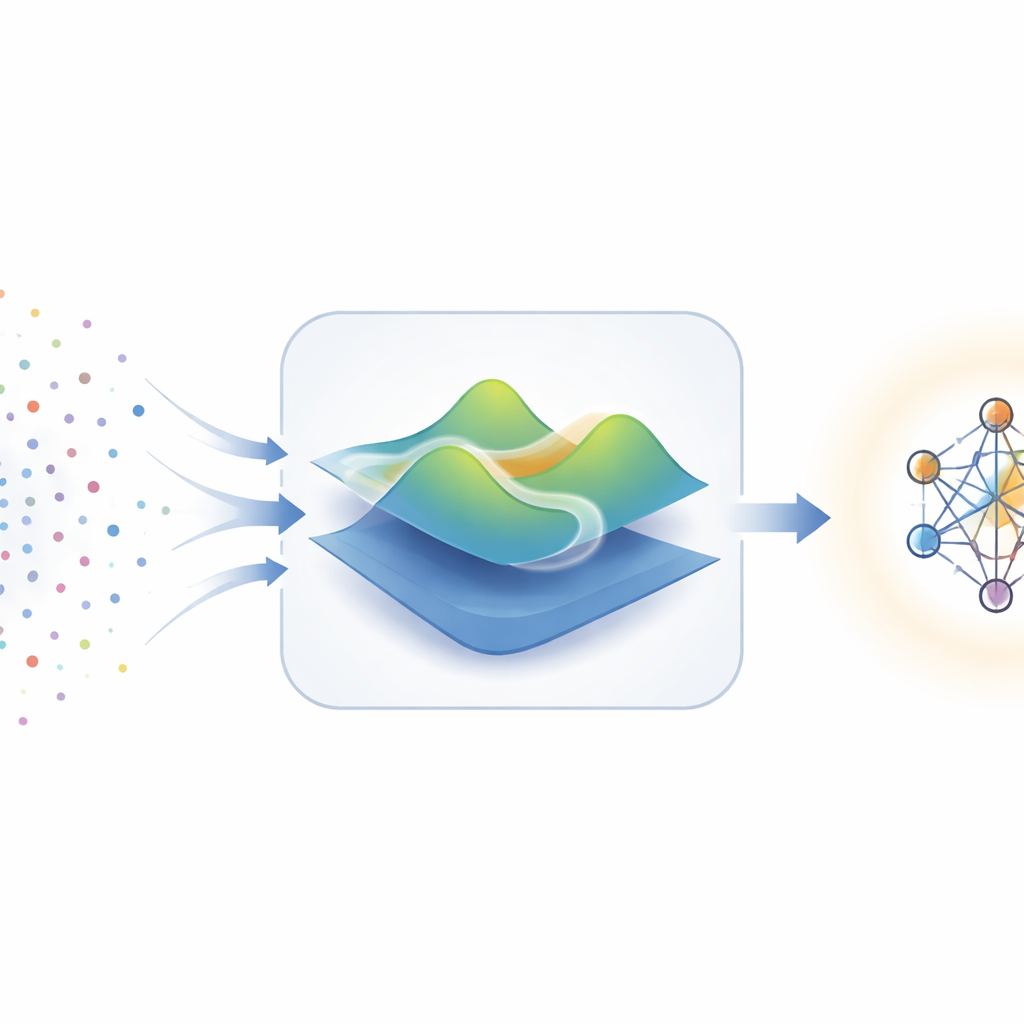

Traditionelle Ansätze zur Hyperparameter-Abstimmung, wie Grid-Search oder Random-Search, gleichen dem Ausprobieren von Rezepten, indem Zutaten zufällig kombiniert werden in der Hoffnung, dass etwas schmeckt. Verfeinerte Methoden wie Bayesian Optimization versuchen klüger zu sein, indem sie ein grobes Modell darüber aufbauen, wie Einstellungen die Leistung beeinflussen, und dieses Modell nutzen, um die nächste Kombination auszuwählen. Diese Methoden setzen jedoch voraus, dass die Leistungs‑„Landschaft“ glatt und gutartig ist — was in realen Problemen mit Eigenheiten, Rauschen und abrupten Sprüngen oft nicht zutrifft. HomOpt begegnet dieser Herausforderung, indem es wiederholt approximative Stellvertreter der wahren Landschaft — sogenannte Surrogatmodelle — konstruiert und jeweils eine stetige Transformation vom alten zum neuen Surrogat definiert, während es verfolgt, wie sich die beste Lösung während dieser Veränderung verschiebt.

Modelle sanft morphen statt von vorn zu beginnen

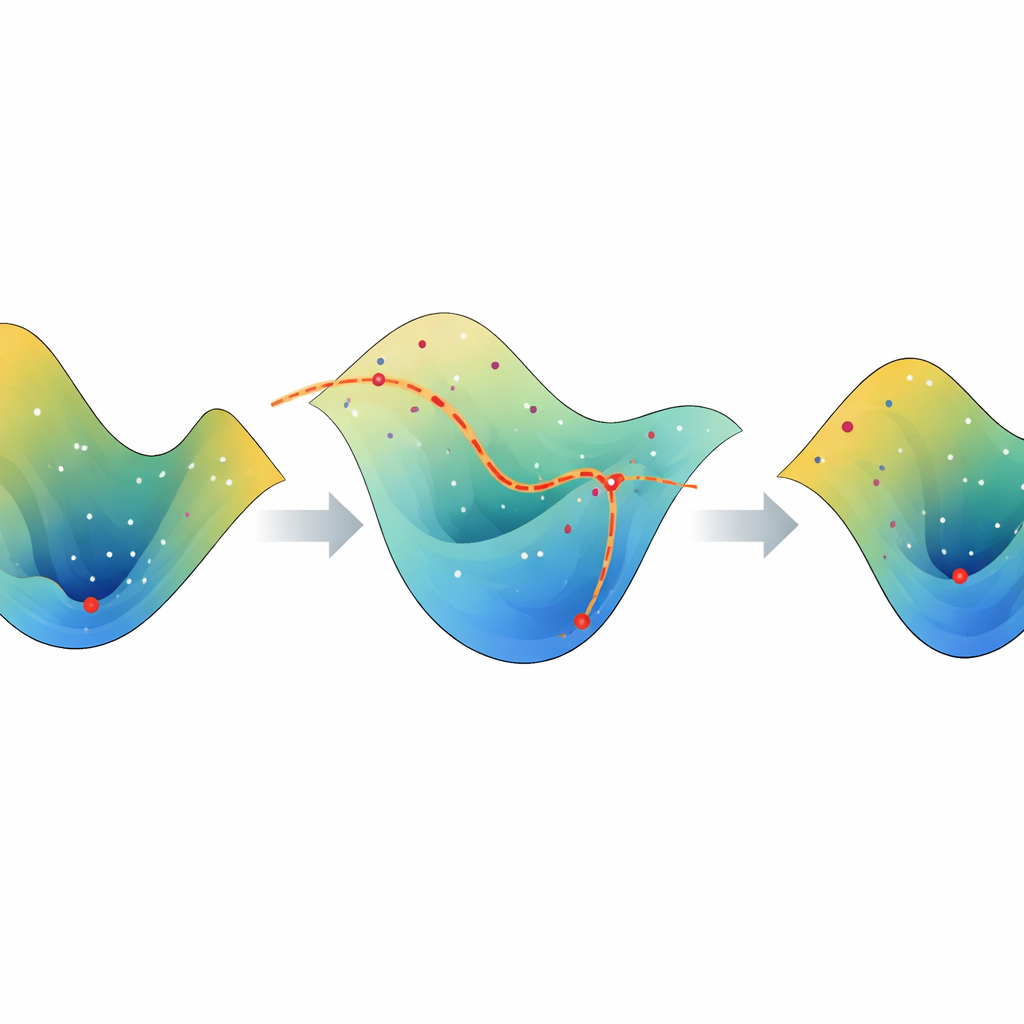

Die zentrale Idee von HomOpt stammt aus dem mathematischen Konzept der Homotopie, das einfach gesagt davon handelt, eine Form schrittweise in eine andere zu überführen, ohne zu reißen oder zu springen. In diesem Rahmen ist jedes Surrogatmodell eine geglättete Darstellung davon, wie unterschiedliche Hyperparameter die Modellleistung beeinflussen. Wenn neue experimentelle Ergebnisse anfallen, baut HomOpt ein aktualisiertes Surrogat und definiert dann eine kontinuierliche Transformation zwischen der alten und der neuen Version. Anstatt frühere Arbeit zu verwerfen und die Suche neu zu starten, verfolgt es, wie der beste Punkt auf der alten Oberfläche über diese morphende Landschaft hinweg zum guten Punkt auf der neuen Oberfläche gleitet. Diese geführte Bewegung macht die Suche zielgerichteter und weniger zufällig und erhöht die Chance, in weniger Schritten bessere Einstellungen zu finden.

Flexible Werkzeuge für verschiedene Datentypen

Um zu zeigen, dass die Idee in der Praxis funktioniert, binden die Autoren zwei sehr unterschiedliche Arten von Surrogatmodellen in HomOpt ein. Zunächst verwenden sie Generalized Additive Models, die glatt und relativ gut interpretierbar sind und sich eignen, wenn die Zusammenhänge zwischen Einstellungen und Leistung sanft variieren. Als zweites setzen sie CatBoost ein, ein leistungsfähiges Ensemble‑Verfahren, das sich für komplexe, hochdimensionale Probleme wie die Bildklassifikation gut eignet. HomOpt bindet sich nicht an ein einziges Surrogat; stattdessen behandelt das Rahmenwerk die Wahl des Surrogats als ein steckbares Bauteil, das an Schwierigkeit und Struktur der Aufgabe angepasst werden kann. Das System kann mit kontinuierlichen, diskreten und kategorialen Einstellungen umgehen und lässt sich über gängige Suchstrategien wie Random Search, Bayesian Optimization oder baumbasierte Methoden legen — als Verfeinerungsschicht statt als Ersatz.

Das Verfahren im Praxistest

Die Forschenden bewerten HomOpt anhand einer vielfältigen Reihe von Benchmarks. Bei klassischen maschinellen Lernaufgaben mit öffentlichen Tabellendatensätzen stimmen sie Modelle wie Support Vector Machines, Random Forests, logistische Regression, mehrlagige Perzeptrons und gradientenverstärkte Bäume ab. Außerdem untersuchen sie anspruchsvolle Open‑Set‑Recognition‑Probleme, bei denen ein System mit zuvor unbekannten Kategorien umgehen muss, mithilfe eines spezialisierten Klassifikators namens Extreme Value Machine. Schließlich testen sie HomOpt an Neural‑Architecture‑Search‑Tabellen für bekannte Bilddatensätze wie CIFAR‑10 und ImageNet‑ähnliche Sammlungen, in denen der Raum möglicher Architekturen besonders groß und zerklüftet ist. In vielen dieser Szenarien beschleunigt HomOpt entweder den Abstieg zu guten Lösungen oder verbessert die Endleistung im Vergleich zu den zugrunde liegenden Methoden allein — oftmals bei weniger teuren Modellevaluationen.

Was das für die tägliche KI‑Praxis bedeutet

Für Praktiker lautet die Kernbotschaft: HomOpt bietet eine strukturierte Möglichkeit, Hyperparameter‑Tuning intelligenter statt nur gründlicher zu machen. Indem es fortlaufend ein approximatives Bild der Leistungslandschaft verfeinert und sanft verfolgt, wie sich dessen bester Punkt verschiebt, wenn dieses Bild besser wird, verringert die Methode verschwendete Suchen und nutzt jede Modellausführung besser aus. Da sie mit einer breiten Palette von Verlustmaßen, Modelltypen und Suchstrategien funktioniert, kann HomOpt als allgemeiner Zusatz zu vorhandenen Optimierungswerkzeugen verstanden werden. Kurz gesagt verspricht sie, aus demselben Rechenbudget genauere, robustere KI‑Systeme hervorzubringen — und das in einer Weise, die von kleinen tabellarischen Problemen bis zu großen, komplexen Vision‑Aufgaben skaliert.

Zitation: Abraham, S.J., Maduranga, K.D.G., Kinnison, J. et al. A flexible framework for hyperparameter optimization using homotopy and surrogate models. Sci Rep 16, 9412 (2026). https://doi.org/10.1038/s41598-026-39713-y

Schlüsselwörter: Hyperparameter-Optimierung, Surrogatmodelle, Homotopie-Methoden, automatisiertes Maschinelles Lernen, Neural Architecture Search