Clear Sky Science · de

Fusion aus Gaussian- und Haar-Transformation verbessert DEIM für die Bestimmung des Reifegrads von Granatäpfeln

Intelligentere Ernten für eine wachsende Welt

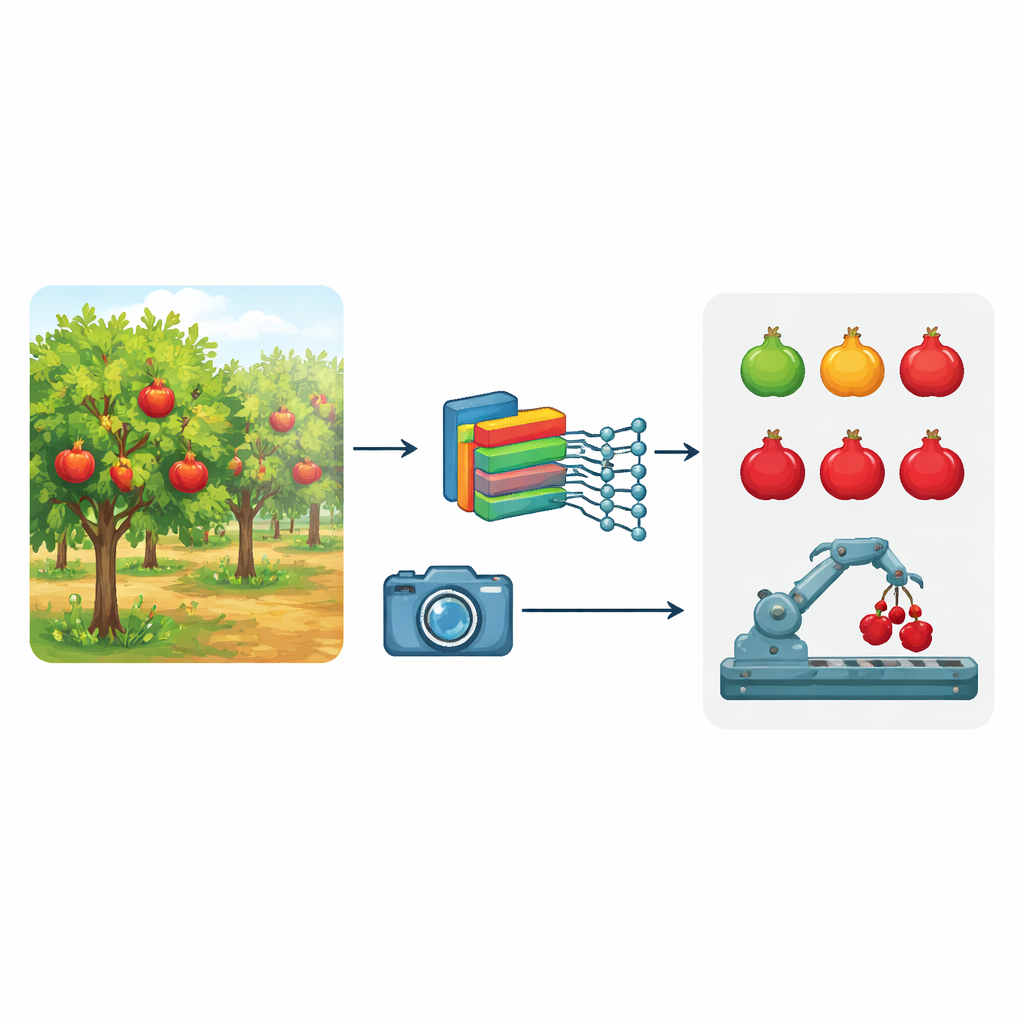

Genau zu wissen, wann Früchte reif zum Pflücken sind, gehört zu den wichtigsten – und zugleich schwierigsten – Entscheidungen in der Landwirtschaft. Diese Studie widmet sich diesem Problem bei Granatäpfeln, einer Kultur mit wachsender wirtschaftlicher und ernährungsphysiologischer Bedeutung. Statt sich auf menschliche Augen oder langsame Labortests zu verlassen, stellen die Autoren ein kompaktes KI-System vor, das gewöhnliche Fotos aus realen Obstgärten analysieren kann und bestimmt, wie weit jeder Granatapfel im Wachstumszyklus ist – von winzigen Knospen bis zur vollreifen Frucht. Ihr Ziel ist es, Ernteautomatisierung, Ertragsprognosen und Obstgartenmanagement schneller, genauer und praktisch nutzbar zu machen, selbst auf energiearmen Geräten.

Warum das Wachstum von Granatäpfeln schwer zu erkennen ist

Unter realen Feldbedingungen ist das Erkennen von Granatäpfeln nicht so einfach, wie es klingt. Früh in der Saison verschwinden kleine grüne Früchte fast im dichten grünen Laub, was viele bestehende Computer-Vision-Methoden verwirrt, die hauptsächlich auf Farbe achten. Später können reifende Früchte teilweise vom Laub verdeckt oder durch ungleichmäßiges Sonnenlicht in tiefen Schatten gedrängt werden, sodass Algorithmen Erkennungsboxen falsch platzieren oder Früchte ganz übersehen. Die meisten früheren Systeme konzentrieren sich zudem auf Früchte nach der Ernte oder auf einen einzelnen Zeitpunkt im Wachstumszyklus, was ihre Nützlichkeit für die Planung von Bewässerung, Düngung und Schädlingsbekämpfung über die ganze Saison einschränkt. Hinzu kommt, dass sehr genaue Modelle oft zu groß und energiehungrig sind, um auf den kleinen Rechnern von Feldrobotern und Edge-Geräten zu laufen.

Der Kamera beibringen, über Farbe hinaus zu sehen

Um diese Hürden zu überwinden, entwickelten die Forschenden ein neues Erkennungssystem, das sie GLMF-DEIM nennen. Zunächst stellten sie einen spezialisierten Datensatz aus 5.855 hochwertigen Bildern aus Obstgärten in der Provinz Shandong, China, zusammen, die zwischen April und Oktober unter unterschiedlichen Licht- und Wetterbedingungen aufgenommen wurden. Fachleute kennzeichneten 11.482 einzelne Granatapfelknospen, -blüten und -früchte und teilten sie in fünf Entwicklungsstadien sowie drei Größengruppen ein. Diese reichhaltige Sammlung ermöglicht es dem Modell, zu lernen, wie Granatäpfel in jeder Entwicklungsphase aussehen – von winzigen, fest geschlossenen Knospen bis zu großen, kräftig gefärbten reifen Früchten – und wie sie zu verschiedenen Tageszeiten und bei unterschiedlicher Blattbedeckung erscheinen.

Auf Textur und Details achten, nicht nur auf Farbe

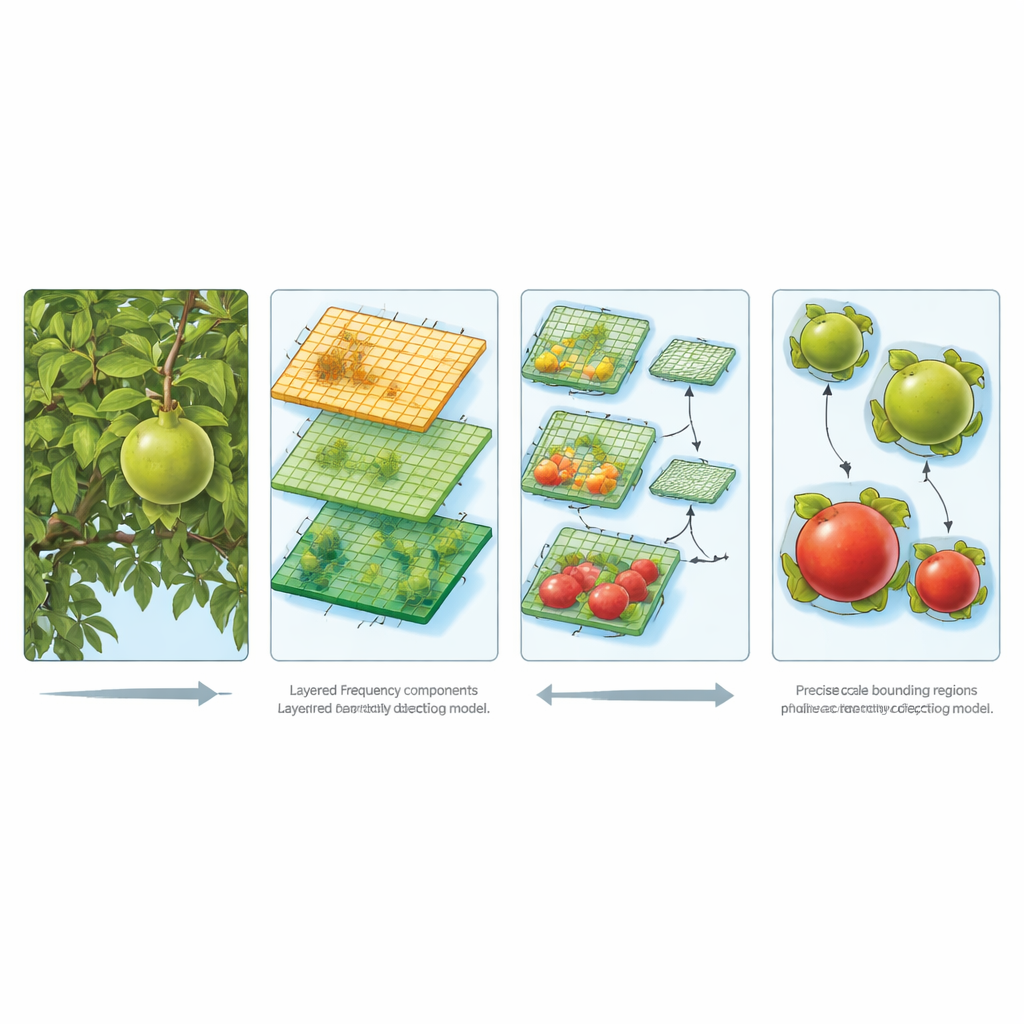

Im Kern von GLMF-DEIM steht eine Reihe cleverer Techniken, die der Maschine helfen, Früchte von Laub zu unterscheiden und kleine, subtile Merkmale wahrzunehmen, ohne unnötig Rechenleistung zu verschwenden. Ein Frontend-Modul verwendet eine mathematische Operation ähnlich der Aufspaltung von Klang in tiefe und hohe Töne. Es zerlegt das Bild in glatte Regionen und scharfe Kanten, nachdem zunächst kleines Hintergrundrauschen sanft geglättet wurde. Da Granatapfelschalen relativ glatt sind, während Blätter eine unruhige, strukturreiche Kulisse bilden, erleichtert diese auf Frequenzen basierende Sicht die Unterscheidung selbst dann, wenn beide dieselbe Grünton haben. Weitere leichte Module passen die Art der Verkleinerung des Bildes so an, dass wichtige Oberflächendetails, die mit dem Reifegrad zusammenhängen, erhalten bleiben, und sie lernen, besondere Aufmerksamkeit auf Informationen zu richten, die sich über verschiedene räumliche Skalen erstrecken – von kleinen Knospen bis zu großen reifen Früchten.

Jede Frucht sehen, groß oder klein

Über das Erkennen einzelner Texturen hinaus muss das System mit Früchten in vielen Größen umgehen, die im Bild verteilt sind. Dazu entwarfen die Autoren ein Merkmals-Fusionsnetzwerk, das eine Art Pyramide bildlicher Repräsentationen aufbaut. Auf höheren Ebenen erfasst das Modell breite Formen; auf niedrigeren Ebenen behält es feine Kanten und Muster bei. Informationen fließen sowohl nach oben als auch nach unten durch diese Pyramide, sodass jede Erkennungsschicht sowohl Kontext als auch lokale Details versteht. Der Erkennungskopf verwendet dann eine moderne Transformer-Architektur – eine Methode, Beziehungen zwischen vielen Punkten in einem Bild gleichzeitig zu modellieren – kombiniert mit einer verfeinerten Trainingsstrategie, die dicht variierte Beispiele zuführt, und einer Verlustfunktion, die sowohl übermäßig selbstsichere Fehler als auch zu wenig selbstsichere Treffer bestraft. Zusammen helfen diese Entscheidungen dem System, schnell zu konvergieren und in schwierigen Szenen mit überlappenden Früchten und unruhigem Hintergrund robust zu bleiben.

Bessere Genauigkeit bei geringerem Rechenaufwand

In Direktvergleichen mit führenden Objekterkennungssystemen schneidet der neue Ansatz am besten ab. Er identifiziert reife Granatäpfel mit etwa 93 Prozent Präzision unter einer standardisierten Bewertungsbedingung und behält auch unter strengeren Bewertungsregeln eine starke Leistung bei. Besonders bemerkenswert sind die Verbesserungen bei kleinen, schwer zu erkennenden Zielen, während er gleichzeitig bei großen Früchten ebenfalls hervorragend ist. Gleichzeitig benötigt er deutlich weniger Berechnungen und Parameter als rechenintensive Modelle, wodurch er sich zur Bereitstellung auf Feldrobotern, Drohnen oder kostengünstigen Überwachungsstationen eignet. Praktisch bedeutet das: Ein mit Kamera ausgestattetes Gerät könnte durch einen Granatapfelgarten fahren, zuverlässig verfolgen, wie sich die Früchte jedes Baums entwickeln, und Landwirten helfen zu entscheiden, wann und wo geerntet oder eingegriffen werden sollte – ganz ohne Supercomputer im Schuppen.

Zitation: Wang, Y., Liu, S., Hao, P. et al. Gaussian-Haar transform fusion enhances DEIM for pomegranate maturity detection. Sci Rep 16, 8246 (2026). https://doi.org/10.1038/s41598-026-39620-2

Schlüsselwörter: Granatapfel-Erkennung, Fruchtreife, intelligente Landwirtschaft, Computer Vision, Deep-Learning-Modelle