Clear Sky Science · de

AsynDBT: asynchrone verteilte bilevel-Optimierung für effizientes In-Context-Lernen mit großen Sprachmodellen

Warum schlauere Prompts für die Alltags-KI wichtig sind

Große Sprachmodelle treiben inzwischen Chatbots, Suchmaschinen und Schreibassistenten an, die viele Menschen täglich nutzen. Trotzdem hängen nützliche Antworten weiterhin stark davon ab, wie wir unsere Fragen formulieren und welche Beispiele wir dem Modell zeigen. Diese Arbeit stellt eine neue Methode vor, um solche Prompts und Beispiele automatisch über viele Geräte hinweg zu verfeinern, ohne die Daten einzelner Nutzer preiszugeben. Das Ergebnis ist ein KI‑System, das lernt, genauer und effizienter zu antworten — besonders bei spezialisierten Aufgaben wie der Wartung von Telekommunikationsnetzen.

KI durch Vorzeigen lehren, statt neu zu trainieren

Anstatt gigantische Modelle ständig neu zu trainieren, setzt ein wachsender Trend darauf, sie „im Moment“ zu unterrichten, indem man wenige sorgfältig ausgewählte Beispiele in den Prompt aufnimmt — ein Prozess, der als In-Context-Learning bekannt ist. Um etwa Filmkritiken als positiv oder negativ zu klassifizieren, zeigt man dem Modell eine kleine Menge gelabelter Beispiele und bittet es dann, eine neue Kritik zu bewerten. Der Haken ist, dass die Auswahl der Beispiele und die genaue Formulierung der Anweisungen die Leistung des Modells dramatisch verändern können. Gute Kombinationen von Hand zu finden ist langsam und teuer, und das Teilen roher Daten zwischen Organisationen ist oft aufgrund von Datenschutzregeln unmöglich.

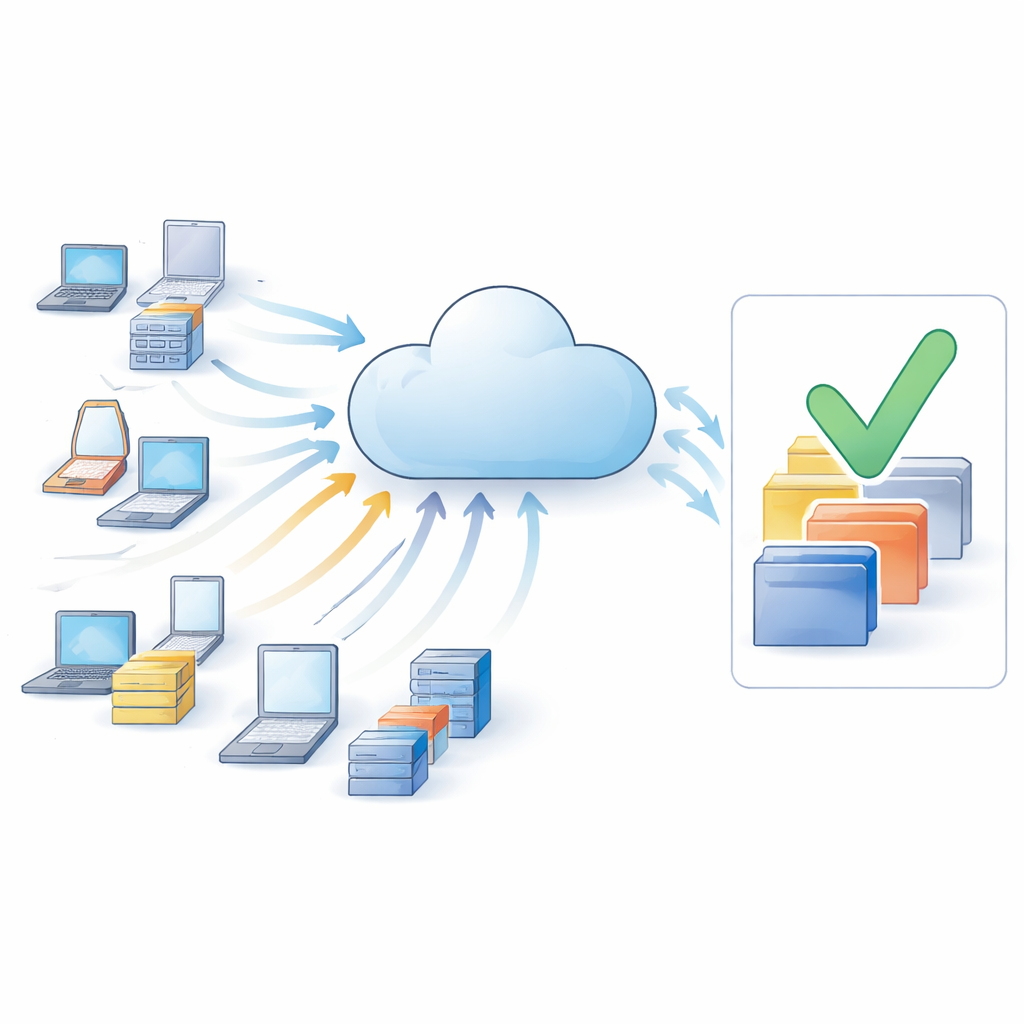

Zusammenarbeiten ohne private Daten zu teilen

Um Daten‑Sharing-Hürden zu umgehen, bauen die Autor:innen auf föderiertes Lernen auf, ein Setup, in dem viele separate Geräte oder Organisationen ihre Daten lokal halten, aber über einen zentralen Server zusammenarbeiten. Jeder Worker — etwa eine Mobilfunkbasisstation oder ein Unternehmensserver — kommuniziert mit demselben cloudbasierten Sprachmodell, lädt jedoch niemals Rohtexte hoch. Stattdessen sendet er nur Rückmeldesignale darüber, wie gut verschiedene Prompt‑ und Beispielauswahlen funktionieren. Ein neuer Algorithmus namens AsynDBT (asynchrone verteilte bilevel‑Optimierung) koordiniert diese Worker so, dass sie gemeinsam eine geteilte Prompt‑Strategie verbessern, dabei Datenschutz wahren und mit langsamen oder unzuverlässigen Netzwerkverbindungen umgehen.

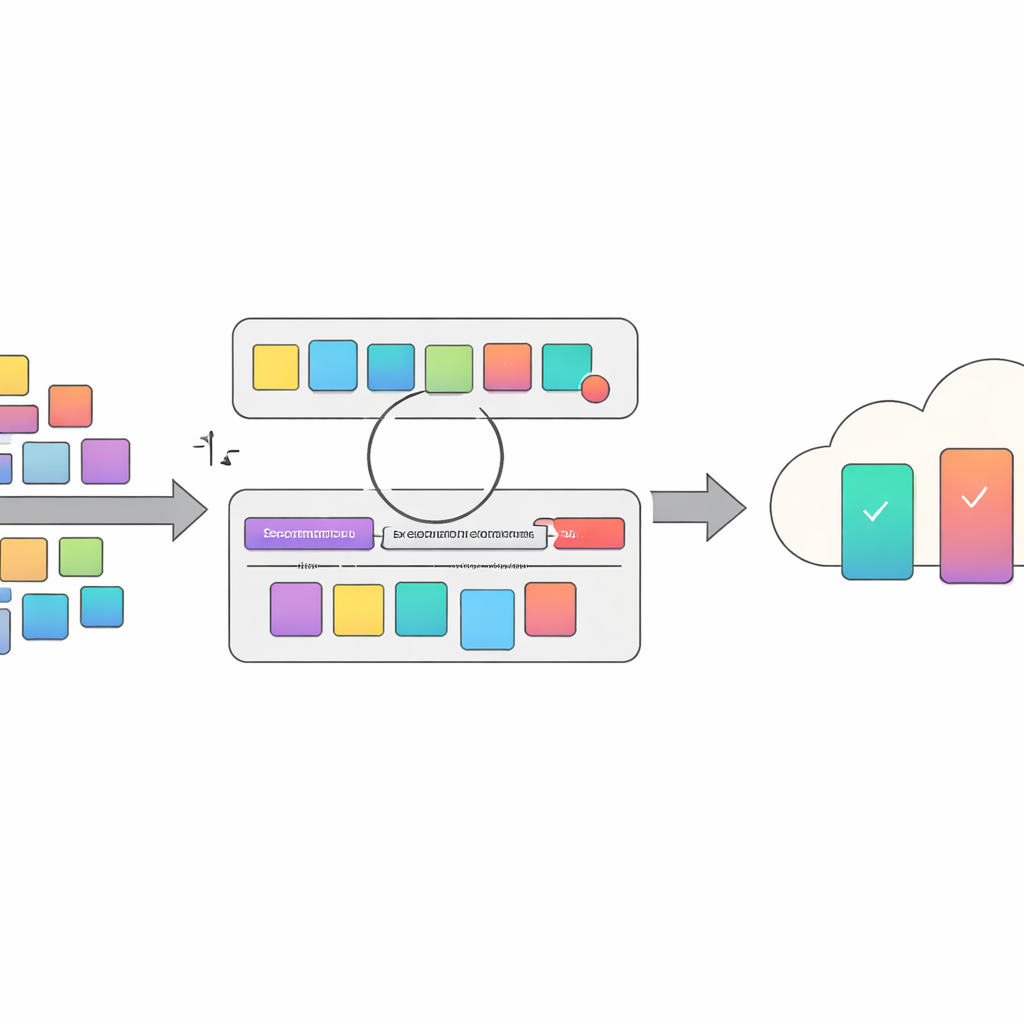

Optimierung sowohl der Anweisung als auch der Beispiele

Eine zentrale Idee der Arbeit ist, das Prompt‑Design als zweistufiges Optimierungsproblem zu behandeln. Auf der unteren Ebene passt das System kurze Fragmente an, die an die Aufgabenanweisung angehängt werden — kleine Wortänderungen, die das Modell zu besserem Schließen anregen können. Auf der oberen Ebene entscheidet es, welche gelabelten Beispiele als Demonstrationen aufgenommen werden. Diese beiden Ebenen interagieren: Unterschiedliche Beispielsätze verlangen nach unterschiedlichen Prompt‑Anpassungen und umgekehrt. AsynDBT formalisierte diese Beziehung mathematisch und verwendet eine effiziente Näherungsmethode, sodass jeder Worker seine lokalen Entscheidungen schrittweise aktualisieren kann, während ein zentraler Server eine konsistente globale Sicht der unteren Ebene beibehält.

Umgang mit langsamen Geräten und böswilligen Teilnehmern

In realen Netzwerken reagieren einige Geräte verspätet oder fallen aus, wodurch sogenannte „Stragglers“ entstehen, die synchrones Training zum Stillstand bringen können. AsynDBT arbeitet stattdessen asynchron: Der Server aktualisiert seine Variablen, sobald eine Teilmenge der Worker Rückmeldungen liefert, ohne auf alle zu warten. Die Methode schützt außerdem vor Workern, die irreführende Updates senden könnten — absichtlich oder versehentlich. Durch die Kombination von Regularisierungstechniken mit robusten Aggregationsregeln reduziert der Algorithmus die Auswirkungen vergifteter oder qualitativ schlechter Beispielauswahlen auf die globale Strategie und hilft dem Gesamtsystem, selbst bei Angriffen stabil und zuverlässig zu bleiben.

Bewiesene Verbesserungen bei Sprach‑ und Telekomaufgaben

Die Forschenden testeten AsynDBT an sechs Textklassifikationsproblemen, darunter ein anspruchsvolles 5G‑Netzwerkdatenset, bei dem das Modell beurteilen musste, ob spezialisierte Fachbegriffe miteinander verwandt sind, wobei nur Fragmente von Telekom‑Normen als Kontext dienten. Verglichen mit einer Reihe bestehender Prompting‑ und Beispielauswahlmethoden erzielte der neue Ansatz bei nahezu allen Aufgaben die beste oder zweitbeste Genauigkeit. Besonders bei der 5G‑Aufgabe verbesserte er die Genauigkeit um etwa zehn Prozentpunkte gegenüber der stärksten Baseline. Gleichzeitig reduzierte das asynchrone Design die Trainingszeit um rund 40 Prozent gegenüber einer ähnlichen zentralisierten Methode, die die Arbeit nicht verteilt.

Was das für künftige KI‑Werkzeuge bedeutet

Für Nicht‑Expert:innen lautet die Quintessenz, dass bessere Prompts und intelligentere Beispielauswahlen das Verhalten von KI‑Systemen deutlich verbessern können — ohne das zugrunde liegende Modell zu verändern. AsynDBT bietet einen automatisierten, datenschutzfreundlichen Weg, dies über viele kooperierende Geräte hinweg zu erreichen und liefert genauere sowie effizientere Sprachwerkzeuge für Bereiche wie Telekom‑Betrieb, Kundensupport und andere spezialisierte Felder. Für die Zukunft planen die Autor:innen, ihr Framework mit graphbasierten Wissensabrufverfahren zu kombinieren, damit Prompts auch auf aktuelle Fakten zugreifen können, Halluzinationen weiter reduzieren und KI‑Assistenten in risikobehafteten Szenarien vertrauenswürdiger machen.

Zitation: Ma, H., Dou, S., Liu, Y. et al. AsynDBT: asynchronous distributed bilevel tuning for efficient in-context learning with large language models. Sci Rep 16, 9381 (2026). https://doi.org/10.1038/s41598-026-39582-5

Schlüsselwörter: In-Context-Lernen, Prompt-Optimierung, föderiertes Lernen, große Sprachmodelle, datenschutzfreundliche KI