Clear Sky Science · de

Automatisierte Erkennung von Zapfen-Photorezeptoren mithilfe synthetischer Daten und Deep Learning in konfokalen adaptiven Optik-Scanning-Laser-Ophthalmoskop-Aufnahmen

Klarere Blicke ins lebende Auge

Die Fähigkeit, die lichtempfindlichen Zellen des Auges einzeln sichtbar zu machen, könnte verändern, wie Ärztinnen und Ärzte erblindende Erkrankungen erkennen und verfolgen. Heute müssen Expertinnen und Experten diese Zellen jedoch mühsam von Hand in stark vergrößerten Netzhautbildern markieren — ein langsamer, subjektiver Prozess, der sich nur schwer auf Tausende von Patientinnen und Patienten ausweiten lässt. Diese Studie zeigt, wie Computermodelle, die mit realistisch wirkenden „künstlichen“ Augenbildern trainiert wurden, lernen können, diese Zellen automatisch zu finden, und damit den Weg für schnellere, zuverlässigere Augenuntersuchungen und bessere Bewertung neuer Therapien ebnen.

Warum winzige Zellen wichtig sind

Die Rückseite des Auges ist mit Photorezeptoren ausgekleidet — spezialisierten Zellen, die Licht in die Signale umwandeln, die unser Gehirn als Sehen interpretiert. Insbesondere die Zapfen-Photorezeptoren sind für scharfes zentrales Sehen und Farbwahrnehmung unerlässlich, und ihr Verlust ist ein Kennzeichen vieler Netzhauterkrankungen. Eine leistungsfähige Bildgebungstechnik, die adaptive Optik Scanning Laser Ophthalmoskopie (AOSLO), kann detaillierte Aufnahmen dieser Zellen beim lebenden Menschen erzeugen. Bevor Ärztinnen, Ärzte und Forschende jedoch die Zapfendichte messen oder Veränderungen über die Zeit verfolgen können, müssen sie zunächst jeden einzelnen Zapfen im Bild eindeutig lokalisieren. Die manuelle Markierung dauert nicht nur sehr lange, sie kann auch zwischen Personen variieren und begrenzt so ihre Nützlichkeit in Routinekliniken und großen Studien.

Von handgefertigten Regeln zum Lernen aus Daten

Frühere Computerprogramme versuchten, die Zapfenerkennung durch feste Regeln zu automatisieren: etwa indem sie nach hellen Flecken einer bestimmten Größe oder Abstand suchten. Diese regelbasierten Methoden funktionierten auf sauberen Bildern gesunder Augen oft gut, hatten aber Schwierigkeiten, wenn die Aufnahmen verrauscht, leicht unscharf oder von erkrankten Augen stammten. Deep Learning bietet einen anderen Ansatz. Anstatt Regeln von Hand zu entwerfen, lernt ein neuronales Netzwerk Muster direkt aus Beispielen. Das Problem ist, dass solche Modelle üblicherweise riesige Mengen bereits sorgfältig von Experten gelabelter Bilder benötigen — genau die Art von Daten, die in der AOSLO-Bildgebung selten und teuer sind.

Aufbau eines virtuellen Trainingsfelds

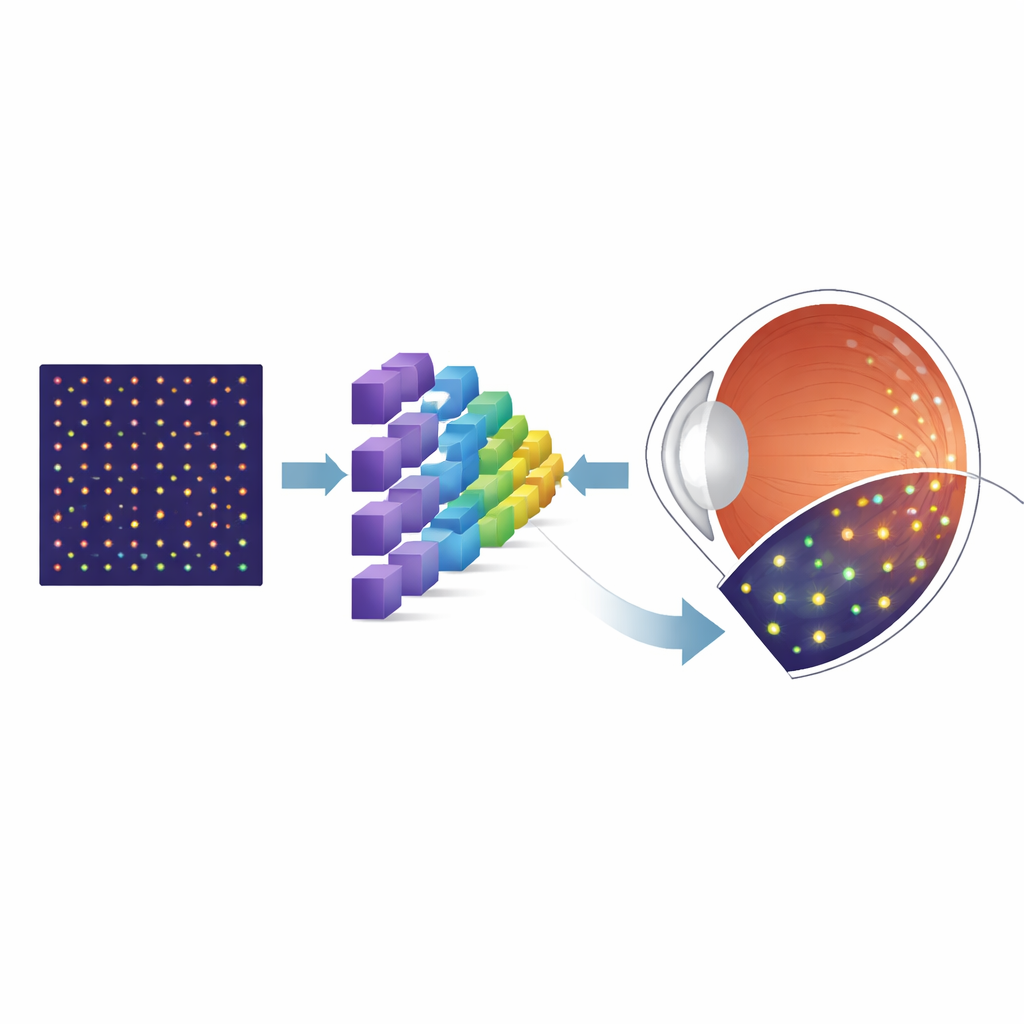

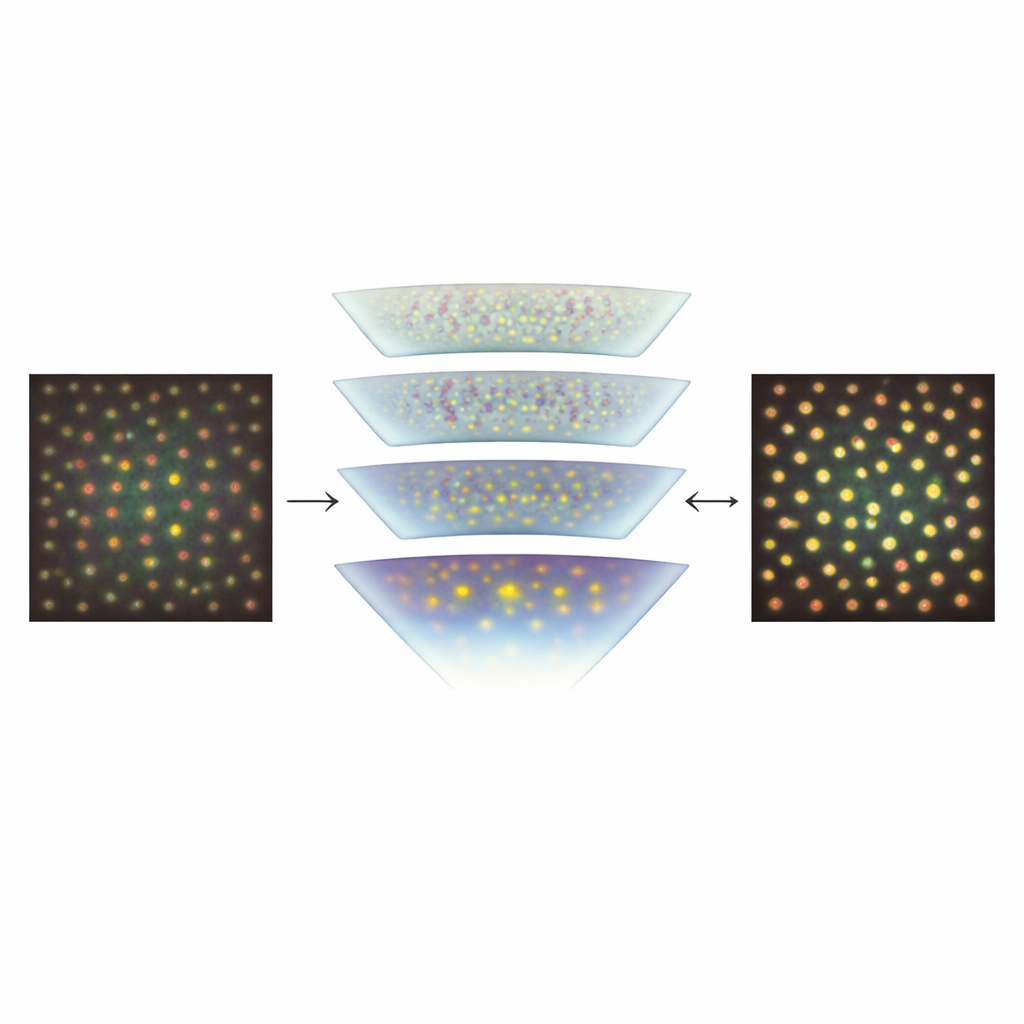

Um den Mangel an gelabelten realen Bildern zu umgehen, nutzten die Forschenden ein Simulationswerkzeug namens ERICA, das realistisch wirkende AOSLO-ähnliche Bilder von Zapfenmosaiken erzeugen kann — mitsamt perfektem „Ground Truth“, also der exakten Kenntnis, wo jeder Zapfen liegt. Sie erzeugten große Mengen dieser synthetischen Bilder, die viele Positionen auf der Netzhaut abdeckten, und variierten systematisch wichtige Bildfehler, die auch reale Aufnahmen beeinflussen, etwa zufälliges Rauschen und subtile optische Unschärfe. Anschließend trainierten sie eine spezialisierte Netzwerkarchitektur, bekannt als U-Net, so dass jedes Eingangsbild in eine Wahrscheinlichkeitskarte umgewandelt wurde, die anzeigt, wo sich Zapfen höchstwahrscheinlich befinden. Nach diesem ersten Training mit synthetischen Daten verfeinerten sie das Modell mit einer deutlich kleineren Sammlung realer AOSLO-Bilder aus einem bekannten öffentlichen Datensatz und testeten es schließlich an unabhängigen Aufnahmen aus einem anderen Labor, um zu prüfen, wie gut es generalisiert.

Wie gut der Computer mit menschlichen Expertinnen und Experten mithält

Das Team verglich die automatisierte Methode mit der mühsamen manuellen Kennzeichnung und mit zwei führenden Algorithmen zur Zapfenerkennung. Anhand einer standardisierten Messgröße für die Überlappung zwischen vorhergesagten und von Menschen markierten Zapfen erreichte das neue U-Net in dem öffentlichen Datensatz eine Leistung, die mit der der Expertinnen und Experten und der konkurrierenden automatischen Methoden übereinstimmte oder nahe daran lag. Entscheidend ist, dass das Modell auch auf einer separaten Bildersammlung, die in unterschiedlichen Entfernungen vom Sehzentrum aufgenommen und mit einem anderen Gerät erzeugt worden war, sehr gut abschnitt. Das deutet darauf hin, dass ein intensives Training an synthetischen Daten, die ein breites Spektrum visueller Bedingungen abdecken, dem Netzwerk geholfen hat, Merkmale zu lernen, die auf reale Bilder übertragbar sind, anstatt sich auf eine bestimmte Kamera oder Patientengruppe zu überanpassen.

Was das für die zukünftige Augenversorgung bedeuten könnte

Für Nicht‑Spezialistinnen und -Spezialisten lautet die Kernbotschaft, dass ein Programm, das weitgehend an „virtuellen“ Augenbildern trainiert wurde, nun reale Zapfenzellen in hochauflösenden Netzhautscans annähernd so zuverlässig finden kann wie menschliche Expertinnen und Experten. Indem die Zapfenerkennung schneller, objektiver und leichter über verschiedene Scanner und Kliniken anwendbar wird, könnte dieser Ansatz helfen, detaillierte Netzhautbildgebung zu einem routinemäßigen Instrument zur Verfolgung von Erkrankungen auf Einzelzellebene zu machen. Langfristig ließen sich ähnliche, von synthetischen Daten getriebene Methoden auch auf die Erkennung anderer Zelltypen und die Modellierung krankheitsbedingter Zellverluste ausweiten, was frühere Diagnosen, bessere Überwachung des Verlaufs und präzisere Bewertung neuer, das Sehvermögen erhaltender Therapien unterstützen würde.

Zitation: Shah, M., Young, L.K., Downes, S.M. et al. Automated cone photoreceptor detection using synthetic data and deep learning in confocal adaptive optics scanning laser ophthalmoscope images. Sci Rep 16, 8313 (2026). https://doi.org/10.1038/s41598-026-39570-9

Schlüsselwörter: Retinalbildgebung, Zapfen-Photorezeptoren, Deep Learning, synthetische Daten, adaptive Optik