Clear Sky Science · de

Interpretierbare und ressourcenschonende Sturzerkennung in einer historischen Galerie mittels YOLOv11-SEFA für den Einsatz am Edge

Warum Sicherheit in Galerien wichtig ist

Mit dem demografischen Wandel besuchen immer mehr ältere Menschen Museen und historische Galerien – schöne Orte, die nie für moderne Sicherheitsüberwachung konzipiert wurden. Ein einfacher Sturz kann in solchen Umgebungen zu schweren Verletzungen führen, doch Gebäude mit neuen Sensoren auszustatten oder laufend Kamerobilder zu beobachten ist teuer, aufdringlich und oft unpraktisch. Diese Arbeit untersucht eine neue Methode, um Stürze in solchen Räumen automatisch und schnell zu erkennen, mit kompakter künstlicher Intelligenz, die nahe an den Kameras läuft, ohne das Netz mit Video zu überfluten oder die Privatsphäre der Besucher zu verletzen.

Ein schwieriger Überwachungsort

Die Rochfort Gallery in North Sydney, ein restauriertes Gebäude aus den 1920er Jahren mit hohen Decken, aufwändigen Verzierungen, glänzenden Böden und Vitrinen, dient als Versuchsumgebung für diese Arbeit. Diese Merkmale machen den Raum für Besucher visuell reizvoll, erschweren jedoch die maschinelle Erkennung: Licht reflektiert an Glas, Schatten verändern sich im Tagesverlauf und Besucherströme schwanken. Schutzvorschriften für Denkmalpflege begrenzen zudem Bohrungen, Kabelverlegungen und sperrige Geräte. Die Autoren argumentieren, dass ein Sturzerkennungssystem hier kompakt, energieeffizient und datenschutzfreundlich sein muss, zugleich aber zuverlässig genug, um das Personal beim Schutz gefährdeter Besucher zu unterstützen.

Computern beibringen, wie ein Sturz aussieht

Zum Training ihres Systems griff das Team nicht auf ein kleines, künstlich erzeugtes Datenset zurück. Stattdessen erweiterten sie eine bestehende Bildsammlung um tausende zusätzlicher Fotos, aufgenommen in Museen, Galerien und Gemeindehäusern. Jedes Bild wurde als normale Körperhaltung (zum Beispiel Stehen oder Gehen) oder als Sturzhaltung (auf dem Boden liegend in verschiedenen Orientierungen) gelabelt und aus unterschiedlichen Blickwinkeln erfasst – von der Decke, von der Seite und auf Augenhöhe – unter Bedingungen von Tageslicht bis zu schwach beleuchteten, spotlichtartigen Räumen. Sie fügten bewusst Szenen mit teilweiser Verdeckung durch Möbel oder andere Besucher sowie überfüllte Räume hinzu, um die Unordnung und Verwirrung öffentlicher Räume realistisch abzubilden.

Ein leichter, intelligenter Beobachter am Edge

Das Herzstück des Systems ist ein schlankes Objekterkennungsnetzwerk namens YOLOv11‑SEFA, das jede Kameraframe analysiert und entscheidet, ob jemand gestürzt ist. Anstatt ein schwereres und komplexeres Modell zu bauen, fügen die Autoren zwei gezielte Anpassungen zu einem bestehenden schnellen Detektor hinzu, damit dieser besonders auf kleine oder teilweise verdeckte Körper und auf Bereiche achtet, in denen eine Person den Boden berührt. Das erhöht sowohl die Trefferquote bei echten Stürzen als auch die Genauigkeit der Begrenzungsrahmen, während der Rechenaufwand gering genug bleibt, um auf einfachen „Edge“-Computern im Gebäude zu laufen. Tests gegenüber mehreren verbreiteten Alternativen zeigen, dass dieses getunte Modell eines der besten Kompromisse zwischen Genauigkeit und Geschwindigkeit bietet und dabei nur einen geringen Anstieg des Energiebedarfs gegenüber dem Ausgangsmodell benötigt.

Von einfachen Alarmen zu gestuften Risikowertungen

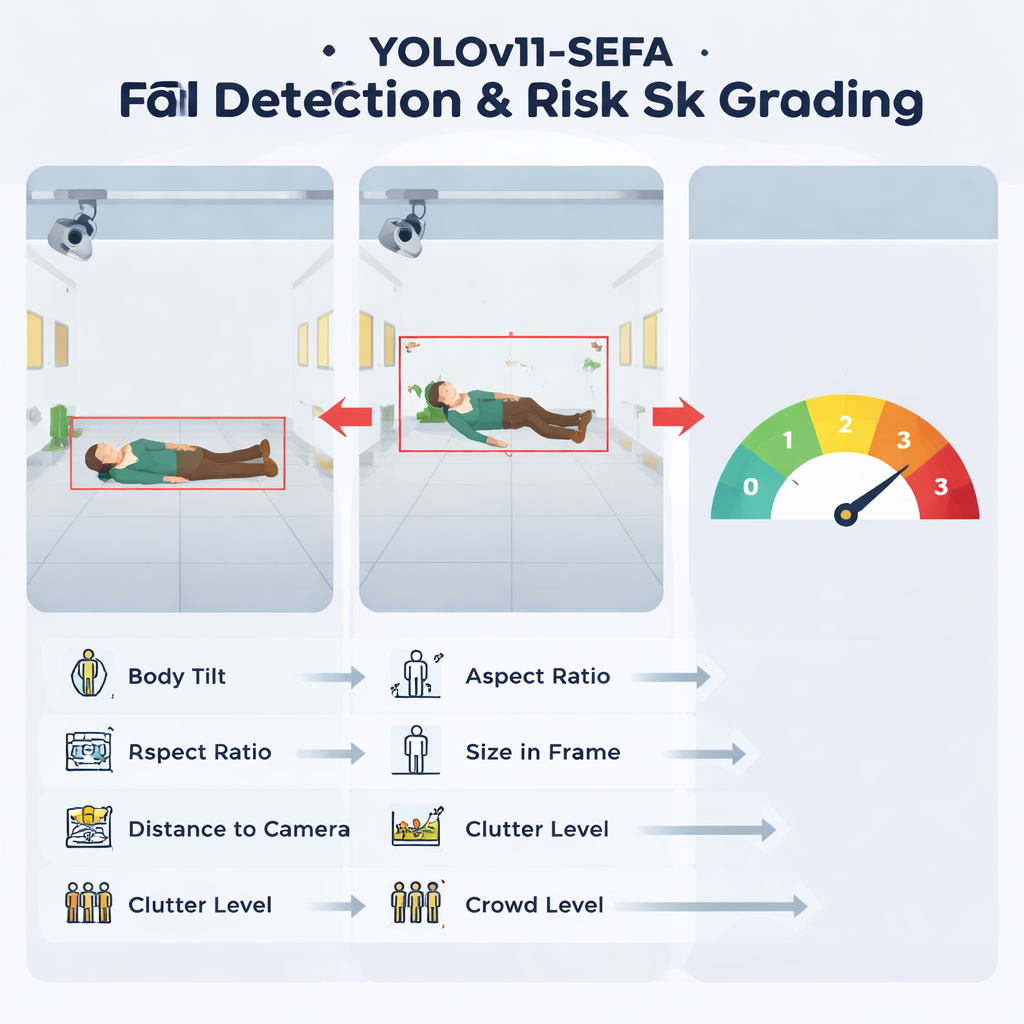

Statt nur „Sturz“ oder „kein Sturz“ zu melden, geht das System einen Schritt weiter und ordnet jedem erkannten Ereignis ein Risikoniveau von 0 bis 3 zu. Dazu wandelt es die visuelle Erkennung in sechs einfache Zahlen um: wie viel des Bildes die Person einnimmt, wie stark sie geneigt ist, wie weit sie scheinbar von der Kamera entfernt ist, wie gestreckt oder platt ihr Umriss wirkt, wie visuell unruhig der umgebende Bereich ist und wie viele andere Personen anwesend sind. Ein separates Entscheidungsmodell, inspiriert von Expertenmeinungen zur Sicherheit, kombiniert diese Werte zu vier Stufen: normale Aktivität, geringes Risiko durch ungewöhnliche Haltung, mittelhohes Risiko und offensichtliche, hochriskante Stürze. Wichtig ist, dass die Autoren ein Erklärungswerkzeug einsetzen, um zu bestätigen, dass das Modell tatsächlich vorwiegend auf haltungsspezifische Hinweise wie Körperneigung und -form vertraut und nicht auf irrelevante Hintergrunddetails.

Tests in der realen Galerie

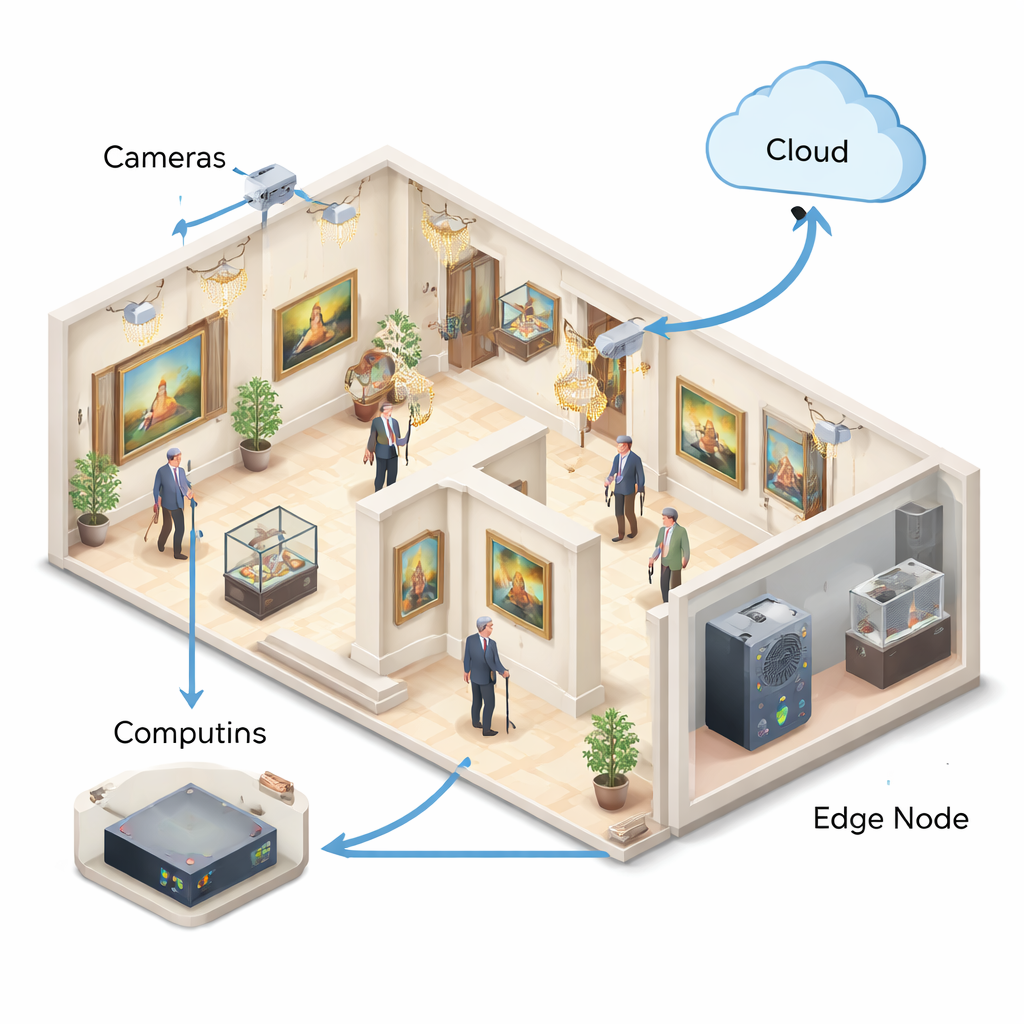

Das vollständige System verbindet Kameras, lokale Edge‑Computer und einen Cloud‑Service zu einer vierstufigen Pipeline. Kameras streamen Videos in reduzierter Rate an kompakte Rechner auf derselben Etage, die den Sturzerkenner ausführen und Alarme erzeugen; nur kurze Ausschnitte oder Heatmap‑Überlagerungen werden bei Bedarf in die Cloud gesendet, was sowohl Bandbreite als auch Datenschutzbelastung begrenzt. In einem 72‑stündigen Pilotversuch in der Rochfort Gallery hielt das System Reaktionszeiten von rund einer Viertelsekunde selbst in überfüllten Szenen ein und erzeugte zu Spitzenzeiten weniger als einen Fehlalarm pro Stunde – meist ausgelöst durch Besucher, die sich zum Fotografieren bücken –, während inszenierte Teststürze alle erkannt wurden. Die Autoren betonen, dass diese Zahlen aus einem relativ kurzen, kontrollierten Versuch stammen, zeigen jedoch, dass der Ansatz technisch in einer anspruchsvollen realen Umgebung umsetzbar ist.

Was das für zukünftige öffentliche Räume bedeutet

Für Nicht‑Experten ist das wichtigste Ergebnis, dass es jetzt möglich ist, bestehenden Kamerasystemen in historischen Galerien und ähnlichen öffentlichen Gebäuden eine automatische, gestufte Sturzwarnschicht hinzuzufügen, ohne größere Umbauten oder ständiges menschliches Monitoring. Indem ein effizienter Detektor auf kleinen Rechnern vor Ort läuft und die Interpretation sowie Weitergabe der Ergebnisse sorgfältig strukturiert wird, liefert das System erste Hinweise darauf, dass Technologie dezent im Hintergrund wachen kann – wahrscheinliche Stürze erkennen, deren Schwere einstufen und das mit moderater Hardware und Blick auf den Datenschutz. Breitere und längere Tests sowie Anpassungen für andere Gebäudetypen werden nötig sein, bevor dies als stadtweiter Sicherheitsstandard gelten kann, doch diese Arbeit zeichnet einen klaren, praxisnahen Weg in diese Richtung auf.

Zitation: Wu, S., Yang, H., Hu, Y. et al. Interpretable and lightweight fall detection in a heritage gallery using YOLOv11-SEFA for edge deployment. Sci Rep 16, 7795 (2026). https://doi.org/10.1038/s41598-026-39527-y

Schlüsselwörter: Sturzerkennung, intelligente Galerien, Edge‑KI, Sicherheit älterer Menschen, Computer Vision