Clear Sky Science · de

Benchmark‑Bewertung von Video‑Large‑Language‑Models zur Qualitätsbewertung wissenschaftspopularisierender Videos über trockene Augen

Warum das für Alltagszuschauer wichtig ist

Kurzvideo‑Apps werden immer häufiger zur ersten Anlaufstelle für Gesundheitsrat, auch bei Augenproblemen wie trockenen Augen, die weltweit Hunderte Millionen Menschen betreffen. Neben hilfreichen Clips sind jedoch leicht auch qualitativ schlechte oder irreführende Videos zu finden, die für Ärztinnen und Ärzte schwer zu kontrollieren sind. Diese Studie untersucht, ob neue KI‑Systeme, die Videos „ansehen“ können, dabei helfen könnten, die Qualität solcher Gesundheitsclips automatisch zu prüfen, und zeigt, warum solche Werkzeuge derzeit noch nicht bereit sind, fachliche Beurteilungen zu ersetzen.

Trockene Augen und der Aufstieg von Gesundheitsvideos

Trockene Augen sind mehr als eine kleine lästige Erscheinung: Sie können das Sehen trüben, Schmerzen verursachen und Arbeit sowie Alltag beeinträchtigen. Da die Erkrankung, insbesondere bei älteren Menschen und intensiven Bildschirmnutzern, häufiger wird, suchen viele online nach Erklärungen und Selbsthilfetipps. Plattformen wie TikTok bieten zahllose Kurzvideos zum Thema trockene Augen, doch ihre offene Struktur ermöglicht jedem das Posten von Inhalten, unabhängig von medizinischer Ausbildung. Schlechte oder überzogene Ratschläge können eine angemessene Behandlung verzögern oder zu unsicheren Hausmitteln führen; daher werden zuverlässige Methoden zur großskaligen Prüfung der Videoqualität dringend benötigt.

Wie die Forschenden die KI‑Videoprüfer testeten

Das Team sammelte 185 chinesischsprachige TikTok‑Videos über trockene Augen mithilfe eines neuen, neutralen Accounts und strenger Regeln, um nur originale, lehrhafte Clips zu behalten. Zwei Augenärztinnen bzw. -ärzte bewerteten anschließend jedes Video mit drei etablierten Instrumenten, die häufig in der medizinischen Bildungsforschung verwendet werden. Ein Instrument beurteilte, wie leicht die Videos zu verstehen waren und wie klar sie konkrete Handlungsschritte vorschlugen. Ein zweites gab eine Gesamtnote von schlecht bis ausgezeichnet. Das dritte zerlegte die Qualität in Aspekte wie den Fluss der Präsentation, die Genauigkeit, den Einsatz zusätzlicher Elemente wie Animationen und die Übereinstimmung des Inhalts mit dem Videotitel.

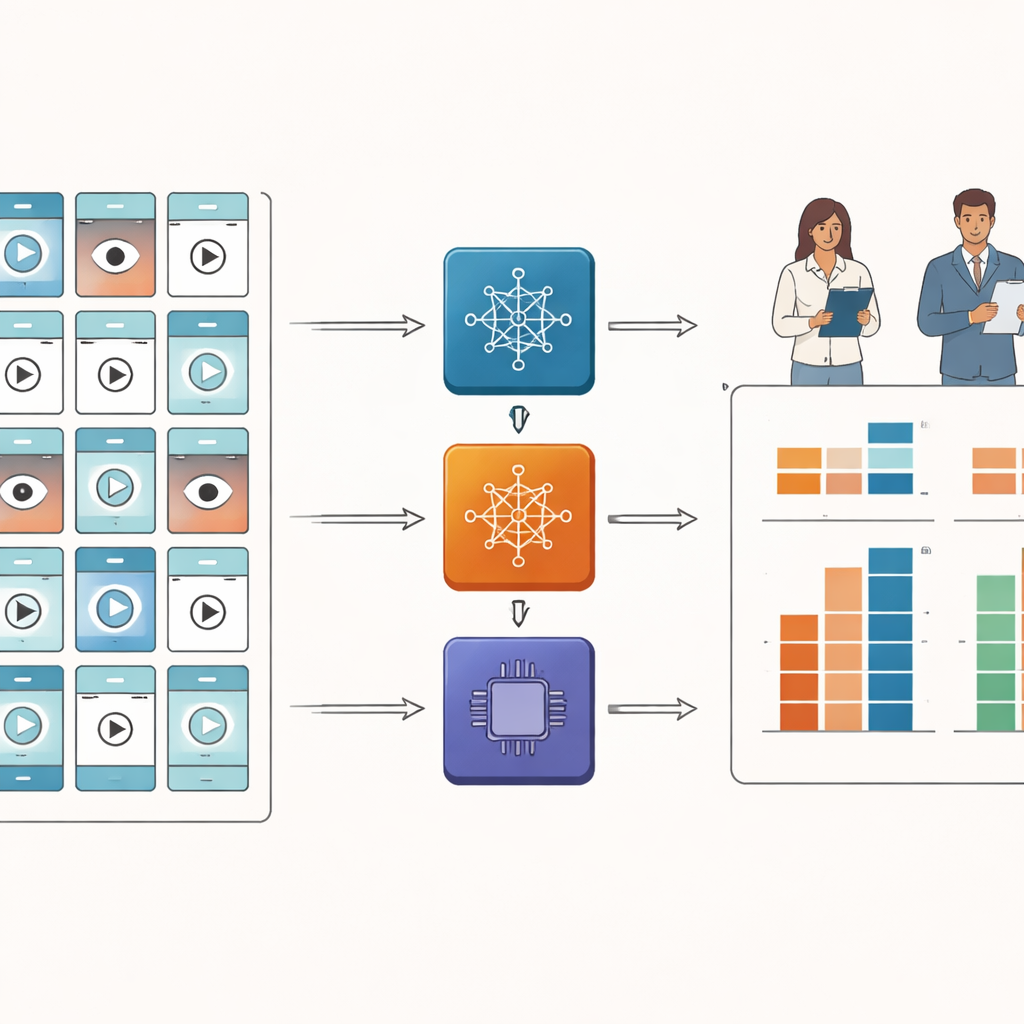

Die auf Video spezialisierten KI‑Modelle auf dem Prüfstand

Anschließend fütterten die Forschenden dieselben Videos in drei fortgeschrittene "Video‑Large‑Language‑Models", KI‑Systeme, die darauf ausgelegt sind, visuelle Informationen Bild für Bild zu interpretieren und Fragen zu dem, was sie sehen, zu beantworten. Sie formulierten detaillierte Anweisungen, damit jedes Modell die Bewertungsinstrumente der Ärztinnen und Ärzte so genau wie möglich nachahmte. Die zentrale Frage war, ob die KI und die menschlichen Expertinnen und Experten ähnliche Bewertungen abgeben würden. Zur Messung nutzte das Team eine standardisierte Reliabilitätskennzahl, die erfasst, wie eng zwei verschiedene "Richter" übereinstimmen — nicht nur in Tendenzen, sondern in konkreten Zahlenwerten.

Was die KI richtig — und falsch — machte

Die menschlichen Bewerterinnen und Bewerter waren größtenteils untereinander einig, was darauf hindeutet, dass ihre Bewertungen stabil und verlässlich waren. Im Gegensatz dazu zeigten die drei KI‑Systeme in den meisten Bereichen nur geringe Übereinstimmung mit den Expertinnen und Experten. Keines der Modelle konnte zuverlässig die Ärztinnen und Ärzte bei der Gesamtqualität der Videos oder bei detaillierten Merkmalen wie der Übereinstimmung von Titeln und Inhalten erreichen. Ein Modell neigte dazu, höhere Bewertungen als die Expertinnen und Experten zu vergeben, ein anderes gab tendenziell niedrigere Noten, und nur eines lag gelegentlich dazwischen. Ein relativer Lichtblick war die "Handlungsempfehlung" — also wie klar Videos den Zuschauenden sagen, was zu tun ist — wo zwei Modelle ein mittleres Maß an Übereinstimmung erreichten, aber immer noch nicht ausreichend für Entscheidungen in der realen Welt waren.

Warum die heutige KI noch nicht ausreicht

Die Autorinnen und Autoren nennen mehrere Gründe für diese Lücke. Die getesteten KI‑Systeme wurden vorwiegend mit Alltagszenen und allgemeinen Videoaufgaben trainiert, nicht mit sorgfältig strukturierten Gesundheitslehrmaterialien. Viele Wissenschaftsvideos stützen sich stark auf gesprochene Erklärungen, Untertitel, Diagramme und Metaphern statt auf dramatische Bewegung, doch die Modelle in dieser Studie analysierten nur die visuellen Frames und hörten nicht auf das Audio noch lasen sie Titel oder andere beschreibende Informationen, die Menschen zur Beurteilung von Relevanz und Genauigkeit nutzen. Infolgedessen gingen große Teile der Bedeutung an der KI vorbei, besonders wenn wichtige Details gesprochen statt gezeigt wurden. Bildhafte Sprache, die in chinesischen Gesundheitsvideos häufig vorkommt, kann Systeme verwirren, die Aussagen wörtlich interpretieren.

Was das für Patientinnen, Patienten und Plattformen bedeutet

Diese Arbeit liefert eine frühe Roadmap, aber keinen gebrauchsfertigen Sicherheitsmechanismus. Sie zeigt, dass sich bekannte Qualitätschecklisten für Gesundheitsinformationen grundsätzlich in Anweisungen für KI‑Modelle, die Videos "ansehen", übersetzen lassen. Sie macht aber auch deutlich, dass aktuelle allgemein einsetzbare Systeme noch nicht zuverlässig genug sind, um medizinische Videos zu bewerten oder Fehlinformationen ohne menschliche Aufsicht zu kontrollieren. Durch die Veröffentlichung ihres Bewertungsrahmens und ihres annotierten Videodatensatzes hoffen die Autorinnen und Autoren, die Entwicklung besserer, spezialisierter Modelle anzustoßen, die Bilder, Ton und Zusatzkontext kombinieren und über Krankheiten und Sprachen hinweg arbeiten können. Bis dahin sollten Zuschauende kurze Gesundheitsvideos weiterhin als Ausgangspunkt und nicht als medizinischen Rat betrachten, und Plattformen sollten sich nicht allein auf KI verlassen, um vertrauenswürdige Informationen zu gewährleisten.

Zitation: Zhou, S., Huang, M., Wei, J. et al. Benchmark evaluation of video large language models in quality assessment of science popularization videos for dry eye. Sci Rep 16, 8756 (2026). https://doi.org/10.1038/s41598-026-39444-0

Schlüsselwörter: trockene Augen Krankheit, Gesundheitsvideos, künstliche Intelligenz, Fehlinformationen, TikTok