Clear Sky Science · de

Aktive Prüfung mit Knowledge Distillation für kosteneffiziente Fehlerprognosen im Fertigungsprozess

Warum es wichtig ist, fehlerhafte Produkte früh zu erkennen

Von Smartphones bis zu Elektroautos sind wir auf komplexe Produkte angewiesen, die aus tausenden winziger Teile bestehen. Wenn nur wenige dieser Teile fehlerhaft sind, kann das teure Nacharbeiten in der Fabrik, Produktrückrufe oder sogar Sicherheitsrisiken für Kundinnen und Kunden nach sich ziehen. Hersteller führen daher viele Tests durch, um Probleme früh zu erkennen — doch die gründlichsten Tests sind auch die langsamsten und teuersten. Dieser Beitrag untersucht, wie Fabriken künstliche Intelligenz nutzen können, um vorherzusagen, welche Produkte wahrscheinlich ausfallen, und dabei die Testkosten im Griff zu behalten.

Zwei Arten von Prüfungen in der Fabrik

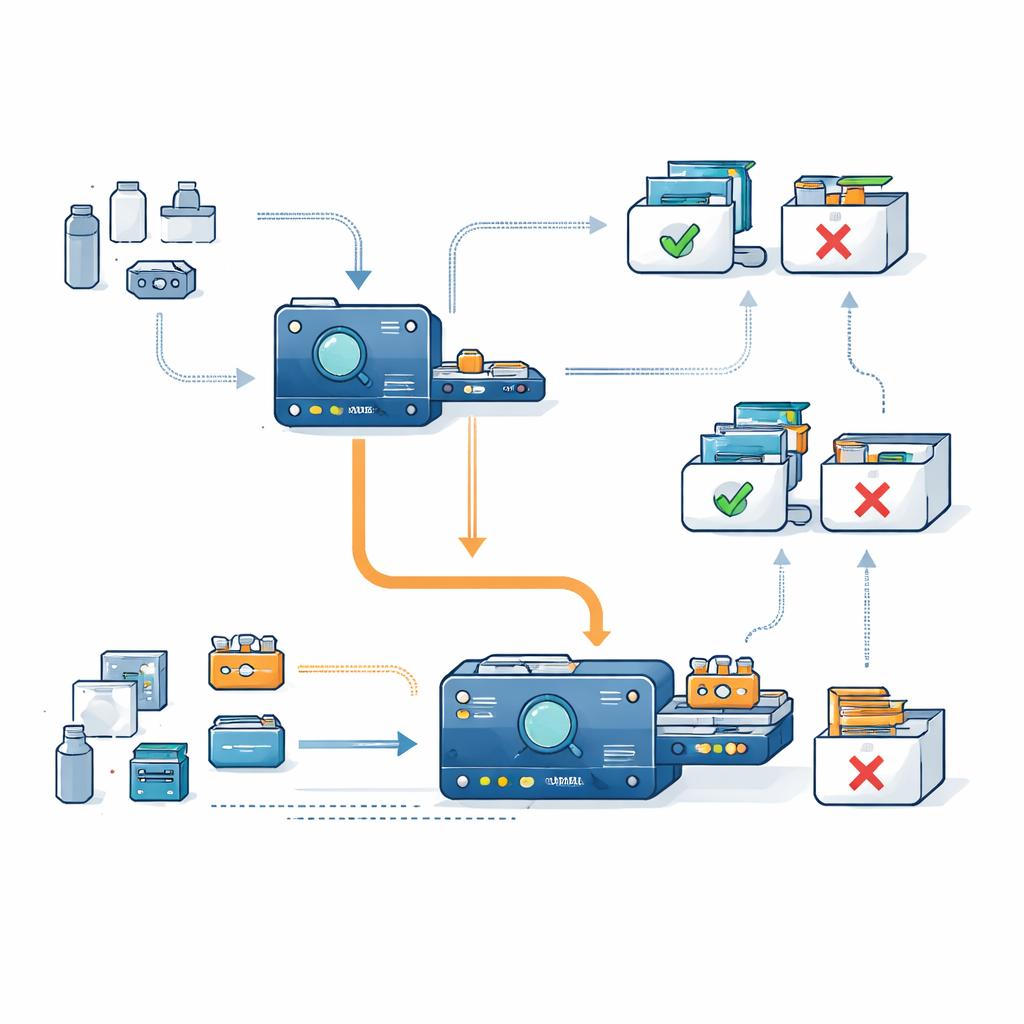

In modernen Produktionslinien durchläuft nicht jedes Teil dasselbe Prüfungsniveau. Einfache, schnelle Tests werden auf jedes Produkt angewandt; die Autorinnen und Autoren bezeichnen diese als Basisinspektionen. Detailliertere Tests, die spezielle Geräte oder harte Bedingungen erfordern können, sind aufgrund ihrer Kosten und Zeitintensität nur für eine kleinere Stichprobe vorgesehen; diese werden als fortgeschrittene Inspektionen bezeichnet. Computermodelle, die zukünftige Fehler vorhersagen, funktionieren besser, wenn sie sowohl Ergebnisse aus Basis- als auch aus fortgeschrittenen Tests sehen, was jedoch bedeutet, dass mehr der teuren Inspektionen bezahlt werden müssen. Modelle, die sich nur auf Basisergebnisse stützen, sind in der Anwendung günstiger, aber in der Regel weniger genau.

Ein billigen Test beibringen, wie ein teurer zu denken

Die Forschenden adaptieren eine Idee aus dem maschinellen Lernen, bekannt als Knowledge Distillation, für diesen Fertigungskontext. Zuerst trainieren sie ein fortgeschrittenes Modell, das Zugriff auf Daten aus Basis- und fortgeschrittenen Inspektionen hat und lernt, vorherzusagen, ob ein Produkt letztlich den Endtests standhält. Anschließend trainieren sie ein Basis-Modell, das nur die kostengünstigen Tests sieht — dabei wird sein Lernprozess so gesteuert, dass seine Vorhersagen die des fortgeschrittenen Modells nachahmen. Effektiv wird dem Basis-Modell beigebracht, die reichere Einschätzung des fortgeschrittenen Modells zu approximieren, während es im Einsatz in der Linie weiterhin nur von den preiswerten Messungen abhängt.

Entscheiden, wann mehr in Tests investiert wird

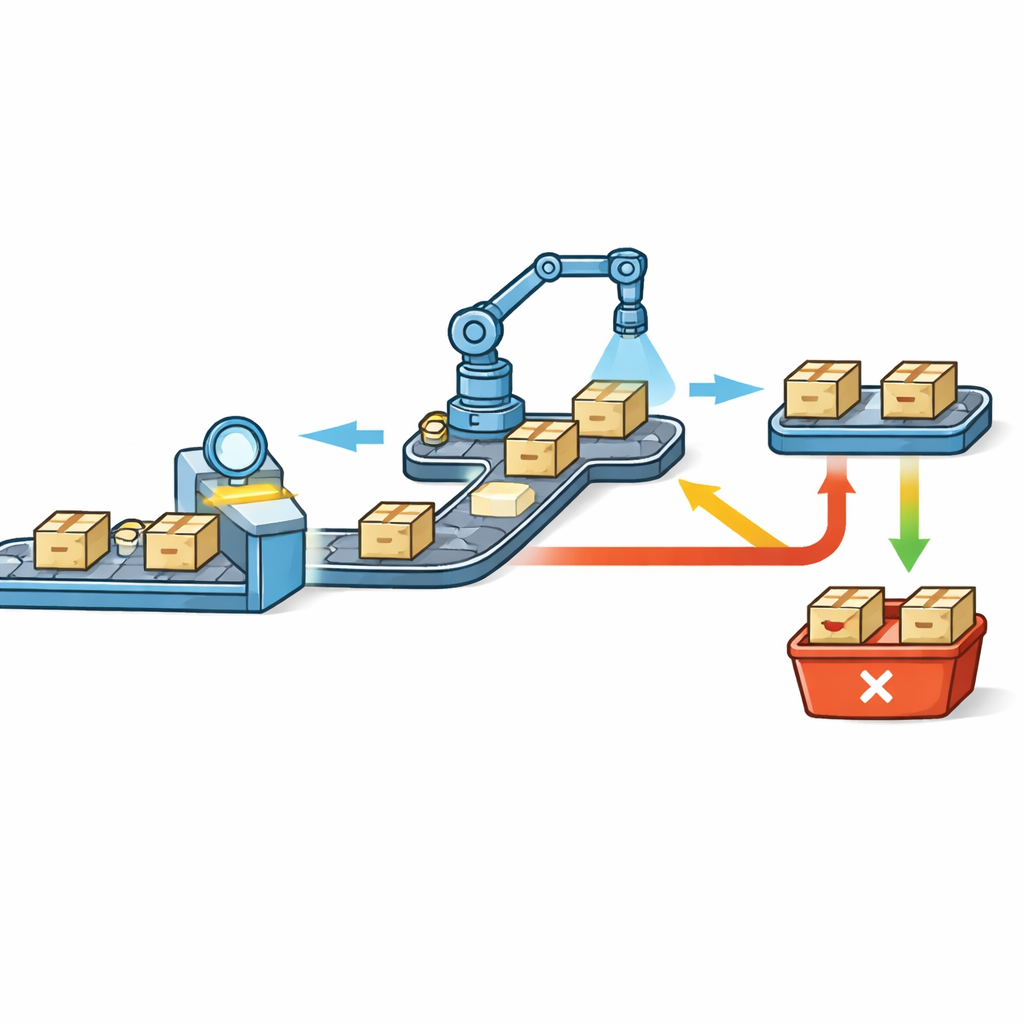

Sobald das Basis-Modell auf diese Weise verbessert wurde, binden die Autorinnen und Autoren es in ein aktives Inspektions-Framework ein. Jedes Produkt erhält zunächst Basisinspektionen und wird vom aufgerüsteten Basis-Modell bewertet, das außerdem ein Maß für seine Zuversicht in seine Einschätzung ausgibt. Wenn das Modell sicher ist, dass ein Teil eindeutig gut oder eindeutig schlecht ist, kann die Fabrik die teuren fortgeschrittenen Tests überspringen. Nur Teile mit unsicheren Vorhersagen werden zur fortgeschrittenen Inspektion und Bewertung durch das fortgeschrittene Modell weitergeleitet. Diese selektive Strategie zielt darauf ab, teure Prüfungen für die Produkte vorzubehalten, bei denen sie den größten Unterschied machen.

Test des Ansatzes in der Chipfertigung

Um zu prüfen, wie gut dieser Ansatz in der Praxis funktioniert, analysierte das Team reale Daten eines Halbleiterherstellers. In der Chipproduktion unterziehen sich Wafer vielen elektrischen Tests; einige werden bei jedem Chip durchgeführt, während andere unter rauen Bedingungen nur auf eine Teilmenge angewandt werden. Die Autorinnen und Autoren bauten sowohl Basis- als auch fortgeschrittene Vorhersagemodelle mit zwei verschiedenen Arten von Machine‑Learning‑Algorithmen und verglichen Modelle, die mit und ohne Knowledge Distillation trainiert wurden. Sie untersuchten zudem mehrere Methoden zur Messung von Vorhersageunsicherheit, um zu entscheiden, welche Chips fortgeschrittene Inspektionen erhalten sollten, und bewerteten die Leistung mithilfe einer standardisierten Kennzahl, die widerspiegelt, wie gut die Modelle gute von schlechten Chips unterscheiden.

Bessere Qualität bei geringeren Kosten

Die Experimente zeigten, dass die mit Knowledge Distillation trainierten Basis-Modelle durchgehend genauer waren als gewöhnliche Basis-Modelle und in einem Datensatz sogar das vollwertige fortgeschrittene Modell leicht übertrafen. Wenn diese verbesserten Basis-Modelle mit der aktiven Inspektionsstrategie kombiniert wurden, konnten Fabriken nahezu dieselbe Fehlererkennungsleistung erreichen wie bei einer Prüfung jedes Produkts mit fortgeschrittenen Inspektionen, während deutlich weniger Teile diesen teuren Tests unterzogen wurden. Kurz gesagt: Die Methode ermöglicht es Herstellern, mehr Defekte früher und verlässlicher zu erkennen, ohne alles auf höchstem Prüfungsniveau inspizieren zu müssen, und bietet einen praktikablen Weg zu höherer Qualität bei niedrigeren Produktionskosten.

Zitation: Heo, J., Son, M. & Shim, J. Active inspection with knowledge distillation for cost-effective fault prediction in manufacturing process. Sci Rep 16, 8613 (2026). https://doi.org/10.1038/s41598-026-39412-8

Schlüsselwörter: Fertigungsqualität, Fehlerprognose, Inspektionskosten, Knowledge Distillation, Halbleiterproduktion