Clear Sky Science · de

Optimierung von Maßnahmen gegen Infektionskrankheiten mit Reinforcement Learning anhand von COVID-19‑Daten aus dem Vereinigten Königreich

Intelligente Werkzeuge für schwierige Gesundheitsentscheidungen

Wenn sich eine neue Krankheit in einem Land ausbreitet, müssen Entscheidungsträger rasch festlegen, wie stark das öffentliche Leben eingeschränkt werden soll. Alles dichtzumachen kann Leben retten, aber die Wirtschaft schädigen; zu zögerlich zu handeln führt zu überlasteten Krankenhäusern. Dieses Papier untersucht, ob eine Form künstlicher Intelligenz, genannt Reinforcement Learning, Regierungen dabei helfen kann, ausgewogenere, klügere Reaktionen zu finden, indem detaillierte Simulationen genutzt werden, die zeigen, wie sich ein Virus wie COVID‑19 tatsächlich in realen Gemeinschaften ausbreitet.

Ein Land im Computer nachbilden

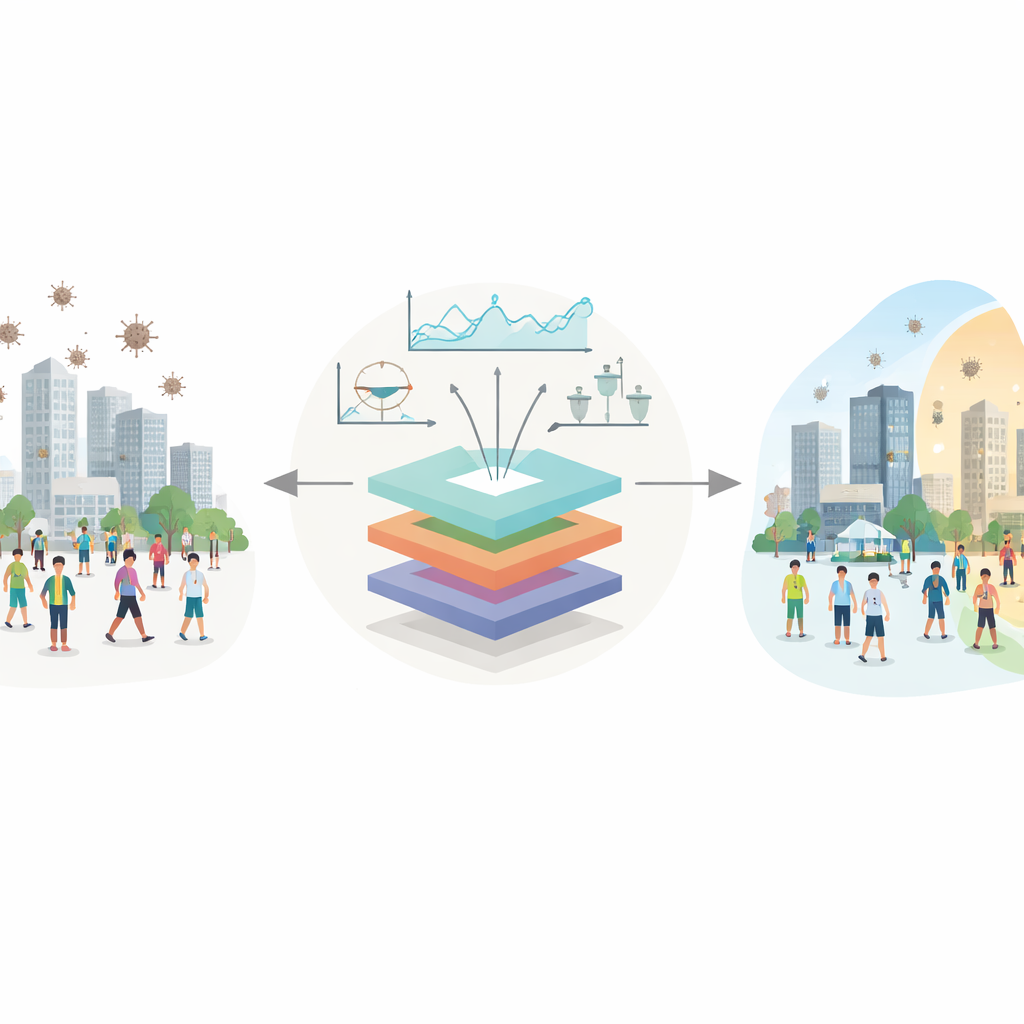

Anstatt einfache Gleichungen zu verwenden, die Menschen als identisch behandeln, bauen die Autor:innen auf Covasim auf, einem umfangreichen Computermodell, das tausende virtuelle Personen verfolgt, während sie leben, arbeiten, lernen und interagieren. Jede simulierte Person hat ein Alter, einen Platz in Familien-, Schul‑ und Arbeitsnetzwerken und einen Gesundheitszustand, der sich von gesund zu infiziert zu genesen oder tot verändern kann. Durch sorgfältiges Anpassen der Modelleinstellungen bringt das Team dieses virtuelle Vereinigte Königreich dazu, sich so zu verhalten wie das reale während der ersten COVID‑19‑Welle und matcht die offiziellen Fall‑ und Todeszahlen aus Anfang 2020. Dieser Kalibrierungsschritt ist entscheidend, denn jede Strategie, die der Computer erlernt, muss in einer Welt funktionieren, die unserer ähnelt, nicht in einer Spielzeugwelt.

Ein digitalen Berater das Handeln beibringen

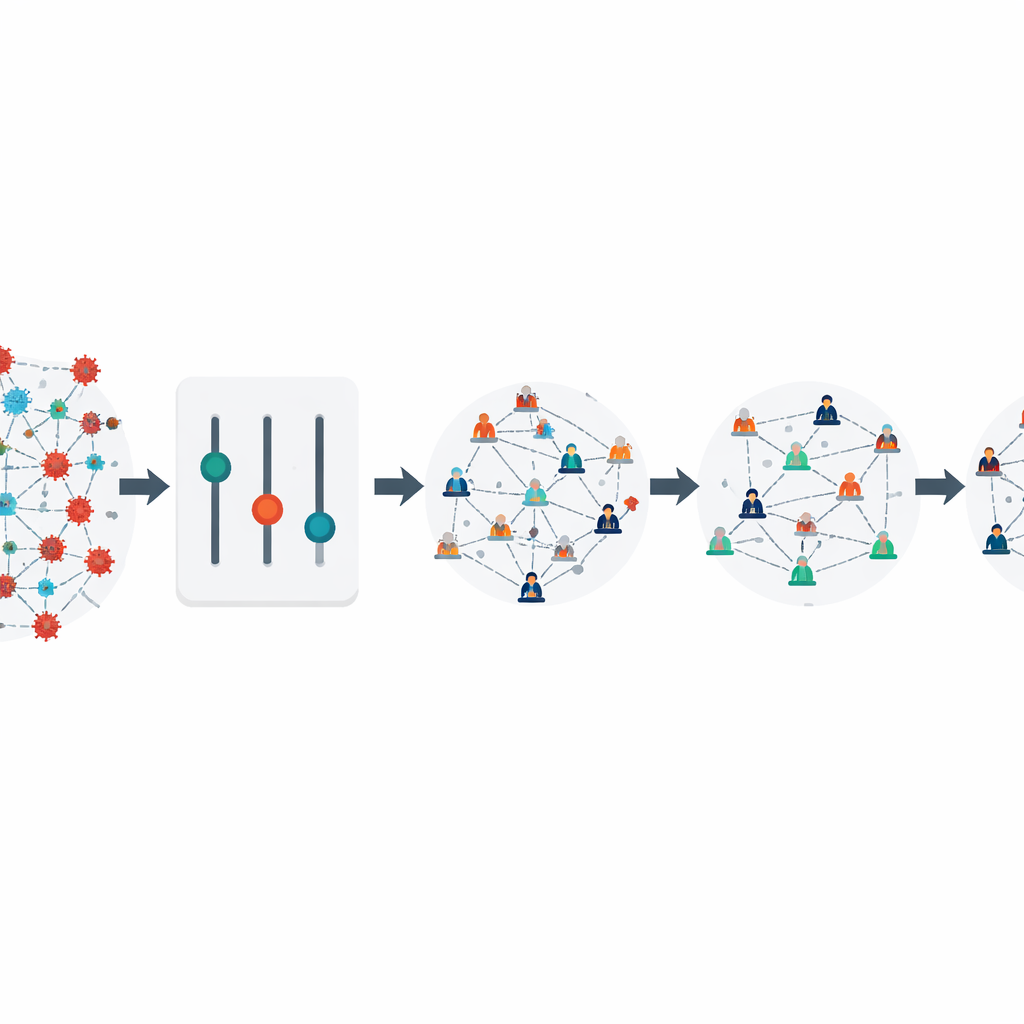

Sobald das Modell realitätsähnlich arbeitet, koppeln die Forschenden Reinforcement Learning an das System — einen Zweig der KI, bei dem ein Software‑"Agent" wiederholt Entscheidungen ausprobiert und je nach Ergebnis belohnt oder bestraft wird. Hier kann der Agent jede simulierte Woche an drei Haupthebeln drehen: wie streng Teil‑Lockdowns sind, wie viele Menschen getestet werden und wie aggressiv das Kontakt‑Tracing betrieben wird. Das Belohnungssystem ist so gestaltet, dass es zwei konkurrierende Ziele einbezieht: Infektionen, schwere Erkrankungen und Todesfälle gering zu halten und zugleich die wirtschaftlichen Schäden durch Betriebsschließungen und Isolation zu begrenzen. Durch das Durchspielen tausender Simulationen findet der Agent heraus, welche Kombinationen und Zeitpunkte von Maßnahmen die höchste Gesamtpunktzahl einbringen.

Ein besseres Gleichgewicht als starre Regeln

Die Studie vergleicht mehrere Lernmethoden und Arten, die Entscheidungen des Agenten zu beschreiben. Eine Methode, die Handlungen als stufenlose Regler anstatt als kleines Menü fester Optionen behandelt, schneidet besonders gut ab. Sie lernt, schnell zu reagieren, wenn das Virus sich auszubreiten beginnt, indem sie kurze, aber strenge Beschränkungen mit intensivem Testen und Tracing kombiniert. Sobald der simulierte Ausbruch unter Kontrolle ist, lockert sie die Beschränkungen und behält dennoch ein gewisses Maß an Testung und Nachverfolgung bei, um bei drohenden Anstiegen die Maßnahmen kurzzeitig wieder zu verschärfen. Dieses flexible Muster hält die Gesamtzahl der Infektionen im Modell bei etwa 300.000, weit unter dem, was unter den real angewendeten Maßnahmen im Vereinigten Königreich in derselben Periode auftrat, und auch unter einer einfachen "sieben Tage offen, sieben Tage Lockdown"‑Regel. Die wirtschaftlichen Verluste im Modell werden gegenüber dieser starren Wechsel‑Strategie um mehr als zwei Drittel reduziert.

Timing ist entscheidend

Die Autor:innen untersuchen auch, wie diese verschiedenen Strategien die Reproduktionszahl in Echtzeit beeinflussen, eine Messgröße dafür, wie viele neue Infektionen jeder Fall hervorruft. In ihren Simulationen drückt die KI‑gestaltete Politik diese Zahl etwa einen Monat früher unter den kritischen Wert von eins als die tatsächliche Reaktion des Vereinigten Königreichs. Diese scheinbar kleine Verschiebung reduziert die kumulativen Infektionen dramatisch und unterstreicht, wie viel Unterschied frühes, gut geplantes Handeln machen kann. Sie testen die gelernte Strategie außerdem in einem sehr anderen Kontext, mit Daten der großen COVID‑19‑Welle in Hongkong 2022, und finden, dass dieselbe Strategie weiterhin gut funktioniert — ein Hinweis darauf, dass die gelernten Regeln allgemeine Prinzipien erfassen und nicht bloß auf ein Land überangepasst sind.

Was das für künftige Ausbrüche bedeutet

Für Nicht‑Spezialist:innen ist die Hauptbotschaft, dass wir nicht blind zwischen Leben retten und Existenzgrundlagen wählen müssen. Durch die Kombination detaillierter Simulationen darüber, wie ein Virus sich durch reale soziale Netzwerke bewegt, mit einer KI, die durch Versuch und Irrtum lernt, könnten Entscheidungsträger datenbasierte Handlungsanleitungen erhalten, die sich an veränderte Bedingungen anpassen. Die Autor:innen betonen, dass solche Werkzeuge nicht dazu gedacht sind, menschliches Urteilsvermögen zu ersetzen, sondern als starke Entscheidungshelfer zu fungieren, die zahllose Was‑wenn‑Szenarien viel schneller erkunden als Menschen es können. Wenn neue Epidemien auftreten, könnte dieser Ansatz Führungskräften helfen, früher und präziser zu handeln, indem gezielte Tests, Tracing und partielle Schließungen eingesetzt werden, um die Krankheit unter Kontrolle zu halten und gleichzeitig so viel normalen Alltag und wirtschaftliche Aktivität wie möglich zu bewahren.

Zitation: Zhang, B., Chen, Y., Li, H. et al. Optimization of infectious disease intervention measures using reinforcement learning with UK COVID-19 epidemic data. Sci Rep 16, 10627 (2026). https://doi.org/10.1038/s41598-026-39377-8

Schlüsselwörter: COVID-19 Richtlinie, Reinforcement Learning, Epidemiesimulation, nicht‑pharmazeutische Interventionen, Gesundheitsstrategie