Clear Sky Science · de

Patientenadressanalyse mittels KG-bewusstem kontrastivem Lernen und eingeschränkter On-Prem-LLM-Inferenz

Warum ordentliche Patientenadressen wichtig sind

Hinter jedem Krankenhausbesuch steht eine unscheinbare Textzeile: die Wohnadresse des Patienten. Weit mehr als eine bloße Schreibarbeit treiben diese Adressen Krankheitskartierungen, Notfallplanung und Entscheidungen darüber, wo Kliniken und Rettungswagen stationiert werden sollen. In vielen elektronischen Patientenakten sind Adressen jedoch als unordentlicher, inkonsistenter Text mit Abkürzungen, Tippfehlern und fehlenden Angaben gespeichert. Dieser Artikel stellt AddrKG‑LLM vor, eine neue Methode, die solch ungezähmten Adresstext in saubere, verlässliche Datensätze verwandelt und gleichzeitig sensible Details schützt.

Das Problem unstrukturierter Wohnadressen

Wenn Adressen frei eingegeben werden, lassen Nutzer oft Bezirke weg, vertauschen Wortfolgen oder verwenden lokale Spitznamen, die auf offiziellen Karten nicht vorkommen. Ältere computerbasierte Verfahren vergleichen Zeichenketten oder einfache Wortlisten, was nur funktioniert, wenn die Eingaben bereits sauber und vollständig sind. Neuere Deep-Learning-Systeme erfassen Kontext deutlich besser, können aber bei ungewöhnlicher Formulierung scheitern und verlangen viel Rechenleistung. Große Sprachmodelle haben zuletzt eindrucksvoll gezeigt, dass sie Texte verstehen und erzeugen können. Erlaubt man ihnen jedoch freie Antworten, neigen sie dazu, Details zu „halluzinieren“, die nicht in den Daten stehen — ein in der Gesundheitsversorgung inakzeptables Risiko, weil Aufzeichnungen präzise und prüfbar sein müssen.

Ein zweistufiger Weg vom Chaos zur Ordnung

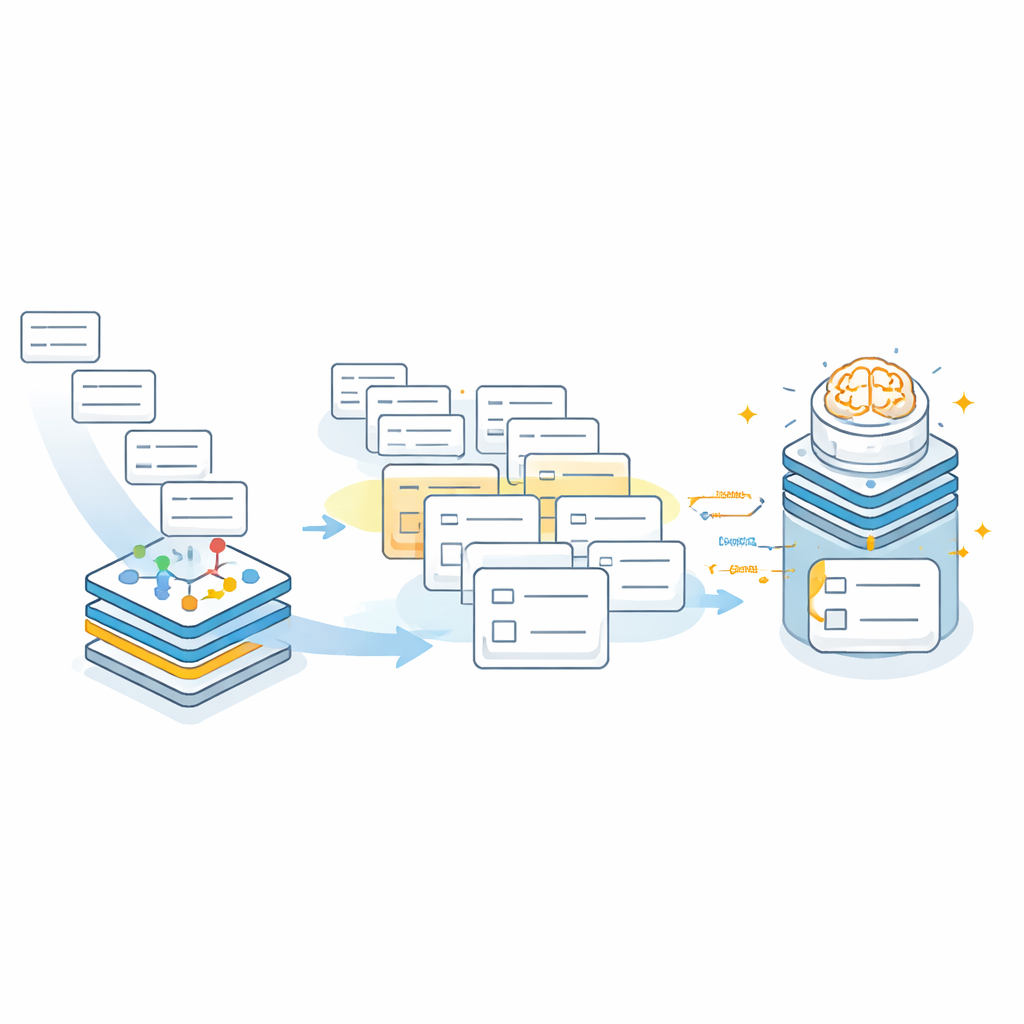

Die Forschenden entwickelten AddrKG‑LLM als zweistufige Pipeline, die dem Sprachmodell Struktur und Schutzmaßnahmen vorgibt, anstatt es allein arbeiten zu lassen. Zunächst werden eingehende Patientenadressen bereinigt, um stark identifizierende Details wie Haus- und Wohnungsnummern sowie Telefonnummern zu entfernen und so die Privatsphäre zu wahren. Der verbleibende Text wird in eine dichte numerische Repräsentation überführt, die seine Bedeutung einfängt. Parallel dazu baut das Team einen Wissensgraphen auf — ein netzwerkartiges Kartenmodell, das offizielle Beziehungen zwischen Städten, Bezirken, Straßen und Wohngebieten kodiert. Mit einer Technik namens kontrastives Lernen trainieren sie das System so, dass Adressen, die dieselbe reale Gemeinde bezeichnen, in diesem gemeinsamen Raum nahe beieinanderliegen, während nicht zusammengehörige Orte weiter auseinander verschoben werden. Auf diese Weise kann das System schnell eine kurze Liste wahrscheinlicher Adresskandidaten für jeden neuen Patientenfall abrufen.

Die KI an kurzer Leine halten

In der zweiten Stufe arbeitet das große Sprachmodell innerhalb eines sorgfältig abgegrenzten Suchraums. Statt eine Adresse aus dem Nichts zu erfinden, erhält das Modell den original bereinigten Text sowie die kleine Menge an Kandidatenorten, die der Wissensgraph vorgeschlagen hat. Das Prompt weist das Modell ausdrücklich an, nur aus diesen Kandidaten zu wählen und die Ausgabe in einer festen JSON-Struktur mit getrennten Feldern für Stadt, Bezirk, Straße oder Gemeinde und Wohnkomplex zu liefern. Wenn keiner der Kandidaten passt — etwa weil die wahre Gemeinde nicht abgerufen wurde — soll das Modell leere Werte zurückgeben, statt zu raten. Dieses „Rejection-first“-Verhalten verringert deutlich das Risiko, dass plausibel klingende, aber falsche Einträge in die Krankenakten gelangen.

Wie gut funktioniert es in der Praxis?

Das Team testete AddrKG‑LLM an zehntausend de‑identifizierten realen Krankenhausadressen, die typische Alltagsrauschen widerspiegeln: Abkürzungen, fehlende Bezirke, Schreibvarianten und sogar vollständig ungültige Einträge. Sie verglichen ihr System mit klassischen String-Matching-Tools, Deep-Learning-Sequenz-Labeling-Modellen, allgemein eingesetzten Sprachmodellen in freier Form sowie einem kommerziellen Adressstandardisierungsdienst. Nach strengen Maßstäben, die verlangen, dass jedes Adressfeld gleichzeitig korrekt ist, übertraf AddrKG‑LLM alle diese Baselines und steigerte die Gesamtgenauigkeit um mehr als zwölf Prozentpunkte gegenüber einem starken BERT-basierten Modell. Die Verbesserungen waren besonders ausgeprägt bei abgekürzten und teilweise fehlenden Adressen, wo die hierarchische Struktur des Wissensgraphen hilft, Lücken zu schließen. Die Autorinnen und Autoren untersuchten außerdem, wie sich die Leistung mit unterschiedlichen Größen von Sprachmodellen und variierender Anzahl abgerufener Kandidaten verändert, und zeigten so, wie Krankenhäuser Geschwindigkeit und Genauigkeit für ihre Bedürfnisse austarieren können.

Was das für die tägliche Versorgung bedeutet

Für Nichtfachleute lautet die Kernbotschaft: AddrKG‑LLM bietet einen Weg, lebenswichtige, aber unordentliche Patientenadressdaten zu bereinigen und gleichzeitig die Kontrolle fest in menschlicher Hand zu belassen. Durch die Kombination eines kartenähnlichen Wissensgraphen mit einem eingeschränkt agierenden Sprachmodell, das vollständig auf den Servern des Krankenhauses läuft, liefert das Framework genauere, konsistentere Adressen, ohne sensible Informationen an externe Cloud-Dienste zu senden oder der KI Freiraum zum Improvisieren zu geben. Das Ergebnis ist ein praxisnahes Werkzeug, das die Krankheitsüberwachung stärken, die Ressourcenplanung verbessern und sicherere, effizientere Krankenhausabläufe unterstützen kann — einfach dadurch, dass jeder Patient verlässlich auf der Karte verortet wird.

Zitation: Li, J., Pan, X. & Jia, Y. Patient address parsing via KG-aware contrastive learning and constrained on-prem LLM inference. Sci Rep 16, 8003 (2026). https://doi.org/10.1038/s41598-026-39348-z

Schlüsselwörter: Patientenadressanalyse, Qualität von Gesundheitsdaten, Wissensgraph, großes Sprachmodell, medizinische Informatik