Clear Sky Science · de

Datenschutzbewusste Analyse von Sprechermerkmalen und multimodalen Merkmalbeziehungen in Vorstellungsgesprächen

Warum Ihre Stimme in Vorstellungsgesprächen neue Fragen aufwirft

Immer mehr Unternehmen setzen auf automatisierte Videointerviews, bei denen Algorithmen zuhören, wie Sie sprechen, und Eigenschaften wie Selbstvertrauen, Zuverlässigkeit oder Geselligkeit ableiten. Ihre Stimme transportiert jedoch weit mehr als einen ersten Eindruck — sie kann Hinweise auf Identität, Gesundheit und Herkunft geben. Diese Arbeit untersucht, ob es möglich ist, in einer Aufnahme zu verbergen, wer Sie sind, und gleichzeitig Computern zu erlauben, zu beurteilen, wie Sie als Bewerberin oder Bewerber wirken. Anders gesagt: Lassen sich die Vorteile KI-gestützter Auswahlverfahren nutzen, ohne dabei stillschweigend unsere Privatsphäre zu opfern?

Von ersten Eindrücken zu automatisierten Urteilen

Personalpsychologen wissen seit langem, dass breite Persönlichkeitsmuster — oft als die Big Five beschrieben: Offenheit, Gewissenhaftigkeit, Extraversion, Verträglichkeit und emotionale Stabilität — für den beruflichen Erfolg wichtig sind. Jüngste Fortschritte in der künstlichen Intelligenz erlauben es Computern, diese Merkmale aus der Art und Weise abzuschätzen, wie Menschen in Vorstellungsgesprächen sprechen, und dabei nicht nur den Inhalt, sondern auch das Wie zu erfassen: Tonhöhe, Lautstärke, Rhythmus und den allgemeinen Sprechstil. Diese Systeme versprechen schnellere und konsistentere Bewerberauswahl. Zugleich werfen sie eine beunruhigende Frage auf: Wenn ein Unternehmen Ihre Stimme speichert, könnte dieselbe Datenquelle später genutzt werden, um Sie zu identifizieren, zu profilieren oder sensible Details zu erschließen, die Sie nie preisgeben wollten?

Wie man eine Stimme verbirgt, ohne ihren Charakter zu verlieren

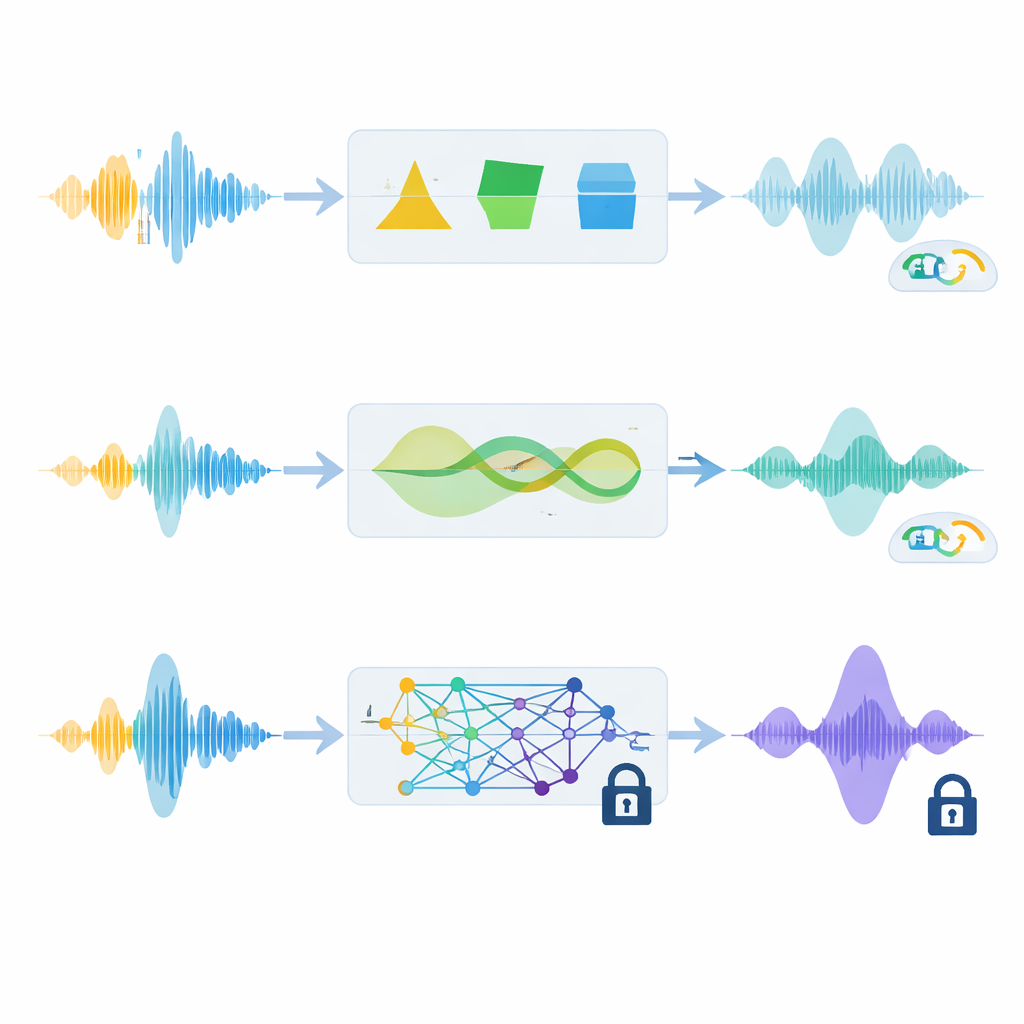

Um dieses Dilemma zu lösen, untersuchten die Forschenden Techniken, die die Stimme einer Person so verändern, dass sie nicht mehr wie die ursprüngliche Person klingt, während gleichzeitig die Hinweise erhalten bleiben, die für Persönlichkeits- und Einstellungsbewertungen wichtig sind. Sie konzentrierten sich auf drei Anonymisierungsmethoden. Zwei davon nutzen traditionelle Audiotricks, etwa das subtile Umformen von Frequenzen und das zeitliche Dehnen oder Verschieben der Tonhöhe. Die dritte basiert auf einem modernen neuronalen Audiocodec, der die Stimme in eine Folge digitaler Codes komprimiert und dann als neue, von hoher Qualität, aber anders klingende Stimme wieder aufbaut. Entscheidend war, dass das Team alle Methoden so anpasste, dass das wahrgenommene Geschlecht des Sprechers gleich blieb und die konvertierte Stimme über mehrere Antworten in einem längeren Online-Interview hinweg konsistent war.

Privatsphäre und Nutzbarkeit auf die Probe gestellt

Unter Verwendung von fast 1.900 echten Online-Interview-Videos von Personen aus den Vereinigten Staaten stellten die Autorinnen und Autoren zwei zentrale Fragen. Erstens: Wie schwer wäre es für einen Angreifer, anonymisierte Stimmen mit einem fortschrittlichen Spracherkennungssystem wieder den ursprünglichen Sprechenden zuzuordnen? Zweitens: Können Algorithmen nach der Anonymisierung weiterhin Schlüsselbewertungen zu Persönlichkeit und Einstellungsentscheidungen mit ähnlicher Genauigkeit vorhersagen? Sie bewerteten die Privatsphäre anhand einer Fehlerrate aus der automatischen Sprecherverifikation — eine höhere Fehlerquote bedeutet besseren Schutz — und maßen die Nutzbarkeit mittels Spracherkennungsgenauigkeit, wahrgenommener Audioqualität sowie der Fähigkeit von Machine-Learning-Modellen, Merkmale und Einstellungsentscheidungen aus akustischen und sprachlichen Merkmalen abzuleiten.

Wie der Kompromiss tatsächlich aussieht

Die Ergebnisse zeigen ein nuanciertes Gleichgewicht zwischen Sicherheit und Leistung. Die einfachste Methode, die die Stimmfrequenzen leicht umformt, bot nur einen mäßigen Privatschutz und konnte nahezu vollständig versagen, wenn das System des Angreifers auf die anonymisierten Stimmen zugeschnitten war. Eine fortgeschrittenere signalbasierte Technik, die Timing und Tonhöhe verändert, schnitt deutlich besser ab: Sie verringerte die Chancen einer erfolgreichen Re-Identifikation erheblich, während Rhythmus und Ausdrucksstärke der Sprache erhalten blieben. Infolgedessen lagen Vorhersagen zu Einstellung und Persönlichkeit nahe denen aus den Originalaufnahmen. Die neuronale Audiocodec-Methode lieferte den stärksten Privatschutz und erschwerte die Rückverfolgung anonymisierter Stimmen zu realen Sprechenden erheblich und entfernte oft sogar Hintergrundgeräusche. In den lauten, realen Interviewaufnahmen beeinträchtigte diese Methode jedoch auch subtile prosodische Hinweise, die die Wahrnehmung von Merkmalen steuern, was zu einem spürbaren Rückgang der Merkmalsabschätzungsleistung und zu höheren Fehlern bei der automatischen Transkription führte.

Was das für faire und private Einstellungspraxis bedeutet

Die Studie zeigt, dass es keine Einzellösung für alle Fälle gibt: Stärkerer Datenschutz geht häufig zulasten der Fähigkeit von KI, Persönlichkeit zu erkennen und Bewerberinnen oder Bewerber zu empfehlen. Für typische Einstellungsfälle, bei denen Merkmalsschätzungen und faire Entscheidungen Priorität haben, können verfeinerte signalverarbeitende Ansätze — insbesondere die hier getestete phasenbasierte Methode — den besten Kompromiss bieten, indem sie Identität abschirmen und zugleich das „Gefühl“ der Stimme bewahren. In Szenarien mit höheren Datenschutzanforderungen, etwa bei breiter Weitergabe von Sprachdaten oder dem Schutz vor leistungsfähigen Angreifern, können neuere neuronale Codec-Methoden größeren Schutz bieten; Designerinnen und Designer müssen dann jedoch einen gewissen Verlust in der Genauigkeit von Persönlichkeits- und Eignungsbewertungen in Kauf nehmen. Letztlich argumentiert die Arbeit, dass der Schutz der Stimmen von Bewerbenden als ethische Verpflichtung und nicht als nachträglicher Gedanke behandelt werden sollte und dass künftige Werkzeuge genau festlegen müssen, welche Aspekte der Sprache verborgen und welche erhalten werden sollen.

Zitation: Mawalim, C.O., Leong, C.W. & Okada, S. Privacy-aware speaker trait and multimodal features relationship analysis in job interviews. Sci Rep 16, 8181 (2026). https://doi.org/10.1038/s41598-026-39322-9

Schlüsselwörter: Stimmenanonymisierung, KI-Einstellung, Sprechermerkmale, Privatsphäre in Sprachdaten, Vorstellungsgespräche