Clear Sky Science · de

Video-dominante Emotionserkennung für tragbare EEG-Geräte

Warum Ihre Videos wissen könnten, wie Sie sich fühlen

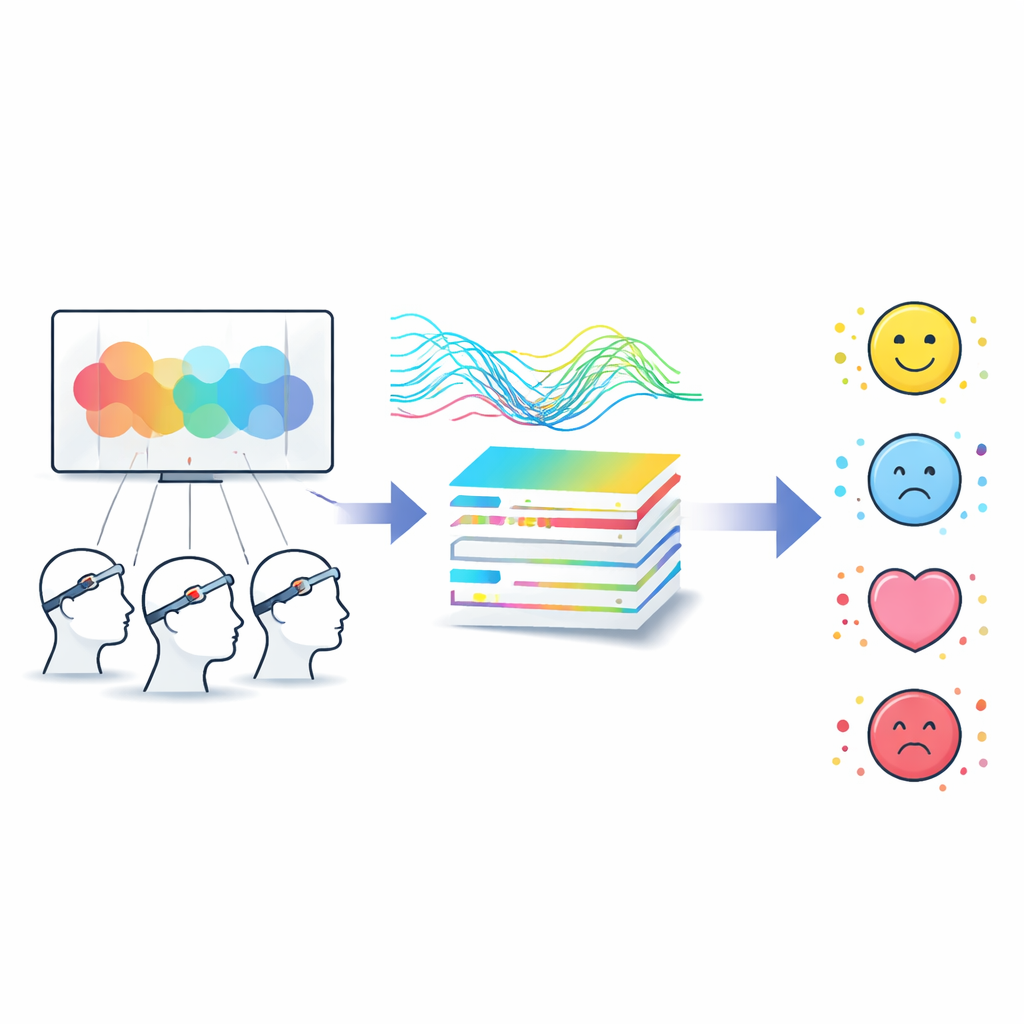

Stellen Sie sich vor, Sie sehen sich einen Kinotrailer an, während ein leichtes Stirnband leise Ihre Gehirnaktivität misst und errät, ob Sie sich glücklich, entspannt, traurig oder verängstigt fühlen. Diese Studie untersucht, wie man dieses Szenario mit einem kleinen, tragbaren Gehirnwellen(EEG)-Gerät realistisch umsetzen kann, statt mit sperriger Laborausstattung. Die Arbeit ist relevant für alle, die an intelligenteren Medien interessiert sind: von Werbetreibenden, die Publikumsreaktionen verstehen wollen, bis zu Streaming-Diensten, die Sendungen anhand dessen empfehlen könnten, wie Zuschauer sich tatsächlich fühlen, und nicht nur danach, worauf sie klicken.

Gefühle aus Gehirnwellen lesen

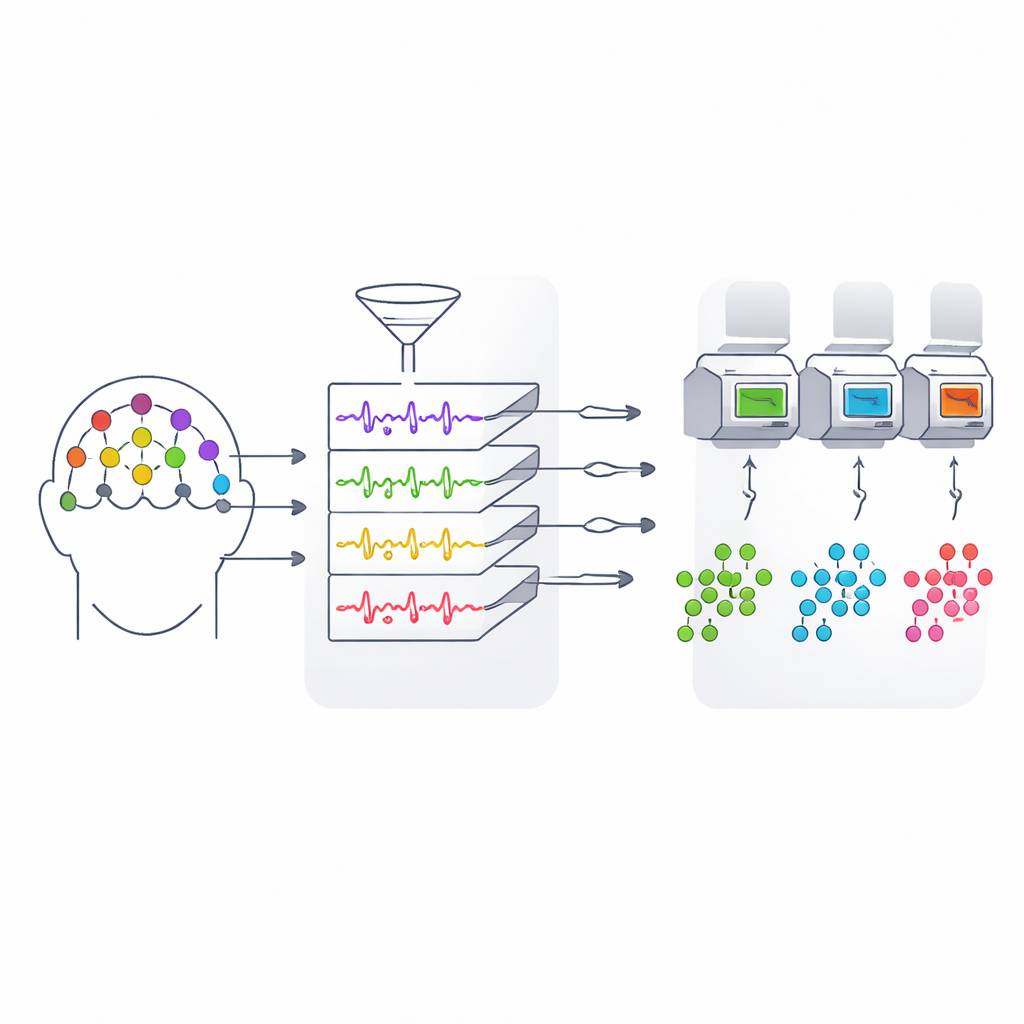

Unsere Gehirne erzeugen schwache elektrische Signale, die am Kopf mit Elektroenzephalographie (EEG) aufgezeichnet werden können. Diese Signale verändern sich subtil, wenn wir verschiedene Emotionen erleben. Ein beliebtes Forschungsdatensatz namens DEAP zeichnete EEGs von Personen auf, während sie Musikvideos sahen, und bat sie anschließend, anzugeben, wie angenehm, intensiv, kontrolliert und gefällig sie jedes Video fanden. Die meisten früheren Studien versuchten, unter idealen Laborbedingungen — mit vielen Elektroden und leistungsfähigen Rechnern — die höchstmögliche Genauigkeit zu erreichen, doch das spiegelt nicht die Realität wider. Dieses Papier stellt stattdessen eine praktischere Frage: Kann man mit einem kostengünstigen, tragbaren Gerät und weniger Elektroden dennoch die vorherrschende Emotion erfassen, die ein Video bei vielen Menschen hervorruft?

Eine gemeinsame emotionale Geschichte finden

Ein Hindernis ist, dass Menschen ihre Gefühle nicht gleich beschreiben. Zwei Zuschauer können denselben Clip sehen, der eine nennt ihn „aufregend“, der andere „ganz okay“. Die Forschenden begegnen diesem Problem mit einem schrittweisen Label-Kalibrierungssystem, das Muster über Zuschauer hinweg sucht, statt sich auf die Bewertung Einzelner zu verlassen. Zuerst werden alle Bewertungen auf eine gemeinsame Skala gebracht und in einige wenige Kerndimensionen komprimiert. Dann gruppiert unüberwachtes Clustering ähnliche emotionale Reaktionen, mit dem Ziel, die Videos in vier grobe Ecken des emotionalen Raums zu unterteilen: glücklich (angenehm und intensiv), entspannt (angenehm und ruhig), ängstlich (unangenehm und intensiv) und traurig (unangenehm und ruhig). Eine abschließende Verfeinerungsstufe korrigiert unsichere Fälle anhand zusätzlicher Bewertungsinformationen, sodass für jedes Video ein dominantes Emotionslabel entsteht, das den Gesamteindruck der Gruppe besser widerspiegelt.

Mehr aus weniger Hardware machen

Eine weitere Herausforderung ist die Hardware: Vollständige EEG-Kappen mit 32 oder mehr Elektroden sind unpraktisch und teuer. Das Team entwickelt eine Methode, dies auf nur 11 sorgfältig ausgewählte Positionen zu reduzieren — über Stirn, Mitte, Seiten und Hinterkopf, Bereiche, die mit Emotionskontrolle, Erregung, Hören, Sehen und Aufmerksamkeit verknüpft sind. Anschließend führen sie eine detaillierte Analyse durch, wie sich Signalenergie über klassische Gehirnwellenbänder (von langsamen bis schnellen Rhythmen) in unterschiedlichen emotionalen Zuständen verteilt. Durch den Vergleich dieser Muster zeigen sie, dass bestimmte Kombinationen aus Frequenzen und Skalp-Positionen besonders starke Hinweise darauf geben, ob ein Zuschauer beispielsweise hoch erregt oder tief entspannt ist. Dieser Multi-Band-Energiequotienten-Ansatz erlaubt es, die informativsten Signale zu behalten und viel Redundanz zu entfernen.

Die Daten das Wichtige hervorheben lassen

Selbst mit weniger Elektroden enthält jede Sekunde Aufzeichnung eine Flut von Zahlen. Um die Modelle nicht zu überfordern, kombinieren die Autorinnen und Autoren mehrere Arten von Merkmalen — etwa wavelet-basierte Energiemaße, wie stark verschiedene Hirnregionen gemeinsam schwanken, und wie sich die Leistung in verschiedenen Frequenzen über die Zeit verändert — zu einer dichten, aber strukturierten Beschreibung jeder Ansichtssitzung. Ein von Salienz geführter Auswahlschritt sortiert dann diese Merkmale nach ihrem Nutzen zur Unterscheidung von Emotionen und behält nur eine kompakte Teilmenge. Mit dieser reduzierten Repräsentation werden drei standardmäßige Machine-Learning-Modelle trainiert, um zu erkennen, welche der vier dominanten Emotionen am besten zu einem gegebenen Video passt. In anspruchsvollen Tests, in denen das System auf völlig neue Personen generalisieren muss, erreicht das beste Modell rund 45 % Genauigkeit — ein solides Ergebnis für eine vierteilige Wahl mit verrauschten Gehirndaten und nur 11 Kanälen.

Was das für Alltagstechnologie bedeutet

Für Nicht-Spezialisten ist die zentrale Aussage: Wir können beginnen, zu beurteilen, wie Gruppen von Menschen über Videos denken, indem wir kleine, tragbare Gehirnwellengeräte statt vollständiger Laboranlagen einsetzen. Durch die Bereinigung der Emotionslabels, die Fokussierung auf die aussagekräftigsten Teile des EEG-Signals und die Auswahl nur weniger gut platzierter Sensoren zeigen die Autorinnen und Autoren, dass es möglich ist, den dominanten emotionalen Ton eines Videos — glücklich, entspannt, ängstlich oder traurig — über Zuschauer hinweg zu erkennen. Das System ist nicht perfekt, aber es weist den Weg zu praktischen Werkzeugen für Publikumsstimmungsmessung, Inhaltsprüfung und emotionsbewusste Empfehlungen, die auf objektiven Hirnreaktionen statt nur auf Umfragen oder Klicks beruhen.

Zitation: Wen, X., Xu, W., Tian, L. et al. Video-dominant emotion recognition for portable EEG-based devices. Sci Rep 16, 7899 (2026). https://doi.org/10.1038/s41598-026-39315-8

Schlüsselwörter: EEG-Emotionserkennung, Brain–Computer-Interface, Video-Affektanalyse, tragbare Neurowissenschaft, affektives Computing