Clear Sky Science · de

Verwendung großer Sprachmodelle zur Verbesserung des Schlussfolgerungsvermögens eines anderen Sprachmodells durch belohnungsaktualisiertes GRPO

Maschinen beibringen, gründlich nachzudenken

Viele der heutigen Sprachmodelle können chatten, übersetzen und Fragen beantworten, doch sie tun sich weiterhin schwer damit, ihre Arbeit so nachvollziehbar darzustellen, wie es ein guter Mathematikschüler oder ein sorgfältiger Analyst tun würde. Dieses Papier untersucht, wie ein KI-System genutzt werden kann, um die Argumentationsfähigkeit eines anderen zu verbessern, und wie das ohne handgefertigte, riesige Spezialdatensätze möglich ist. Für Leser, die sich dafür interessieren, wie KI in Bereichen wie Finanzen, Medizin oder wissenschaftlicher Forschung verlässlicher werden kann, bietet die Arbeit ein praktisches Rezept, damit Modelle ihre Antworten klarer und konsistenter erläutern.

Von Rohdokumenten zu lehrbaren Beispielen

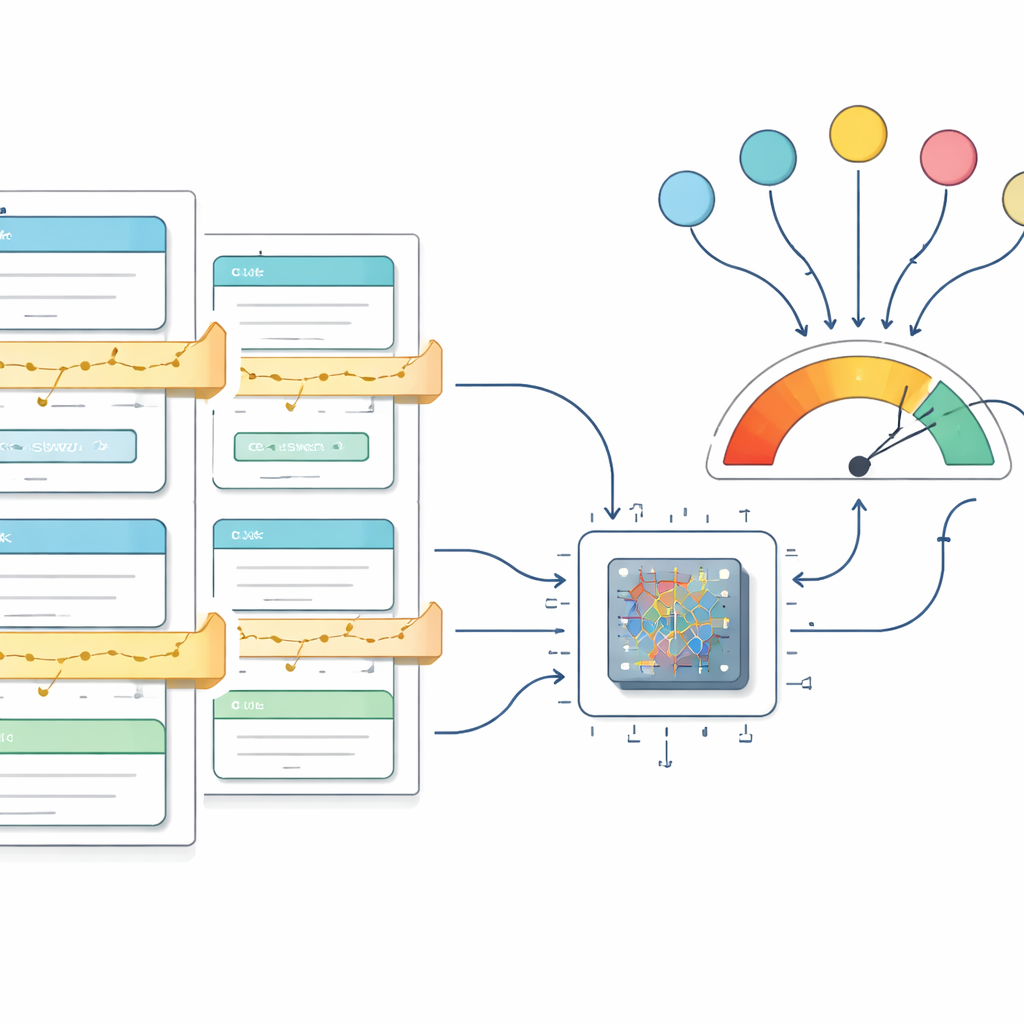

Die Autoren beginnen mit einer einfachen Beobachtung: Die meisten Informationen im realen Leben liegen in unordentlichen Formen vor — etwa in Berichten, Aktionärsbriefen oder Webseiten — und nicht im sauberen Frage‑Antwort‑Format. Um diese Lücke zu schließen, führen sie zwei Softwarewerkzeuge ein, Huggify-Data und den CoT Data Generator. Diese Werkzeuge nehmen unstrukturierte Texte und zerlegen sie automatisch in Frage‑Antwort‑Paare, um dann ein leistungsfähiges Sprachmodell zu bitten, die fehlenden Schlussfolgerungsschritte dazwischen zu ergänzen. Das Ergebnis ist für jedes Beispiel ein strukturiertes Triple: eine Frage, eine Kette von Schlussfolgerungen und eine Antwort. Entscheidend ist, dass diese Pipeline auf nahezu jede Domäne gerichtet werden kann — von Schulmathematik bis hin zu Unternehmensfinanzen — sodass sich trainingsrelevante, auf Schlussfolgerungen fokussierte Daten ohne Heerscharen menschlicher Annotatoren erzeugen lassen.

Wie ein Modell ein anderes trainiert

Sobald diese Frage‑Schlussfolgerung‑Antwort‑Tripel erstellt sind, dienen sie dazu, ein kleineres „Schülermodell“ darin zu schulen, auf dieselbe strukturierte Weise zu denken. Vom Schüler wird nicht nur die finale Antwort verlangt, sondern eine klar getrennte Erklärung, gefolgt von der Schlussfolgerung. Das Training wird durch eine Methode namens Group Relative Policy Optimization geleitet, die mehrere Kandidatenantworten auf dieselbe Frage vergleicht und das Modell in Richtung besserer Antworten lenkt. Die Arbeit ergänzt diese Methode um einen zusätzlichen Belohnungsterm, der überprüft, ob die Ausgabe des Modells dem gewünschten Format folgt — bis hin zu der Frage, wie eng sie an einem wohlgeformten Referenzbeispiel liegt. Diese Belohnung bestraft leicht durcheinandergeratene oder unvollständige Erklärungen und treibt das Modell zu ordentlichen, interpretierbaren Antworten.

Die Methode in der Praxis testen

Um zu prüfen, ob das Framework praktisch funktioniert, wenden die Autoren es auf zwei sehr unterschiedliche Datensätze an. Der erste, GSM8K, besteht aus Grundschultextaufgaben, die mehrstufiges arithmetisches Denken erfordern. Der zweite Datensatz wurde aus Warren Buffetts jährlichen Aktionärsbriefen erstellt, mit dem Ziel, langfristige Argumentationsketten zu Investitions‑ und Unternehmensentscheidungen abzubilden. In beiden Fällen verwandelt die Pipeline Rohtexte in strukturierte Trainingsdaten und feinjustiert ein mittelgroßes Modell namens Qwen 2.5. Während des Trainings belohnt eine einfache Bewertungsregel korrekte, gut formatierte Antworten; mit fortschreitendem Lernen steigt die durchschnittliche Belohnung stetig und stabilisiert sich an ihrem theoretischen Maximum, was zeigt, dass das Modell das Zielverhalten auf den Trainingsdaten weitgehend erlernt hat.

Wie gut das verbesserte Modell abschneidet

Die Leistung wird mit der „mittleren Token‑Genauigkeit“ gemessen, die grob fragt, welcher Anteil der kleinen Textbausteine (Tokens) in den Modellantworten mit den erwarteten übereinstimmt. Während sich diese Metrik vom üblichen Alles‑oder‑Nichts‑Scoring bei Testantworten unterscheidet, eignet sie sich gut dazu zu bewerten, ob Erklärungen und Antworten in der richtigen Struktur erzeugt werden. Auf GSM8K erreicht das beste Modell 98,2 Prozent Token‑Genauigkeit, und bei den Buffett‑Briefen sind es 98,5 Prozent. Diese Werte liegen über denen, die für weithin bekannte Systeme wie GPT‑4 und Claude 3.5 Sonnet unter derselben Metrik berichtet wurden, und das bei Verwendung nur eines 3‑Milliarden‑Parameter‑Modells, das in weniger als zwei Tagen auf gemieteter Hardware trainiert werden kann. Die Autoren geben zudem Details zu Rechenkosten und Hardware‑Setups an und veröffentlichen allen Code, Modelle und Datensätze, damit andere sie prüfen und weiterentwickeln können.

Was das für den alltäglichen KI‑Einsatz bedeutet

Für Nicht‑Spezialisten ist die wichtigste Erkenntnis, dass KI‑Systeme nicht nur dazu gebracht werden können, Antworten zu liefern, sondern Antworten in einer disziplinierten, leicht nachvollziehbaren Form zu geben — und das mithilfe von automatisch aus gewöhnlichen Dokumenten extrahierten Daten. Durch die Kombination eines lehrrreichen Lehrer‑Modells, einer flexiblen Datenpipeline und eines Belohnungsschemas, das sowohl Korrektheit als auch Klarheit wertschätzt, zeigen die Autoren, wie kleinere Modelle zu zuverlässigeren Problemlösern geformt werden können. Zwar weisen sie auf Grenzen hin — etwa die Notwendigkeit robusterer Tests für echtes Verständnis und Sicherheit —, doch das Framework weist in Richtung einer Zukunft, in der Organisationen ihre eigenen Textarchive in maßgeschneiderte, transparente KI‑Assistenten für Bildung, Finanzen und andere Bereiche verwandeln können.

Zitation: Yin, Y. Use large language model to enhance reasoning of another large language model through reward updated GRPO. Sci Rep 16, 8360 (2026). https://doi.org/10.1038/s41598-026-39296-8

Schlüsselwörter: große Sprachmodelle, Chain-of-Thought-Schlussfolgerung, Belohnungsoptimierung, Datenkuration, domain-specific AI