Clear Sky Science · de

Eine vergleichende Analyse eingebetteter Chatbot‑Modelle und ChatGPT‑4 zur Beantwortung kieferorthopädischer Behandlungsfragen

Warum schlauere Chatbots bei Zahnspangen wichtig sind

Wer eine Zahnspange getragen hat, weiß: Fragen warten nicht auf die Sprechstunde. Hört dieser Schmerz auf? Kann ich das essen? Muss ich mir Sorgen um meinen Kiefer machen? Diese Studie untersucht, ob ein speziell für die Kieferorthopädie entwickelter Chatbot — dessen Zweck es ist, solche Alltagsfragen zu beantworten — klarere und verlässlichere Antworten liefern kann als ein allgemeines KI‑System wie ChatGPT‑4. Die Arbeit zeigt, wie gezielt angepasste KI‑Werkzeuge Patienten und Behandler in der modernen Zahnmedizin unterstützen könnten.

Ein Chatbot, der nur für Zahnspangenfragen gebaut wurde

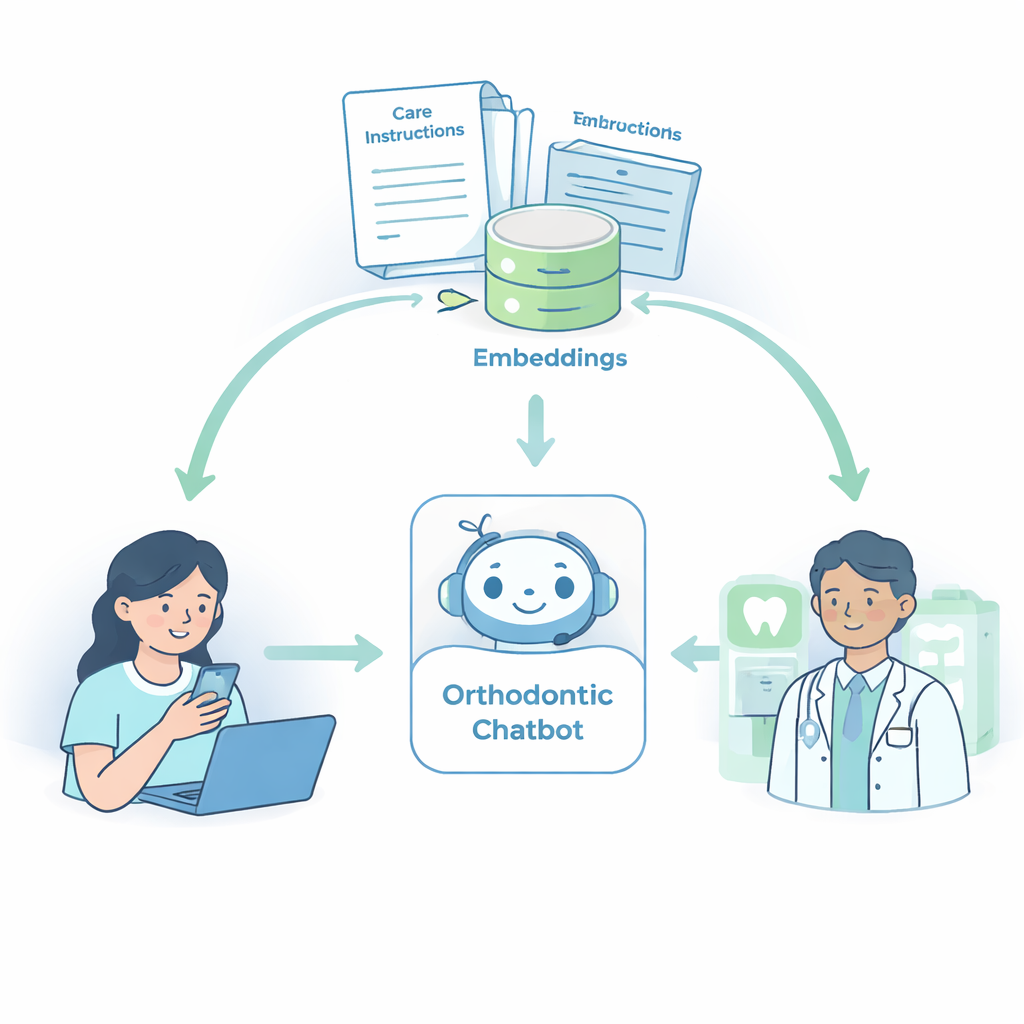

Die Forschenden entwickelten einen eingebetteten Chatbot, der sich ausschließlich auf kieferorthopädische Behandlungsthemen konzentriert. Anstatt eine neue KI von Grund auf zu trainieren, verbanden sie ein fortgeschrittenes Sprachmodell mit einer kuratierten Bibliothek aus Patienteninformationen und Auszügen aus Fachbüchern. Diese Sammlung umfasste Broschüren der British Orthodontic Society zu Themen wie Mundhygiene, Ernährung, Pflege von Apparaturen, Gummizügen und Retainern sowie kurze Erklärungen aus Standardwerken der Kieferorthopädie. Mittels einer Technik namens Retrieval‑Augmented Generation suchte das System bei jeder Frage nach passenden Passagen in dieser Bibliothek und nutzte sie, um die Antwort zu gestalten — mit dem Ziel, das wiederzugeben, was ein Patient typischerweise in einer Stuhldialog‑Situation hören würde.

Wie die Studie die beiden Systeme testete

Um die Leistung des spezialisierten Chatbots zu überprüfen, verglich das Team ihn mit ChatGPT‑4, wie es standardmäßig über die ChatGPT‑Plus‑Oberfläche genutzt wird. Sie stellten 30 reale Fragen zusammen, die Patienten vor, während und nach einer Zahnspangenbehandlung häufig stellen — etwa, ob Zahnspangen Schmerzen verursachen, wie sie Sprechen oder Singen beeinflussen, wie oft Kontrolltermine nötig sind und ob Zahnspangen bei Kiefergelenksproblemen helfen können. Beide Systeme erhielten dieselben Vorgaben und sollten als kieferorthopädische Expertinnen und Experten in klarer, patientengerechter Sprache antworten. Sechs erfahrene Kieferorthopäden bewerteten anschließend jede anonymisierte Antwort in vier Bereichen: Genauigkeit, Verständlichkeit, Relevanz für die Frage und Aktualität der Informationen, jeweils auf einer Fünf‑Punkte‑Skala.

Qualität messen, nicht nur Eindrücke sammeln

Statt sich auf allgemeine Eindrücke zu verlassen, nutzten die Forschenden eine strukturierte Bewertungsmethode, den Content Validity Index. Für jede Frage und jeden Qualitätsaspekt zählten sie, wie viele Expertinnen und Experten eine Antwort mit „stimme zu“ oder „stimme voll zu“ bewerteten, und wandeln dies in eine Punktzahl zwischen null und eins um. Hohe Werte bedeuteten, dass die Mehrheit die Antwort als genau, klar, relevant oder aktuell einschätzte. Außerdem berechneten sie Mittelwerte über alle Fragen, um die Gesamtleistung der Systeme zu vergleichen. Statistische Tests wurden angewendet, um zu prüfen, ob Unterschiede zwischen den beiden Chatbots groß genug waren, um als bedeutsam und nicht nur zufällig zu gelten.

Wie die Kieferorthopäden die Antworten beurteilten

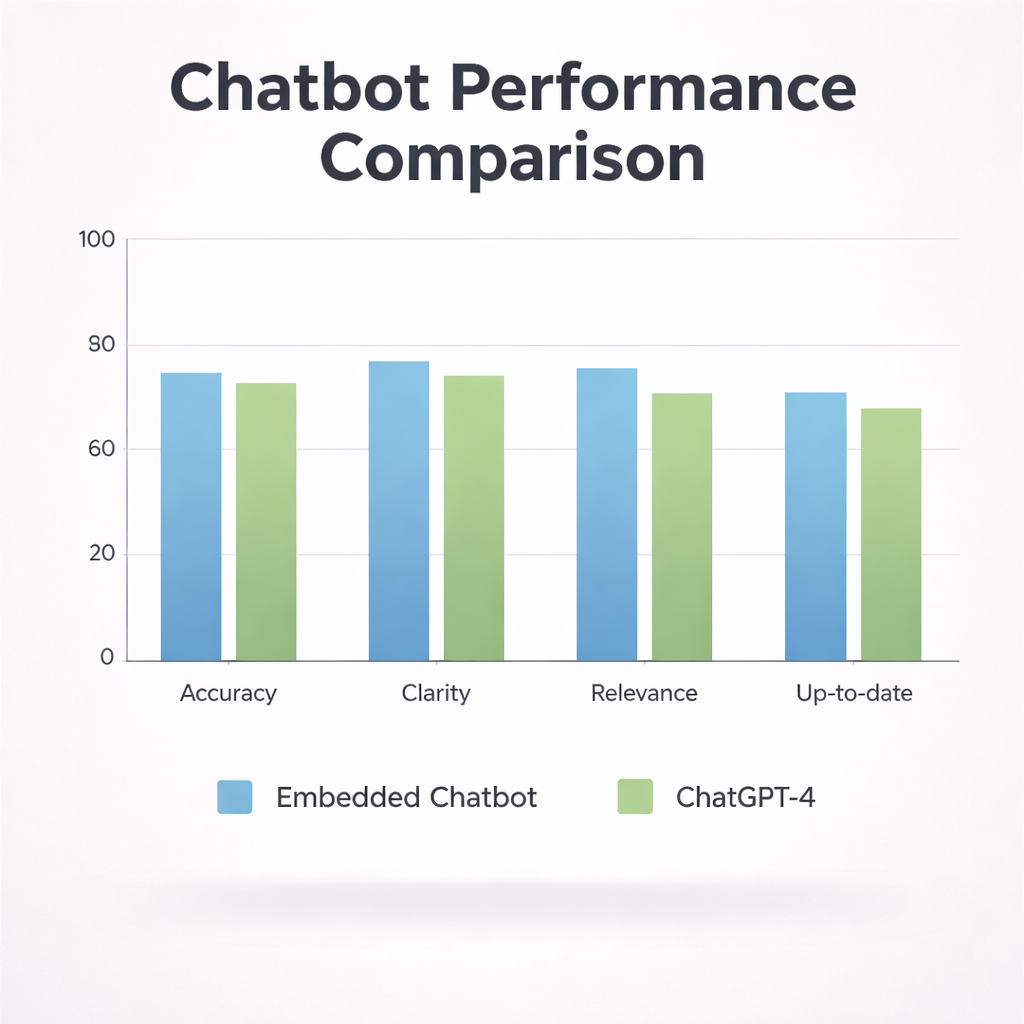

Der eingebettete Chatbot schnitt insgesamt besser ab. Etwa drei Viertel seiner Antworten erreichten eine akzeptable Qualitätsgrenze, verglichen mit etwas mehr als der Hälfte der Antworten von ChatGPT‑4. Im Mittel erzielte der spezialisierte Chatbot höhere Werte bei Genauigkeit, Verständlichkeit und Relevanz und schien zudem etwas stärker mit aktuellen Leitlinien übereinzustimmen. Beispielsweise waren seine Erklärungen zu Schmerzen während der Behandlung oder zu Auswirkungen auf die Sprache schlicht, konkret und eng an gängiger Patienteninformation orientiert. Im Gegensatz dazu fielen die Antworten von ChatGPT‑4 zwar oft vernünftig aus, waren aber tendenziell allgemeiner und mitunter technischer, was aus Sicht der Expertinnen und Experten die Verständlichkeit mindern konnte. Bei formalen statistischen Tests waren die Unterschiede zwischen den beiden Systemen jedoch nicht groß genug, um statistisch signifikant zu sein.

Begrenzungen und Lehren für künftige KI in der Klinik

Die Studie zeigte auch, dass Expertinnen und Experten nicht immer übereinstimmen, was als „beste“ Antwort gilt. Die Gesamtübereinstimmung zwischen den Kieferorthopäden war schwächer als erwartet, besonders bei subjektiven Aspekten wie Verständlichkeit und Relevanz. Die Forschenden nannten weitere Einschränkungen: Es wurden nur zwei KI‑Setups untersucht, Patienten waren nicht direkt einbezogen, und der spezialisierte Chatbot basierte auf einem bestimmten Satz schriftlicher Materialien. Trotzdem liefert die Arbeit weiterführende Hinweise darauf, dass KI‑Systeme viele häufige zahnmedizinische Fragen vernünftig beantworten können und dass das Hinzufügen fokussierter, aktueller Referenzmaterialien die Leistung verbessern kann.

Was das für Menschen mit Zahnspange bedeutet

Für Patientinnen und Patienten ist die Botschaft ermutigend, aber mit Vorsicht zu lesen. Ein gut gestalteter, kieferorthopädisch ausgerichteter Chatbot kann klare, vertrauenswürdige Antworten auf viele Alltagsfragen geben und dabei helfen, Ängste zwischen Terminen zu reduzieren. Zugleich zeigt die Studie, dass ein solches Werkzeug noch nicht den Bedarf an professionellem Urteil oder persönlicher Beratung ersetzt. Das eigentliche Potenzial liegt in der Kombination dieser maßgeschneiderten KI‑Hilfen mit fachlicher Betreuung, sodass Menschen mit Zahnspangen zeitnah verständliche Informationen erhalten und gleichzeitig auf den Rat ihres Kieferorthopäden für finale Entscheidungen vertrauen können.

Zitation: Khalil, R., Amin, L., Sukhia, R.H. et al. A comparative analysis of embedded chatbot models and ChatGPT-4 for answering orthodontic treatment queries. Sci Rep 16, 7776 (2026). https://doi.org/10.1038/s41598-026-39263-3

Schlüsselwörter: kieferorthopädischer Chatbot, zahnmedizinische KI, Zahnspangen Fragen, Patientenaufklärung, Vergleich mit ChatGPT