Clear Sky Science · de

Bewertung KI-gestützter Lernassistenten in der ingenieurwissenschaftlichen Hochschulbildung mit Auswirkungen auf studentisches Engagement, Ethik und Richtlinien

Warum das für heutige Studierende wichtig ist

Studierende wenden sich zunehmend Chatbots und anderen KI-Tools zu, um bei Hausaufgaben, Programmierung und schwierigen Vorlesungsinhalten zu helfen. Können diese Werkzeuge wirklich das Lernen unterstützen, und was passiert mit Fragen wie Betrug, Fairness und Vertrauen, wenn Software zum Lernpartner wird? Dieses Papier begleitet ein reales Experiment in Lehreveranstaltungen der Bau- und Umweltingenieurwissenschaften, in dem ein KI-gestütztes „Educational AI Hub“ getestet wurde und Studierende gefragt wurden, was funktionierte, was sie beunruhigte und wie sie sich die Rolle von KI in der Zukunft der Hochschulbildung vorstellen.

Ein digitaler Studienkamerad, viele integrierte Werkzeuge

Das Educational AI Hub ist ein kursbezogener Lernassistent, der in die Online-Lernplattform der Universität eingebettet ist. Anstatt Fragen an einen allgemeinen Chatbot zu senden, der mit dem gesamten Internet trainiert wurde, interagieren Studierende mit einem Assistenten, der eng mit ihren eigenen Vorlesungen, Aufgaben und dem Lehrplan verknüpft ist. Im Hintergrund liest das System von Dozenten freigegebene Kurs-PDFs, zerlegt sie in durchsuchbare Abschnitte und speist nur diese Informationen in ein fortschrittliches Sprachmodell, um studentische Fragen zu beantworten. Das Hub bietet sechs Hauptfunktionen: kurze KI-generierte Notizen, einen Frage‑und‑Antwort-Chatbot, Karteikarten, automatisch bewertete Quizze, eine „Sandbox“ für Programmierhilfe und schnelle Antworten zu organisatorischen Fragen im Lehrplan. Es ist so konzipiert, dass es eher wie ein freundlicher, stets verfügbarer Lehrassistent wirkt als wie eine Abkürzungslösung.

Wie die Studie durchgeführt wurde

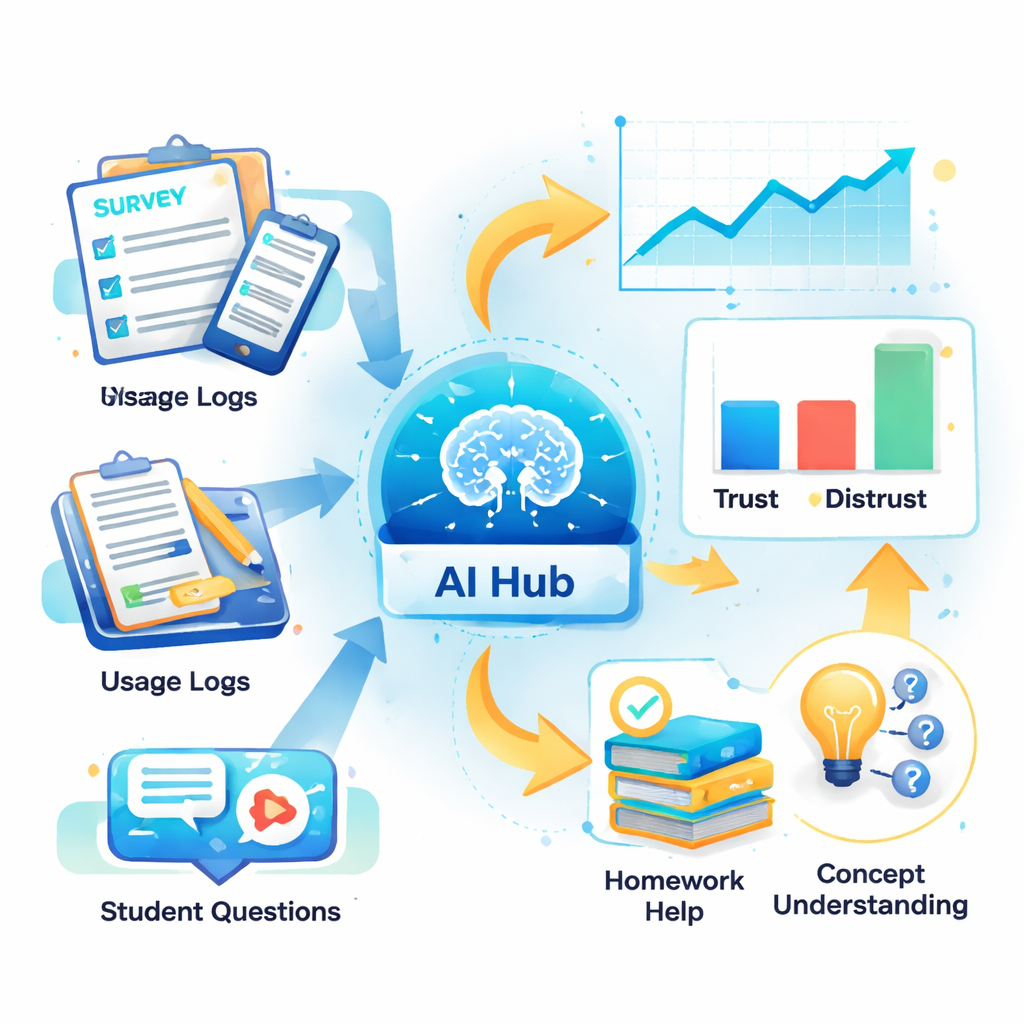

Um zu untersuchen, wie Studierende den Assistenten tatsächlich nutzten, integrierten die Forschenden ihn in zwei grundständige Ingenieurskurse an einer großen öffentlichen Forschungsuniversität. Fünfundsechzig der 77 eingeschriebenen Studierenden meldeten sich freiwillig zur Teilnahme. Sie füllten zu Beginn und am Ende des Semesters Umfragen zu ihren Erfahrungen mit KI, ihrem Vertrauen in solche Werkzeuge und ihren Bedenken hinsichtlich Ethik und akademischer Integrität aus. Gleichzeitig protokollierte das System stillschweigend jede Interaktion: welche Funktionen genutzt wurden, wie oft Studierende zurückkamen und welche Arten von Fragen gestellt wurden. Das Team kodierte außerdem Hunderte studentischer Anfragen nach Themen wie „Software‑Hilfe“, „Theoriefragen“ und „Aufgabenklärung“, um zu verstehen, welche Art von Unterstützung die Studierenden wirklich suchten.

Was Studierende mochten — und dem sie nicht voll vertrauten

Bei weitem am beliebtesten war der Chatbot, der mehr als 90 Prozent aller Interaktionen ausmachte. Studierende nutzten ihn intensiv, um bei technischen Softwareaufgaben in Tools wie ArcGIS und MATLAB nicht stecken zu bleiben und um zentrale ingenieurwissenschaftliche Konzepte und Formeln zu klären. Viele berichteten, der Assistent habe das Verständnis des Kursmaterials und das Fertigstellen von Hausaufgaben erleichtert, und einige gaben an, sie fühlten sich gegenüber der KI wohler beim Fragenstellen als gegenüber Dozierenden oder Tutor:innen. Dennoch betrachteten die meisten Studierenden menschliche Hilfe weiterhin als gleichwertig oder qualitativ besser. Bedenken wegen falscher oder irreführender Antworten der KI — manchmal als „Halluzinationen“ bezeichnet — führten dazu, dass viele Nutzer:innen den Assistenten eher als bequemen ersten Schritt denn als endgültige Autorität ansahen.

Ethische Grauzonen und Richtlinienunsicherheit

Selbst wenn Studierende das Tool schätzten, waren sie unsicher bezüglich der Regeln für dessen Nutzung. Viele wussten nicht genau, was als akademisches Fehlverhalten im Umgang mit KI gilt, und fürchteten, fälschlich des Betrugs beschuldigt zu werden. Fast die Hälfte glaubte, dass KI nicht automatisch die akademische Integrität untergräbt, doch ein ähnlicher Anteil war unsicher bei der Verwendung in benoteten Arbeiten. Wichtig war, dass Studierende nicht wollten, dass KI verboten wird; stattdessen forderten sie „mäßig restriktive“ Kursrichtlinien mit klaren Vorgaben. Die Mehrheit war sich einig, dass der Einsatz von KI als akademische Hilfe ethisch vertretbar sein kann, und äußerte den Wunsch, ähnliche Werkzeuge in anderen Kursen zu haben, vorausgesetzt, Erwartungen werden in klarer Sprache formuliert und mit verantwortungsvollen Gewohnheiten wie Quellenprüfung und Angabe von Hilfe verknüpft.

Von Daten zu besserem Lehren und Lernen

Nutzungsprotokolle und Umfrageantworten zeichneten ein konsistentes Bild: Studierende nutzten das AI Hub am stärksten, wenn sie ihm vertrauten, sich damit wohlfühlten und es als wirklich nützlich für Kursaufgaben wie Konzeptwiederholung und Hausaufgaben empfanden. Geringeres Vertrauen in die KI ging mit niedrigerer Nutzung einher, während Komfort und wahrgenommener Nutzen mit häufigerem Engagement korrelierten. Dennoch schrieben Studierende dem Tool nicht allein die Verbesserung ihrer Noten zu, und viele griffen weiterhin auf allgemeine Chatbots zurück, wenn es um Programmierung oder Mathematik ging, die über das Kursmaterial hinausgingen. Diese Muster deuten darauf hin, dass KI‑Assistenten am besten als zielgerichtete Unterstützungsebene innerhalb eines Kurses funktionieren — nicht als Ersatz für Lehrende und nicht als Allzwecklösung.

Was das für das Klassenzimmer der Zukunft bedeutet

Für Laien lässt sich festhalten: KI‑Studienhilfen können Fachfächer zugänglicher machen und Studierenden eine stressfreie Möglichkeit bieten, jederzeit Fragen zu stellen, aber sie lösen Lernen nicht von allein. In dieser Studie betrachteten Ingenieurstudierende das Educational AI Hub als nützlichen Begleiter, der Probleme auflöste und schwierige Inhalte erklärte, während sie weiterhin auf Lehrende und traditionelle Lerngewohnheiten vertrauten. Ihre größten Sorgen bezogen sich weniger auf die Technologie selbst als auf unklare Regeln und die Angst vor Betrugsvorwürfen. Die Autor:innen argumentieren, dass Hochschulen, wenn sie KI tatsächlich zur Verbesserung der Bildung nutzen wollen, intelligente, kursbewusste Werkzeuge mit klaren, transparenten Richtlinien und aktiver Anleitung durch Lehrende koppeln müssen, damit Studierende nicht nur von KI lernen, sondern auch den verantwortungsvollen Umgang damit erlernen.

Zitation: Sajja, R., Sermet, Y., Fodale, B. et al. Evaluating AI-powered learning assistants in engineering higher education with implications for student engagement, ethics, and policy. Sci Rep 16, 7565 (2026). https://doi.org/10.1038/s41598-026-39237-5

Schlüsselwörter: KI in der Bildung, Ingenieurstudierende, Lernassistent, akademische Integrität, studentisches Engagement