Clear Sky Science · de

Multimodale große Sprachmodelle stellen die NEJM Image Challenge in Frage

Warum das für Patientinnen, Patienten und Ärztinnen und Ärzte wichtig ist

Die richtige Diagnose zur richtigen Zeit zu stellen, kann den Unterschied zwischen schneller Behandlung und jahrelangem Leid ausmachen. Trotzdem übersehen oder verzögern Ärztinnen und Ärzte, selbst sehr gut ausgebildete, noch Diagnosen, besonders bei seltenen oder ungewöhnlichen Erkrankungen. Diese Studie stellt eine eindrückliche Frage: Wenn medizinische Bilder und klinische Details in die derzeit fortschrittlichsten KI-Systeme eingespeist werden, können diese komplexe Fälle tatsächlich besser diagnostizieren als eine große Zahl realer Ärztinnen und Ärzte — und wenn ja, was bedeutet das für die zukünftige medizinische Versorgung?

Ein großes Puzzle aus Fällen aus der Praxis

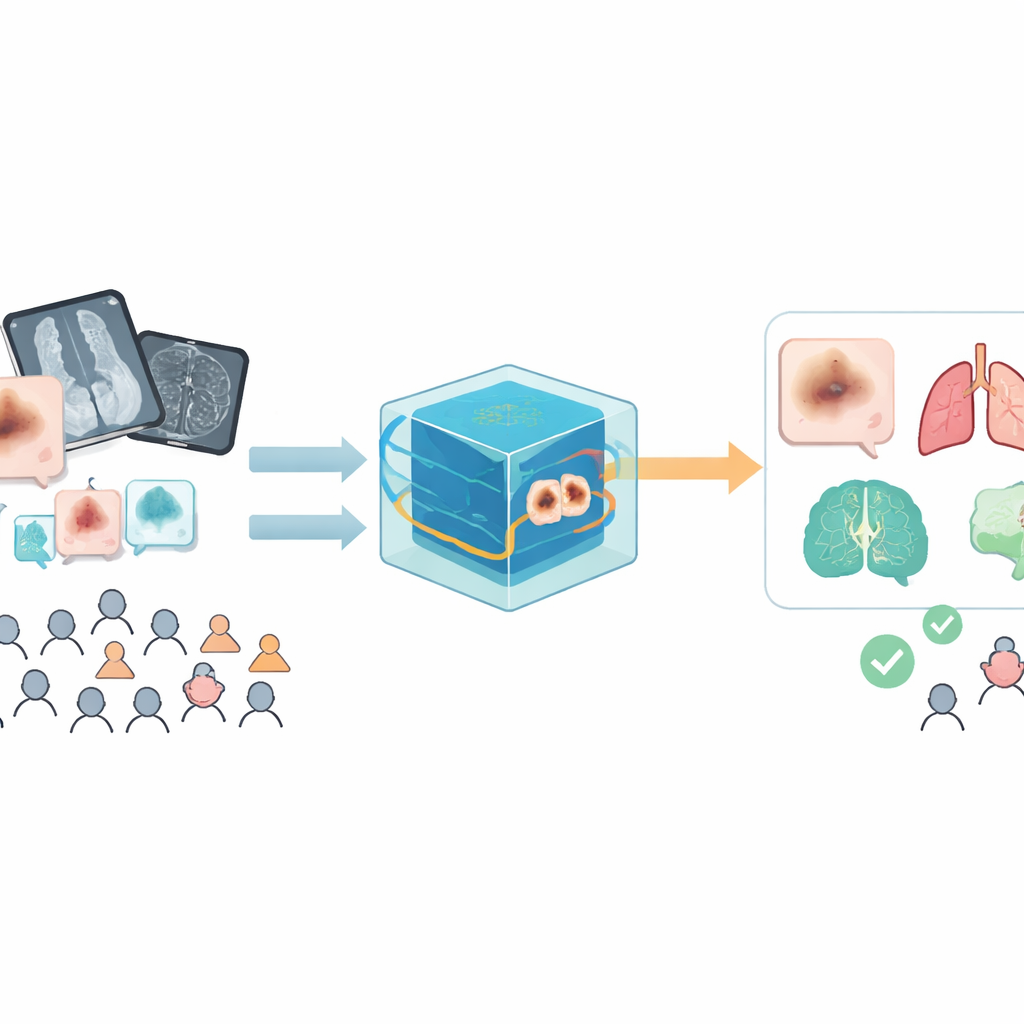

Die Forschenden griffen auf eine lang laufende Rubrik des New England Journal of Medicine zurück, die «Image Challenge» heißt. Jede Challenge zeigt das medizinische Bild eines echten Patienten — etwa ein Hautfoto, Röntgenbild, MRT oder einen Mikroskoppräparat — zusammen mit einer kurzen klinischen Geschichte und fünf möglichen Diagnosen. Seit 2009 sind pro Fall über 16 Millionen Antworten von mehr als 60.000 Ärztinnen und Ärzten zusammengekommen und haben damit ein einzigartiges globales Archiv geschaffen, wie Medizinerinnen und Mediziner bei denselben schwierigen Fragen abschneiden. Aus diesem Archiv wählte das Team 272 Fälle aus, die alle Altersgruppen, beide Geschlechter und ein breites Spektrum von Erkrankungen abdecken, von Infektionen und Autoimmunerkrankungen bis hin zu Krebserkrankungen, genetischen Krankheiten und Verletzungen.

KI und Ärztinnen/Ärzte auf derselben Grundlage vergleichen

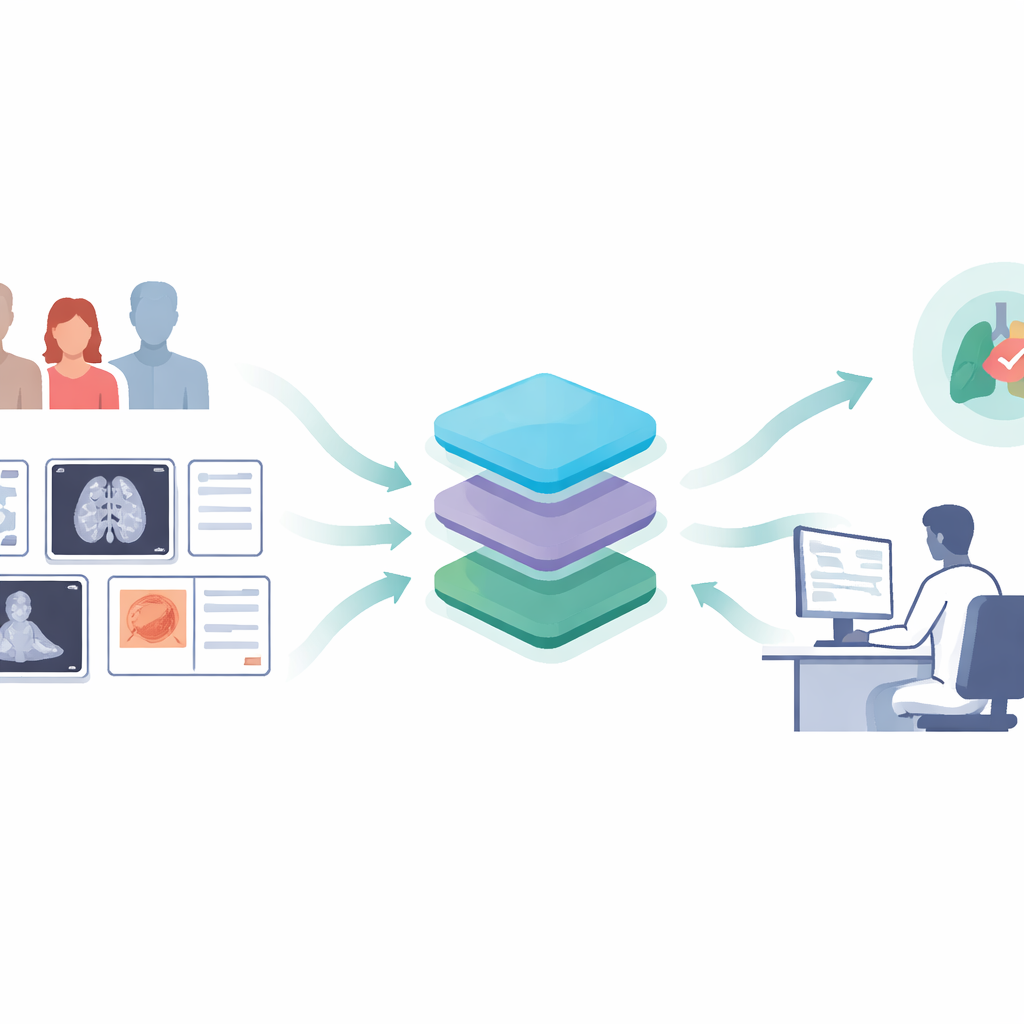

Die Studie testete drei führende multimodale große Sprachmodelle — Systeme, die Bilder ansehen und gleichzeitig Text verarbeiten können: GPT‑4o, Claude 3.7 und Doubao. Für jeden Fall sahen die Modelle zuerst nur das Bild und mussten eine der fünf Optionen mit einer Erklärung wählen. Danach erhielten sie Bild und klinische Beschreibung und antworteten erneut. Um den Test fair zu halten, wurden die Modelle in Standardkonfigurationen verwendet, mit deaktivierter Websuche und zusätzlichen Reasoning-Funktionen, und jeder Fall wurde in einer neuen Sitzung ausgeführt, um Kontamination durch frühere Antworten zu vermeiden. Zwei Ärztinnen/Ärzte bewerteten die KI-Antworten anhand der offiziellen Lösungen des New England Journal und prüften dabei, ob die endgültige Wahl mit der wahren Diagnose übereinstimmte — genauso wie beim Vergleichswert der menschlichen Teilnehmenden.

Übermenschliche Leistung über Krankheiten und Bildtypen hinweg

Wenn ihnen sowohl Bilder als auch Texte vorlagen, übertrafen alle drei KI-Systeme deutlich die globale Ärztinnen-/Arztgemeinde. Claude 3.7 und GPT‑4o erreichten jeweils etwa 89–90 % Genauigkeit, verglichen mit 46,7 % für die Mehrheitsentscheidung der menschlichen Teilnehmenden — eine Lücke von mehr als 40 Prozentpunkten. Selbst in den härtesten Fällen, in denen weniger als 40 % der Ärztinnen/Ärzte richtig lagen, traf Claude 3.7 noch 86,5 % der Diagnosen korrekt. Der Vorsprung zeigte sich bei den meisten Krankheitsarten und Bildformaten: Die Modelle waren besonders stark bei medikamentenbedingten und genetischen Zuständen und bewältigten nicht nur Fotos und Röntgenaufnahmen, sondern auch endoskopische, pathologische und gemischte Bildersets. Die Leistung war bei Männern und Frauen gleichermaßen hoch, und in einigen besonders verletzlichen Gruppen, etwa Säuglingen unter einem Jahr, waren die Modelle deutlich genauer als die Ärztinnen und Ärzte.

Andere Denkweisen, nicht nur schnellere

Womöglich die überraschendste Erkenntnis war, wie häufig die Modelle dort erfolgreich waren, wo Ärztinnen und Ärzte scheiterten. In fast der Hälfte der Fälle lag Claude 3.7 richtig, während die Mehrheit der Ärztinnen und Ärzte falsch lag; das Umgekehrte — Ärztinnen/Ärzte richtig, Modell falsch — war selten. Insgesamt gab es für Claude 3.7 etwa fünfzehn «Modell‑Vorteils»-Fälle auf jeden «Arzt‑Vorteils»-Fall. Dennoch war die Übereinstimmung zwischen menschlichen und KI‑Antworten gering, ein Hinweis darauf, dass die Systeme nicht einfach menschliche Muster nachahmen, sondern auf unterschiedlichen Wegen zu korrekten Diagnosen gelangen. Das Hinzufügen klinischer Texte half generell stark und steigerte die KI‑Genauigkeit um 28–42 Prozentpunkte gegenüber nur Bildern. In einem kleinen Bruchteil der Fälle führten zusätzliche Details jedoch dazu, dass Modelle von einer richtigen bildbasierten Antwort zu einer falschen wechselten — ein Hinweis auf neue Arten von Verzerrungen und Ausfallmodi, die sorgfältig untersucht werden müssen.

Was das für die künftige Versorgung bedeuten könnte

Die Autorinnen und Autoren kommen zu dem Schluss, dass multimodale große Sprachmodelle bei diesem anspruchsvollen diagnostischen Test ein «übermenschliches» Niveau erreicht haben: Sie sind genauer als die durchschnittliche Ärztinnen-/Arztgruppe und behalten ihren Vorsprung selbst bei Fällen, die die meisten Medizinerinnen und Mediziner ratlos lassen. Zugleich deutet die geringe Übereinstimmung mit menschlichen Entscheidungen darauf hin, dass sie eher komplementär denken, statt digitale Kopien von Klinikerinnen und Klinikern zu sein. Klug eingesetzt könnten diese Systeme als leistungsfähige Zweitgutachter dienen, unabhängige Meinungen zu schwierigen oder seltenen Fällen liefern und dabei helfen, Befunde zu entdecken, die menschlichen Ärztinnen und Ärzten entgehen. Sie sind nicht bereit, klinisches Urteilsvermögen zu ersetzen, könnten aber bald wertvolle Partner am Krankenbett und im Leseraum werden, die unsere Arbeit still prüfen und das Sicherheitsnetz für Patientinnen und Patienten erweitern.

Zitation: Sheng, C., Shen, S., Wang, L. et al. Multimodal large language models challenge NEJM image challenge. Sci Rep 16, 8132 (2026). https://doi.org/10.1038/s41598-026-39201-3

Schlüsselwörter: medizinische Diagnose, künstliche Intelligenz, medizinische Bildgebung, seltene Krankheiten, klinische Entscheidungsunterstützung