Clear Sky Science · de

Ein leichtgewichtiges Hybridmodell aus CNN und Transformer zur Klassifikation von Krankheitsbildern an Heilpflanzenblättern mit erklärbarer KI

Warum klügere Pflanzenpflege wichtig ist

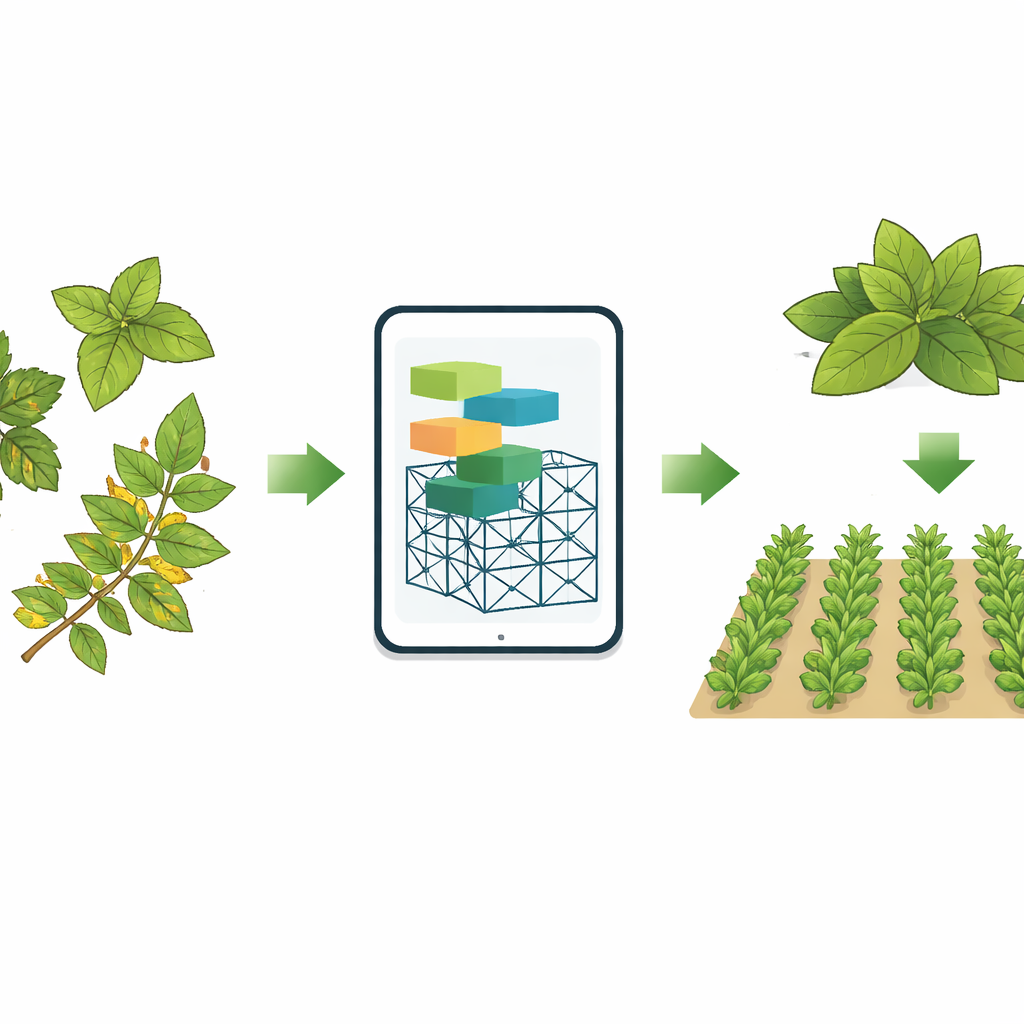

Viele der Kräuter, die in Hausmitteln und modernen Arzneien verwendet werden – wie Tulsi (Heiliges Basilikum), Neem und Patharkuchi – sind auf gesunde Blätter angewiesen, um ihre heilenden Inhaltsstoffe zu produzieren. Befallen Krankheiten diese Blätter, verlieren die Pflanzen sowohl Ertrag als auch medizinische Wirksamkeit. Die Arbeit stellt ein kompaktes System der künstlichen Intelligenz (KI) vor, das verschiedene Blattkrankheiten in Fotos mit bemerkenswerter Genauigkeit erkennen kann. Es wurde so konzipiert, dass es auf kostengünstigen Geräten läuft und transparent darstellt, worauf es „schaut“; dieser Ansatz könnte Landwirten und Gärtnern helfen, wertvolle Heilpflanzen in Echtzeit zu schützen.

Verborgene Gefahren auf vertrauten Blättern

Die Studie konzentriert sich auf drei weit verbreitete Heilpflanzen: Kalanchoe pinnata (Patharkuchi), Azadirachta indica (Neem) und Ocimum tenuiflorum (Tulsi). Diese Pflanzen bieten antibakterielle, entzündungshemmende und sogar antikanzeröse Vorteile, doch ihre Blätter sind anfällig für Pilzgeflechte, stressbedingtes Vergilben und verschiedene Fleckenkrankheiten. Traditionelle Diagnosen beruhen auf Expertenbeurteilungen im Feld oder langsamen, geräteintensiven Labortests, die beide erschweren, Probleme frühzeitig oder großflächig zu erkennen. Da die Pflanzengesundheit sowohl für die öffentliche Gesundheit als auch für lokale Wirtschaften wichtig ist, besteht ein großer Bedarf an automatischen, genauen und verständlichen Werkzeugen, die Krankheiten schnell allein anhand von Bildern melden können.

Ein schlaues Auge für kranke Blätter entwickeln

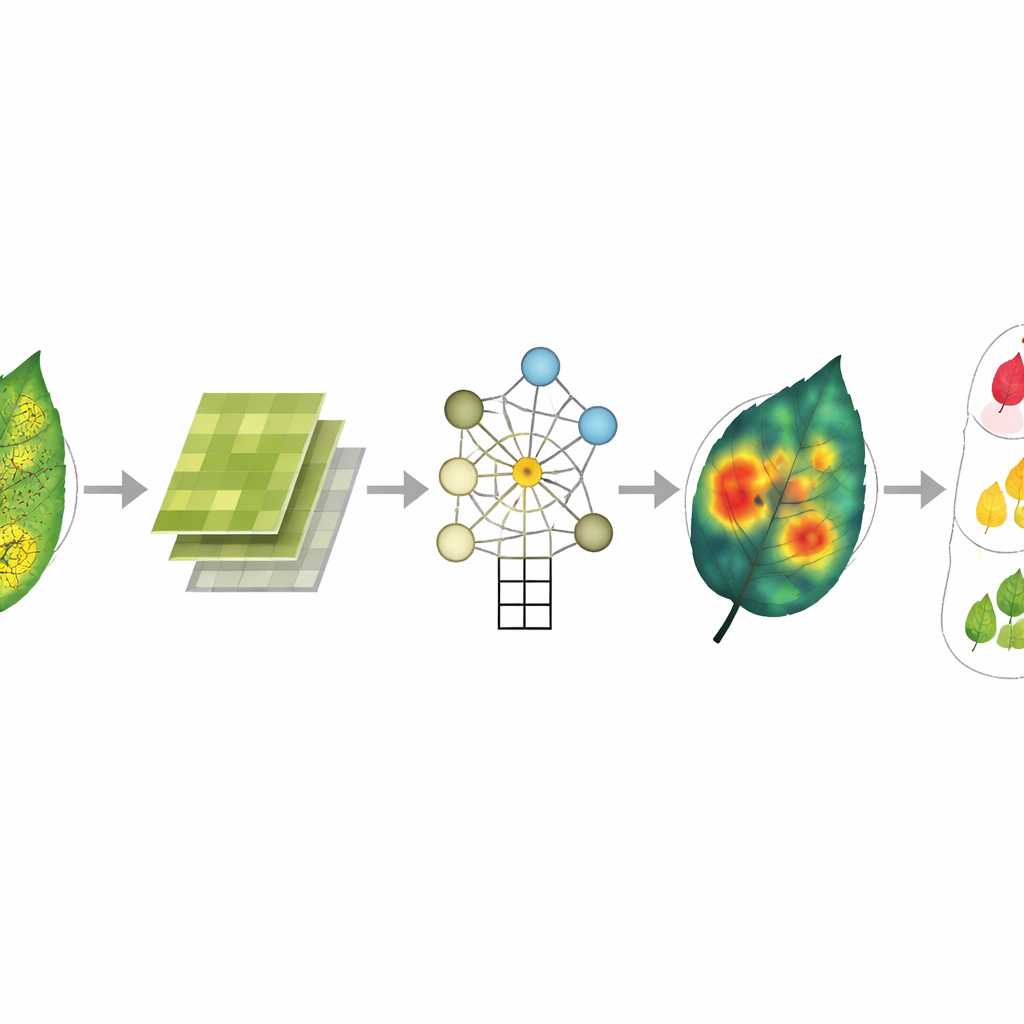

Um diese Herausforderung zu meistern, entwickelten die Autoren ein neues Modell namens LSeTNet, ein leichtgewichtiges Hybridmodell zweier populärer Bild‑KI‑Ansätze: Faltungsnetzwerke, die feinste Texturen und Kanten gut erfassen, und Transformer‑Schichten, die langreichweitige Muster im Bild abbilden. Das System lernte zunächst an einem sorgfältig zusammengestellten Bildsatz namens MedicinalLeaf‑12, der 12 Klassen umfasst und gesunde sowie kranke Varianten der drei Pflanzen abdeckt. Die Fotos wurden unter realen Feldbedingungen mit variierender Beleuchtung, Blickwinkeln und Hintergründen aufgenommen, anschließend bereinigt und verstärkt, sodass Krankheitsflecken und Blattadern deutlicher hervortreten. Das Team setzte außerdem umfangreiche Bildaugmentierungen ein – Drehen, Zoomen, Helligkeitsänderungen und mehr –, um die unordentliche Vielfalt realer Farmbedingungen nachzubilden und zugleich das Datenset ausgeglichen zu halten.

Wie das Modell Blätter „denkt“

LSeTNet verarbeitet jedes Blattbild in mehreren Stufen. Leichte Faltungs‑ (Convolutional‑) Schichten erfassen lokale Hinweise wie winzige Flecken, Gespinste und die Schärfe der Blattkanten. Spezielle „Squeeze‑and‑Excitation“‑Module gewichten diese Hinweise neu, indem sie leise Kanäle hochfahren, die krankheitsrelevante Signale tragen, und solche absenken, die vom Hintergrund dominiert werden. Ein Transformer‑Block folgt und verbindet weit auseinanderliegende Regionen des Blattes, sodass das Modell beispielsweise verstreute Gelbfärbungen oder entlang der Adern verlaufende Muster in Beziehung setzen kann. Schließlich entscheidet ein kompakter Klassifikator, welche der 12 Bedingungen am besten zu jedem Bild passt. Trotz nur rund 9,4 Millionen Parametern und moderatem Rechenaufwand erreicht das Modell hohe Geschwindigkeit und geringen Speicherbedarf, was es für Smartphones, Tablets oder kleine Einplatinencomputer geeignet macht.

Ins Schwarze schauen: Erklärbarkeit des Systems

Da Landwirte und Agronomen automatischen Diagnosen vertrauen müssen, integrierten die Autoren Erklärbarkeit in ihr System. Sie verwendeten Werkzeuge wie Grad‑CAM und LIME, um Heatmaps zu erzeugen, die zeigen, wo das Modell bei jedem Blatt „aufpasst“, und t‑SNE‑Plots, um zu visualisieren, wie sich verschiedene Krankheiten im internen Merkmalsraum des Modells gruppieren. Diese Erklärungen zeigen, dass die KI konsequent auf Läsionen, verfärbtes Gewebe und Pilzgeflechte fokussiert – nicht auf schlichten Hintergrund oder Stängel. Selbst bei den seltenen Fehlklassifikationen – nur fünf Fehler bei 1.800 Testbildern – bleiben die hervorgehobenen Regionen biologisch sinnvolle Bereiche; die Verwechslungen entstehen hauptsächlich, wenn zwei Krankheiten für das menschliche Auge sehr ähnlich aussehen.

Was die Ergebnisse für Produzenten bedeuten

Im Hauptdatensatz klassifizierte LSeTNet Blatbilder mit einer Genauigkeit von etwa 99,7 % korrekt, und bei Tests auf einem separaten externen Datensatz mit bangladeschischen Heilpflanzen, den es zuvor nicht gesehen hatte, erzielte es ähnlich hohe Leistungen. Gleichzeitig läuft das Modell schnell (etwa sieben Tausendstel einer Sekunde pro Bild auf einer GPU) und beansprucht wenig Speicher, was den Weg für kostengünstige, feldtaugliche Apps ebnet. Praktisch zeigt diese Arbeit, dass kompakte, transparente KI frühe Krankheitszeichen an wichtigen Heilpflanzen zuverlässig erkennen und den Nutzern klar vermitteln kann, warum sie zu einer bestimmten Entscheidung gelangt ist. Mit weiteren Tests an mehr Arten und unter härteren Feldbedingungen könnten ähnliche Systeme dazu beitragen, Lieferketten für Kräutermedizin zu schützen, die Präzisionslandwirtschaft zu unterstützen und Kleinbauern eine leicht zugängliche „zweite Meinung“ in die Tasche zu geben.

Zitation: Ahmmed, J., Kabir, M.A., Rehman, A.u. et al. A lightweight hybrid CNN and transformer model for medicinal leaf disease classification with explainable AI. Sci Rep 16, 8243 (2026). https://doi.org/10.1038/s41598-026-39182-3

Schlüsselwörter: Heilpflanzen, Blattkrankheitserkennung, Tiefes Lernen, erklärbare KI, präzisionslandwirtschaft