Clear Sky Science · de

Bewertung von Imputationsstrategien für fehlende Zeitreihendaten in der Intensivmedizin anhand realitätsnaher Szenarien

Warum das Schließen von Datenlücken bei Intensivpatienten wichtig ist

In modernen Intensivstationen wird jeder Herzschlag, jeder Atemzug und jeder Blutdruckpuls als ein stetiger Zahlenstrom aufgezeichnet. In der Praxis sind diese Ströme jedoch voller Lücken: Sensoren lösen sich, Patienten verlassen das Bett für Untersuchungen, und Geräte werden zeitweise abgeschaltet. Wenn Ärztinnen, Ärzte und Algorithmen diese unvollständigen Aufzeichnungen zur Vorhersage des Patientenverlaufs oder zur Steuerung der Behandlung nutzen, kann die Art und Weise, wie wir die fehlenden Stücke „auffüllen“, die Interpretation der Daten deutlich verändern. Diese Studie stellt eine praxisnahe Frage mit großer Tragweite: Welche der vielen Strategien zum Auffüllen von Lücken – von einfachen Geraden bis zu modernen künstlichen Intelligenzverfahren – funktionieren am besten unter den Datenlücken, die tatsächlich auf Intensivstationen auftreten?

Ein näherer Blick auf Vitalparameter auf der Intensivstation

Die Forschenden nutzten MIMIC-IV, eine große öffentliche Datenbank anonymisierter Intensivaufenthalte aus einem US-Krankenhaus. Sie konzentrierten sich auf 26.167 erwachsene Aufenthalte und untersuchten die ersten 48 Stunden nach Aufnahme auf der Intensivstation, wobei vier kontinuierlich am Bett überwachte Vitalparameter verfolgt wurden: Herzfrequenz, Sauerstoffsättigung, Atemfrequenz und mittlerer Blutdruck. Um die Signale realistisch zu halten, wurden offensichtlich unmögliche Messwerte entfernt, und alle Messungen wurden stündlich zusammengefasst. Jede Stunde ohne aufgezeichneten Wert für einen bestimmten Vitalparameter wurde als fehlend gewertet. Obwohl nur etwa 4 % aller Werte fehlten, zeigte das Team, dass diese Lücken nicht zufällig verteilt waren — sie traten oft gehäuft später im 48-Stunden-Fenster auf und betrafen manchmal mehrere Vitalparameter gleichzeitig.

Wie realistische Datenlücken nachgebildet wurden

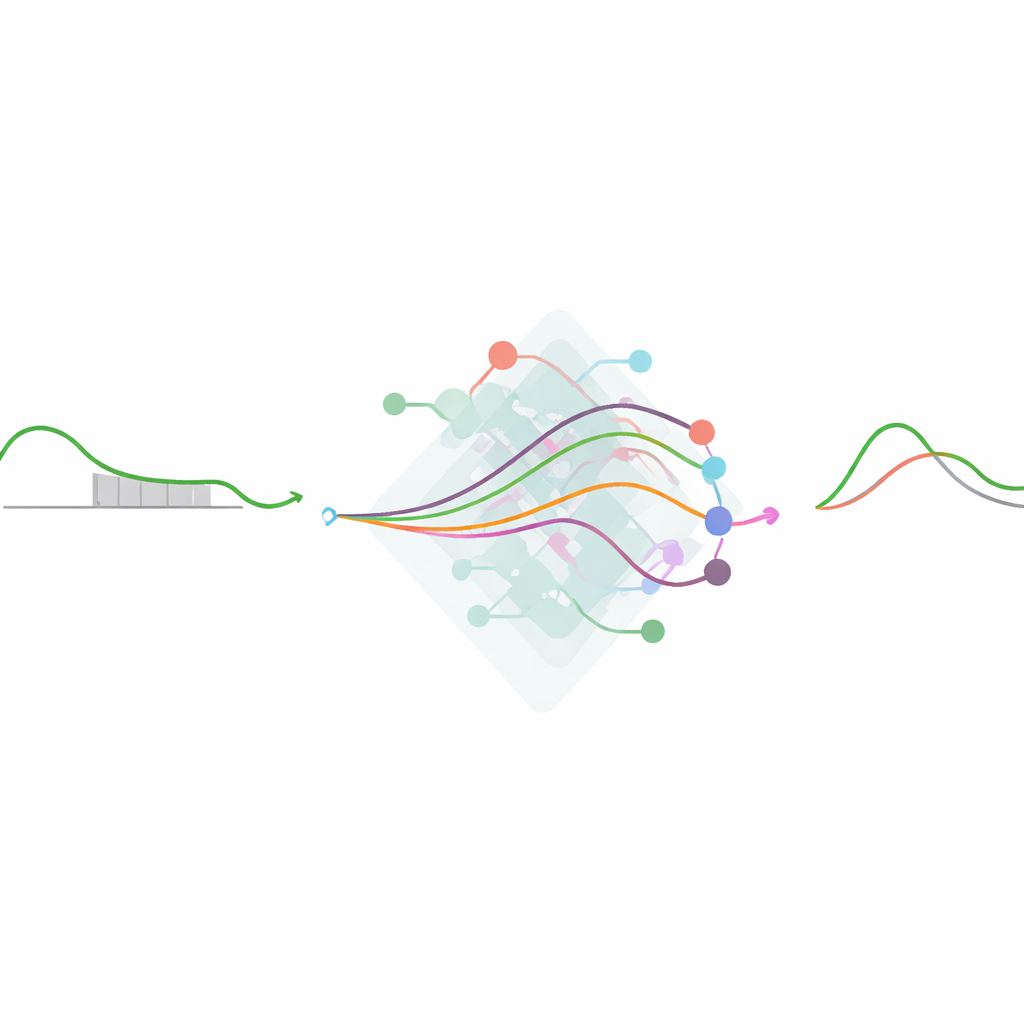

Anstatt ausschließlich künstliche Muster fehlender Werte zu erfinden, entwickelten die Autorinnen und Autoren drei Szenarien, die von den Beobachtungen in den Rohdaten und dem klinischen Alltag inspiriert waren. Im ersten Szenario wurden einzelne Messungen zufällig gelöscht, was gelegentlich verlorene Messwerte nachahmt. Im zweiten verschwanden 1- bis 3-stündige Blöcke über alle vier Vitalparameter hinweg, was Zeiten repräsentiert, in denen ein Patient nicht an die Monitore angeschlossen ist – etwa während einer Bildgebung. Im dritten Szenario wurde ein einzelner Vitalparameter – zum Beispiel der Blutdruck – für eine zusammenhängende 4-stündige Periode entfernt, was einem ausgefallenen Sensor oder einer verschobenen Sonde entspricht. Jedes Szenario entfernte etwa 30 % der Daten und stellte somit eine ernsthafte Herausforderung für Methoden dar, die die ursprünglichen Verläufe rekonstruieren sollen.

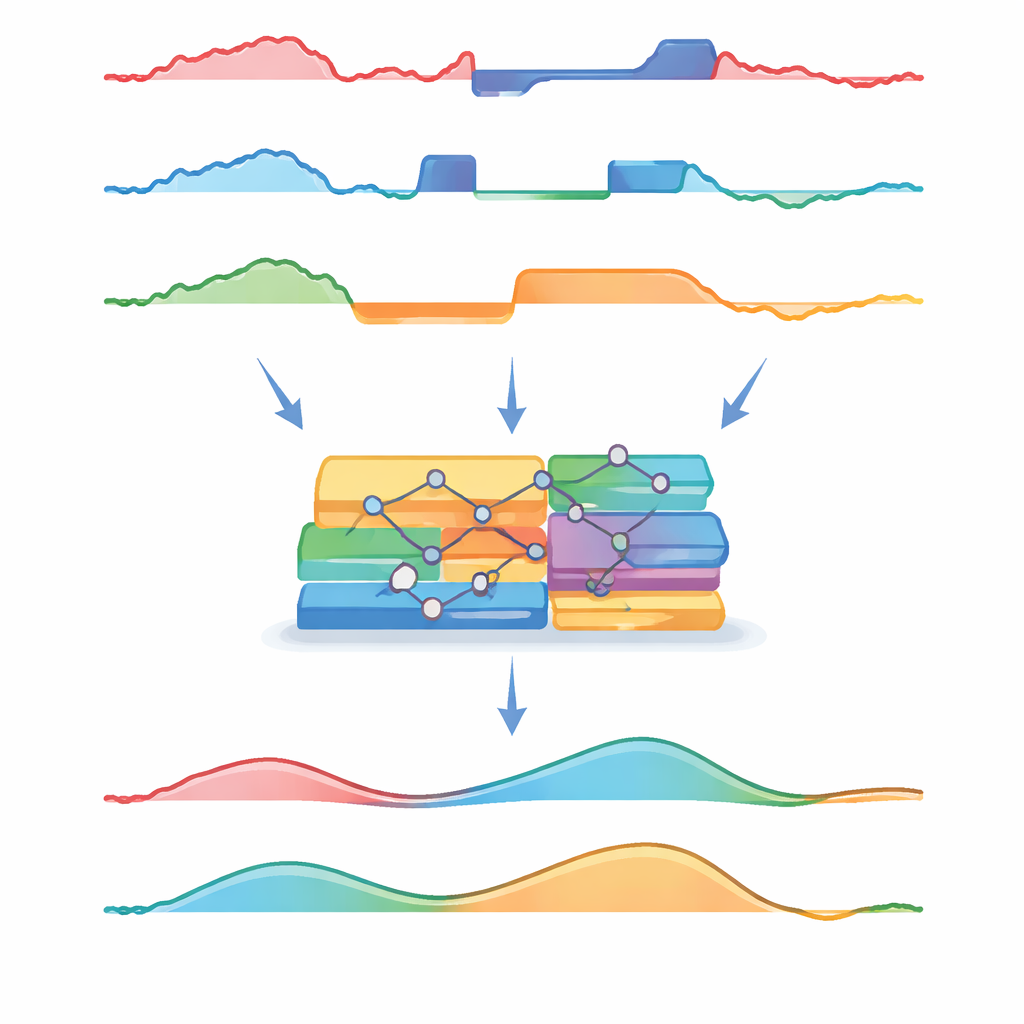

Alte Methoden versus moderne maschinelle Intelligenz

Das Team stellte dann eine breite Palette von Rekonstruktionsmethoden gegeneinander. Einfache Standardverfahren umfassten das Auffüllen einer Lücke mit dem Mittelwert des Patienten, das Weitertragen des zuletzt beobachteten Werts oder das Einfügen einer Geraden zwischen den nächsten bekannten Punkten. Fortgeschrittene statistische Werkzeuge versuchten, fehlende Werte aus den anderen Vitalparametern vorherzusagen, mussten dafür jedoch die Zeitdimension abflachen und jede Stunde wie eine normale Tabellenzeile behandeln. Am anderen Ende des Spektrums standen Deep-Learning-Modelle – Transformer, rekurrente Netze und generative Modelle –, die explizit Muster über die Zeit und zwischen Variablen lernen. Alle Modelle wurden auf Daten trainiert, bei denen 30 % der Werte zufällig verborgen waren, und anschließend in den drei Maskierungsszenarien getestet. Die Leistung wurde daran gemessen, wie weit die Rekonstruktionen von den ursprünglichen Werten abwichen, mit besonderem Augenmerk auf Fehler im mittleren Blutdruck, ein wichtiges Signal für die Kreislaufsteuerung.

Was wann funktionierte und um wie viel

Insgesamt lieferten die ausgereiftesten Modelle – insbesondere ein Transformer-basierter Ansatz und ein generatives adversariales Netzwerk – die geringsten durchschnittlichen Fehler, vor allem wenn Lücken kurz oder verstreut waren. Auffällig war jedoch, dass die einfache Methode der linearen Interpolation in vielen Situationen sehr gut abschnitt und den neuronalen Modellen nahekam. Statistische Verfahren, die die Reihenfolge der Messungen ignorierten, wie Random Forests und verkettete Gleichungen, lagen trotz ihrer Komplexität zurück. Auch die Form der Lücken spielte eine Rolle. Bei zufällig fehlenden Werten schnitten alle Methoden besser ab, was ein zu optimistisches Bild ihrer Genauigkeit zeichnen kann. Lange, zusammenhängende Ausfälle in der Aufzeichnung, insbesondere über mehrere Stunden oder bei einem ausgefallenen Sensor, erwiesen sich als deutlich schwerer korrekt zu füllen. In diesen anspruchsvolleren Situationen verschlechterten sich die besten Deep-Learning-Methoden zwar langsamer als einfache Verfahren, die Verbesserungen waren jedoch oft nur moderat, gemessen in tatsächlichen Blutdruckeinheiten.

Warum die Ergebnisse für Entscheidungen am Bett relevant sind

Für alltägliche Blutdruckwerte betrug der Unterschied zwischen den besten Deep-Learning-Modellen und der einfachen Interpolation häufig nur wenige Millimeter Quecksilbersäule – in der Regel zu gering, um eine ärztliche Entscheidung zu verändern. Doch alle Methoden, selbst die fortgeschrittensten, hatten Probleme, wenn der Blutdruck sehr niedrig oder sehr hoch war – genau in den Momenten, in denen sorgfältige Überwachung am wichtigsten ist. Die Studie kommt zu dem Schluss, dass die Wahl, wie fehlende Intensivdaten behandelt werden, ebenso sehr davon abhängt, wie und wo Lücken auftreten, wie von der Auswahl des neuesten Algorithmus. Sophistische Modelle können vor allem bei längeren oder komplexeren Lücken zusätzliche Vorteile bieten, doch einfache, transparente Methoden können für viele praktische Anwendungen mehr als ausreichend sein. Entscheidend ist auch, dass bessere Lückenauffüllung nicht automatisch bessere Vorhersagemodelle garantiert; künftige Arbeiten müssen untersuchen, wie sich diese Rekonstruktionsentscheidungen auf tatsächliche klinische Entscheidungen auswirken.

Zitation: Poette, M., Mouysset, S., Ruiz, D. et al. Benchmarking imputation strategies for missing time-series data in critical care using real-world-inspired scenarios. Sci Rep 16, 8116 (2026). https://doi.org/10.1038/s41598-026-39035-z

Schlüsselwörter: ICU-Zeitreihen, fehlende Daten, Imputationsmethoden, Deep Learning, Vitalparameter