Clear Sky Science · de

Kumulierte lokale Effekte und graphneuronale Netze zur Linkvorhersage

Warum das Verstehen verdeckter Verbindungen wichtig ist

Viele Systeme, die unser Leben prägen – soziale Medien, wissenschaftliche Kooperationen, Gehirnnetzwerke und sogar das Web selbst – lassen sich als Netzwerke verbundener Punkte beschreiben. Eine zentrale Frage ist, welche neuen Verbindungen in Zukunft wahrscheinlich entstehen, zum Beispiel wer künftig miteinander zusammenarbeitet oder welche Arbeit welche zitieren wird. Moderne graphneuronale Netze sind mächtige Werkzeuge für diese Art der „Linkvorhersage“, aber sie sind auch Blackboxes: Sie funktionieren gut, doch es ist schwer nachzuvollziehen, warum sie eine bestimmte Entscheidung treffen. Dieses Paper geht dieses Problem an, indem es eine allgemeine Erklärtechnik anpasst, sodass wir sehen können, wie sich das Ändern einer einzelnen Eigenschaft eines Knotens auf die Wahrscheinlichkeit auswirkt, dass Verbindungen zu ihm entstehen.

Von einfachen Scores zu undurchsichtigen Graph‑Gehirnen

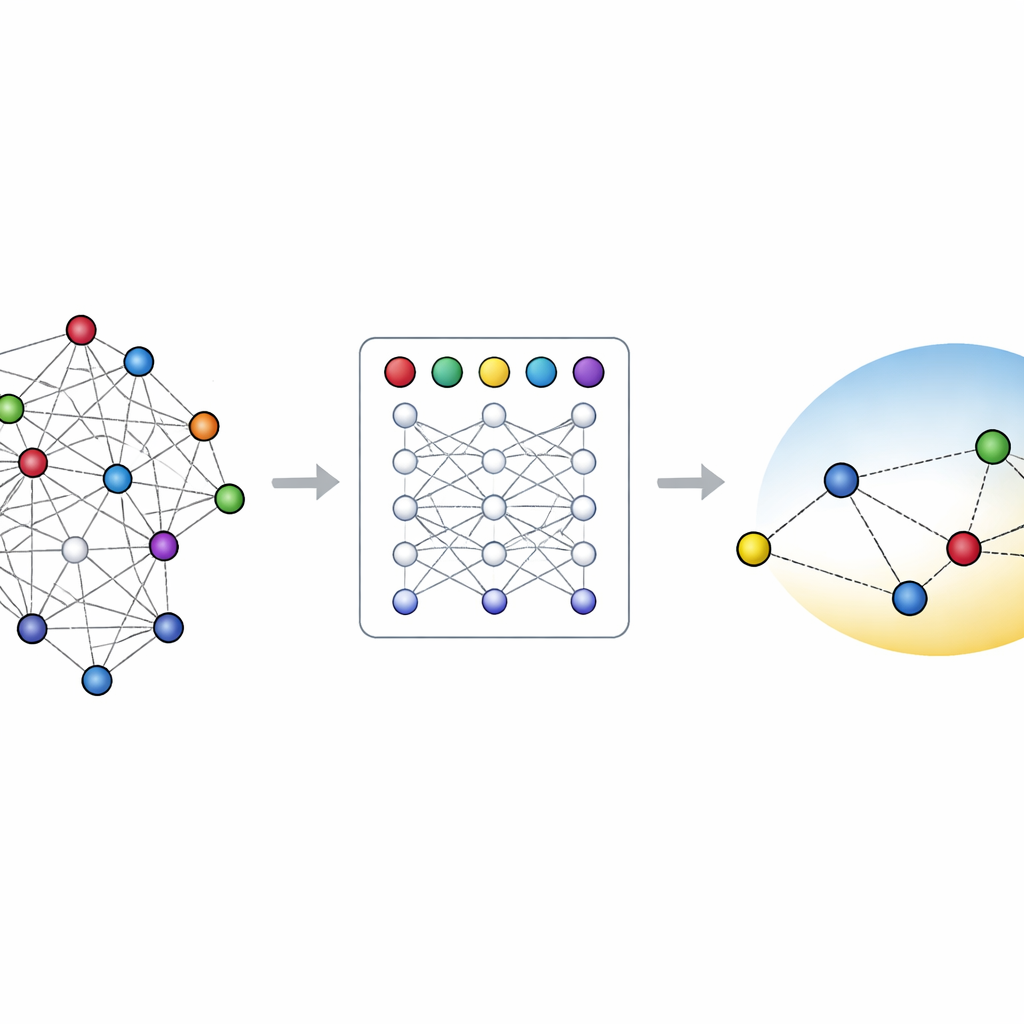

Frühe Netzwerkwissenschaft stützte sich auf einfache Regeln, um fehlende oder zukünftige Verbindungen zu vermuten. Zum Beispiel sind zwei Personen mit vielen gemeinsamen Freunden eher geneigt, selbst Freunde zu werden, und stark verlinkte Webseiten ziehen tendenziell noch mehr Links an. Im vergangenen Jahrzehnt wurden diese handgefertigten Scores von Methoden überholt, die kompakte numerische Beschreibungen oder Einbettungen (Embeddings) für jeden Knoten erlernen. Graphneuronale Netze gehen einen Schritt weiter: Sie leiten wiederholt Nachrichten entlang der Kanten, sodass das Embedding jedes Knotens Informationen von seinen Nachbarn und deren Nachbarn sammelt. Das macht sie exzellent für Linkvorhersage, bedeutet aber auch, dass ihre inneren Abläufe verwoben und schwer zu interpretieren sind.

Sehen, wie ein einzelnes Merkmal Vorhersagen verschiebt

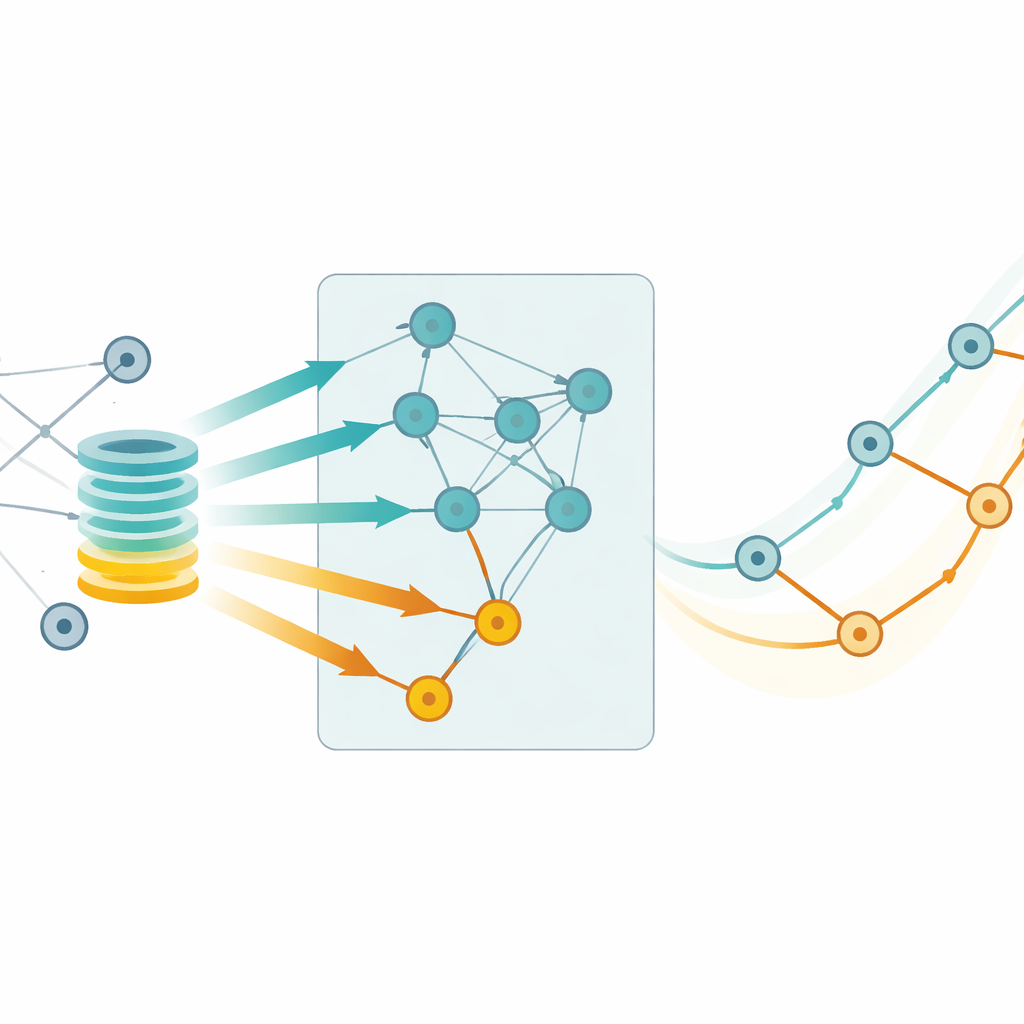

Außerhalb der Graphwelt ist eine verbreitete Methode zur Interpretation von Black‑Box‑Modellen die sogenannten kumulierten lokalen Effekte (Accumulated Local Effects, ALE). Anstatt nur zu sagen, welche Merkmale wichtig sind, fragt ALE, wie sich die Vorhersage des Modells verändert, wenn man ein Merkmal leicht nach oben oder unten verschiebt, und akkumuliert diese lokalen Änderungen zu einer glatten Kurve. Die Autorinnen und Autoren passen ALE für Linkvorhersagen mit graphneuronalen Netzen an, indem sie nacheinander das Merkmal eines Knotens verändern und prüfen, wie die vorhergesagte Wahrscheinlichkeit von Verbindungen zwischen diesem Knoten und vielen anderen reagiert. Das erzeugt eine Visualisierung, die zum Beispiel zeigt, wie eine erhöhte Anteilsgröße von „Big‑Tech“-Autoren an einem Paper oder eine veränderte vertikale Lage eines Gefäßsegments im Gehirn die geschätzte Wahrscheinlichkeit einer Verbindung verschiebt.

Zwei Arten, Effekte zu berechnen: exakt und schnell

Graphneuronale Netze bringen eine Besonderheit in ALE: Wenn man viele Knoten gleichzeitig verändert, können sie sich durch Message Passing gegenseitig beeinflussen, was die Erklärung verzerren kann. Daher vergleichen die Autorinnen und Autoren zwei Strategien. In der „exakten“ Version wird das Merkmal jedes Knotens isoliert verändert, sodass keine zwei veränderten Knoten die Embeddings des jeweils anderen kontaminieren können – das ist jedoch rechnerisch aufwendig. In der „approximativen“ Version werden viele Knoten gleichzeitig geändert, wobei die Daten eher wie eine gewöhnliche Tabelle behandelt und diese Interaktionen ignoriert werden; das ist deutlich schneller, kann aber Verzerrungen einführen. Durch systematisches Variieren der Anzahl veränderter Knoten und der Anzahl möglicher Partner, gegen die sie getestet werden, messen die Autorinnen und Autoren, wie diese Entscheidungen die ALE‑Kurven beeinflussen.

Tests an synthetischen Graphen und realen Daten

Um die Genauigkeit zu untersuchen, bauen die Forschenden zunächst ein synthetisches Netzwerk, in dem die wahre Regel für die Linkbildung bekannt ist: Kanten sind wahrscheinlicher, wenn ein spezielles »Signal«‑Merkmal bei beiden Endpunkten hoch ist. Hier können sie ALE‑Kurven direkt mit der Ground Truth vergleichen. Sie stellen fest, dass die approximative Methode mit zunehmender Zahl gleichzeitig veränderter Knoten vom wahren Zusammenhang abdriftet, während die exakte Methode treu bleibt. Bei großen realen Datensätzen – einem Zitiernetzwerk von KI‑Papieren und einer detaillierten 3D‑Karte von Blutgefäßen im Mausgehirn – ist die wahre Regel nicht mehr sichtbar; daher verwenden sie die exakte Methode, aggregiert über viele Durchläufe, als Goldstandard‑Erklärung und prüfen, wie weit die approximative Methode davon abweicht. Statistische Tests und Permutationsexperimente zeigen, dass in den meisten Modell‑Datensatz‑Kombinationen die Unterschiede zwischen den beiden Methoden moderat sind, wobei die approximativen Kurven jedoch von Lauf zu Lauf variabler sind.

Was diese Effekte über die Welt verraten

Über die Methodik hinaus liefern die ALE‑Kurven Einblicke, was die Modelle tatsächlich gelernt haben. Im Zitiernetzwerk deuten sie darauf hin, dass Arbeiten mit einem höheren Anteil an Autoren aus großen Technologieunternehmen laut Modell eher zitiert werden – ein Echo der Sorge über den wachsenden Einfluss der Industrie in der KI‑Forschung. Im Gefäßgraphen lernen zwei verschiedene graphneuronale Netzarchitekturen entgegengesetzte Trends dafür, wie die Höhe eines Gefäßes im Gehirn mit seiner Konnektivität zusammenhängt, was unterstreicht, dass ALE die Überzeugungen des Modells offenlegt, nicht notwendigerweise biologische Wahrheit. Solche Diskrepanzen können Stellen markieren, an denen Architektur, Trainingsdaten oder Evaluation überdacht werden sollten.

Fazit für Leserinnen, Leser und Praktiker

Die Studie zeigt, dass sich kumulierte lokale Effekte so anpassen lassen, dass sie Linkvorhersagen in graphneuronalen Netzen erklären und anschauliche Kurven liefern, die zeigen, wie sich das Ändern eines Knotenmerkmals auf Linkwahrscheinlichkeiten auswirkt. Die exakte Berechnung dieser Kurven ist verlässlicher, aber langsamer, während eine schnellere Approximation häufig ausreichend ist, wenn man etwas zusätzliche Varianz in Kauf nimmt, insbesondere beim Mitteln über viele Läufe. Für Anwenderinnen und Anwender, die bereits Erklärwerkzeuge für Standard‑Machine‑Learning‑Modelle nutzen, bringt dies eine vertraute, visuelle Möglichkeit, komplexe graphbasierte Systeme zu durchleuchten und zu hinterfragen, ob das, was das Modell gelernt hat, wirklich mit unserem Verständnis der relevanten Netzwerke übereinstimmt.

Zitation: Kaczyńska, P., Sienkiewicz, J. & Ślęzak, D. Accumulated local effects and graph neural networks for link prediction. Sci Rep 16, 8574 (2026). https://doi.org/10.1038/s41598-026-39000-w

Schlüsselwörter: graphneuronale Netze, Linkvorhersage, Modellerklärbarkeit, kumulierte lokale Effekte, Netzwerkforschung