Clear Sky Science · de

Feinabgestimmte große Sprachmodelle mit strukturierten Prompts ermöglichen den effizienten Aufbau von Wissensgraphen zum Lungenkrebs

Warum aus medizinischem Text Karten zu machen wichtig ist

Lungenkrebs gehört zu den tödlichsten Krebsarten weltweit, und Informationen über Diagnose und Behandlung sind über Forschungsartikel, Krankenhausberichte, Online‑Konsultationen und traditionelle medizinische Fallbücher verstreut. Ärztinnen, Ärzte und Forschende haben Schwierigkeiten, mit dieser Textflut Schritt zu halten. Diese Studie untersucht eine neue Methode, um dieses verstreute Wissen automatisch in eine einzige, navigierbare „Karte“ — einen Wissensgraphen zum Lungenkrebs — zu überführen, indem ein feinabgestimmtes großes Sprachmodell und sorgfältig strukturierte Prompts eingesetzt werden. Das Ziel ist, komplexes medizinisches Wissen für Computer durchsuchbar zu machen und Expertinnen und Experten besser in Entscheidungsunterstützungssystemen nutzbar zu machen.

Von verstreuten Geschichten zu verknüpften Fakten

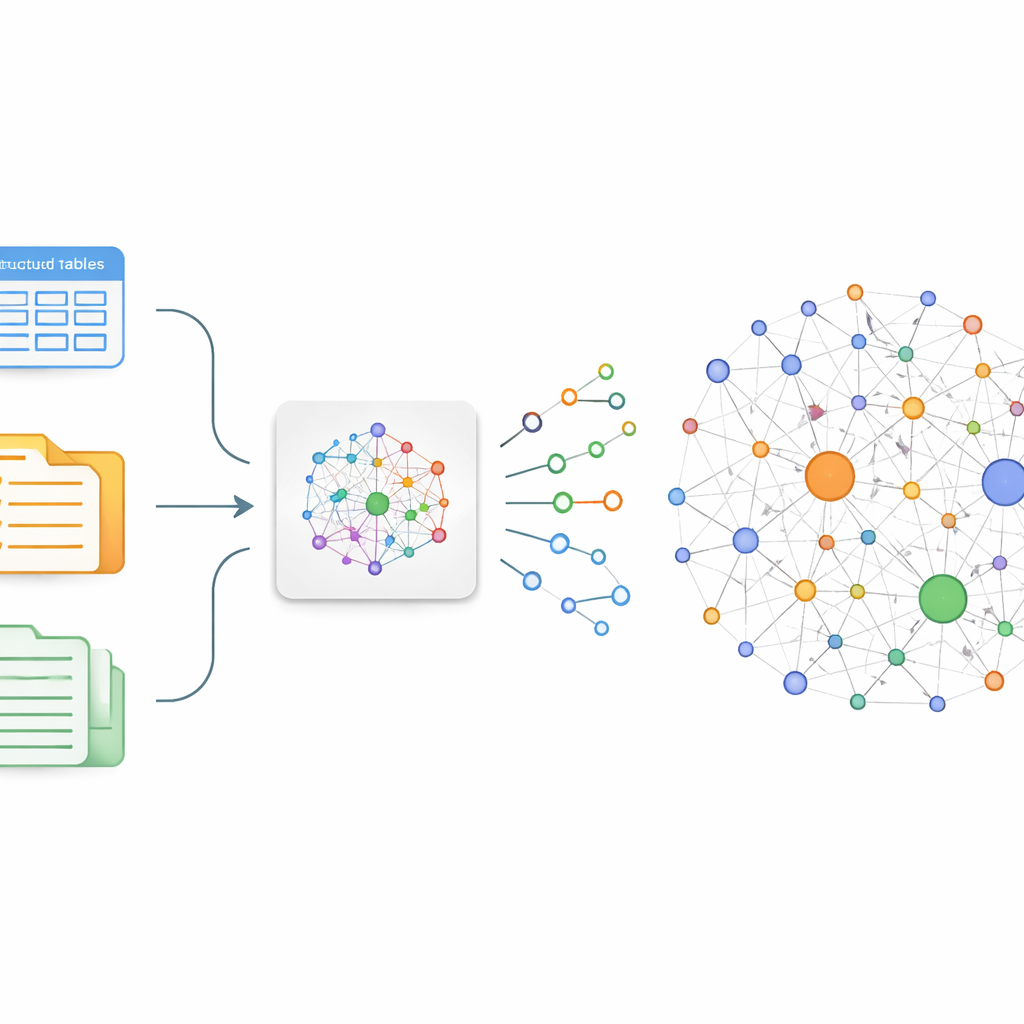

Die Autorinnen und Autoren konzentrieren sich auf eine einfache Idee: Wenn man zuverlässig aus medizinischem Text herausziehen kann, wer-was-mit-wem macht, lässt sich dieses Wissen zu einem Graphen verknüpfen. Praktisch bedeutet das, freie Sätze in kleine Bausteine namens Tripel zu überführen — Entitätspaare, die durch eine Relation verbunden sind, etwa „Lungenkrebs – behandelt mit – Chemotherapie.“ Traditionelle Methoden zum Aufbau solcher Graphen erfordern entweder Heerscharen von Annotatorinnen und Annotatoren oder starre Regeln, die Nuancen und neue Erkenntnisse übersehen. Um das zu umgehen, feinabstimmt das Team ein existierendes chinesisches großes Sprachmodell, ChatGLM-6B, sodass es darauf spezialisiert ist, medizinisch sinnvolle Tripel zu Lungenkrebs aus einer Vielzahl von Quellen zu erkennen — von Online‑Patient‑Arzt‑Chats über halbstrukturierte klinische Fälle bis hin zu Aufzeichnungen der traditionellen chinesischen Medizin.

Ein KI das Denken in klaren Einheiten beibringen

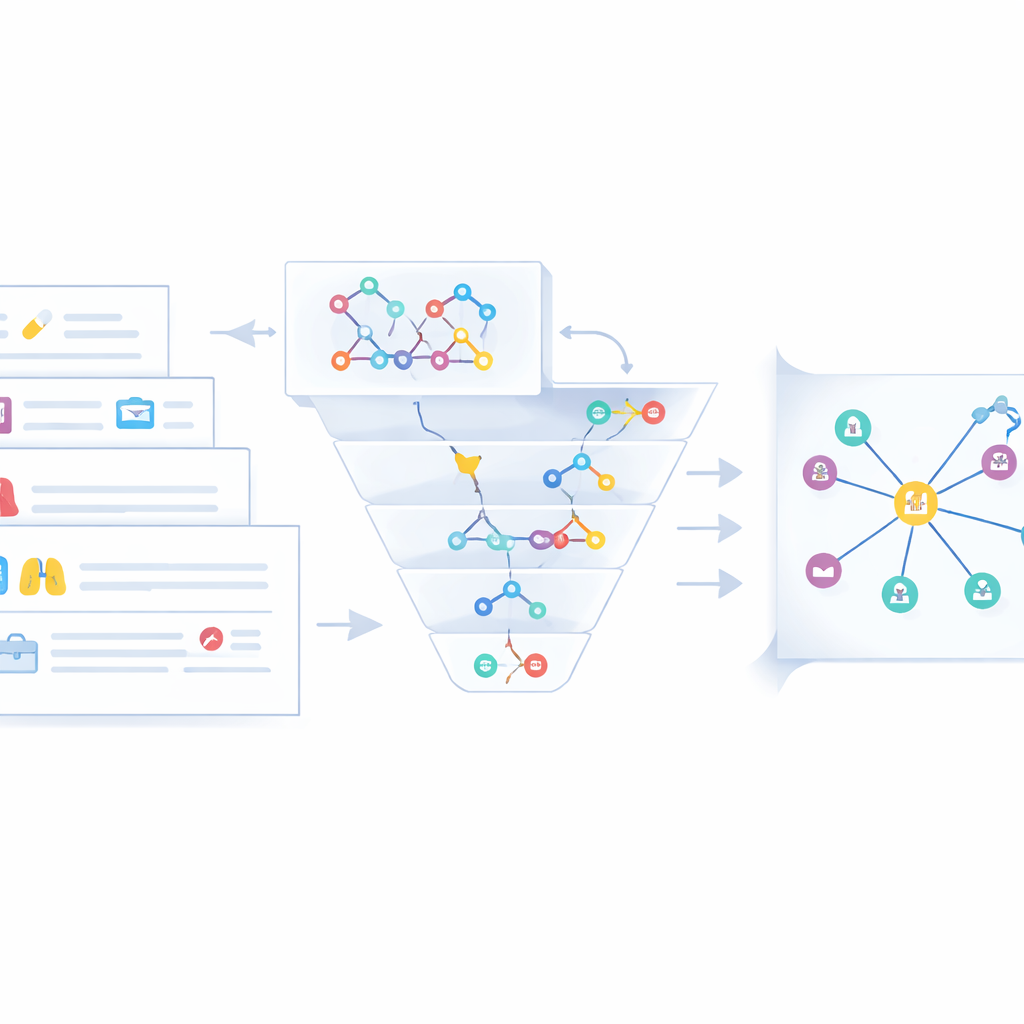

Ein allgemeines Sprachmodell einfach nur zu bitten, „Informationen zu extrahieren“, liefert häufig unstrukturierte, ausschweifende Antworten. Die Forschenden entwerfen daher ein strenges Prompt‑Schema und feinabstimmen das Modell anhand von fast 50.000 Beispielen erwünschten Verhaltens. Jedes Beispiel zeigt eine Anweisung und die exakt erwartete tripelartige Ausgabe. Das Prompt weist das Modell an, wie ein professioneller Text‑Mining‑Experte zu agieren, ausschließlich strukturierte Tripel in einem maschinenlesbaren Format zu liefern und bei Sätzen mit verschachtelten Details „Schritt für Schritt“ zu denken — etwa wenn Behandlung, verwendetes Medikament und Dosierung genannt werden. Diese Kombination aus Rollenfestlegung, Formatregeln und schrittweisem Denken verwandelt das Modell — nun KGLM genannt — von einem Konversationsassistenten in einen disziplinierten Extraktor maschinenbereiter Fakten.

Viele Stimmen zu einem klaren Graphen verschmelzen

Rohe Tripel aus Text sind nur ein Teil der Arbeit. Dieselbe Krankheit oder dasselbe Medikament tauchen oft unter unterschiedlichen Bezeichnungen auf — etwa „chronisch obstruktive Lungenerkrankung“ versus „COPD“. Um Unordnung und Verwirrung zu vermeiden, entwickeln die Autorinnen und Autoren eine Fusionsstufe, die äquivalente Entitäten aus drei Datenströmen zusammenführt: unstrukturierter Webtext, halbstrukturierte klinische Fälle und bestehende medizinische Wissensgraphen. Zunächst markiert eine schnelle stringbasierte Ähnlichkeitsprüfung offensichtliche Übereinstimmungen. Reicht das nicht aus, vergleicht ein tiefer gehendes semantisches Ähnlichkeitsmodell (Sentence-BERT) Bedeutungen im Kontext. Als Duplikate beurteilte Entitäten werden zu einem einzigen kanonischen Knoten verschmolzen, wobei kürzere Namen bevorzugt und andere Formen als Aliase gespeichert werden. Expertinnen und Experten prüfen dann Grenzfälle und entfernen irreführende oder qualitativ minderwertige Aussagen, was zu einem saubereren und kohärenteren Wissensgraphen zum Lungenkrebs führt, der in einer Neo4j‑Datenbank gespeichert wird.

Wie gut funktioniert diese Wissenskarte?

Zur Leistungsbewertung vergleicht das Team KGLM mit gängigen Deep‑Learning‑Ansätzen auf BERT‑Basis und mit Faltungsnetzwerken sowie mit dem ursprünglichen, nicht feinabgestimmten ChatGLM‑Modell. Bei der Aufgabe der Relationsextraktion — also der Entscheidung, welche Entitäten miteinander verknüpft sind und wie — erreicht das feinabgestimmte, promptgeführte KGLM eine F1‑Score von etwa 0,82, übertrifft damit alle getesteten Baselines und verbessert sich gegenüber dem Ausgangsmodell um rund 25 Prozent. Ablationsstudien zeigen, dass jede Komponente des Prompts wichtig ist: Das Entfernen der Expertenrolle, des strikten Tripelformats oder der „Schritt‑für‑Schritt‑Denken“-Anweisung verschlechtert die Genauigkeit, insbesondere bei komplexen Sätzen mit verschachtelten Attributen oder Terminologie der traditionellen chinesischen Medizin. Ein Gremium aus klinischen und Informatik‑Expertinnen und -Experten beurteilt den resultierenden Graphen ebenfalls als genauer, nutzbarer und klinisch relevanter als Graphen, die ohne Feinabstimmung oder strukturierte Prompts erstellt wurden.

Was das für künftige medizinische Werkzeuge bedeutet

Kurz gesagt zeigt die Studie, dass mit der richtigen Schulung und Anleitung ein großes Sprachmodell unordentlichen, realen Lungenkrebs‑Text effizient in ein strukturiertes, durchsuchbares Netz von Fakten überführen kann. Dieser Wissensgraph zum Lungenkrebs ist zwar noch ein Forschungsprototyp und auf chinesischsprachige Quellen sowie einen Krankheitsbereich beschränkt, weist aber in Richtung einer Zukunft, in der ständig aktualisierte „Wissenskarten“ Entscheidungsunterstützungssysteme, Bildungswerkzeuge und Forschungserkundungen unterstützen könnten. Die Autorinnen und Autoren betonen, dass solche Graphen sorgfältig validiert und regelmäßig aktualisiert werden müssen und ohne fachliche Aufsicht nicht zur Steuerung der Patientenversorgung geeignet sind. Dennoch deuten ihre Ergebnisse darauf hin, dass feinabgestimmte Sprachmodelle zusammen mit intelligenten Prompts die schwierige Aufgabe, medizinisches Wissen zu organisieren, skalierbarer und zeitgerechter machen können.

Zitation: Zhou, C., Gong, Q., Luan, H. et al. Fine-tuned large language models with structured prompts enable efficient construction of lung cancer knowledge graphs. Sci Rep 16, 9505 (2026). https://doi.org/10.1038/s41598-026-38959-w

Schlüsselwörter: Lungenkrebs, Wissensgraph, großes Sprachmodell, Relationsextraktion, medizinische KI