Clear Sky Science · de

DQN-gestützte Energieoptimierung für drahtlos mit Energie versorgte Kommunikationsnetze

Winzige Geräte durch die Luft mit Energie versorgen

Von intelligenten Straßenlaternen bis zu in Wäldern versteckten Brandmeldern bilden unzählige winzige Geräte inzwischen das Internet der Dinge. Alle mit Energie zu versorgen ist eine große Herausforderung: Batterien laufen leer und Stromkabel überall zu verlegen ist unpraktisch. Diese Arbeit untersucht, wie man solchen Geräten drahtlos Energie zukommen lassen kann und wie künstliche Intelligenz diese Energie klug verteilt, sodass kritische Sensoren länger funktionsfähig bleiben und das gesamte Netzwerk reibungsloser arbeitet.

Warum drahtlose Energie intelligentere Steuerung braucht

Drahtlos mit Energie versorgte Kommunikationsnetze senden Funkwellen aus, die Geräte in Strom umwandeln und zugleich zur Datenübertragung nutzen können. In den meisten früheren Studien wurde diese Energieumwandlung vereinfacht als lineares Verhalten behandelt: mehr Signal bedeutete proportional mehr Leistung. In Wirklichkeit flachen Energiegewinnungsschaltungen jedoch ab, wenn das eingehende Signal stark ist, sodass ein Teil der Energie verloren geht. Gleichzeitig sind reale Umgebungen unübersichtlich: Sonnenlicht für Solarzellen schwankt, Gebäude blockieren Signale und plötzliche Ereignisse wie Brände können an bestimmten Knoten dringenden Datenbedarf erzeugen. Starre Regeln, die diese Wendungen ignorieren, können dazu führen, dass einige Sensoren energietechnisch vernachlässigt werden, während andere Energie verschwenden — was die Lebensdauer des gesamten Netzwerks verkürzt.

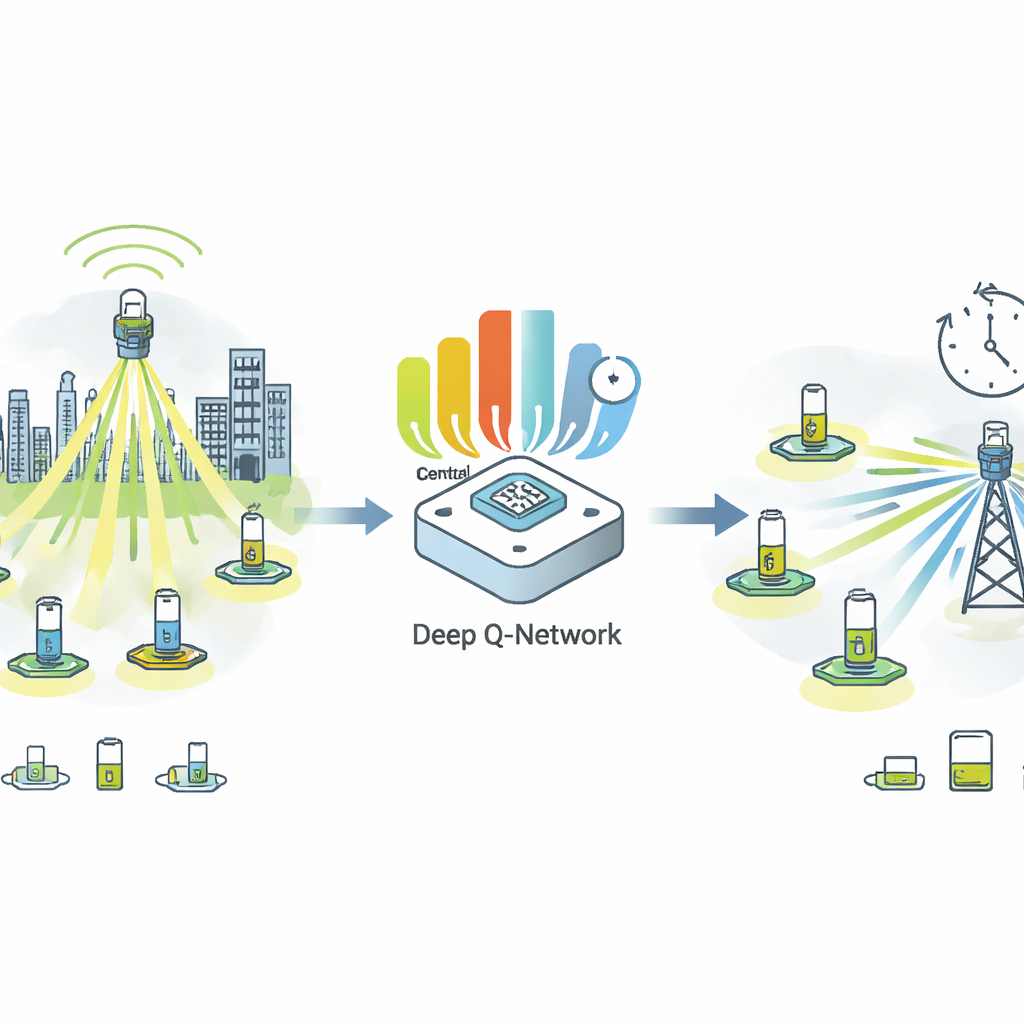

Ein lernendes Gehirn für das Energienetz

Um dem zu begegnen, entwerfen die Autoren einen lernbasierten Controller auf Basis einer Technik namens Deep Q-Networks, einer Form des verstärkenden Lernens. Statt sich auf feste mathematische Formeln zu stützen, behandelt dieser Controller das Netzwerk als ein Spiel über die Zeit. In jeder Runde beobachtet er die verbleibende Energie in jedem Knoten, die Qualität der Funkverbindungen und wie dringend die jeweiligen Aufgaben sind — etwa Brandüberwachung gegenüber routinemäßigen Temperaturmessungen. Aus diesen Beobachtungen entscheidet er, wie viel Leistung an jeden Knoten abgegeben wird. Nach jeder Entscheidung erhält er Feedback, das mehrere Ziele mischt: möglichst viele nützliche Daten zu übertragen, Energie fair zu verteilen, sodass kein Gerät dauerhaft vernachlässigt wird, und verschwenderische Überbeanspruchung der gemeinsamen Energiequelle zu vermeiden. Über viele Runden lernt der Controller, welche Muster der Energieverteilung zu einer besten langfristigen Performance führen.

Vorausschauen und konkurrierende Ziele ausbalancieren

Ein wichtiges Element im Rahmen ist die Vorhersage. Das System nutzt eine statistische Methode namens Gaussian Process Regression, um abzuschätzen, wie viel Energie Knoten in naher Zukunft voraussichtlich ernten werden — zum Beispiel wenn sich die Sonnenlichtbedingungen ändern. Es verwendet außerdem ein flexibles Modell dafür, wie Funksignale in realistischen, stadtähnlichen Umgebungen abschwächen und reflektiert werden. Diese Bausteine fließen in einen Entscheidungsprozess ein, der sich alle paar Sekunden aktualisiert und es dem Controller erlaubt, schnell auf veränderte Netzwerkbedingungen zu reagieren. Das Belohnungssignal, das das Lernen steuert, verbindet drei einfache Ideen: Effizienz (wie viele Informationsbits pro Energieeinheit geliefert werden), Fairness (wie gleichmäßig Energie über die Knoten verteilt wird) und Priorität (sicherzustellen, dass Aufgaben mit hoher Dringlichkeit erhalten, was sie brauchen). Durch das Abstimmen der relativen Wichtigkeit dieser drei Komponenten können Betreiber zwischen maximaler Lebensdauer, strenger Fairness oder Spitzen-Datenraten wählen.

Was die Simulationen zeigen

Da Experimente in der realen Welt noch laufen, bewerten die Autoren ihre Methode in detaillierten Computersimulationen eines Netzwerks mit 30 drahtlos mit Energie versorgten Geräten und untersuchen außerdem Szenarien mit bis zu 100 Knoten. Im Vergleich zu einer einfachen festen Energieaufteilung und einer traditionelleren Lernmethode hält der neue Controller das Netzwerk deutlich länger am Leben — etwa halb so viele Runden zusätzlich, bevor Knoten ausfallen. Er hält auch die Streuung der Energiezustände zwischen Geräten viel enger, was bedeutet, dass es deutlich weniger „tote Bereiche“ gibt, in denen Knoten frühzeitig ausfallen. Die gelernte Strategie passt sich plötzlichen Änderungen, etwa einem Abfall der Signalqualität oder einem Sprung in der Aufgabenpriorität, mehrere Male schneller an und erhält über ein breites Spektrum von Funkbedingungen einen höheren Datendurchsatz. Wichtig ist, dass die Autoren auf praktische Details achten und zeigen, dass eine kompakte Version des Lernmodells auf kostengünstigen Mikrocontrollern laufen kann, die in vielen IoT-Geräten verwendet werden, mit Entscheidungszeiten im Bereich von einigen zehn Millisekunden.

Von der Simulation zu realen Sensornetzen

Die Studie kommt zu dem Schluss, dass die Kombination von drahtloser Energie und einem lernbasierten Controller die Lebensdauer und Zuverlässigkeit von Sensornetzwerken deutlich verlängern kann, besonders wenn die Bedingungen unvorhersehbar sind und Aufgaben unterschiedliche Dringlichkeiten haben. Indem sie anerkennt, dass Ernte-Schaltungen sättigen, dass die Funkumgebung schwankt und dass einige Sensoren in einem bestimmten Moment wichtiger sind als andere, lernt der vorgeschlagene Ansatz, konkurrierende Anforderungen besser zu jonglieren als starre Regeln. Die Autoren betonen, dass ihre Ergebnisse derzeit aus Simulationen stammen und die genauen Gewinne auf realer Hardware bestätigt werden müssen. Dennoch weist ihre Arbeit auf eine Zukunft hin, in der großflächige Netze kleiner Geräte lange Zeit mit minimaler menschlicher Betreuung laufen können, intelligent Energie aus der Luft zapfen und dabei wichtige Daten kontinuierlich liefern.

Zitation: Chen, H., Wang, X., Yuan, L. et al. DQN-empowered energy optimization for wireless powered communication networks. Sci Rep 16, 7987 (2026). https://doi.org/10.1038/s41598-026-38904-x

Schlüsselwörter: drahtlose Energie, Internet der Dinge, Energiegewinnung, verstärkendes Lernen, Sensornetzwerke