Clear Sky Science · de

Forschung zu verbesserten Modellen zur Erkennung von Gesichtsausdrücken bei Mäusen mit gestörtem Glukosestoffwechsel

Gesundheit in winzigen Gesichtern ablesen

Abweichender Blutzucker ist vor allem für seine Rolle bei Diabetes bekannt, wirkt aber auch leise auf Gehirn, Stimmung und das allgemeine Wohlbefinden ein. Diese Studie zeigt, dass Mäuse ihren Stoffwechselzustand im wahrsten Sinne des Wortes im Gesicht tragen. Indem winzige Veränderungen an Schnurrhaaren, Ohren und Augen beobachtet und mit einem schlanken, aber leistungsfähigen Computer‑Vision‑Modell kombiniert werden, demonstrieren die Forschenden eine neue Methode, um Blutzuckerprobleme und Behandlungseffekte zu verfolgen – ganz ohne Nadelstich.

Ein Mausmodell für Prädiabetes und Diabetes aufbauen

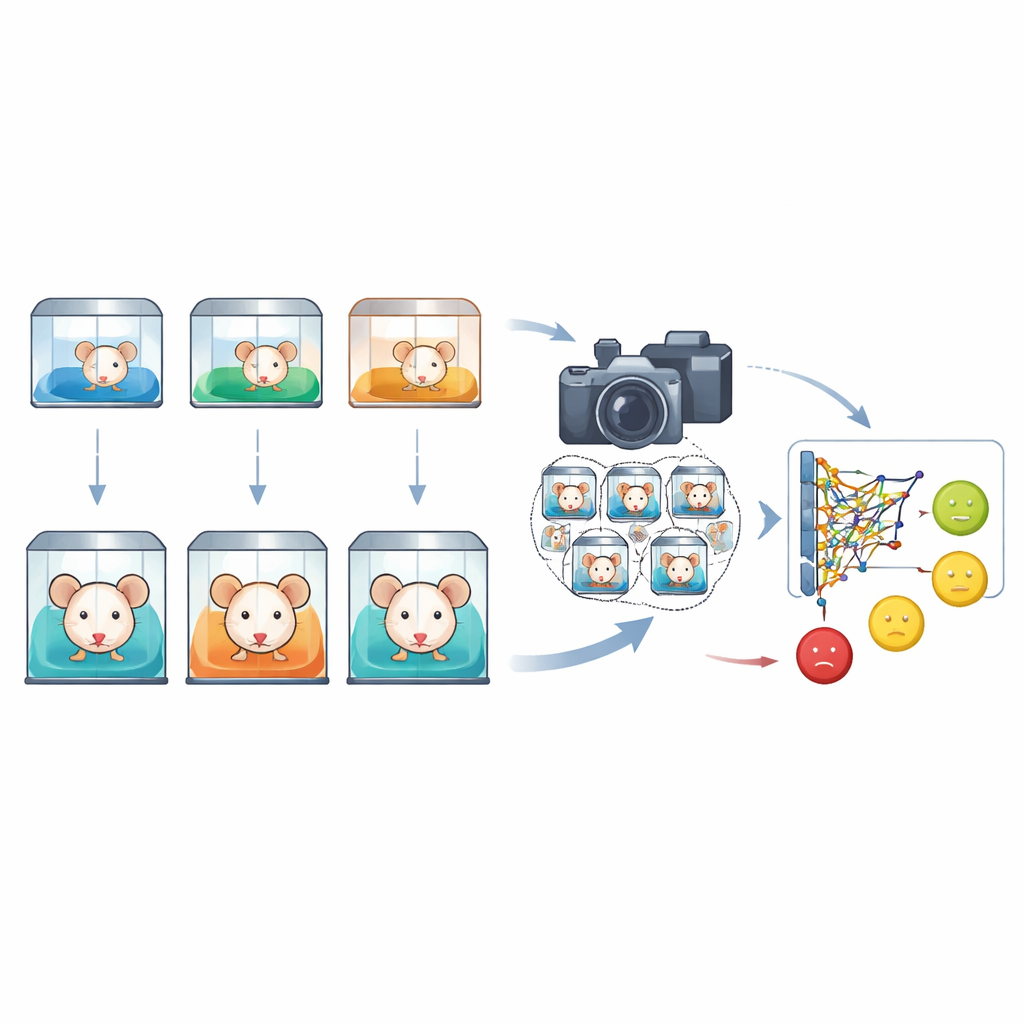

Um zu untersuchen, wie sich Blutzuckeränderungen im Gesicht zeigen, brauchte das Team zunächst Mäuse, die zuverlässig von normalem Stoffwechsel zu Störungen und anschließend zur Erholung wechseln. Sie verwendeten ein bewährtes Protokoll: eine fettreiche Ernährung zusammen mit Streptozotocin, einer Verbindung, die insulinproduzierende Zellen schädigt. Männliche C57BL/6J‑Mäuse wurden in fünf Gruppen aufgeteilt. Eine blieb auf Standardkost, die anderen erhielten die fettreiche Diät plus das Medikament, um erhöhten Blutzucker auszulösen. Anschließend bekamen drei der hoch‑zucker‑Gruppen verschiedene Dosen eines pilz‑abgeleiteten Stoffes, der Sparassis latifolia‑Polysaccharide (SLPs) genannt wird. Über mehrere Monate zeigten wiederholte Bluttests ein klares Muster: Der Blutzucker stieg von normal zu Vorstufe, dann zu ausgeprägter Hyperglykämie und fiel schließlich in der Hochdosis‑SLP‑Gruppe wieder, was eine dosisabhängige Verbesserung offenbarte.

Mausgesichter in eine Datensammlung verwandeln

Als Nächstes verwandelten die Forschenden alltägliches Mausverhalten in eine umfangreiche Bildbibliothek. Zwei Kameras – eine auf Augenhöhe, eine schräg von oben – zeichneten frei bewegliche Mäuse über tausende Minuten bei kontrollierter Beleuchtung und Temperatur auf. Aus 390 Videoclips wählte das Team 2830 klare Bilder von Mausgesichtern von Hand aus. Jedes Bild wurde einem von fünf blutzuckerbasierten Zuständen zugeordnet: normal, frühe Störung, volle Abnormität sowie frühe oder späte Stadien der SLP‑Behandlung. Fachleute zeichneten dann Begrenzungsrahmen um Augen, Ohren, Nase, Mund und Schnurrhaare, um die feinen Hinweise zu erfassen, die Unbehagen, Belastung oder Erleichterung widerspiegeln. So entstand ein standardisierter Datensatz, der Gesichtsausdrücke direkt mit gemessenen Blutzuckerwerten über Krankheitsverlauf und Erholung verknüpft.

Ein kleines, aber scharfäugiges Erkennungsmodell entwerfen

Diese Ausdrücke zu erkennen ist alles andere als trivial: Mausgesichter sind in jedem Bild winzig, Ausdrucksunterschiede sind subtil, und die Käfigumgebung ist visuell unruhig mit Einstreu, Spielzeug und Käfiggenossen. Um das zu bewältigen, baute das Team eine erweiterte Version eines populären Echtzeit‑Vision‑Systems namens YOLOv8 und nannte ihre Variante LFPP‑YOLO. Sie fügten einen „partiellen Selbstaufmerksamkeits“-Block hinzu, der das gesamte Bild scannt, aber selektiv Regionen hervorhebt, die wie Gesichter aussehen, sodass das Modell Ablenkungen im Hintergrund ignorieren kann. Außerdem integrierten sie eine leichte Modulreihe, die Informationen über verschiedene Bildskalen hinweg verbindet, sodass das System sowohl den gesamten Kopf erfassen als auch feine Linien und Texturen um Augen und Schnurrhaare herausarbeiten kann. Eine verfeinerte Verlustfunktion drängt das Modell zusätzlich dazu, enger und genauer um unregelmäßige, verschwommene Gesichtsbereiche zu begrenzen.

Systemtests gegen Konkurrenzmethoden und in der Praxis

Auf dem kuratierten Datensatz erreichte LFPP‑YOLO eine durchschnittliche Erkennungsgenauigkeit von etwa 95 % über die fünf Stoffwechselzustände hinweg, mit einem F1‑Score nahe 0,89. Bemerkenswert ist, dass das Modell dabei sehr klein blieb – etwa 2,4 Megabyte – und schnell arbeitete: Für die Analyse eines Bildes benötigte es auf der Testhardware nur rund 5 Millisekunden. In Direktvergleichen übertraf es sowohl einen klassischen zweistufigen Detektor als auch mehrere neuere YOLO‑Varianten, insbesondere bei kleinen, teilweise verdeckten oder schräg stehenden Gesichtern. Heatmap‑Visualisierungen zeigten, dass das verbesserte Modell gelernt hatte, sich auf Ohren, Augen und Mund zu konzentrieren, selbst wenn andere Mäuse oder Einstreu die Szene überlagerten. In einer separaten Validierung in einer anderen Einrichtung stimmten die auf Ausdrücken basierenden Klassifikationen des Modells eng mit blutzuckerbasierten Labels überein, mit einer statistischen Übereinstimmung, die üblicherweise als „beinahe perfekt“ beschrieben wird.

Was das für die künftige Versorgung bedeuten könnte

Die Arbeit legt nahe, dass Gesichtsausdrücke ein praktisches, nichtinvasives Fenster in den Stoffwechselzustand kleiner Tiere sein können. Statt wiederholter Blutentnahmen könnten Forschende Kameras und einen kompakten Algorithmus nutzen, um zu erkennen, wann eine Maus von normalem Stoffwechsel in eine Störung abrutscht und wann eine Ernährungs‑ oder Wirkstoffintervention beginnt, den Schaden rückgängig zu machen. Zwar ist der aktuelle Datensatz in Umfang und Bedingungen begrenzt und es bedarf weiterer Arbeit, um die Methode auf andere Stämme, Beleuchtungen und Arten zu übertragen, doch die Studie deutet auf eine Zukunft hin, in der die routinemäßige Überwachung chronischer Krankheiten bei Tieren – und vielleicht eines Tages auch bei Menschen – zunehmend auf sorgfältiges Gesichtablesen in Kombination mit intelligenten Vision‑Systemen statt auf Nadeln und Teststreifen setzen könnte.

Zitation: Guo, X., Shi, L., Ma, B. et al. Research on improved models for facial expression recognition in mice with abnormal glucose metabolism. Sci Rep 16, 8165 (2026). https://doi.org/10.1038/s41598-026-38863-3

Schlüsselwörter: Erkennung von Gesichtsausdrücken, gestörter Glukosestoffwechsel, Maus-Diabetes-Modell, Tiefenlern‑Erkennung, nichtinvasive Überwachung