Clear Sky Science · de

VolE: Ein Punktwolken-Framework zur 3D-Rekonstruktion und Volumenschätzung von Lebensmitteln

Warum die Messung Ihres Abendessens wichtig ist

Kalorien aus einem Foto zu zählen klingt nach Zauberei, kann für Ärztinnen, Ärzte und Ernährungswissenschaftlerinnen jedoch ein mächtiges Werkzeug sein. Zu wissen, wie viel jemand tatsächlich isst, ist essenziell für die Behandlung von Erkrankungen wie Diabetes und Adipositas, doch jede Mahlzeit auf einer Küchenwaage zu wiegen ist im Alltag unrealistisch. In diesem Artikel wird VolE vorgestellt, eine neue Methode, mit der ein gewöhnliches modernes Smartphone ein detailliertes dreidimensionales Modell eines einzelnen Lebensmittels erstellen und dessen Volumen mit überraschend hoher Genauigkeit schätzen kann – ganz ohne spezielle Hardware, Referenzkarte oder Tiefensensor.

Von einfachen Fotos zu festen Formen

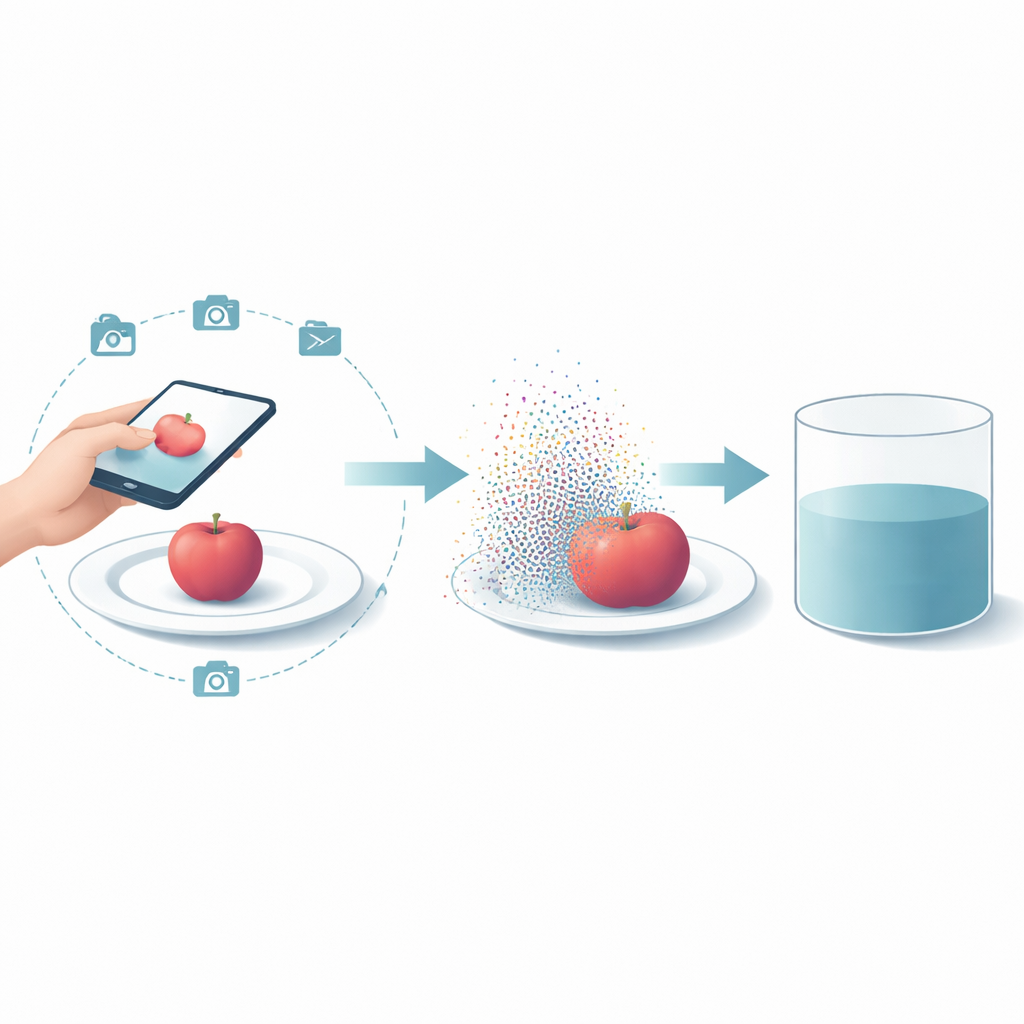

Die Kernidee von VolE besteht darin, ein kurzes, beiläufig aufgenommenes Handyvideo Ihrer Mahlzeit in eine präzise 3D-Form zu verwandeln, die sich messen lässt. Während der Nutzer das Telefon langsam um einen Teller bewegt, zeichnen die eingebauten Augmented-Reality-Funktionen des Geräts (ARCore auf Android oder ARKit auf iOS) sowohl die Bilder als auch die genaue Position und Ausrichtung der Kamera im realen Raum auf. VolE kombiniert diese Bildfolgen und Kamerapfade, um eine dichte „Punktwolke“ des Lebensmittels zu rekonstruieren – tausende winziger Punkte im Raum, die die Oberfläche des Objekts nachzeichnen. Da das AR-System des Telefons bereits die realen Abstände kennt, wird dieses virtuelle Objekt in der korrekten physischen Größe erstellt und löst damit ein langjähriges Problem der Bildverarbeitung, bei dem zwar die 3D-Form rekonstruiert werden kann, nicht jedoch ihre wahre Größe.

Das Essen finden und die Szene säubern

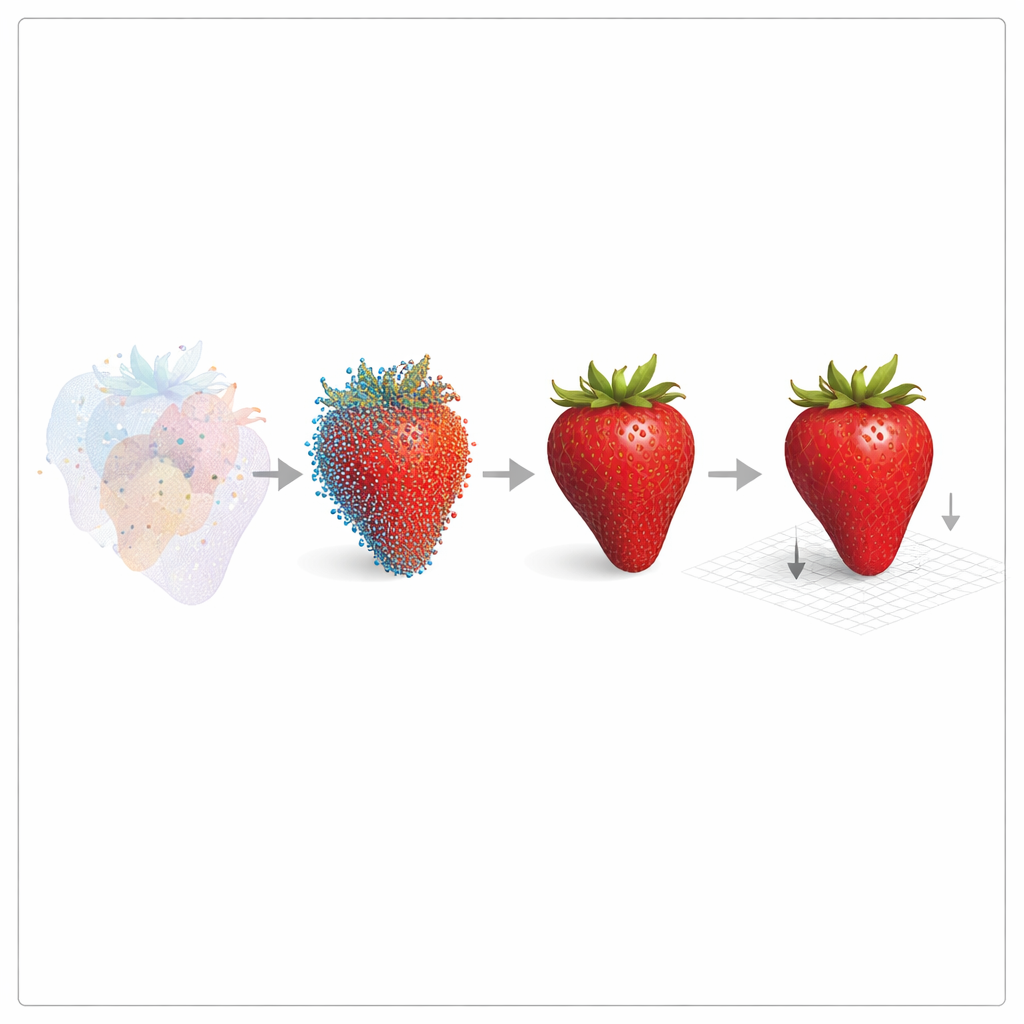

Lebensmittelfotos sind unübersichtlich: Teller, Tische und Hintergrundgegenstände konkurrieren um Aufmerksamkeit. VolE löst das mit einem automatischen Videosegmentierungsschritt, der wie eine intelligente Schere wirkt. Ein Modell namens FoodMem identifiziert, welche Pixel in allen Videoframes zum Essen gehören, selbst wenn sich das Telefon bewegt und das Essen teilweise verdeckt ist. Mithilfe der verfeinerten Kamerapositionen projiziert VolE die 3D-Punkte in jedes segmentierte Bild und behält nur jene Punkte bei, die in jeder Ansicht konsistent auf dem Essen liegen. Das Ergebnis ist eine saubere, isolierte Punktwolke, die nur zum Zielobjekt gehört, während die meisten Hintergrundpunkte und Segmentierungsfehler herausgefiltert werden.

Von Punkten zu einem messbaren Objekt

Punktwolken allein sind schwer zu messen, daher wandelt VolE sie in eine kontinuierliche digitale Oberfläche, ein sogenanntes Mesh, um. Spezialisierte 3D-Software verbindet benachbarte Punkte zu kleinen Dreiecken, die das Lebensmittel wie eine feste Haut umschließen, kleine Lücken füllen und das Objekt „wasserdicht“ machen. Das Mesh wird anschließend durch Glättungs-, Rauschunterdrückungs- und Optimierungsschritte verfeinert, die Unebenheiten und Löcher entfernen, ohne die tatsächliche Größe in nennenswertem Maße zu verändern. Schließlich kommt ein mathematischer Trick zum Einsatz, bekannt als Divergenzsatz: Die Oberfläche wird in viele kleine Teile zerlegt, von denen jedes wie eine kleine Pyramide mit dem Ursprung als Spitze behandelt wird. Die Summe der vorzeichenbehafteten Volumina all dieser Teile ergibt das Gesamtvolumen des Lebensmittels in Kubikzentimetern, das dann über übliche Dichtetabellen in Gewicht und Kalorien umgerechnet werden kann.

Tests an realen Lebensmitteln und harten Benchmarks

Um die Leistungsfähigkeit von VolE zu prüfen, erstellten die Autorinnen und Autoren ein neues „Foodkit“-Datenset mit 21 realen Lebensmitteln – von Äpfeln und Bananen bis zu Wraps und Gebäck – jeweils mit 700–1200 aufgenommenen Bildern. Sie bestimmten das tatsächliche Volumen mittels Wasserverdrängung und die Masse mit einer Laborwaage und verglichen diese Messwerte mit den Schätzungen von VolE. Über alle Objekte lag der durchschnittliche Volumenfehler bei etwa 1–2 %, entsprechend einer Genauigkeit von ungefähr 99 %, und blieb trotz interner Zufälligkeiten in der Rekonstruktionssoftware bei wiederholten Durchläufen stabil. VolE wurde außerdem auf herausfordernden öffentlichen Datensätzen bewertet, die in internationalen Wettbewerben verwendet werden, und übertraf oder erreichte die Leistung der besten bestehenden Methoden zur Volumenschätzung von Lebensmitteln, ohne Kalibrierungsbretter, Tiefensensoren oder feste Kamerasysteme zu benötigen.

Was das für die alltägliche Gesundheit bedeutet

Einfach ausgedrückt zeigt diese Arbeit, dass ein bereits vorhandenes Smartphone mit den richtigen Algorithmen Ihr Essen fast so gut messen kann wie Laborgeräte. Indem beiläufige Videos in genaue 3D-Modelle verwandelt werden, eliminiert VolE die Notwendigkeit von Waagen, spezialisierten Scannern oder sorgfältig inszenierten Fotos mit Referenzobjekten. Obwohl die Methode derzeit am besten für ein einzelnes Hauptobjekt auf einem Teller funktioniert und noch auf einem leistungsfähigen Computer statt direkt auf dem Telefon läuft, weist sie auf eine nahe Zukunft hin, in der Ernährungs-Apps Portionsgrößen automatisch und verlässlich schätzen können. Das könnte die langfristige Ernährungsüberwachung objektiver, weniger belastend und deutlich zugänglicher für Menschen machen, die ihre Gesundheit im Alltag managen.

Zitation: Haroon, U., AlMughrabi, A., Zoumpekas, T. et al. VolE: A point-cloud framework for food 3D reconstruction and volume estimation. Sci Rep 16, 8648 (2026). https://doi.org/10.1038/s41598-026-38756-5

Schlüsselwörter: Schätzung des Lebensmittelvolumens, 3D-Rekonstruktion, mobile Gesundheit, erweiterte Realität, Ernährungsbewertung