Clear Sky Science · de

Leistungsregelung auf Basis von Machine Learning in zellulären und zellfreien Massive-MIMO-Systemen

Warum diese Forschung für alltägliche Verbindungen wichtig ist

Während unsere Telefone, Tablets und Smart‑Geräte um drahtlose Bandbreite konkurrieren, kämpfen Netzwerke darum, schnellen und verlässlichen Service zu liefern, ohne Energie zu verschwenden. Dieser Beitrag untersucht, wie modernes Machine Learning mobilen Netzwerken helfen kann, in Echtzeit zu entscheiden, wie viel Leistung jede Antenne beim Senden an ein Gerät verwenden sollte. Indem dies intelligenter geschieht als mit den heutigen Standardmethoden, verspricht der Ansatz flüssigere Verbindungen, bessere Abdeckung in überfüllten Bereichen und geringere Verzögerungen—Schlüsseleigenschaften für zukünftige 5G‑ und 6G‑Dienste wie virtuelle Realität, Fernsteuerung von Maschinen und ultra‑zuverlässige, latenzarme Kommunikation.

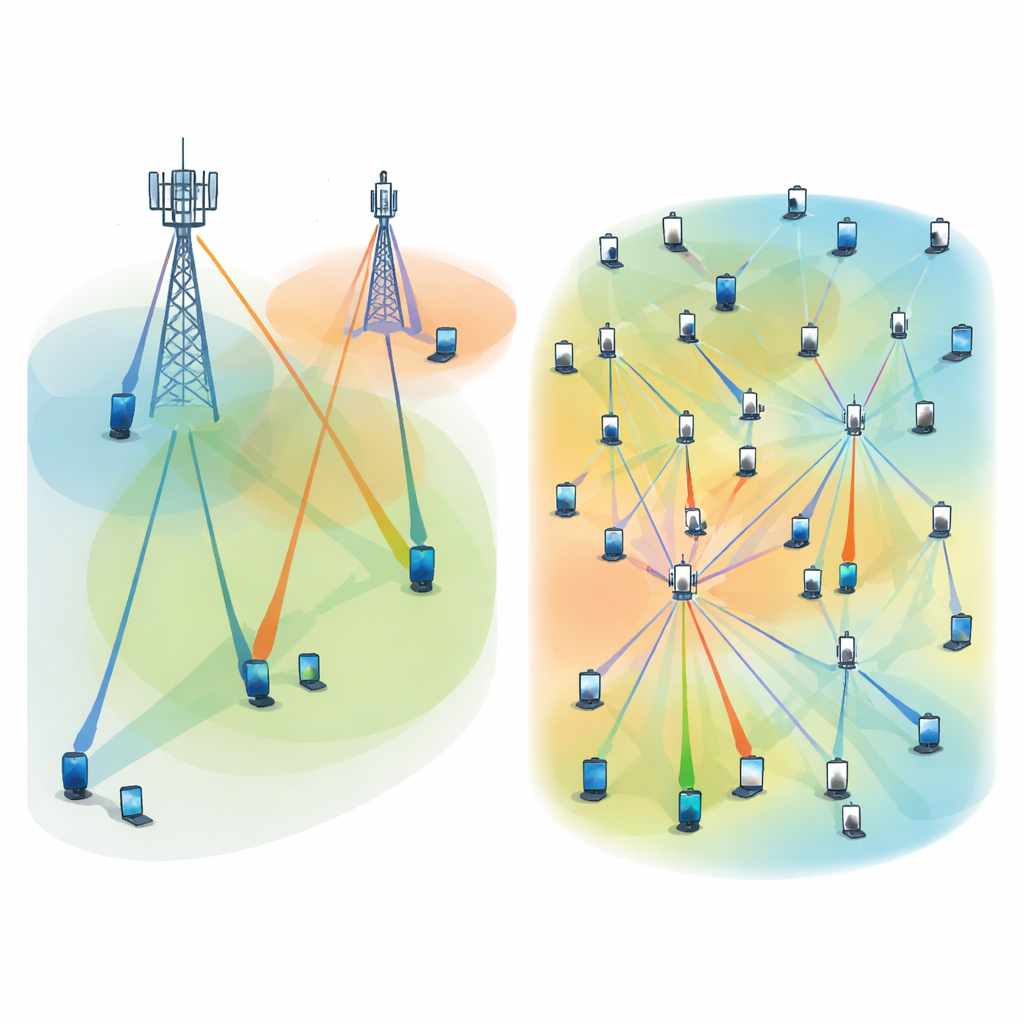

Von großen Türmen zu vielen stillen Helfern

Traditionelle Mobilfunknetze basieren auf großen Basisstationen, die jeweils eine feste „Zelle“ bedienen. Eine neuere Idee, genannt zellfreies Massive MIMO, ersetzt starre Zellgrenzen durch viele kleine Access Points, die über ein Gebiet verteilt sind und zusammenarbeiten. Statt dass ein Nutzer zu einem Turm gehört, kann jede nahe Antenne sein Signal mittragen. Dieser geteilte Ansatz verkürzt die Distanz zwischen Geräten und Antennen und kann Funklöcher reduzieren. Gleichzeitig wird die Koordinierung der Leistungspegel zwischen Dutzenden oder Hunderten von Antennen und Nutzern zu einem komplexen Problem—insbesondere wenn man Interferenz minimieren und dennoch möglichst viel Daten durch die Luft übertragen möchte.

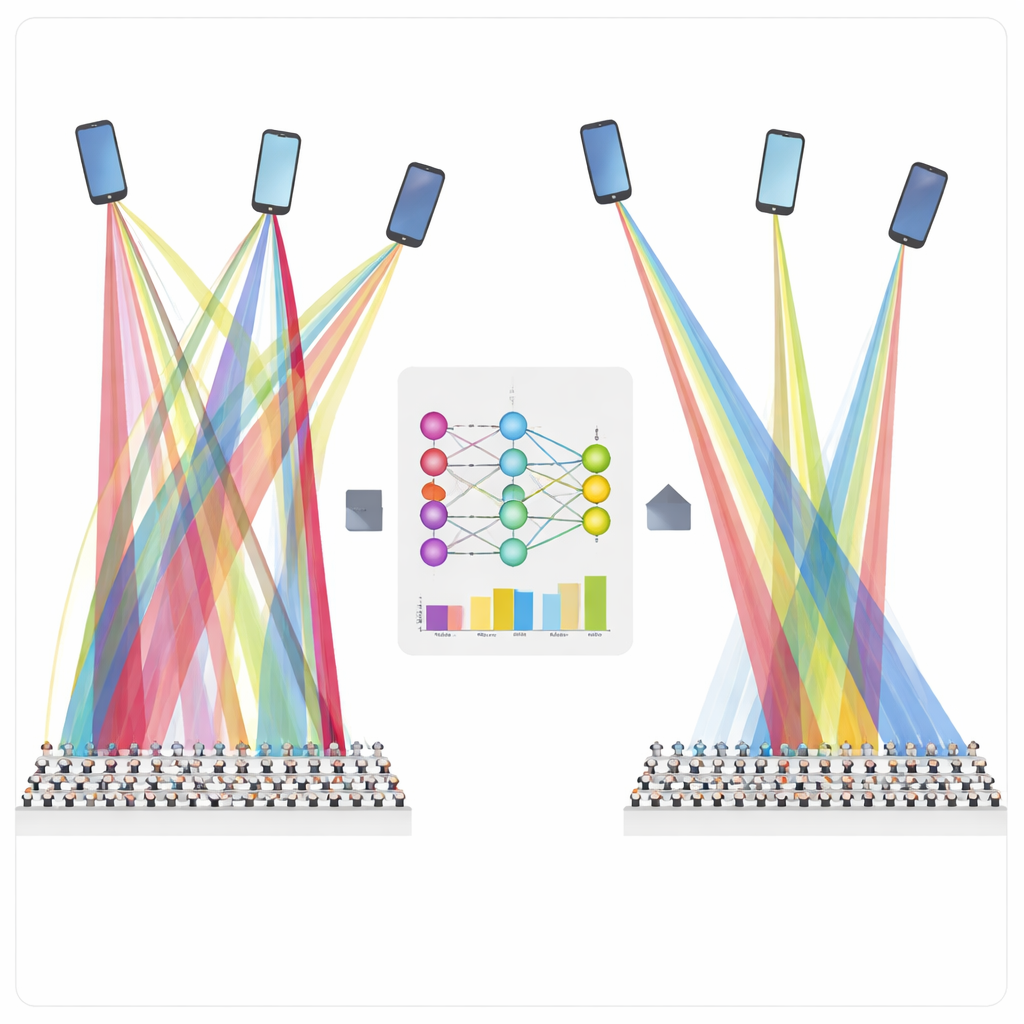

Netze lehren, Leistung intelligent zu verteilen

Ingenieure haben lange auf mathematisch aufwendige Algorithmen gesetzt, wie etwa die Methode WMMSE, um zu bestimmen, wie viel Leistung jede Antenne nutzen sollte. Diese Methoden sind genau, aber langsam und ressourcenintensiv, weshalb sie sich schwer in Echtzeit für große, dichte Netze anwenden lassen. Die Autoren trainieren stattdessen tiefe neuronale Netze, um diese sorgfältige Leistungsanpassung nachzuahmen—und in manchen Fällen zu verbessern. Sie erzeugen große simulierte Datensätze, die viele Kombinationen von Nutzerpositionen, Antennenanordnungen und Kanalbedingungen abbilden, und bringen dem neuronalen Netz bei, gute Leistungseinstellungen direkt aus den Informationen über den Funkkanal vorherzusagen.

Eine neue Sicht auf Fairness und Leistung

Anstatt nur die gesamte Datenrate des Netzes zu betrachten, bewertet die Studie, wie gut einzelne Nutzer jeweils abschneiden. Die Autoren führen eine kompakte Kennzahl namens „ΔAUC“ ein, die die Fläche zwischen zwei Kurven misst, welche beschreiben, wie die Datenraten der Nutzer verteilt sind—eine Kurve für das neuronale Netz und eine für die traditionelle Methode. Ein positives ΔAUC bedeutet, dass der lernbasierte Ansatz über die gesamte Nutzerpopulation hinweg mindestens genauso gute und oft leicht bessere Datenraten liefert. Diese distributionsbewusste Sichtweise zeigt nicht nur durchschnittliche Gewinne, sondern auch Fairness: ob das System viele Nutzer gut bedient statt nur einige wenige Glückliche.

Was passiert, wenn Netze wachsen

Das Team variiert systematisch drei Schlüsselfaktoren: die Anzahl der Nutzer, die Anzahl der Antennen pro Access Point oder Basisstation und die Anzahl der Access Points selbst. Sie testen sowohl konventionelle zellulare Layouts als auch zellfreie Layouts und verändern außerdem, wie viele simulierte Beispiele zum Trainieren des neuronalen Netzes verwendet werden. Ihre Ergebnisse zeigen, dass die einfache Hinzufügung weiterer Nutzer wenig Einfluss auf die Genauigkeit des Netzes hat, während zusätzliche Antennen und Access Points klar helfen. Wenn die physische Infrastruktur dichter wird, werden die Eingabedaten für das neuronale Netz reichhaltiger, sodass es die traditionelle Methode besser nachbilden oder übertreffen kann. Größere Trainingsdatensätze schärfen die Vorhersagen weiter, wobei die Verbesserungen abflachen, sobald genügend Beispiele gesehen wurden. In vielen Szenarien steigert der neuronale Ansatz die Gesamt‑Datenraten um mehrere Prozent bei gleichbleibendem Verhalten für einzelne Nutzer.

Entscheidungen beschleunigen für die nächste Generation drahtloser Netze

Ein entscheidender Vorteil des neuronalen Netzes ist die Geschwindigkeit. Sobald es trainiert ist, kann es gute Leistungseinstellungen in einem Bruchteil der Zeit liefern, die der iterative traditionelle Algorithmus benötigt—in den durchgeführten Tests mehr als zehnmal so schnell. Das macht es deutlich besser geeignet für Anwendungen, die keine Verzögerungen tolerieren, etwa industrielle Steuerung, Fahrzeugkoordination oder missionskritische Kommunikation. Indem die Studie ihre neue fairness‑orientierte Kennzahl mit Fehlermaßen, Datenratenvergleichen und Zeitanalysen kombiniert, bietet sie praktische Hinweise dazu, wie dicht die Infrastruktur sein sollte und wie viele Trainingsdaten nötig sind, um sich sicher auf Machine Learning für die Leistungsregelung verlassen zu können.

Was das für zukünftige drahtlose Systeme bedeutet

Die zentrale Erkenntnis ist, dass sorgfältig gestaltete tiefe neuronale Netze klassische, rechenintensive Optimierungsroutinen in modernen drahtlosen Netzen ersetzen und in manchen Fällen verbessern können. Sie bieten leicht höhere Datenraten, eine fairere Verteilung des Service und erheblich schnellere Entscheidungen—insbesondere wenn viele Antennen und Access Points verfügbar sind. Das ebnet den Weg für intelligentere, reaktionsschnellere 5G‑ und 6G‑Systeme, in denen lernbasierte Steuerungen im Hintergrund die Leistung regeln und unseren Alltagsgeräten helfen, mit weniger Verzögerung und größerer Robustheit verbunden zu bleiben.

Zitation: Ahmadi, N., Akbarizadeh, G. Machine learning based power control in cellular and cell-free massive MIMO systems. Sci Rep 16, 8129 (2026). https://doi.org/10.1038/s41598-026-38685-3

Schlüsselwörter: massive MIMO, Leistungsregelung, cell-free Netzwerke, Deep Learning, 5G und 6G