Clear Sky Science · de

Auf aufmerksamer Vorhersage basierende Arbeitslastprognose und dynamische Ressourcenverteilung für heterogene Rechenumgebungen

Warum klügere Computer für alle wichtig sind

Hinter jedem Film, den Sie streamen, jeder Karte, die Sie öffnen, oder jedem KI-Assistenten, mit dem Sie sprechen, arbeiten riesige Rechenzentren leise rund um die Uhr. Mit zunehmender Leistungsfähigkeit der künstlichen Intelligenz werden diese Zentren an ihre Grenzen gebracht: Sie müssen viele Arten von Aufgaben auf vielen Arten von Geräten gleichzeitig bewältigen und dabei Kosten, Geschwindigkeit und Energieverbrauch unter Kontrolle halten. Dieses Papier stellt einen neuen Ansatz vor, um vorherzusagen, was diese Computer in naher Zukunft benötigen, und um Arbeit über verschiedene Hardwaretypen zu verteilen, damit Dienste schnell und zuverlässig bleiben und gleichzeitig weniger Strom verschwendet wird.

Viele Aufgaben, viele Maschinen

Moderne Rechenzentren verlassen sich nicht mehr auf einen einzigen Servertyp. Stattdessen kombinieren sie traditionelle Prozessoren mit leistungsfähigen Grafikchips, spezialisierten KI-Karten und rekonfigurierbaren Schaltungen. Verschiedene KI-Aufgaben — etwa das Trainieren großer Sprachmodelle, das Bereitstellen von Echtzeit-Empfehlungen oder die Bildanalyse — passen sehr unterschiedlich zu diesen Maschinen. Heute weisen Betreiber Ressourcen oft mit festen Regeln oder einfachen Prognosen basierend auf dem gestrigen Verbrauch zu. Wenn die Nachfrage plötzlich ansteigt, kann das zu langsamen Reaktionen oder gebrochenen Servicevereinbarungen führen; wenn die Nachfrage sinkt, steht teure Hardware untätig, verbraucht Energie und leistet wenig Arbeit.

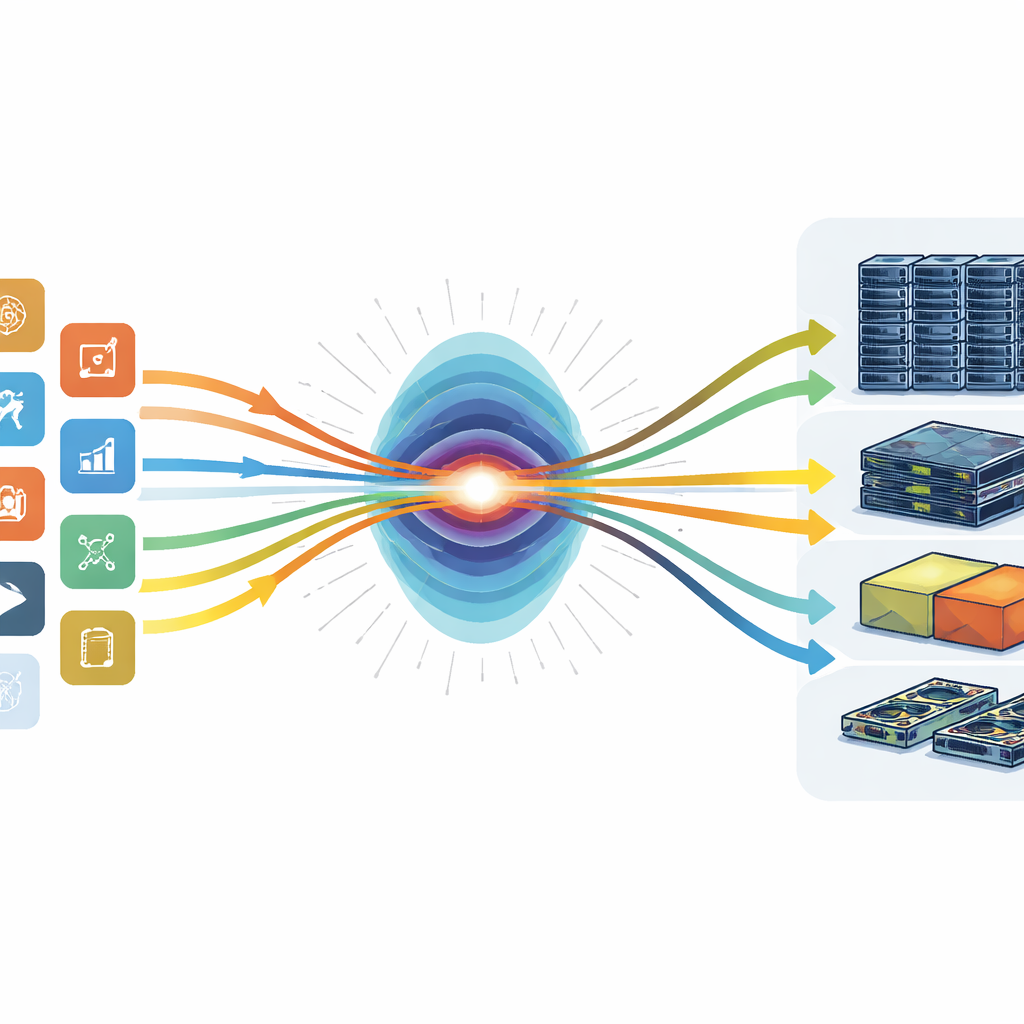

Lernen, dorthin zu schauen, wo es zählt

Die Autoren entlehnen ein Konzept aus modernen KI-Modellen, genannt „Attention“ (Aufmerksamkeit), und übertragen es auf die Verwaltung von Rechenzentren. Anstatt alle Verlaufsdaten gleich zu behandeln, lernt ihr System, welche Zeitpunkte und welche Aufgabentypen am hilfreichsten sind, um das nächste Geschehen vorherzusagen. Ein Teil des Modells konzentriert sich darauf, wie sich jede Arbeitslast — etwa ein Trainingsjob oder ein Onlinedienst — im Zeitverlauf verändert. Ein anderer Blick schaut quer über verschiedene gleichzeitig laufende Arbeitslasten, um verborgene Zusammenhänge zu entdecken, etwa ein Muster, bei dem das Beenden einer Reihe von Trainingsjobs oft zu einem Anstieg verwandter Online-Anfragen führt. Durch die Kombination dieser beiden Perspektiven kann das System zukünftige Anforderungen an Prozessoren, Speicher und Beschleuniger genauer vorhersagen als frühere Methoden.

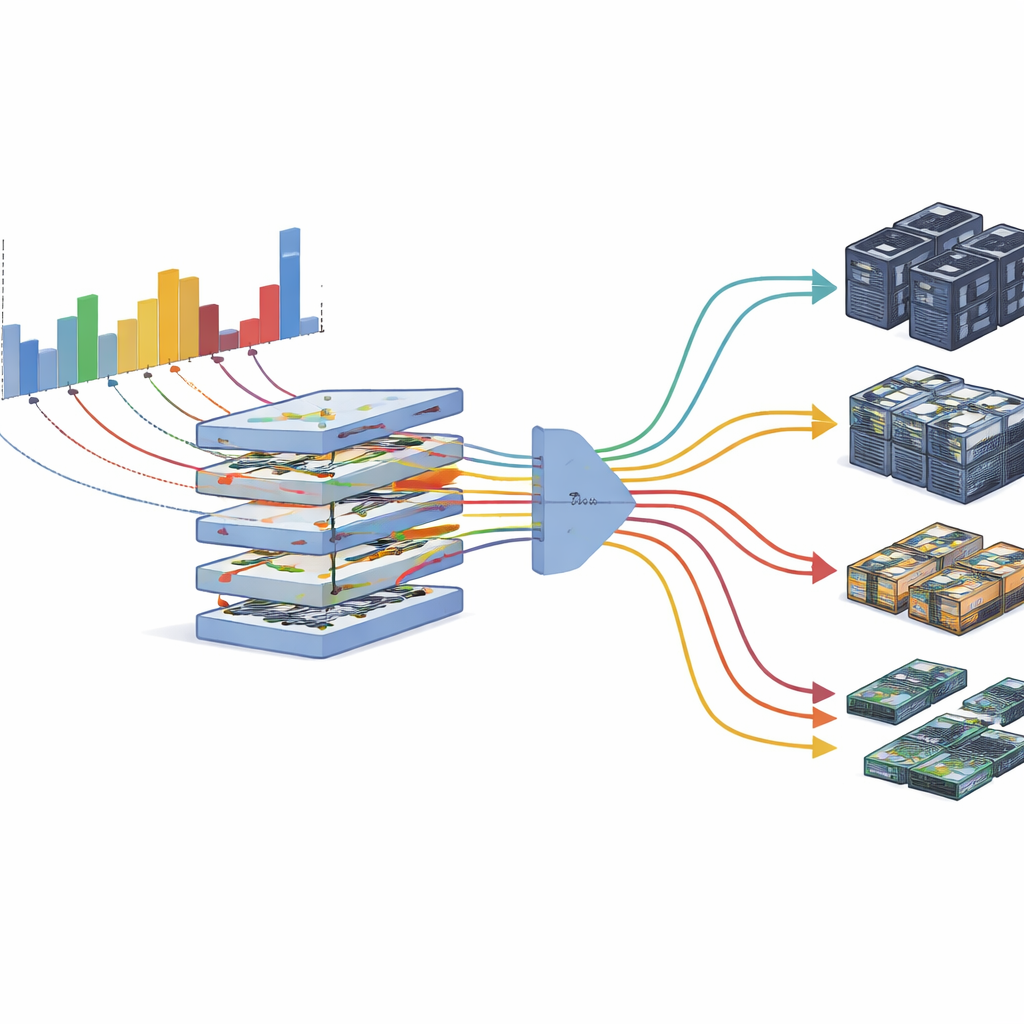

Vorhersagen in bessere Entscheidungen verwandeln

Vorhersagen allein reichen nicht; das Rechenzentrum muss darauf reagieren. Die zweite Hälfte des Frameworks verwandelt diese Prognosen in konkrete Entscheidungen darüber, wo welcher Job ausgeführt werden soll. Die Autoren behandeln dies als Ausgleichsakt zwischen drei Zielen: Jobs schnell zu beenden, möglichst wenig Energie zu verbrauchen und Maschinen ausgelastet statt untätig zu halten. Ihr Scheduler modelliert das Rechenzentrum als Netzwerk unterschiedlicher Geräte und verwendet ein Optimierungsverfahren, um Platzierungen zu wählen, die diese Ziele je nach Betreiberpräferenz abwägen. Da Prognosen nie perfekt sind, schätzt das System auch seine eigene Unsicherheit ein und lässt bei Bedarf Sicherheitsmargen, überwacht dann die Realität in Echtzeit und passt an, indem es niedrigprioritäre Arbeiten pausiert oder Jobs verschiebt, wenn die Nutzung von den Erwartungen abweicht.

Das System im Praxistest

Um zu prüfen, wie dieser Ansatz in der Praxis funktioniert, bauten die Forschenden einen Testcluster mit einer realistischen Mischung aus Prozessoren, GPUs und spezialisierter KI-Hardware und speisten ihn mit detaillierten Aktivitätsaufzeichnungen aus realen Rechenzentren bei Google, Alibaba und einem akademischen Labor. Sie verglichen ihre Methode mit gängigen Prognosewerkzeugen und Planungsstrategien, einschließlich Techniken, die in Produktivsystemen verwendet werden, sowie mit kontrollierenden Verfahren auf Basis von Reinforcement Learning. Der aufmerksamkeitsbasierte Prädiktor lieferte durchweg genauere Vorhersagen, insbesondere bei den scharfen Einbrüchen und Spitzen, die in KI-Arbeitslasten häufig auftreten. In Kombination mit ihrem dynamischen Zuteiler erhöhte das System die Gesamtgerätenutzung auf etwa vier Fünftel der Kapazität, verkürzte die durchschnittliche Jobabschlusszeit um etwa ein Viertel und senkte den Energieverbrauch um rund 15 Prozent, während Serviceverletzungen auf einem sehr niedrigen Niveau blieben.

Was das für alle Nutzer bedeutet

Für Nicht-Fachleute lautet die Kernbotschaft: Eine intelligentere Koordination innerhalb von Rechenzentren kann KI-Dienste schneller, günstiger und umweltfreundlicher machen, ohne neue Chips oder Gebäude zu benötigen. Indem das Framework lernt, wo es in der Flut von Nutzungsdaten „Aufmerksamkeit“ richten muss, hilft es vorhandener Hardware, nützlicher zu arbeiten und seltener untätig zu sein. Das bedeutet, Unternehmen können reaktionsschnellere Apps und leistungsfähigere KI-Tools liefern und gleichzeitig Stromkosten und CO2-Fußabdruck reduzieren. Wenn sich ähnliche Prognose- und Zuteilungssysteme verbreiten und ausreifen, könnte die unsichtbare Infrastruktur des Internets nicht nur leistungsfähiger, sondern auch nachhaltiger werden.

Zitation: Shao, S., Ding, X., Zhao, B. et al. Attention-based workload prediction and dynamic resource allocation for heterogeneous computing environments. Sci Rep 16, 8571 (2026). https://doi.org/10.1038/s41598-026-38622-4

Schlüsselwörter: Rechenzentrum-Planung, KI-Arbeitslastvorhersage, heterogenes Rechnen, energieeffizientes Rechnen, Ressourcenzuweisung