Clear Sky Science · de

Engere Datenschutzprüfung von differentially private stochastic gradient descent im Hidden-State-Bedrohungsmodell

Warum das für alltägliche Technik wichtig ist

Moderne Apps lernen ständig aus unseren Daten, von Fotos und Nachrichten bis zu medizinischen Unterlagen. Eine führende Methode, um dieses Training sicher zu machen, heißt differentielle Privatsphäre: Dabei wird gezielt Rauschen hinzugefügt, sodass die Daten einer einzelnen Person nicht hervorgehoben werden. Aber woran erkennt man, dass diese Schutzmaßnahmen in der Praxis wirklich wirken, vor allem bei den heute verwendeten tiefen neuronalen Netzen? Diese Arbeit untersucht diese Frage und zeigt, wann das Verbergen des „Trainingsfilms“ eines Modells der Privatsphäre tatsächlich hilft — und wann nicht.

Wie privates Lernen funktionieren soll

Differentially private stochastic gradient descent (DP-SGD) ist der Standardalgorithmus für datenschutzfreundliches maschinelles Lernen. Er trainiert Modelle schrittweise auf kleinen Datenbatches, schneidet (clippt) den Gradienten jedes Schritts ab und fügt vor dem Aktualisieren des Modells zufälliges Rauschen hinzu. Die Theorie liefert obere Schranken dafür, wie stark die Daten einer einzelnen Person das Endmodell beeinflussen können, zusammengefasst durch eine Datenschutzgröße, die oft Epsilon genannt wird. Parallel dazu versucht die „Datenschutzprüfung“ (privacy auditing), das trainierte Modell anzugreifen und herauszufinden, welche Informationen sich praktisch extrahieren lassen. Stimmen Theorie und Prüfungen überein, kann man der Datenschutzbilanz vertrauen; wenn nicht, wird etwas Wichtiges übersehen.

Was sich ändert, wenn nur das finale Modell veröffentlicht wird

Die meisten früheren Prüfungen gingen von einem starken Angreifer aus, der jeden Zwischencheckpoint des Modells während des Trainings sehen kann. In der Praxis geben viele Organisationen aber nur das finale Modell frei, nicht die gesamte Trainingshistorie. Diese realistischere Annahme nennt man das Hidden-State-Bedrohungsmodell. Neuere theoretische Arbeiten legten nahe, dass zumindest bei einfachen konvexen Problemen das Verbergen von Zwischenmodellen die Privatsphäre über die Zeit verstärken könnte: Daten, die früh im Training verwendet werden, werden durch spätere, verrauschte Updates „ausgewaschen“. Moderne Deep-Learning-Modelle sind jedoch stark nicht-konvex, mit einer rauen und komplexen Verlustlandschaft. Es war unklar, ob dieselbe Verstärkung dort wirklich stattfindet — oder ob frühere Angriffe einfach zu schwach waren, um den tatsächlichen Datenschutzverlust aufzudecken.

Eine neue Methode, mit der Angreifer das Modell beeinflussen

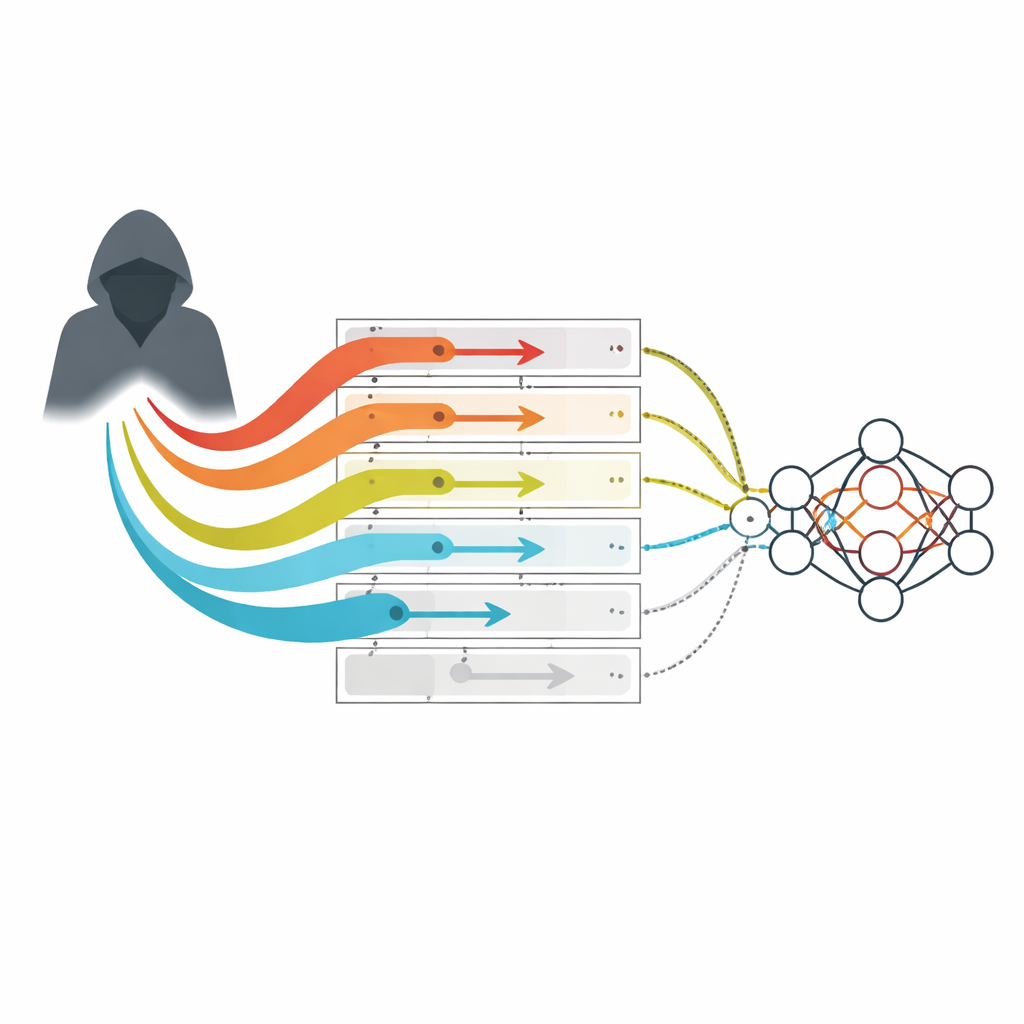

Der Autor stellt eine neue Familie von „Gradient-Crafting“-Angreifern vor, die speziell auf das Hidden-State-Modell zugeschnitten ist. Anstatt einen speziellen Datenpunkt zu entwerfen und dann zu beobachten, wie sich dessen Verlust während des Trainings verändert (wie bei traditionellen verlustbasierten Angriffen), geben diese Angreifer direkt die Sequenz von Gradienten vor, die angewendet würden, wenn ein worst-case-Datenpunkt vorhanden wäre. Sie wählen Gradienten, die immer die Clipping-Schwelle erreichen und sich an selten genutzten Parameter-Richtungen ausrichten, wodurch ihr Einfluss leichter nachzuweisen ist, selbst ohne Zwischenmodelle zu sehen. Untersucht werden zwei einfache Varianten: eine, die zufällig eine Parameter-Richtung auswählt, und eine andere, die das Training simuliert, um die am wenigsten aktualisierte Richtung zu finden, bevor starke, wiederholte Gradienten in dieser Richtung injiziert werden.

Was die Experimente über echtes Privatsphärenrisiko zeigen

Mithilfe dieses Rahmens prüft die Arbeit DP-SGD an Bild- und Tabellendatensätzen mit gängigen Architekturen wie Faltungs- und ResNet-Netzen sowie einem kleinen vollständig verbundenen Modell. Wird der konstruierte Gradient in jedem Trainingsschritt verwendet, erreichen die neuen Angreifer die strengen theoretischen Datenschutzgrenzen — obwohl sie nur das finale Modell sehen. Das bedeutet, dass in diesem Extremfall das Verbergen von Zwischencheckpoints keinerlei zusätzliche Privatsphäre bietet. Wird der konstruierte Gradient seltener eingefügt, ändert sich das Bild: Bei großen Batches im Verhältnis zur Rauschstärke bleiben die Prüfungen nahe an der Theorie (was erneut auf geringe tatsächliche Verstärkung hindeutet), aber bei kleineren Batches und stärkerem Rauschen entsteht eine Lücke, die auf eine echte, wenn auch bescheidene, Privatsphärenverstärkung in nicht-konvexen Einstellungen hindeutet.

Ein Blick in das Worst-Case-Limit

Um die absoluten Grenzen der Privatsphäre im Hidden-State-Modell zu verstehen, untersucht die Arbeit auch einen extremeren theoretischen Angreifer, der nicht nur Gradienten konstruiert, sondern eine gesamte Verlustlandschaft so entwirft, dass der Einfluss eines speziellen Datenpunkts über Iterationen hinweg erhalten bleibt. In diesem kontrollierten Setting trennen die Ergebnisse zwei Regime klar: Bei großen Batch-Größen ist die datenschutztheoretische Bilanz im Wesentlichen straff, während bei kleinen Batches und erheblichem Rauschen frühe Informationen über einen Datenpunkt im Laufe der Zeit teilweise vergessen werden. Entscheidend ist, dass diese Verstärkung schwächer ist als das, was für einfache konvexe Probleme bekannt ist, und das Privatsphärenrisiko nie vollständig auslöscht.

Was das für Nutzer und Praktiker bedeutet

Für Nicht-Experten lautet die Schlussfolgerung: Allein das Verbergen der Trainingshistorie eines Deep-Learning-Modells garantiert nicht automatisch erheblich stärkeren Datenschutz. Wenn die Daten einer Person sehr häufig im Training verwendet werden, entspricht ihr Risiko weitgehend den konservativen Vorhersagen der heutigen Theorie. In günstigeren Szenarien — kleine Batches mit erheblichem Rauschen — entsteht zwar zusätzlicher Schutz, er ist jedoch moderat und reduziert das Risiko nicht auf null. Diese Ergebnisse bestätigen Teile der bestehenden Datenschutzbilanz und machen zugleich ihre Grenzen deutlich, wodurch ein klareres, realistischeres Bild davon entsteht, wie viel Schutz DP-SGD bieten kann, wenn nur das finale Modell geteilt wird.

Zitation: Bhuekar, A. Tighter privacy auditing of differentially private stochastic gradient descent in the hidden state threat model. Sci Rep 16, 8365 (2026). https://doi.org/10.1038/s41598-026-38537-0

Schlüsselwörter: differenzielle Privatsphäre, DP-SGD, Datenschutzprüfung, Sicherheit im maschinellen Lernen, Hidden-State-Modell