Clear Sky Science · de

Ein wavelet-basierter Frequenzbereichsansatz für präzise Mehrfrucht-Krankheitserkennung

Klügere Augen für die Pflanzenvitalität

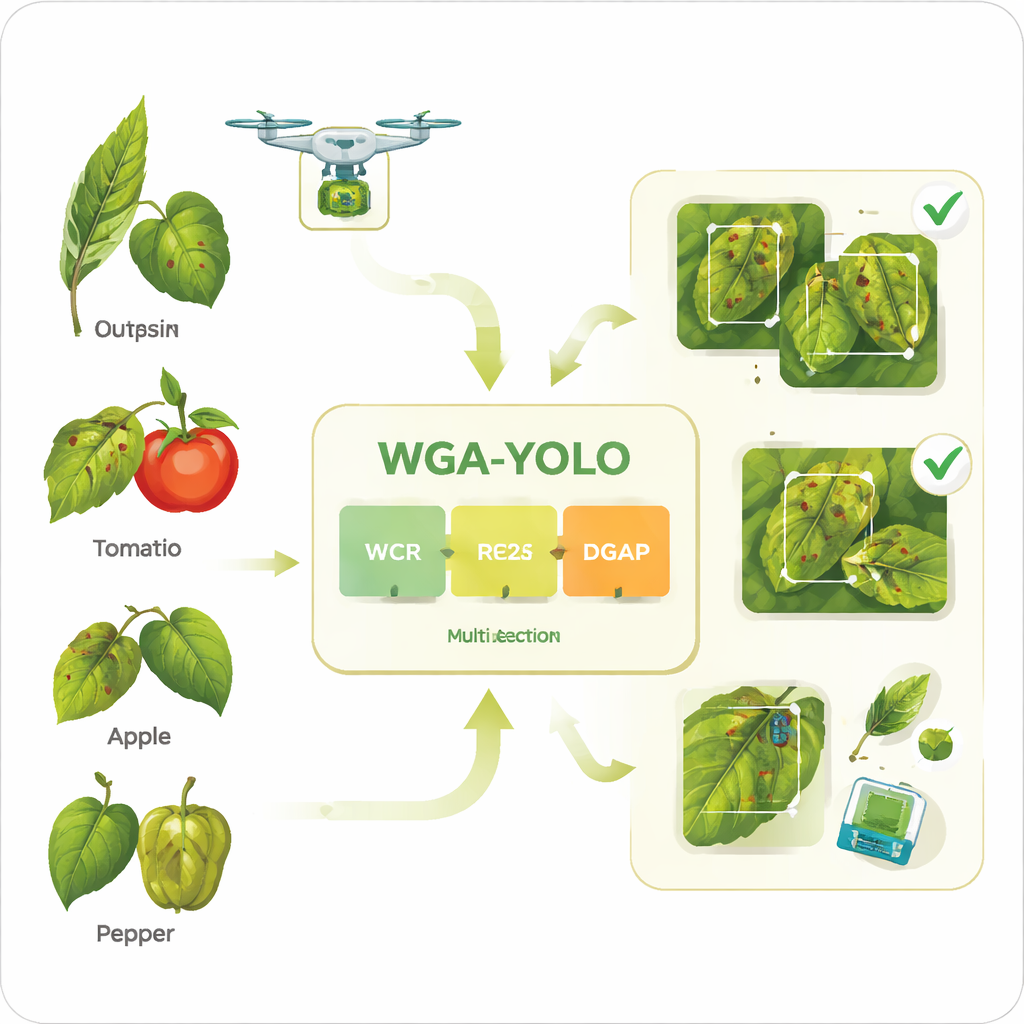

Bauern und Forschende verlassen sich zunehmend auf Kameras und Drohnen, um Pflanzenerkrankungen frühzeitig zu erkennen, bevor sie sich ausbreiten und Ernten vernichten. In echten Feldern ist die Situation jedoch unordentlich: Blätter überlappen, das Sonnenlicht ändert sich sekündlich, und viele Krankheitsflecken sind winzig und leicht mit der normalen Blattstruktur zu verwechseln. Dieses Paper stellt WGA‑YOLO vor, ein kompaktes KI‑System, das darauf ausgelegt ist, erkrankte Bereiche vieler verschiedener Nutzpflanzen schnell und genau zu finden — selbst unter solchen herausfordernden Bedingungen.

Warum das Finden von Blattflecken so schwer ist

Auf den ersten Blick scheint es einfach, ein krankes Blatt auf einem Foto zu erkennen. In der Praxis ist es das keineswegs. In echten Feldern können Krankheitsherde sehr klein, unregelmäßig geformt und über die Blätter verstreut sein. Farbe und Textur ähneln oft natürlichen Mustern wie Blattadern oder Sprenkeln. Die Beleuchtung kann hart, schwach oder durch Schatten fleckig sein. Traditionelle maschinelle Lernsysteme beruhen auf handgefertigten visuellen Merkmalen und versagen häufig, wenn der Hintergrund unruhig wird oder sich die Beleuchtung ändert. Neuere Deep‑Learning‑Systeme, wie Standard‑YOLO‑Modelle, sind zwar leistungsfähiger, übersehen aber immer noch winzige Herde oder benötigen hohe Rechenleistung, die für kostengünstige Geräte auf dem Feld unpraktisch ist.

Das Sichtfeld für Pflanzenerkrankungen säubern

Für das Training und die Evaluation eines Detektionssystems ist ein verlässlicher Datensatz unerlässlich. Die Autor:innen begannen damit, eine weit verbreitete öffentliche Sammlung von Pflanzenbildern namens PlantDoc erneut zu überprüfen. Sie entdeckten viele Probleme, die ein KI‑Modell in die Irre führen könnten: fehlende oder inkonsistente Beschriftungen, Zeichnungen statt echter Fotos sowie Bilder mit Wasserzeichen oder handschriftlichen Notizen. Diese Proben wurden sorgfältig nachgeprüft, korrigiert und problematische Beispiele entfernt; zusätzlich erweiterten die Autor:innen den Datensatz mit neuen, klar dokumentierten Bildern aus öffentlichen Quellen. Das Ergebnis, PlantDoc_boost, umfasst 13 gängige Kulturpflanzen und 17 Krankheitstypen, mit realistischen Außenszenen und vielen kleinen befallenen Bereichen. Dieser sauberere, reichhaltigere Datensatz spiegelt besser wider, was eine Kamera tatsächlich im Feld „sieht“, und ermöglicht es, zu testen, ob ein Modell über Laborbedingungen hinaus generalisiert.

Wie das neue Modell innen aussieht

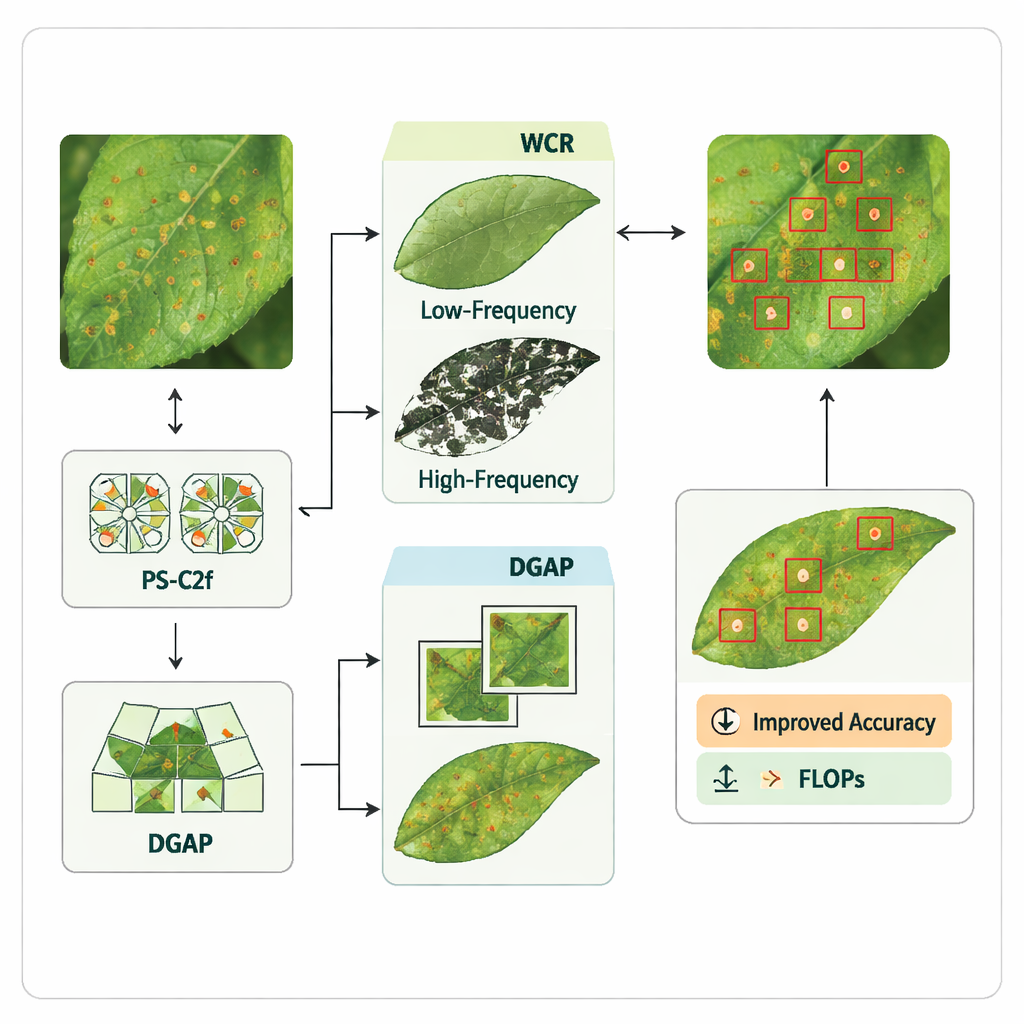

WGA‑YOLO baut auf YOLOv8n auf, einem beliebten Ein‑Stufen‑Objektdetektor, der für seine Geschwindigkeit bekannt ist. Die Autor:innen gestalteten zentrale Teile des Netzes neu, um feine Details zu bewahren und es zugleich leichtgewichtig zu halten. Zunächst ersetzen sie einige Standard‑Downsampling‑Schritte durch ein Modul namens Wavelet Channel Recalibration (WCR). Anstatt Merkmale einfach zu verkleinern und damit Informationen zu verlieren, führt WCR eine Wavelet‑Transformation durch, die Features in glatte, niederfrequente Anteile sowie in scharfe, hochfrequente Kanten und Texturen aufteilt. Durch wohlüberlegte Neukombination dieser Anteile behält das Netzwerk sowohl die Gesamtform der Blätter als auch die winzigen Flecken, die auf Krankheiten hinweisen — und das mit sehr geringem Mehraufwand an Berechnung.

Winzige Herde auf vielen Skalen genauer betrachten

Kleine Herde werden besonders leicht übersehen, daher führen die Autor:innen einen maßgeschneiderten Baustein namens PS‑C2f ein. Er nutzt „Pinwheel‑förmige“ Filter, die in mehrere Richtungen um jeden Punkt schauen und das Modell empfindlicher für subtile Veränderungen in Form und Textur machen, die die Begrenzungen von Herden markieren. Ein weiterer neuer Baustein, DGAP (Dynamic Group Attention Pooling), hilft dem Netzwerk, Informationen aus verschiedenen Skalen zu kombinieren — von kleinen Punkten bis hin zu nahezu blattgroßen Regionen. Indem DGAP lernt, wie viel Gewicht lokalen, mittelgroßen und globalen Blicken beigemessen werden soll, fördert es, dass das Modell wirklich wichtige Herdbereiche hervorhebt und verwirrende Hintergrundmuster wie Adern oder Bodentexturen herunterstuft.

Wie gut es in der Praxis funktioniert

Getestet auf dem PlantDoc_boost‑Datensatz erkennt WGA‑YOLO befallene Bereiche genauer als mehrere bekannte Alternativen, darunter Faster R‑CNN und verschiedene Versionen von YOLO, wobei es weniger Parameter verwendet und leicht weniger Rechenaufwand benötigt als der Ausgangspunkt YOLOv8n. Es zeigt auch starke Leistungen auf mehreren externen Datensätzen zu Mais‑, Tomaten‑ und Apfelkrankheiten, die einfachere Szenen, aber viele Bilder und Krankheitstypen abdecken. Über diese Tests hinweg fokussiert WGA‑YOLO besser auf tatsächliche Herdbereiche und lässt sich seltener von ablenkenden Texturen oder Beleuchtungsunterschieden täuschen. Diese Kombination aus Genauigkeit und Effizienz legt nahe, dass das Modell auf bescheidener Hardware laufen könnte, etwa auf Edge‑Geräten an Drohnen oder Feldrobotern, und nahezu in Echtzeit Orientierung liefern kann.

Was das für Landwirt:innen bedeutet

Einfach gesagt liefert diese Arbeit ein schärferes und effizienteres digitales „Auge“ für Kulturen. Durch das Bereinigen der Trainingsdaten und die Neuentwicklung der Art und Weise, wie das KI‑Modell mit feinen Details und Skalen umgeht, haben die Autor:innen einen Detektor geschaffen, der mehr Krankheiten erkennt, ohne sperrige Rechner zu verlangen. Das könnte Landwirt:innen helfen, Probleme früher zu erkennen, den Pflanzenschutz gezielter einzusetzen und sowohl Kosten als auch Umweltbelastung zu reduzieren. Zwar sind noch Feinabstimmungen für sehr frühe, subtile Infektionen und für den Einsatz auf den kleinsten Geräten nötig, doch WGA‑YOLO stellt einen bedeutenden Schritt in Richtung praktischer, feldtauglicher Krankheitsüberwachung für zahlreiche Kulturen dar.

Zitation: Zhao, J., Liang, Y., Wei, G. et al. A wavelet-based frequency-domain approach for accurate multi-crop disease detection. Sci Rep 16, 7099 (2026). https://doi.org/10.1038/s41598-026-38476-w

Schlüsselwörter: Erkennung von Pflanzenkrankheiten, präzise Landwirtschaft, Computer Vision, YOLO, Überwachung der Pflanzenvitalität