Clear Sky Science · de

Ein verbessertes YOLOv11-Netzwerk zur Erkennung von Meeresmüll in Unterwasserumgebungen

Warum es wichtig ist, Müll unter Wasser zu erkennen

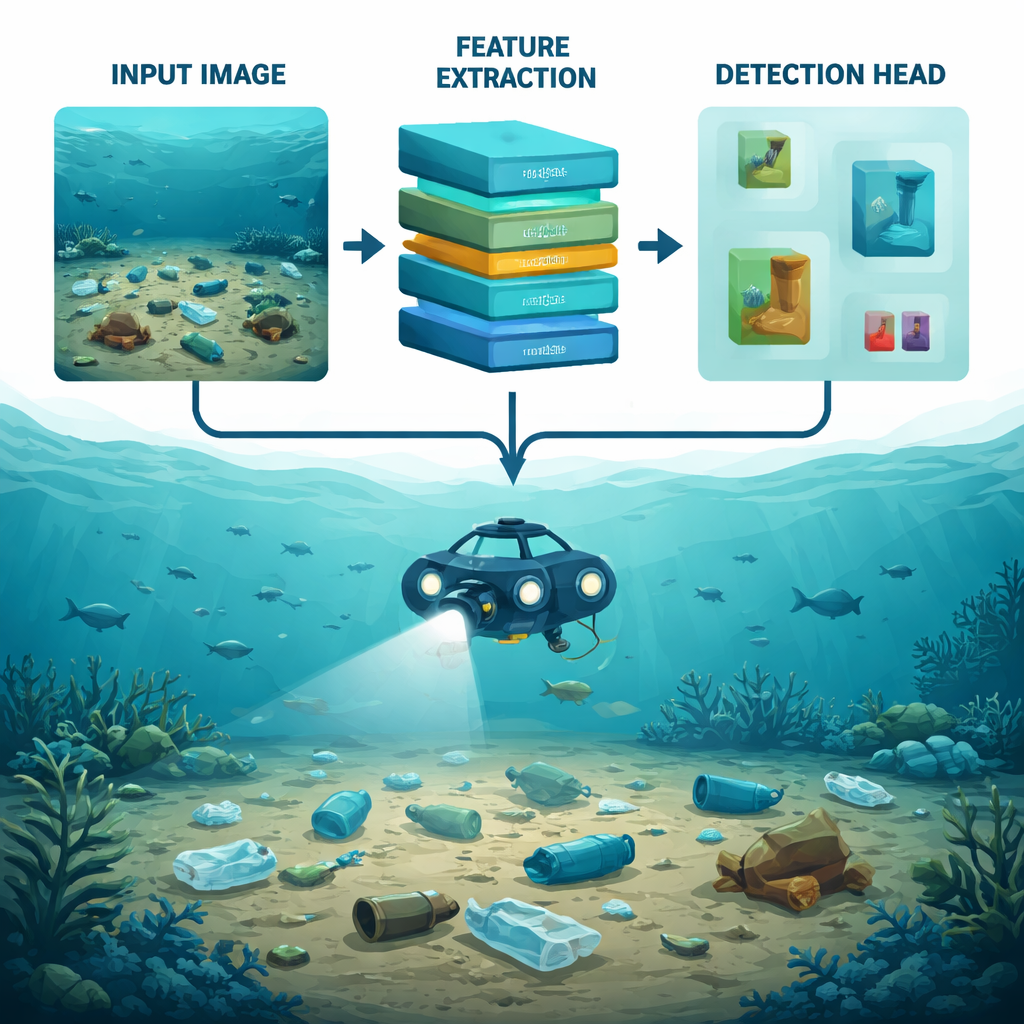

Tief unter der Meeresoberfläche sammeln sich unauffällig Plastiktüten, Flaschen, Angelschnüre und anderes Treibgut an. Dieser Abfall schadet dem Meeresleben, verstopft empfindliche Lebensräume und kann sogar Unterwasserrobotern im Weg sein, die Forschende einsetzen, um das Meer zu untersuchen und zu schützen. Die hier zusammengefasste Arbeit beschreibt ein intelligenteres Computer-Vision-System, das Kameras und Roboter dabei unterstützt, Unterwassermüll in Echtzeit automatisch zu finden und zu kennzeichnen — selbst in trübem, unübersichtlichem Wasser.

Die Herausforderung, unter Wasser klar zu sehen

Im Gegensatz zu klaren Tageslichtaufnahmen an Land sind Unterwasserbilder oft dunkel, verschleiert und blau- oder grünlich getönt. Licht nimmt mit der Tiefe schnell ab, Sand und Plankton trüben das Wasser, und Müllstücke sind häufig klein, teilweise verdeckt oder ähneln Steinen und Pflanzen. Klassische Bildverarbeitungsmethoden stoßen unter diesen Bedingungen an ihre Grenzen, und selbst moderne Deep-Learning-Detektoren können winzige Objekte übersehen oder Hintergrundstruktur mit Müll verwechseln. Gleichzeitig sind genaue und schnelle Erkennung essenziell, um Verschmutzungs-Karten zu erstellen, Aufklärungsroboter zu steuern und Veränderungen des Meeresmülls über die Zeit zu verfolgen.

Aufbauend auf einem schnellen Vision-Arbeitspferd

Die Autoren bauen auf YOLOv11 auf, einem neueren Mitglied der „You Only Look Once“-Familie von Objektdetektoren. YOLO-Modelle sind beliebt, weil sie ein Bild einmal scannen und in Echtzeit die Positionen und Typen vieler Objekte vorhersagen. Das Standarddesign von YOLOv11 wurde jedoch für gewöhnlichere Szenen wie Straßen oder Innenräume entwickelt, nicht für die visuellen Extrembedingungen unter Wasser. Um diese Lücke zu schließen, überarbeiten die Forschenden zwei zentrale Teile des Netzwerks: wie es zunächst visuelle Muster aus einem Bild extrahiert und wie es später entscheidet, welche Bereiche wichtige Müllobjekte und welche nur störender Hintergrund sind.

Eine neue Methode, Details in vielen Größen zu erfassen

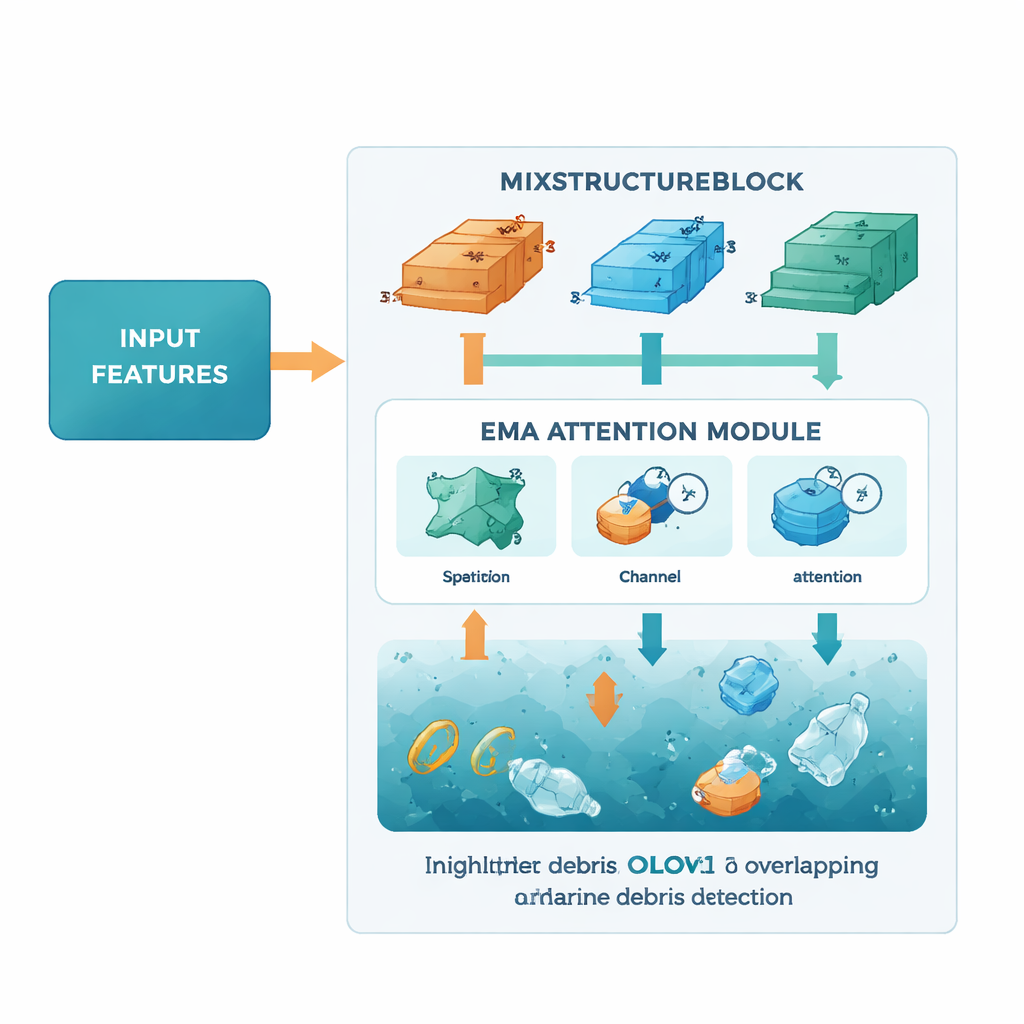

Die erste Verbesserung ist ein Modul namens MixStructureBlock, das einen Standardbaustein im YOLOv11-Backbone ersetzt. Anstatt ein festes Filtermuster zu verwenden, führt MixStructureBlock mehrere parallele Zweige aus, die die Szene mit unterschiedlichen „Fenstergrößen“ und Abständen betrachten. Das hilft dem Netzwerk, sowohl feine Details wie den Rand eines Flaschendeckels als auch größere Formen wie eine treibende Tüte zu erfassen. Zusätzlich enthält der Block einfache Aufmerksamkeitsmechanismen, die lernen, informative Farben und Bereiche zu betonen und unbrauchbare Hintergrundpartien abzuschwächen. Das Ergebnis ist ein reichhaltigeres, saubereres Merkmalset, das kleine, schwache Müllstücke leichter erkennbar macht.

Dem Netzwerk beibringen, worauf es achten soll

Das zweite Upgrade ist ein Efficient Multi-scale Attention (EMA)-Modul, das später im Netzwerk an der Stelle ergänzt wird, an der die Detektionen erfolgen. EMA betrachtet die Feature-Maps sowohl räumlich als auch kanalbezogen und stellt dabei effektiv zwei Fragen gleichzeitig: „Wo im Bild passiert etwas Wichtiges?“ und „Welche Musterarten sind gerade am relevantesten?“ Durch das Pooling von Informationen auf mehreren Skalen und den Einsatz leichter mathematischer Operationen schärft EMA den Fokus des Netzwerks auf wahrscheinliche Müllbereiche — etwa überlappende Objekte oder schwach beleuchtete Gegenstände weit entfernt von der Kamera — und hält das Modell gleichzeitig kompakt und schnell genug für den Echtzeitbetrieb auf eingebetteter Hardware.

Das System auf die Probe gestellt

Um ihr Design zu bewerten, trainierte und evaluierte das Team das Modell mit TrashCan, einer großen öffentlichen Sammlung von Tiefseeaufnahmen aus Japan. Eine Version des Datensatzes kennzeichnet Müll nach spezifischen Objekttypen (wie Becher, Tüte oder Metallrohr), während eine andere Version Gegenstände nach Material gruppiert (wie Plastik oder Stoff). In beiden Versionen übertrifft das verbesserte Netzwerk mehrere starke Baselines, darunter das ursprüngliche YOLOv11, ältere Systeme zur Meeresmüll-Erkennung und andere auf Unterwasseranwendungen zugeschnittene YOLO-Varianten. Es erkennt nicht nur mehr Müll korrekt, insbesondere kleine und dicht beieinanderliegende Objekte, sondern erreicht das bei einer bemerkenswert geringen Modellgröße von etwa 5 Megabyte, was gut für energiebegrenzte Unterwasserfahrzeuge geeignet ist.

Was das für sauberere Ozeane bedeutet

Einfach ausgedrückt zeigt die Studie, dass ein durchdachtes Neudenken darüber, wie eine KI Unterwasserbilder „sieht“, einen echten Unterschied beim Auffinden von Müll unter den Wellen machen kann. Durch die Kombination mehrskaliger Musterextraktion mit gezielter Aufmerksamkeit auf wichtige Bereiche entdeckt das vorgeschlagene System mehr Müll und bleibt dabei effizient genug für den Echtzeiteinsatz. Auf Kamerasystemen und Unterwasserrobotern eingesetzt, könnte diese Technologie Forschenden und Umweltbehörden helfen, Verschmutzungs-Hotspots zu kartieren, Aufräumaktionen zu leiten und zu überwachen, ob Maßnahmen zur Reduzierung von Meeresmüll wirken — ein Schritt näher an gesünderen Ozeanen.

Zitation: Yuanwei, J., Yijiang, D., Xuemei, W. et al. An improved YOLOv11 network for marine debris detection in underwater environment. Sci Rep 16, 7074 (2026). https://doi.org/10.1038/s41598-026-38305-0

Schlüsselwörter: Erkennung von Meeresmüll, Unterwasserrobotik, Objekterkennung, Tiefes Lernen, Verschmutzung der Ozeane