Clear Sky Science · de

Verwendung von Deep-Learning-Modellen zur Früherkennung und Klassifikation von Fruchtkrankheiten: auf dem Weg zu nachhaltiger Landwirtschaft und verbesserter Lebensmittelqualität

Warum frühes Erkennen kranker Früchte wichtig ist

Angestoßene oder fleckige Früchte sind mehr als ein kosmetisches Problem — sie können auf Pflanzenerkrankungen hinweisen, die Ernten schmälern, Wasser und Chemikalien verschwenden und stillschweigend die Lebensmittelpreise erhöhen. Weltweit verlassen sich Bauern noch immer überwiegend auf das bloße Auge, um zu beurteilen, welche Früchte gesund sind, ein langsamer und fehleranfälliger Prozess. Diese Studie untersucht, wie moderne künstliche Intelligenz einfache Fotos von Früchten in ein Frühwarnsystem verwandeln kann, das Landwirfte hilft, Felder zu schützen, Verluste zu verringern und qualitativ bessere Lebensmittel zu liefern.

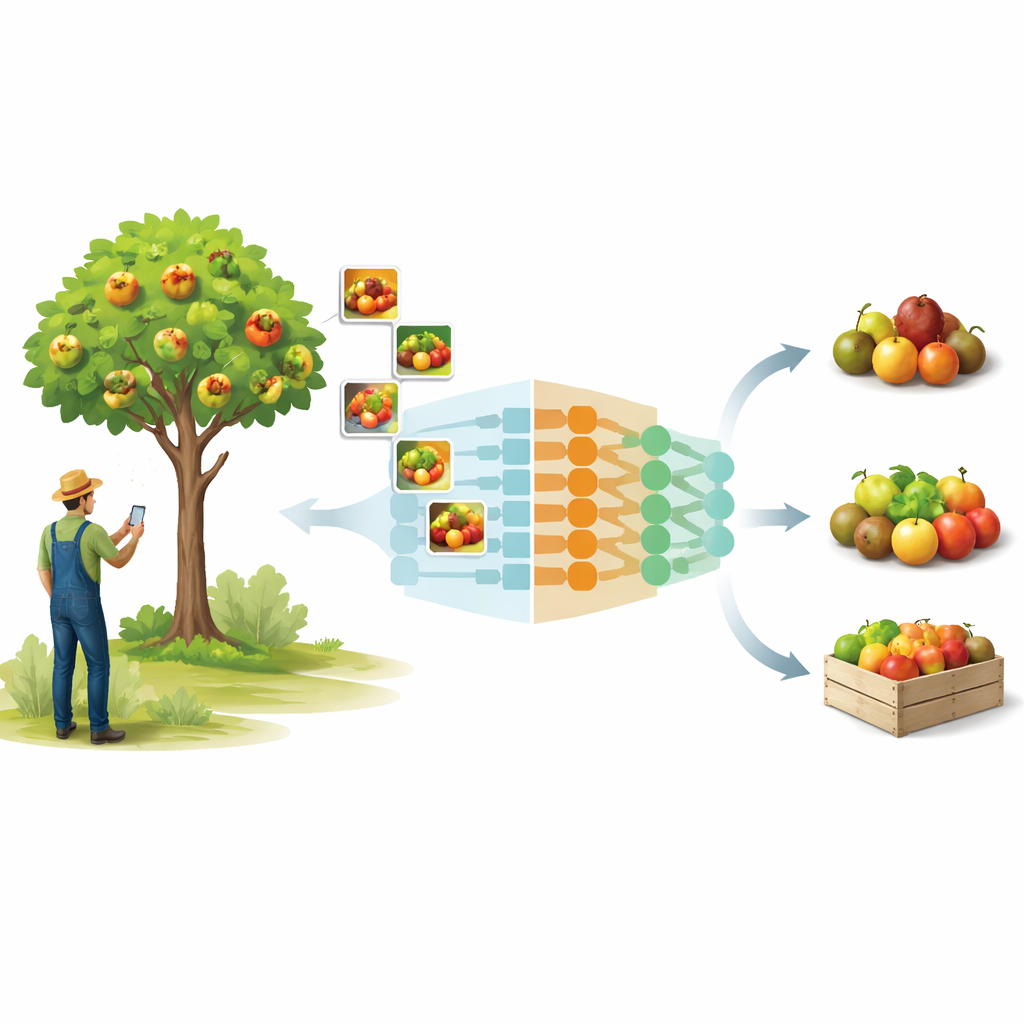

Von Smartphone-Fotos zu intelligenten Feldern

Die Forschenden wollten Werkzeuge entwickeln, die Krankheiten an gängigen Obstsorten automatisch allein anhand von Bildern von Blättern und Früchten erkennen. Sie konzentrierten sich auf sechs weit verbreitete Kulturen — Äpfel, Trauben, Mangos, Bananen, Guaven und Orangen — und sammelten Tausende von Aufnahmen, die sowohl gesunde als auch erkrankte Exemplare zeigen. Indem Computer beigebracht wird, subtile Flecken, Verfärbungen und Texturveränderungen zu unterscheiden, oft lange bevor ein Mensch sie bemerkt, soll Landwirtinnen und Landwirten schnell und objektiv Rückmeldung über den Gesundheitszustand der Pflanzen vor Ort gegeben werden.

Den Computern die "Fingerabdrücke" von Früchten beibringen

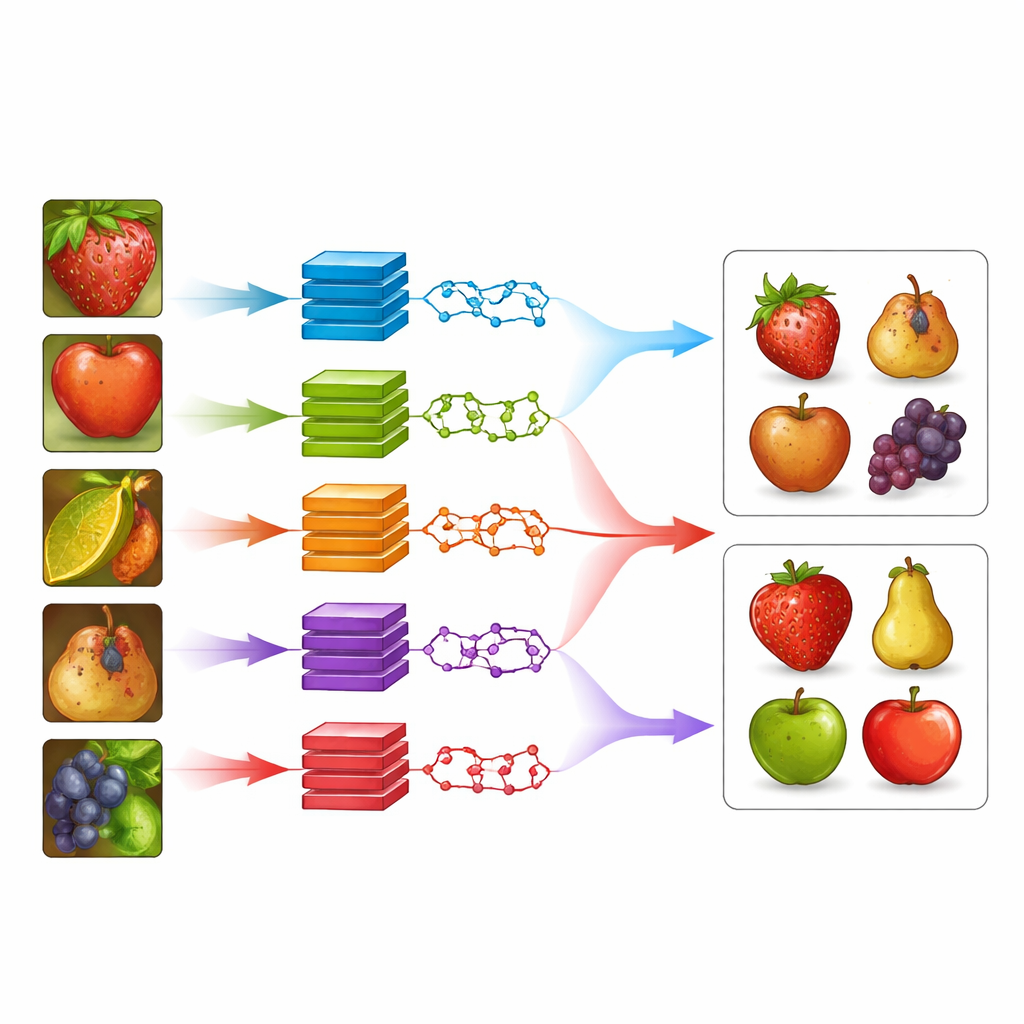

Zu diesem Zweck nutzte das Team Deep Learning, einen Bereich der künstlichen Intelligenz, der besonders gut darin ist, Muster in Bildern zu finden. Anstatt Regeln per Hand zu kodieren wie „suche nach braunen Kreisen“, trainierten sie fünf verschiedene neuronale Netzwerkarchitekturen — bekannt als CNN, DenseNet121, EfficientNet B3, Xception und ResNet50 — so dass diese direkt aus den Bilddaten lernen. Vor dem Training bereinigten und bereiteten sie die Bilder vor: Sie passten die Größe an, korrigierten Farben und nutzten Tricks wie Rotation und Spiegelung, um zusätzliche Trainingsbeispiele zu erzeugen. Dieser Bild-"Pflege"-Schritt hilft den Modellen, die wichtigen visuellen Fingerabdrücke von Krankheiten zu lernen und Ablenkungen wie Hintergrundunordnung oder Lichtverhältnisse zu ignorieren.

Sechs Früchte, viele Krankheiten, ein Kernansatz

Das gleiche grundlegende Vorgehen wurde in sechs getrennten Fallstudien angewendet, jeweils fokussiert auf eine bestimmte Frucht und deren wichtigste Krankheiten. Beispielsweise umfassten die Orangenbilder gesunde Früchte sowie Fälle von Zitrus-Canker, Black Spot und Greening. Trauben hatten Kategorien wie Black Rot und Blattfäule; Mangos und Guaven deckten ein breiteres Spektrum an Problemen ab; Bananen und Äpfel konzentrierten sich auf mehrere wichtige Blatt- und Fruchtinfektionen. Für jede Frucht trainierten die Forschenden alle fünf Deep-Learning-Modelle und maßen dann, wie genau jedes Modell neue, ungesehene Bilder der richtigen Krankheitskategorie oder „gesund“ zuordnen konnte. So war ein fairer Vergleich möglich, welche Architekturen unter realistischen Bedingungen am zuverlässigsten und effizientesten sind.

Wie gut die digitalen Prüfer abgeschnitten haben

Die digitalen Fruchtärzte erwiesen sich als bemerkenswert genau. In vielen Tests klassifizierten die besten Modelle mehr als 95 von 100 Bildern korrekt. Ein Modell namens EfficientNet B3 stach hervor und erreichte etwa 99 % Genauigkeit bei Trauben- und Apfelkrankheiten, während es Rechenressourcen effizient nutzte. ResNet50 zeigte besonders gute Leistungen bei Mango und Guave, und ein einfacheres CNN war für Orangen am besten geeignet. Selbst in schwierigeren Fällen, beispielsweise bei komplexen Bananen- oder Guavendatensätzen, erreichte zumindest ein Modell noch über 94–96 % Genauigkeit. Die Studie verglich diese Ergebnisse außerdem mit früherer Forschung und fand heraus, dass ihre sorgfältig abgestimmten Modelle, gestützt durch durchdachte Bildvorbereitung, im Allgemeinen mit früheren Ansätzen mithalten konnten oder diese übertrafen.

Was das für Landwirtschaft und Lebensmittel bedeutet

Für Landwirtinnen und Landwirte deuten diese Ergebnisse darauf hin, dass eine Kamera und ein trainiertes Deep-Learning-Modell bald wie ein ständig aktiver Pflanzengesundheitsassistent wirken könnten, der Probleme frühzeitig erkennt, sodass Bäume und Reben gerettet werden können, statt nur das Übriggebliebene zu bergen. Frühe und präzise Erkennung erleichtert es, nur die Pflanzen zu behandeln, die tatsächlich Aufmerksamkeit benötigen, wodurch Pestizidverschwendung reduziert und Boden sowie Wasser geschont werden. Im Laufe der Zeit könnten solche Systeme eine nachhaltigere Landwirtschaft unterstützen — höhere Erträge, weniger Verschwendung und bessere Qualität der Früchte auf dem Markt — indem alltägliche Bilder in schnelle, vertrauenswürdige Gesundheitschecks für unsere Nutzpflanzen verwandelt werden.

Zitation: Alrashdi, I., Sharawi, M., Ali, A.M. et al. Utilizing deep learning models for early detection and classification of fruit diseases: towards sustainable agriculture and enhanced food quality. Sci Rep 16, 8167 (2026). https://doi.org/10.1038/s41598-026-38259-3

Schlüsselwörter: Erkennung von Fruchtkrankheiten, Deep Learning in der Landwirtschaft, Pflanzengesundheitsüberwachung, Computer Vision, nachhaltige Landwirtschaft