Clear Sky Science · de

Multi-Level-Attention DeepLab V3+ mit EfficientNetB0 zur Segmentierung von Organen des Magen-Darm-Trakts in MRT-Aufnahmen

Präziseres Zielen auf Tumoren

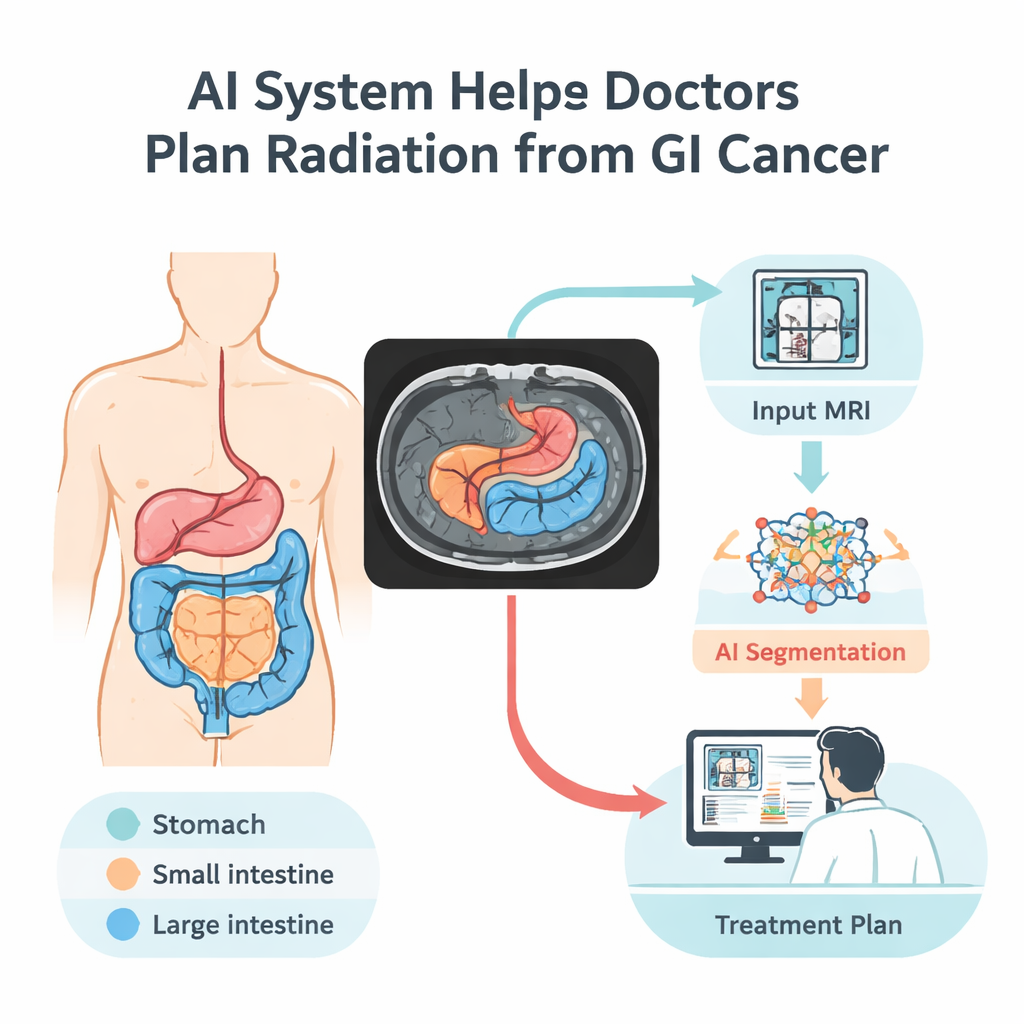

Wenn Ärztinnen und Ärzte Krebserkrankungen des Verdauungstrakts mit Strahlung behandeln, ist das ein heikles Gleichgewicht: den Tumor wirkungsvoll treffen und gleichzeitig benachbarte gesunde Organe wie Magen und Darm schonen. Heute kann das händische Nachzeichnen dieser Organe in jeder Magnetresonanztomographie (MRT)-Aufnahme bis zu einer Stunde pro Patient und Tag dauern. Diese Studie stellt ein Computer-Visions-System vor, das diese Organe in MRT-Bildern automatisch nachzeichnet und damit schnellere, präzisere Behandlungsplanung und weniger Nebenwirkungen für Patienten verspricht.

Warum die Kartierung des Darms wichtig ist

Gastrointestinale Krebserkrankungen sind häufig und oft tödlich, die Gesamtüberlebensraten liegen bei etwa 30 Prozent. Strahlentherapie ist ein zentraler Bestandteil der Behandlung, doch der Verdauungstrakt ist im Bauchraum eng gepackt und gesunde Organe können sich von Tag zu Tag leicht verschieben. Um Magen, Dünn- und Dickdarm nicht zu schädigen, müssen Spezialistinnen und Spezialisten vor jeder Behandlung genau sehen, wo diese Strukturen liegen. Manuelles Konturieren ist langsam und anfällig für Unterschiede zwischen Expertinnen und Experten. Ein automatisiertes, verlässliches Verfahren zur Abgrenzung könnte Termine verkürzen, Ärzten ermöglichen, mehr Patienten zu behandeln, und die Sicherheit und Genauigkeit der Strahlendosen verbessern.

Computern das Lesen von MRT-Bildern beibringen

Die Forschenden entwickelten ein künstliches Intelligenzmodell, das lernt, drei wichtige Verdauungsorgane in MRT-Aufnahmen zu erkennen: Magen, Dünndarm und Dickdarm. Sie trainierten es mit dem UW–Madison GI Tract Datensatz, der einzigen öffentlichen Sammlung mit detaillierten Organumrissen auf abdominalen MRT-Aufnahmen. Dieser Datensatz umfasst 38.496 Bilder von 85 Patientinnen und Patienten sowie sorgfältig erstellte Labels, die markieren, wo jedes Organ vorkommt oder wo kein Organ zu sehen ist. Um aus dieser vergleichsweise kleinen Stichprobe das Maximum zu machen, teilte das Team die Daten nach Patient (so dass das Modell dieselbe Person nie in Training und Test sieht) und erweiterte den Datensatz durch Spiegeln, Rotieren, Aufhellen und leichtes Verformen der Bilder. Diese kontrollierten Veränderungen helfen dem System, mit realen Variationen in Patientenlage, Bildhelligkeit und subtilen Formunterschieden zurechtzukommen.

Wie das neue KI-Modell Muster erkennt

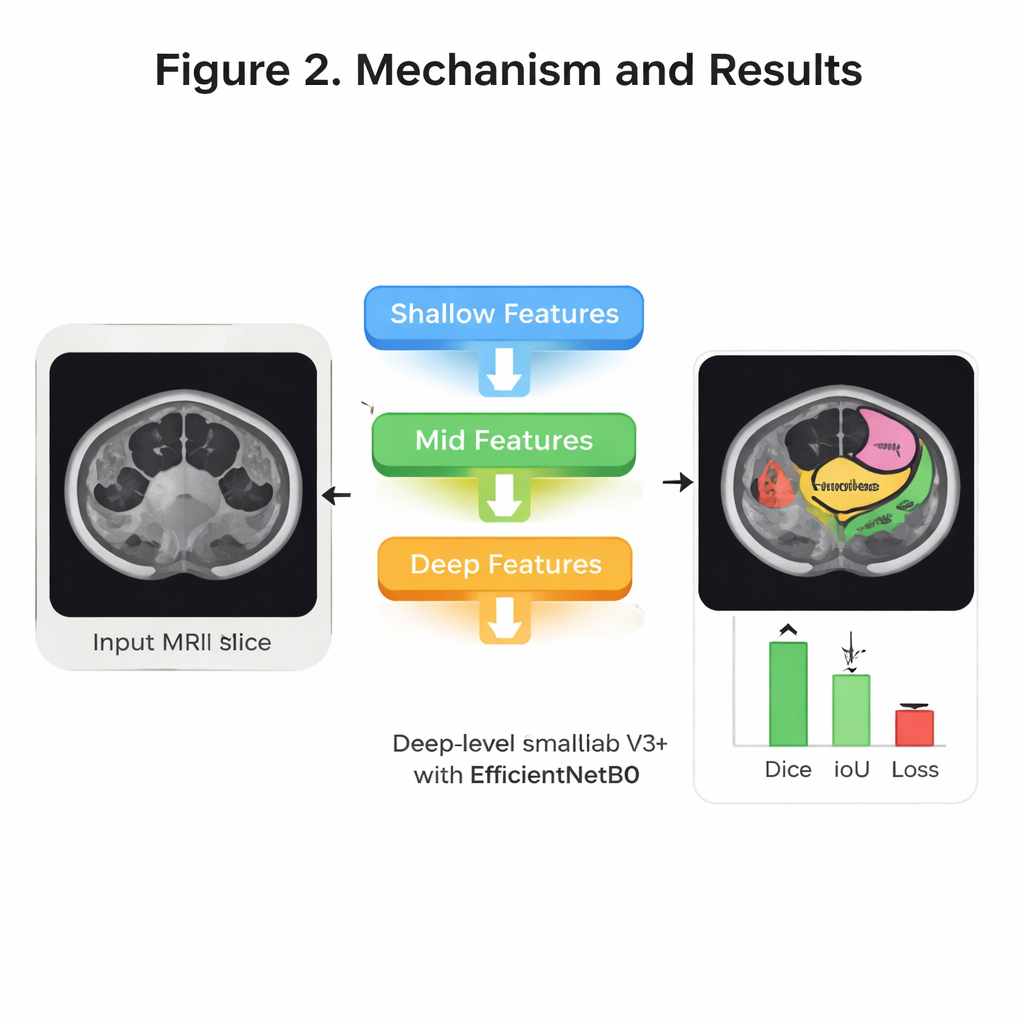

Im Inneren des Modells werden mehrere Ideen aus der modernen Bildverarbeitung kombiniert, um sein „Auge“ für Anatomie zu schärfen. Zuerst scannt ein kompakter Netzwerkblock namens EfficientNet B0 jedes Bild und baut Schichten visueller Merkmale auf – von einfachen Kanten bis hin zu komplexen Organformen – und hält dabei den Rechenaufwand moderat. Dann betrachtet eine Struktur namens DeepLab V3+ das Bild auf mehreren Skalen, ähnlich dem Herein- und Herauszoomen, um sowohl feine Details als auch den Gesamtzusammenhang zu erfassen. Darauf setzen die Autorinnen und Autoren auf mehreren Detailebenen einen „Attention“-Mechanismus. Einfach gesagt hilft Attention dem System zu entscheiden, welche Bildbereiche und internen Signale mehr Gewicht verdienen, damit es sich auf subtile, aber wichtige Hinweise konzentrieren kann, die zum Beispiel den Magen von Schlaufen des Dünndarms unterscheiden. Schließlich fügt eine Decoder-Phase diese Hinweise wieder zu einer sauberen, vollformatigen Maske zusammen, die die drei Organe zeigt.

Prüfung von Genauigkeit und Effizienz

Das Team optimierte systematisch die Trainingsprozedur – sie probierten verschiedene Optimierer, unterschiedliche Trainingszyklen und Wege zur Aufteilung der Daten für die Validierung. Die beste Konfiguration nutzte einen Optimierer namens RMSprop, vierfache Kreuzvalidierung und 30 Trainingsrunden. An unabhängigen Testpatienten klassifizierte das Modell insgesamt mehr als 99 Prozent der Pixel korrekt und zeigte eine sehr starke Überlappung mit von Expertinnen und Experten gezeichneten Konturen. Eine weit verbreitete Überlappungsmetrik, der Dice-Score, erreichte im Mittel etwa 94 Prozent über die drei Organe, während eine verwandte Kennzahl, Intersection over Union, bei etwa 92 Prozent lag. Ebenfalls wichtig für den klinischen Einsatz: Das System ist relativ schlank — es verfügt über rund 8,3 Millionen trainierbare Parameter und kann eine typische 224×224-MRT-Scheibe in etwa 31 Millisekunden verarbeiten, schnell genug für nahezu Echtzeit-Unterstützung bei der täglichen Behandlungsplanung.

Was das für Patientinnen und Patienten bedeuten könnte

Anschaulich zeigt diese Studie, dass eine sorgfältig gestaltete KI Magen und Darm in MRT-Bildern zuverlässig nachzeichnen kann, mit Performance auf Expertinnen- und Expertenniveau, dabei deutlich schneller und konsistenter arbeitet. Diese Fähigkeit könnte Strahlentherapeuten helfen, Strahlenfelder präziser um empfindliches Gewebe zu platzieren und so unerwünschte Schäden und Nebenwirkungen während der Behandlung zu verringern. Obwohl das aktuelle Modell mit Aufnahmen aus einem Zentrum und überwiegend gesunder Anatomie trainiert wurde, bildet es eine solide Grundlage für künftige Systeme, die erkrankte Organe und Daten aus mehreren Kliniken einbeziehen. Mit weiterer Prüfung und Verfeinerung könnten solche Werkzeuge Routineassistenten im Bestrahlungsplanungsraum werden und still dafür sorgen, dass lebensrettende Strahlen genau dort ankommen, wo sie am meisten gebraucht werden.

Zitation: Sharma, N., Gupta, S., Al-Yarimi, F.A.M. et al. Multi-level attention DeepLab V3+ with EfficientNetB0 for GI tract organ segmentation in MRI scans. Sci Rep 16, 7546 (2026). https://doi.org/10.1038/s41598-026-38247-7

Schlüsselwörter: gastrointestinale Krebserkrankung, MRT-Segmentierung, Planung der Strahlentherapie, Deep Learning in der Medizin, medizinische Bildanalyse