Clear Sky Science · de

Ensemble-basierte, leistungsstarke Deep‑Learning‑Modelle für die medizinische Bildsuche bei der Brustkrebs‑Erkennung

Warum intelligenteres Bildmaterial für die Brustgesundheit wichtig ist

Brustkrebs gehört zu den häufigsten Krebserkrankungen bei Frauen, und Ultraschalluntersuchungen sind ein zentrales Werkzeug, um verdächtige Knoten früh zu entdecken. Ärzte müssen heute jedoch durch immer größere Archive medizinischer Bilder navigieren, und computergestützte Systeme, die helfen könnten, tun sich oft schwer damit, wirklich zu „verstehen“, was sie sehen. Diese Studie stellt eine intelligentere Form einer Bildsuchmaschine für Brustultraschall vor, die nicht nur Tumore mit hoher Genauigkeit findet und klassifiziert, sondern Ärzten auch zeigt, welche Bildbereiche ihre Entscheidungen beeinflusst haben.

Von einfachen Bildern zu nützlichen Vergleichen

Krankenhäuser speichern inzwischen enorme Mengen an Brustultraschallaufnahmen, was es schwer und zeitaufwendig macht, frühere Fälle zu finden, die dem Bild einer neuen Patientin ähneln. Frühere inhaltsbasierte Bildabrufsysteme verglichen Bilder anhand einfacher Merkmale wie Helligkeit oder Textur, die oft nicht mit der Art und Weise übereinstimmten, wie Radiologinnen und Radiologen über Erkrankungen urteilen. Die Autorinnen und Autoren wollen diese Lücke schließen, indem sie ein Deep‑Learning‑System mit einer weit verbreiteten Sammlung von 830 Brustultraschallbildern trainieren, die in normales Gewebe, harmlose (benigne) Tumore und gefährliche (maligne) Tumore gruppiert sind. Ihr Ziel ist zweifach: einen neuen Scan in eine dieser drei Gruppen zu klassifizieren und anschließend automatisch ähnliche frühere Aufnahmen abzurufen, um die Diagnose zu stützen.

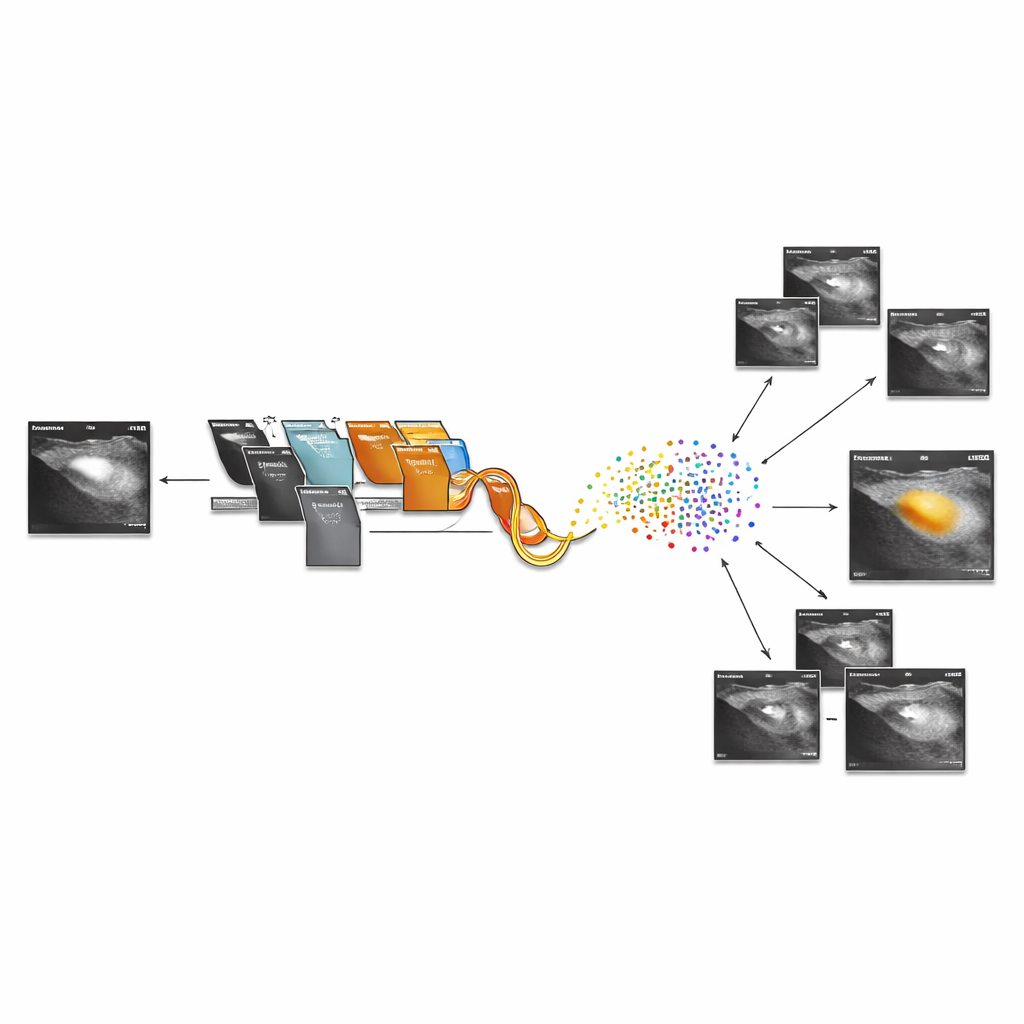

Ein hybrides KI‑System auf Musterjagd

Das Team entwickelt ein „hybrides“ Modell, das drei Arten von neuronalen Netzen kombiniert, die jeweils eine andere Rolle übernehmen. Ein Faltungsnetz (Convolutional Network) ist auf das Erfassen räumlicher Muster in einem Ultraschallbild spezialisiert, etwa die Form eines Knotens oder wie scharf seine Ränder hervorstechen. Ein rekurrentes Netz, das sonst öfter für Sequenzen wie Sprache eingesetzt wird, wird so adaptiert, dass es Bildzeilen als eine Art geordnetes Signal behandelt und so hilft, subtile Veränderungen über das Bild hinweg zu erkennen. Ergänzt wird das Ganze durch eine erklärbare‑KI‑Komponente, die Heatmaps erzeugt, welche die Bildregionen hervorheben, die für eine Entscheidung am wichtigsten sind, sodass Klinikpersonal prüfen kann, ob das Modell auf den Tumor statt auf irrelevanten Hintergrund fokussiert.

Bereinigen, erweitern und organisieren der Daten

Vor dem Training bereiten die Forschenden die Ultraschallbilder sorgfältig vor. Sie entfernen Duplikate und störende Ränder, konvertieren die Aufnahmen in ein einheitliches Graustufenformat, schneiden leere Bereiche weg und skalieren alles auf ein standardisiertes kleines Quadrat, damit das Modell Daten effizient verarbeiten kann. Jedes Bild wird als normal, benigne oder maligne gelabelt, und Maskenbilder umreißen die genauen Tumorregionen. Da medizinische Datensätze meist klein sind, erweitern sie diese Sammlung künstlich durch Rotieren, Spiegeln, Zoomen und Kontrastanpassungen und vergrößern so den Trainingssatz von 548 auf 3.840 Bilder. Diese kontrollierten Variationen lehren das Netzwerk, mit den vielen Erscheinungsformen realer Tumore umzugehen, wie sie bei verschiedenen Geräten und Patientinnen vorkommen.

Wie das System klassifiziert und sucht

Nach dem Training verwandelt das hybride Modell jede Ultraschallaufnahme in einen kompakten numerischen Fingerabdruck, entnommen aus der zweitletzten Schicht des Netzwerks. Bilder mit ähnlichen Fingerabdrücken weisen tendenziell vergleichbare Gewebemuster auf, sodass das Team einfache Abstände zwischen diesen Repräsentationen berechnen kann, um die engsten Übereinstimmungen in der Datenbank zu finden. Das System sagt zunächst voraus, ob der neue Scan normal, benigne oder maligne ist, und ruft dann visuell und klinisch ähnliche Fälle ab und stellt dem Radiologen eine Galerie von Referenzbildern bereit. Das Erklärbarkeitsmodul legt warm eingefärbte Regionen über den Originalscan, die zeigen, wo das Netzwerk „hingeschaut“ hat, um zu seinem Ergebnis zu kommen — das kann Vertrauen schaffen und Lehre sowie Zweitmeinungen unterstützen.

Was die Ergebnisse für Patientinnen bedeuten

In Tests mit dem Brustultraschalldatensatz erzielt der hybride Ansatz eine Klassifikationsgenauigkeit von etwa 99 % und übertrifft mehrere führende Deep‑Learning‑Modelle, die auf eine einzelne Architektur setzen. Er zeigt zudem stabile Verhaltensweisen über mehrere Trainings‑Test‑Aufteilungen hinweg, was darauf hindeutet, dass seine Leistung kein Zufall einer bestimmten Datensatzaufteilung ist. Für Patientinnen bedeutet das, dass Rhe zukünftt eine Radiologin oder ein Radiologe nicht nur eine hochzuverlässige computerunterstützte Einschätzung eines Ultraschalls erhalten könnte, sondern auch sofort ähnliche frühere Fälle und genau die Bildbereiche sehen kann, die Besorgnis erregten. Die Autorinnen und Autoren weisen darauf hin, dass breitere klinische Studien und Tests an anderen Bildgebungsarten noch nötig sind, doch ihre Arbeit weist in Richtung einer transparenteren, verlässlicheren und effizienteren Nutzung von KI bei der Brustkrebserkennung.

Zitation: Fawzy, A.E., Almandouh, M.E., Herajy, M. et al. Ensemble-based high-performance deep learning models for medical image retrieval in breast cancer detection. Sci Rep 16, 8723 (2026). https://doi.org/10.1038/s41598-026-38218-y

Schlüsselwörter: Brustultraschall, medizinische Bildsuche, Deep Learning, Brustkrebserkennung, erklärbare KI