Clear Sky Science · de

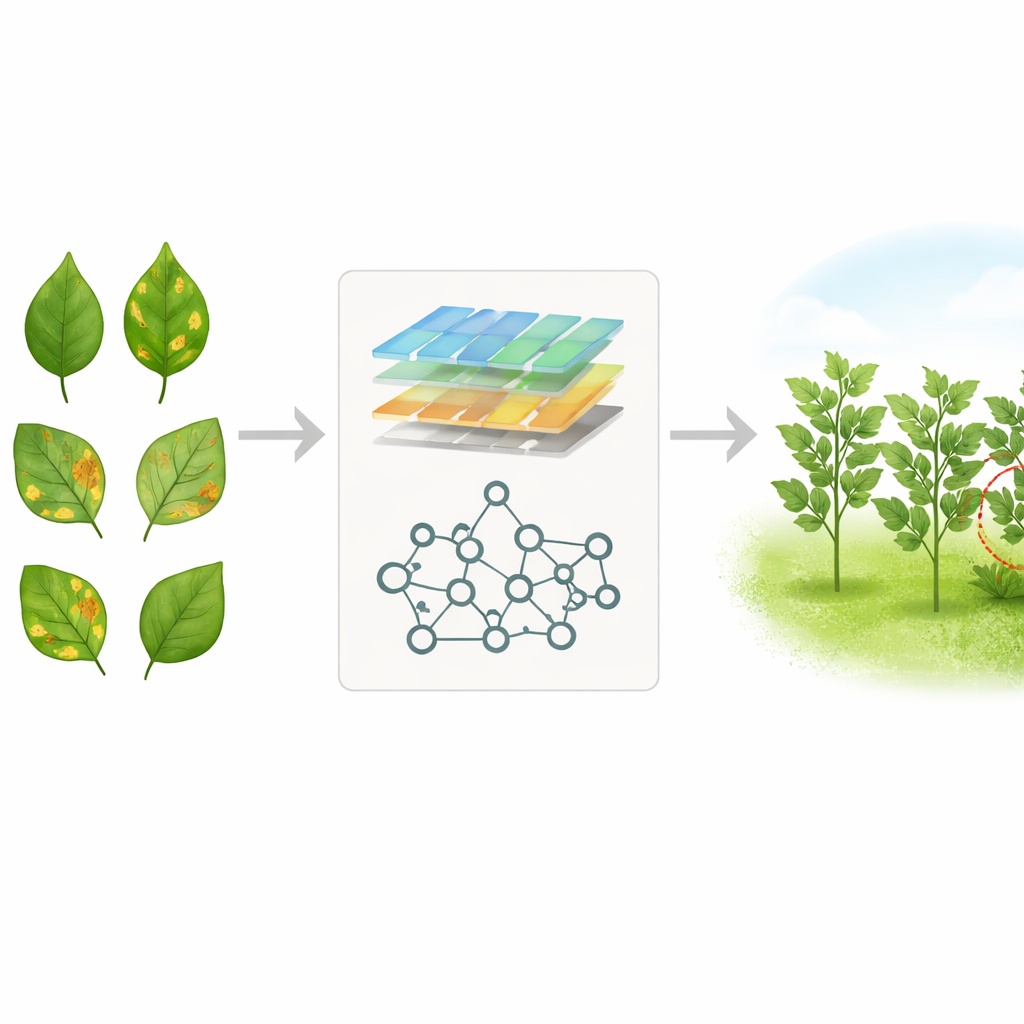

Ein hybrides Deep‑Learning‑Framework mit Convolutional‑ und Transformer‑Modellen für robuste Pflanzenkrankheitsklassifikation

Warum es wichtig ist, kranke Pflanzen zu erkennen

Pflanzenkrankheiten vernichten jedes Jahr stillschweigend einen großen Teil der Nahrungsmittel weltweit, reduzieren Erträge, schädigen die Einkommen der Landwirtinnen und Landwirte und gefährden die Ernährungssicherheit. Diese Krankheiten früh zu entdecken ist schwierig: Felder sind groß, Expertinnen und Experten sind rar, und viele Symptome sind unauffällig. Diese Studie untersucht, wie eine neue Art künstlicher Intelligenz lernen kann, Dutzende von Blattkrankheiten auf einfachen Fotos zu erkennen, und eröffnet damit die Möglichkeit für Smartphone‑ oder Feldkamera‑Werkzeuge, die Landwirte unterstützen, bevor sich Probleme ausbreiten.

Von menschlichem Raten zu digitalen Augen

Traditionelle Diagnosen beruhen darauf, dass Menschen Blätter visuell untersuchen und gelegentlich Proben ins Labor schicken. Dieses Verfahren ist langsam, subjektiv und in ländlichen Regionen oft nicht verfügbar. In den letzten zehn Jahren haben Forschende Computerprogramme darauf trainiert, Blattbilder zu «lesen». Frühere Systeme erforderlichen entweder handgefertigte visuelle Merkmale durch Ingenieurinnen und Ingenieure oder setzten auf Deep‑Learning‑Modelle wie Convolutional Neural Networks, die besonders gut Texturen, Farben und Kanten erfassen. Diese Methoden verbesserten die Genauigkeit, hatten aber weiterhin Probleme, wenn Krankheitszeichen schwach waren, sich über das Blatt ausbreiteten oder bei verschiedenen Krankheiten ähnlich aussahen. Die neue Studie fragt, ob die Kombination zweier moderner KI‑Ansätze in diesen schwierigen Fällen zuverlässigere Ergebnisse liefern kann.

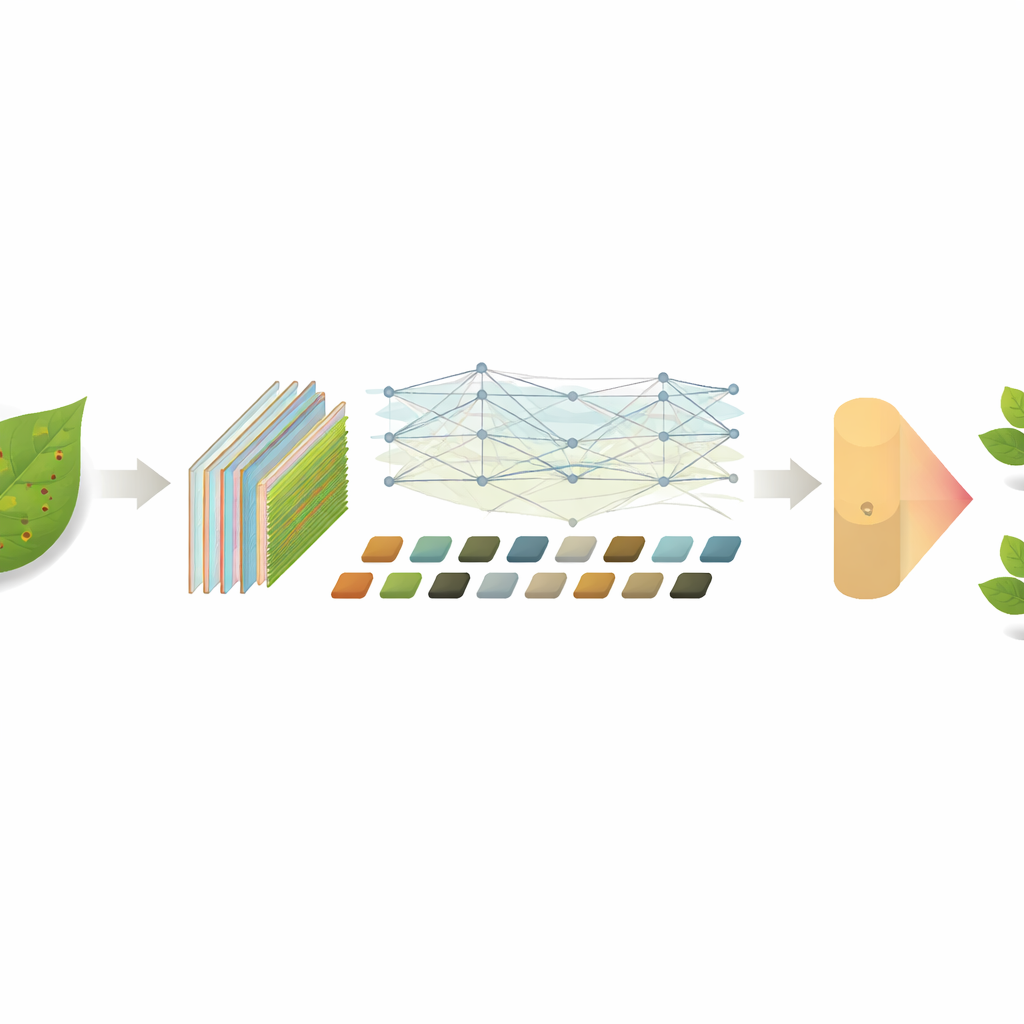

Zwei Sichtweisen vereinen

Die Autorinnen und Autoren bauen ein hybrides System, das ein Convolutional‑Netz mit einem neueren Bildmodell, dem Vision Transformer, verbindet. Der erste Teil, EfficientNet‑B7, wirkt wie eine Lupe und durchsucht Blattfotos nach feinen Details wie kleinen Flecken, Blattadern und Farbveränderungen. Seine Ausgaben werden anschließend umgeformt und an einen Transformer (ViT‑B16) übergeben, der darauf ausgelegt ist, zu erkennen, wie verschiedene Bildregionen über große Distanzen zueinander in Beziehung stehen. Indem die detaillierten Merkmale in eine Serie kleiner Patches verwandelt werden und der Transformer gewichten kann, wie jeder Patch mit allen anderen interagiert, kann das System sowohl lokale Makel als auch das Gesamtmuster auf der Blattoberfläche erfassen. Diese Kombination zielt darauf ab, das Verhalten eines erfahrenen Agronomen nachzuahmen, der eine Läsion genau betrachtet und zugleich ihre Lage und Umgebung berücksichtigt.

Das System mit Tausenden Blättern lehren

Zum Trainieren und Testen ihres Modells nutzten die Forschenden eine große öffentliche Sammlung von 21.534 Bildern, die 38 verschiedene Zustände zeigen, darunter viele Krankheiten und gesunde Blätter von Kulturen wie Apfel, Tomate, Weinrebe und Mais. Sie standardisierten die Fotos auf eine gemeinsame Größe und wendeten digitale Tricks wie Rotationen, Spiegelungen und Zooms an, um die unordentlichen Bedingungen realer Felder zu simulieren. Das Modell lernt zunächst allgemeine visuelle Muster aus vorhandenen Bilddaten und wird dann an dieser Pflanzensammlung feinabgestimmt. Während des Trainings verfolgt das Team nicht nur die Gesamtgenauigkeit, sondern auch, wie oft das System jede Krankheit korrekt identifiziert und wie gut es Fehlalarme vermeidet, sodass die Leistung sowohl bei häufigen als auch bei selteneren Klassen stabil bleibt.

Wie gut der hybride Ansatz abschneidet

Bei der Bewertung mit unbekannten Bildern klassifiziert das hybride Modell den Gesundheitszustand und Krankheiten von Pflanzen in 98,13 Prozent der Fälle korrekt und erzielt gleichzeitig hohe Werte bei strengen Kennzahlen für Präzision, Recall und deren Ausgewogenheit. Es bewältigt sowohl gesunde Blätter als auch schwierige Krankheiten, wobei sehr frühe Symptome weiterhin anspruchsvoller bleiben. Die Autorinnen und Autoren vergleichen ihr System mit einer Reihe beliebter Alternativen, darunter eigenständige Convolutional‑Netze, reine Transformer‑Modelle, leichte Mobilnetzwerke, schnelle Detektoren wie YOLO sowie klassische Werkzeuge wie Support Vector Machines und Random Forests. In diesen direkten Vergleichen liegt das Hybridmodell durchgängig vorn und übertrifft sogar starke Konkurrenten, die nur EfficientNet nutzen oder aus mehreren Netzwerken bestehen.

Was das für Betriebe und Nahrungsmittel bedeutet

In praktischer Hinsicht zeigt die Studie, dass die Kombination von zwei komplementären KI‑„Blickweisen“ auf ein Bild — scharfe lokale Details und breiter Kontext — die automatische Erkennung von Pflanzenkrankheiten deutlich verbessern kann. Während das aktuelle System noch relativ klare Fotos erwartet und am besten auf Maschinen mit Grafikkarten läuft, ließen sich die gleichen Designideen auf leichtere Versionen für Smartphones, Drohnen oder kostengünstige Feldgeräte übertragen. Wenn sich diese Werkzeuge weiterentwickeln, könnten sie Landwirten schnelle Vor‑Ort‑Hinweise geben, was ihre Pflanzen befällt und wo, und so frühere Behandlungen, reduzierten Chemikalieneinsatz und stabilere Ernten unterstützen. Für Leserinnen und Leser ist die Kernbotschaft, dass intelligentere Kameras und Algorithmen zu starken Helfern beim Schutz der weltweiten Nahrungsmittelversorgung werden.

Zitation: Jawed, M.M., Tufail, F.A., Ahmed, M.Z. et al. A hybrid deep learning framework using convolutional and transformer models for robust plant disease classification. Sci Rep 16, 9704 (2026). https://doi.org/10.1038/s41598-026-38209-z

Schlüsselwörter: Erkennung von Pflanzenkrankheiten, Deep Learning, Vision Transformer, präzise Landwirtschaft, Bildklassifikation