Clear Sky Science · de

Klassifizierung von Reispflanzenkrankheiten mit effizientem DenseNet121

Warum es wichtig ist, kranke Reispflanzen zu erkennen

Reis ist für Milliarden Menschen ein Grundnahrungsmittel; alles, was Reisfelder schädigt, kann die Lebensmittelversorgung und die Existenz von Landwirtinnen und Landwirten bedrohen. Viele Reiskrankheiten zeigen sich zunächst als unauffällige Flecken oder Streifen auf den Blättern, die leicht übersehen oder falsch beurteilt werden — besonders auf großen Anbauflächen. Diese Arbeit untersucht, wie künstliche Intelligenz (KI) aus einfachen Fotos von Reispflanzen schnelle und genaue Diagnosen mehrerer Blattkrankheiten erstellen kann, sodass Landwirte früh reagieren und größere Ernteverluste vermeiden können.

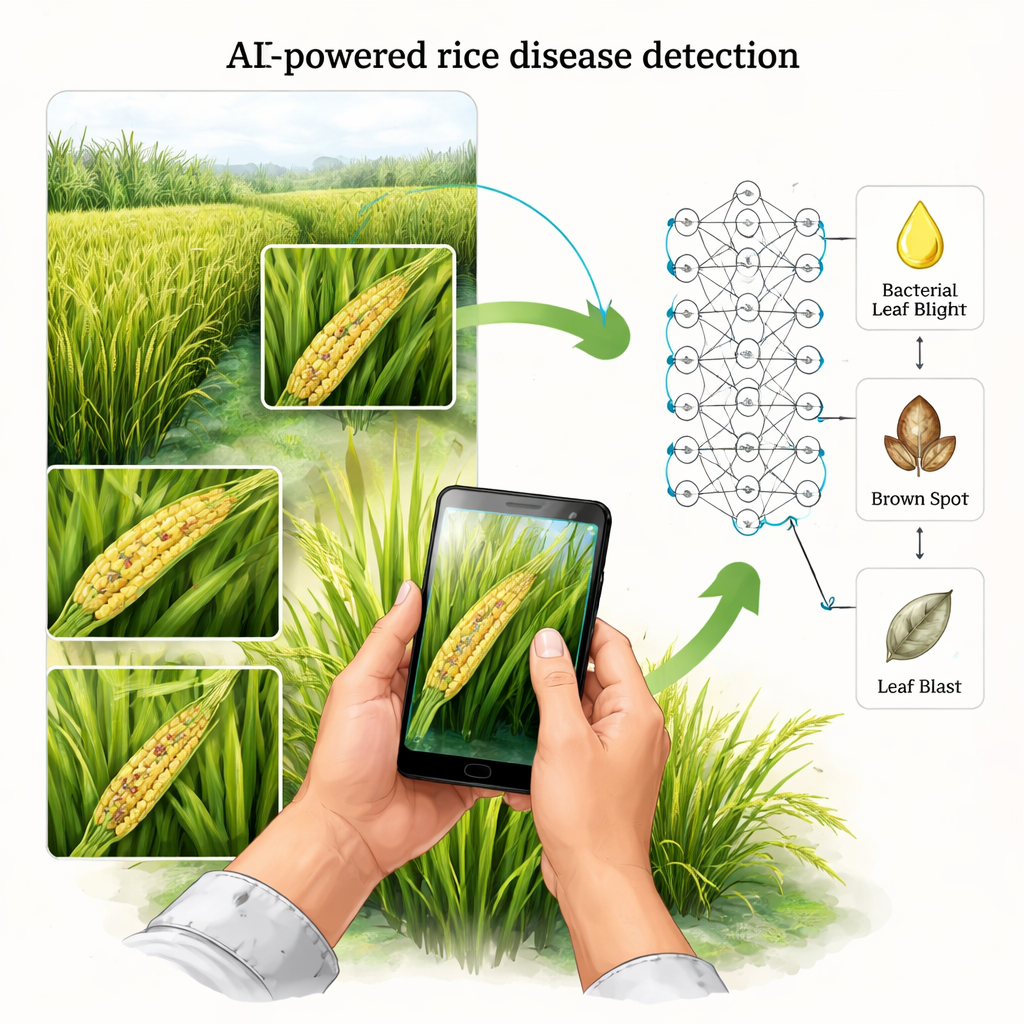

Von Raten zu kameragestützten Prüfungen

Traditionell beruht die Diagnose von Pflanzenkrankheiten auf der visuellen Inspektion durch Expertinnen und Experten vor Ort oder anhand von Fotos. Dieses Vorgehen ist langsam, teuer und nicht skalierbar für Millionen kleiner Höfe. Gleichzeitig sind Smartphones und günstige Digitalkameras inzwischen selbst in ländlichen Gebieten weit verbreitet. Die Autorinnen und Autoren nutzen diese Chance: Wenn Landwirtinnen klare Blattfotos aufnehmen können, könnte ein gut trainiertes KI‑System verschiedene Krankheiten automatisch und in Sekunden erkennen. Die Studie konzentriert sich auf sieben der häufigsten Reiskrankheiten — von bakterieller Blattfleckenkrankheit bis zu Pilzflecken und Mehltau — mit dem Ziel eines Werkzeugs, das für ein breites Spektrum von Problemen einsetzbar ist, statt nur für ein oder zwei.

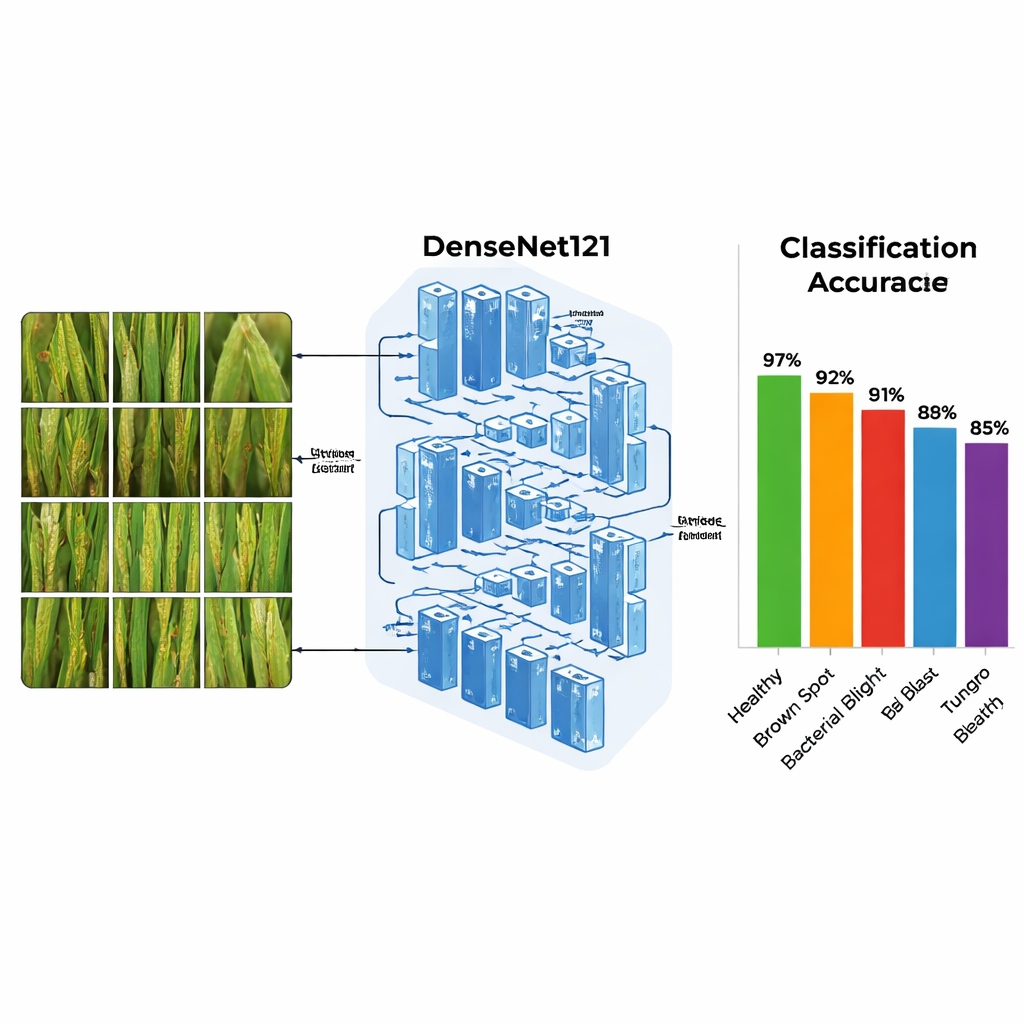

Wie das intelligente Bildsystem funktioniert

Die Forschenden bauen auf einem leistungsfähigen Bilderkennungsansatz auf, der als konvolutionäres neuronales Netz bekannt ist und Muster wie Formen, Farben und Texturen in Bildern lernt. Sie verwenden ein bestimmtes Design namens DenseNet121, das für seine dichten Verbindungen zwischen vielen Schichten bekannt ist, sodass Informationen effizient fließen und Merkmale wiederverwendet werden, statt ständig neu gelernt zu werden. Anstatt bei Null zu beginnen, setzen sie Transfer Learning ein: Sie starten mit einem DenseNet‑Modell, das bereits an Millionen alltäglicher Bilder trainiert ist, und passen es dann mit Reisblattfotos fein an. Sie sammeln 8.030 Originalbilder kranker Blätter aus einem öffentlichen „Paddy‑Rice“-Datensatz und erweitern diesen durch gezielte Datenaugmentation auf 11.467 Bilder, etwa durch Rotationen, Spiegelungen und leichte Helligkeitsänderungen, damit das Modell robust gegen reale Variationen wird.

Training, Testen und Vertrauen in die Ergebnisse

Zum Training teilt das Team die Bilder in zwei Sätze: etwa 80 % zum Trainieren des Modells und 20 % zum Testen mit bislang unbekannten Fällen. Sie justieren Parameter wie Lernrate, Batch‑Größe und Anzahl der Trainingsdurchläufe, verwenden einen Optimierer namens Adam und beenden das Training frühzeitig, wenn die Leistung nicht weiter steigt. Das System lernt dann, jedes Bild einer der Krankheitskategorien zuzuordnen. Die Leistung wird mit mehreren Standardkennzahlen gemessen: Genauigkeit (wie oft das Modell insgesamt richtig liegt), Präzision (wie häufig positive Vorhersagen korrekt sind), Recall/Sensitivität (welche Anteile der tatsächlich Kranken gefunden werden) und der F1‑Score (der Präzision und Recall ausgleicht). Zudem analysieren sie eine Konfusionsmatrix, die zeigt, wo das System ähnlich aussehende Krankheiten verwechselt.

Wie gut die KI Reiskrankheiten diagnostiziert

Das trainierte DenseNet121‑Modell erzielt beeindruckende Ergebnisse. Im unabhängigen Testsatz erreicht es eine Gesamtgenauigkeit von 97,9 %, wobei die Genauigkeiten für einzelne Krankheiten meist zwischen 96 % und fast 100 % liegen. Die durchschnittliche Präzision liegt bei etwa 96,2 %, der Recall bei rund 97,9 % und der F1‑Score bei 97 %, was darauf hinweist, dass das Modell nicht nur präzise ist, sondern auch ausgeglichen in Bezug auf verpasste Fälle und Fehlalarme. Eine fünffache Kreuzvalidierung — das wiederholte Aufteilen in Trainings‑ und Testdaten — zeigt ähnlich starke und stabile Ergebnisse mit sehr geringen Schwankungen zwischen den Läufen. Zwar gibt es nach wie vor Verwechslungen zwischen Krankheiten mit ähnlichen Blattflecken, doch das System unterscheidet im Allgemeinen selbst subtile Unterschiede in Mustern und Farben, die menschlichen Beobachterinnen und Beobachtern entgehen könnten.

Was das für Landwirtinnen, Landwirte und Ernährungssicherheit bedeutet

Für Nicht‑Spezialistinnen und Nicht‑Spezialisten ist die Kernbotschaft einfach: Die Studie zeigt, dass ein sorgfältig gestaltetes KI‑Modell Fotos von Reisblättern anschauen und mit hoher Zuverlässigkeit feststellen kann, welche Krankheit unter mehreren Hauptbedrohungen vorliegt. Das öffnet die Tür für smartphone‑ oder drohnenbasierte Werkzeuge, die Landwirtinnen und Landwirten schnelle, praxisnahe Hinweise zur Pflanzen‑gesundheit geben, sodass Probleme früh behandelt, unnötiger Pestizideinsatz reduziert und Erträge geschützt werden können. Obwohl weitere Arbeiten nötig sind, um solche Systeme in verschiedenen Feldbedingungen zu testen und in benutzerfreundliche Apps zu überführen, deuten die Ergebnisse darauf hin, dass KI‑gestützte Krankheitsdiagnosen ein praktischer Verbündeter werden können, um die globale Reisproduktion widerstandsfähiger und nachhaltiger zu machen.

Zitation: Ismail, A., Hamdy, W., Ibrahim, A.H. et al. Classification of rice plant diseases using efficient DenseNet121. Sci Rep 16, 7482 (2026). https://doi.org/10.1038/s41598-026-38078-6

Schlüsselwörter: Erkennung von Reiskrankheiten, Bildgebung zur Pflanzenvitalität, Tiefes Lernen, Schutz von Nutzpflanzen, Ernährungssicherheit