Clear Sky Science · de

Stabilitätsorientierte, diagonal-reaktive Quanten-Neuronale Netze zur Identifikation nichtlinearer Systeme

Maschinen beibringen, unordentliche Systeme zu verstehen

Viele der Systeme, die unser Leben prägen – von Elektromotoren in Haushaltsgeräten über turbulente Luftströmungen bis hin zu manchen medizinischen Prozessen – verhalten sich kompliziert und nichtlinear. Das bedeutet, dass kleine Änderungen in den Eingängen überraschend große oder chaotische Reaktionen auslösen können. Solche Systeme vorherzusagen und zu steuern ist schwierig, aber entscheidend für Effizienz, Sicherheit und Energieeinsparung. Dieser Beitrag stellt eine neue Art von Lernmaschine vor, die Ideen aus Quanteninformatik, neuronalen Netzen und Stabilitätstheorie verbindet, um diese schwierigen Verhaltensweisen genauer und verlässlicher zu modellieren.

Warum herkömmliche Modelle an Grenzen stoßen

Traditionelle Modellierungswerkzeuge gehen oft davon aus, dass Ursache und Wirkung ordentlich und proportional sind, was für einfache oder fast lineare Systeme gut funktioniert. Viele reale Systeme besitzen jedoch Gedächtnis, Rückkopplungen und Schwellenwerte, die ihr Verhalten stark nichtlinear machen. Klassische neuronale Netze haben geholfen, doch sie bringen eigene Probleme mit sich. Feedforward-Netze, in denen Informationen nur in eine Richtung fließen, sind für statische Aufgaben geeignet, tun sich aber schwer, wenn vergangene Signale eine Rolle spielen. Rekursive Netze, die Informationen zurückschleifen, um Gedächtnis zu erzeugen, können zeitvariierendes Verhalten erfassen, sind jedoch oft schwer zu trainieren, neigen zu Instabilität und werden rechenintensiv, wenn jede Neuron mit jedem anderen verbunden ist.

Quantenideen mit einfachen Schleifen verbinden

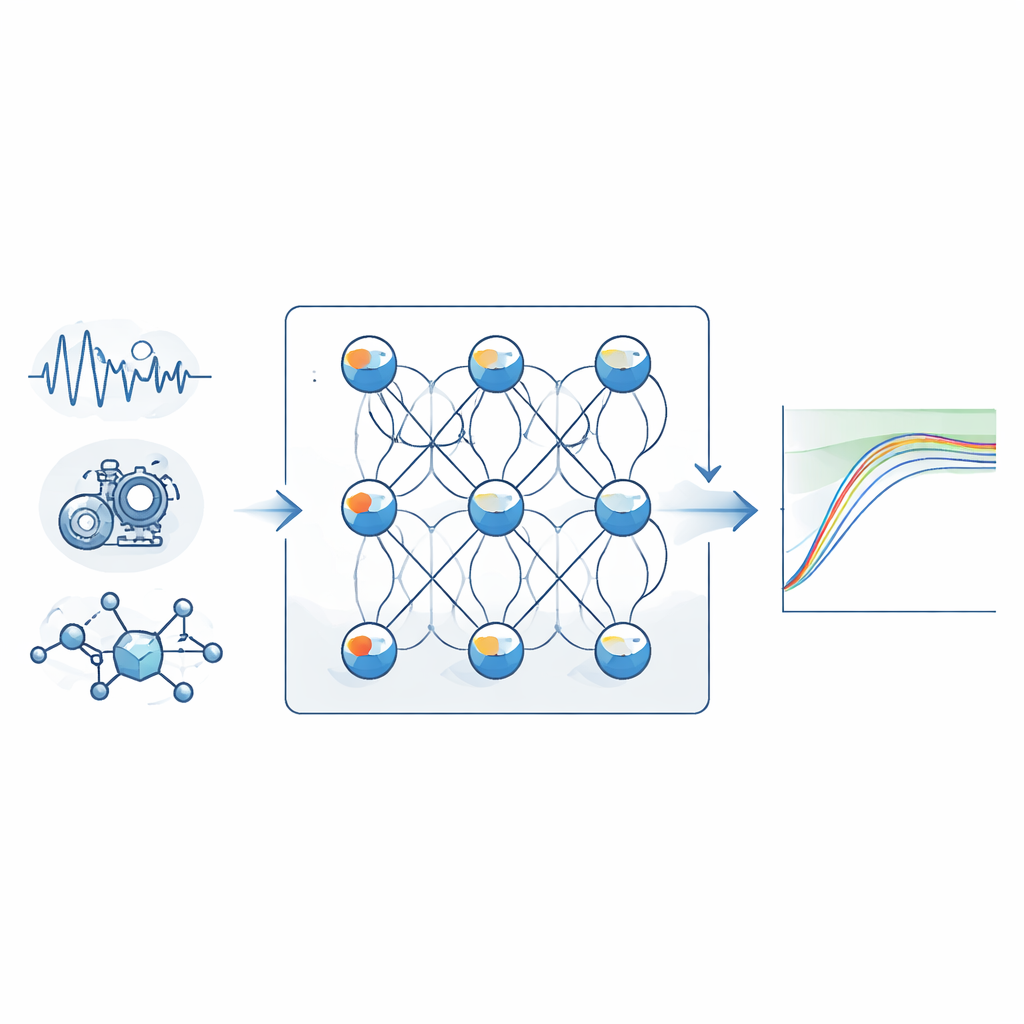

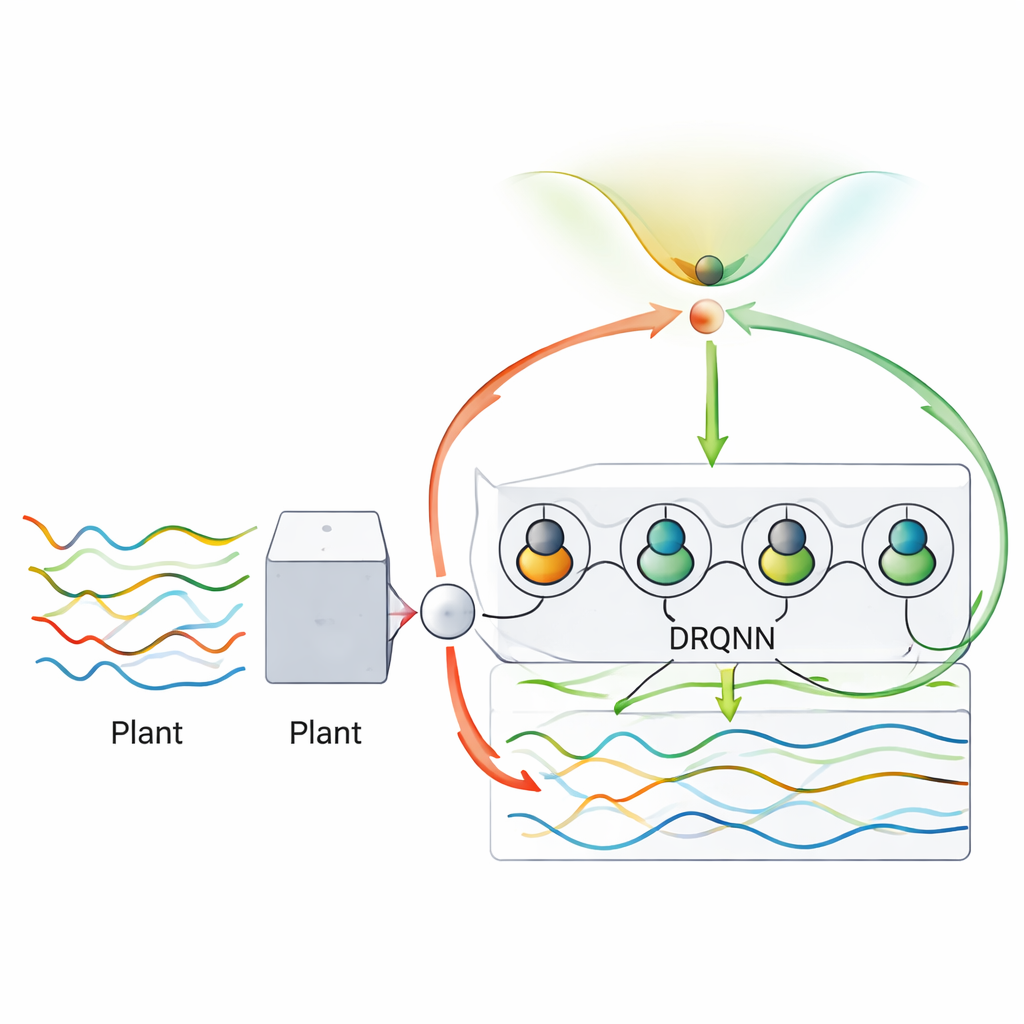

Die Autoren schlagen ein diagonal rekurrentes quanten-inspiriertes neuronales Netz mit Lyapunov-Stabilität vor, abgekürzt DRQNN-LS. Im Kern ähnelt dieses Netz einem vertrauten Dreischichten-Netz: Eingänge, eine verdeckte Schicht und ein Ausgang. Zwei Besonderheiten machen es jedoch besonders. Erstens verhalten sich die verborgenen Einheiten wie vereinfachte Qubits, deren interne Zustände eher über phasenähnliche Größen als über einfache Zahlen beschrieben werden. Diese quanteninspirierte Darstellung erlaubt es jeder Einheit, reichhaltigere Informationen kompakt zu kodieren und verbessert so die Fähigkeit des Netzes, komplexe Zusammenhänge zu approximieren. Zweitens führt statt eines Gewirrs von Rückkopplungsverbindungen jedes verborgene Neuron nur in sich selbst zurück. Diese „diagonale“ Rekurrenz erhält das notwendige Gedächtnis für zeitvariante Muster, reduziert aber drastisch die Anzahl der anzupassenden Verbindungen.

Lernen stabil und kontrolliert halten

Eine große Herausforderung beim Training rekursiver Netze besteht darin, das Lernen stabil zu halten: Ändern sich die Gewichte zu aggressiv, können die Modell-Ausgaben explodieren oder oszillieren; ändern sie sich zu langsam, dauert das Training ewig oder bleibt stecken. Hier stützen sich die Autoren auf die Lyapunov-Stabilitätstheorie, einen mathematischen Rahmen, der ursprünglich zur Analyse der Sicherheit physikalischer Systeme entwickelt wurde. Sie konstruieren eine spezielle, energieähnliche Funktion, die Modellfehler und die Größe der Netzwerkparameter kombiniert. Indem sie sorgfältig ableiten, wie sich diese Funktion im Laufe der Zeit ändert, erhalten sie automatische Regeln zur Aktualisierung der Netzwerkgewichte und internen Parameter, sodass die Gesamt-„Energie“ nur abnehmen kann. Das liefert adaptive Lernraten, die sich selbst beschleunigen oder verlangsamen und Konvergenz garantieren, ohne manuelles Feinjustieren.

Das neue Netz auf die Probe stellen

Um zu zeigen, dass DRQNN-LS mehr als eine elegante Idee auf dem Papier ist, testen die Autoren es an drei sehr unterschiedlichen Aufgaben. Zuerst modellieren sie ein mathematisches nichtlineares System mit bekanntem Verhalten und prüfen, wie genau das Netz dessen Ausgabe nachverfolgen kann. Dann bearbeiten sie die chaotische Henon-Abbildung, ein klassisches Benchmark, bei dem winzige Änderungen der Anfangsbedingungen stark abweichende Trajektorien erzeugen können. Drittens wenden sie die Methode auf reale Daten eines kleinen Gleichstrommotors an, eines verrauschten, praktischen Geräts, dessen interne Vorgänge nicht vollständig bekannt sind. In jedem Fall vergleichen sie den neuen Ansatz mit mehreren bestehenden neuronalen Modellen, darunter klassische diagonale rekurrente Netze und frühere quanten-inspirierte Varianten, die mit einfacheren Gradientenschätzern trainiert wurden.

Bessere Genauigkeit, Robustheit und Rauschresistenz

Über alle drei Beispiele hinweg liefert DRQNN-LS konsistent geringere Vorhersagefehler und eine bessere Anpassung an die echten Signale als die konkurrierenden Methoden, selbst wenn die Daten absichtlich mit erheblichem Rauschen beeinträchtigt werden. Zwar erfordert das neue Modell pro Schritt etwas mehr Rechenaufwand – da es rekurrente, quanteninspirierte Zustände verfolgt und die Lyapunov-basierten Updates auswertet – die Laufzeiten bleiben jedoch auf modernen Prozessoren gering genug für den Echtzeitbetrieb. Die Ergebnisse deuten darauf hin, dass die Kombination aus einer gestrafften Rekurrenzstruktur, quantenartigen Neuronzuständen und mathematisch garantierter stabiler Lernregel ein leistungsfähiges und praktisch einsetzbares Werkzeug zum Verständnis und zur Vorhersage nichtlinearer Dynamik in der realen Welt ergibt.

Was das für die Zukunft bedeutet

Für Nicht-Spezialisten lautet die Kernaussage: Wir lernen, wie man intelligentere, vertrauenswürdigere digitale Zwillinge unordentlicher physikalischer Systeme baut. DRQNN-LS bietet einen Weg, einer Maschine zu erlauben, das Verhalten eines komplexen Prozesses direkt aus Daten zu erlernen und gleichzeitig sicherzustellen, dass ihr Lernen nicht „explodiert“ oder sich unvorhersehbar verhält. Diese Kombination aus Flexibilität und Stabilität könnte in Bereichen von industrieller Steuerung und Robotik über Energiesysteme bis hin zur biologischen oder medizinischen Modellierung wertvoll sein, wo nichtlineares Verhalten und verrauschte Messdaten die Norm sind.

Zitation: Khalil, H., Elshazly, O. & Shaheen, O. Stable approach based diagonal recurrent quantum neural networks for identification of nonlinear systems. Sci Rep 16, 8274 (2026). https://doi.org/10.1038/s41598-026-37973-2

Schlüsselwörter: Identifikation nichtlinearer Systeme, Quanten-Neuronales Netz, Rekursives Neuronales Netz, Lyapunov-Stabilität, Modellierung chaotischer Dynamik