Clear Sky Science · de

Ein Deep‑Learning‑Framework zur Brustkrebsdiagnose mit Swin Transformer und Dual‑Attention Multi‑scale Fusion Network

Warum das für Patientinnen und Ärzte wichtig ist

Brustkrebs ist eine der häufigsten Krebserkrankungen bei Frauen, und Mammogramme sind das wichtigste Instrument, um ihn früh zu entdecken. Dennoch ist das Lesen dieser Röntgenbilder schwierig, selbst für Fachleute, und kleine Warnsignale können übersehen werden. Diese Studie stellt ein neues System der künstlichen Intelligenz (KI) vor, das Radiologinnen und Radiologen zuverlässiger beim Erkennen von Brustkrebs unterstützen soll, indem es zwei leistungsfähige Sichtweisen auf Mammogramme kombiniert: eine, die das große Ganze erfasst, und eine, die winzige Details heranzoomt.

Die Herausforderung: sowohl den Wald als auch die Bäume sehen

Moderne KI‑Systeme unterstützen bereits beim Lesen medizinischer Bilder, doch die meisten beruhen auf einem einzigen Modelltyp. Convolutional Neural Networks sind gut darin, lokale Muster wie scharfe Kanten oder kleine helle Flecken zu erkennen. Vision Transformer, eine neuere Modellfamilie, sind stark darin, Beziehungen über das gesamte Bild hinweg zu erfassen. Mammogramme erfordern jedoch beide Fähigkeiten gleichzeitig: Krebs kann sich als winzige Verkalkungen oder subtile Verzerrungen zeigen, doch ihre Bedeutung hängt davon ab, wie diese Zeichen in die Gesamtstruktur der Brust passen. Gleichzeitig sind reale Mammographie‑Datensätze relativ klein und oft unausgewogen, mit deutlich weniger Krebsfällen als normalen Untersuchungen, was es KI‑Systemen leicht macht, zu überanpassen oder verzerrt zu werden.

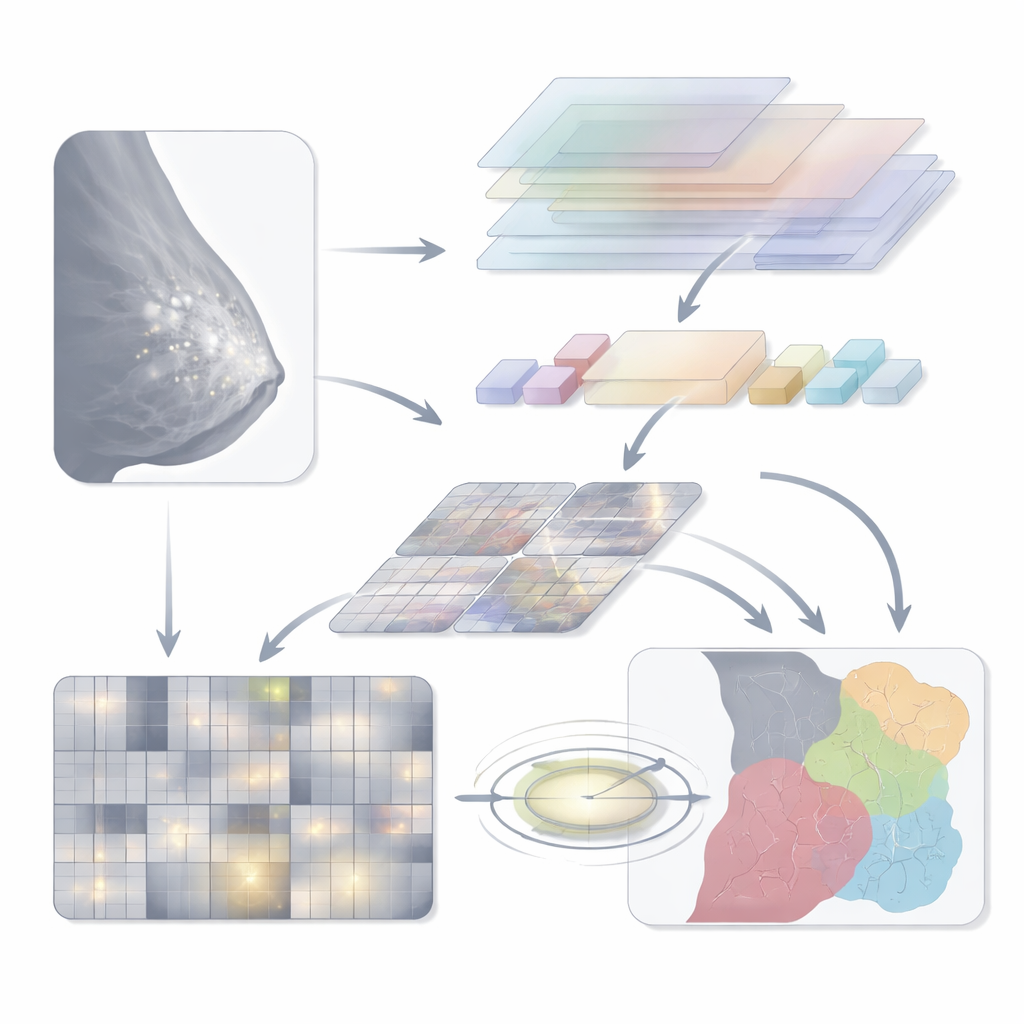

Ein zweigleisiges KI‑Modell, das weit sieht und tief hineinzoomt

Die Autorinnen und Autoren stellen ein hybrides Modell vor, das sie Swin‑DAMFN nennen und das explizit dafür entwickelt wurde, globale und lokale Sichtweisen zu verschmelzen. Ein Zweig basiert auf dem Swin Transformer, der das Mammogramm in Fenster unterteilt und einen Aufmerksamkeitsmechanismus nutzt, um langfristigen Kontext zu erfassen – also wie verschiedene Bereiche der Brust zueinander in Beziehung stehen. Der zweite Zweig ist ein maßgeschneidertes Faltungsnetzwerk, das Dual‑Attention Multi‑scale Fusion Network (DAMFN). Dieser Zweig ist darauf abgestimmt, extrem feine Details wie Mikroverkalkungen und leichte Gewebeverzerrungen aufzunehmen. Innerhalb dieses Zweigs analysieren spezialisierte Blöcke das Bild in mehreren Skalen und Richtungen und nutzen dann Attention‑Module, um Regionen zu betonen, die klinisch am informativsten erscheinen, während Hintergrundgewebe weniger gewichtet wird.

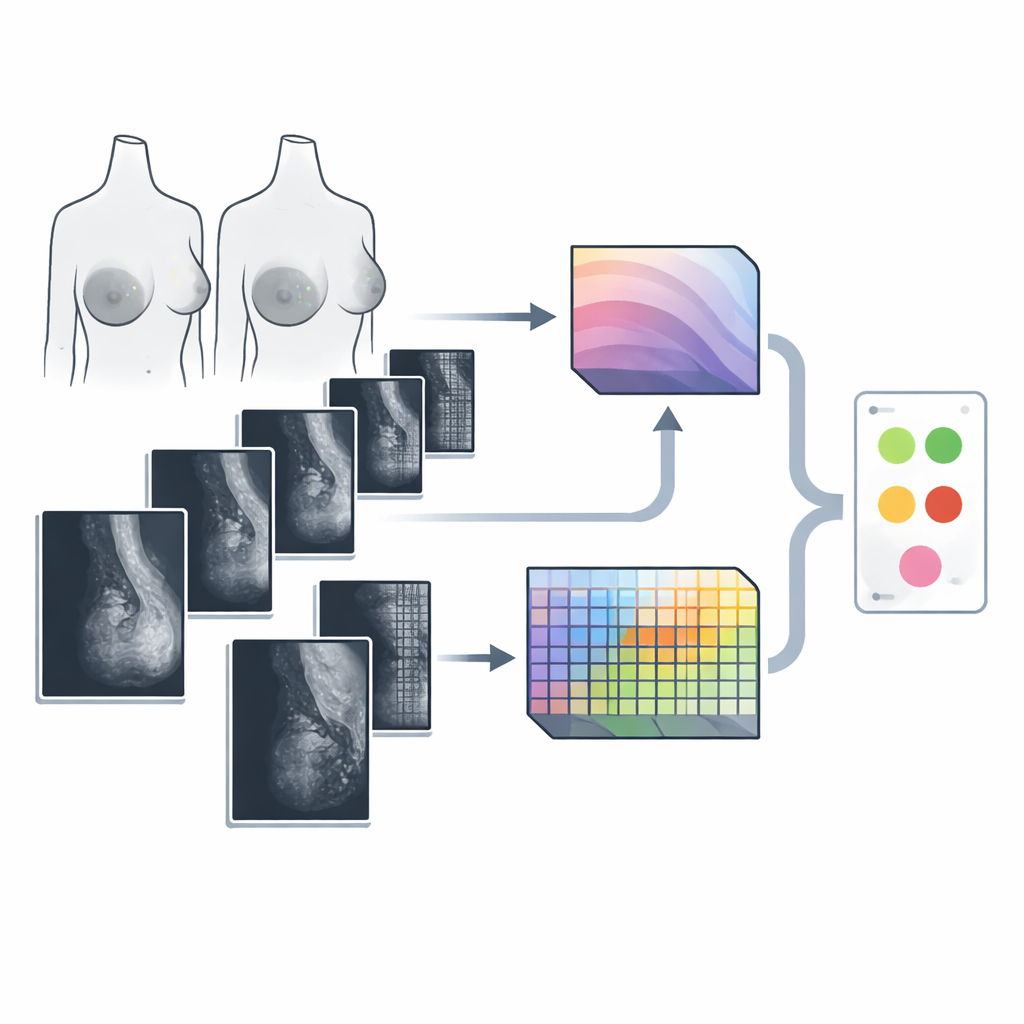

Das System mit mehr und reichhaltigeren Bildern trainieren

Da reale Mammographie‑Datensätze begrenzt sind und zugunsten nicht‑maligner Fälle verzerrt sind, stärkten die Forschenden die Trainingsdaten auf zwei komplementäre Weisen. Erstens nutzten sie einen Typ generativer Modelle, einen conditional GAN, um realistische Mammogramm‑Patches zu synthetisieren, insbesondere für unterrepräsentierte maligne Kategorien. Diese erzeugten Bilder helfen, die Klassen auszugleichen und das Modell mit mehr Variationen des Krankheitsbilds vertraut zu machen. Zweitens wendeten sie photometrische Veränderungen an – kleine, zufällige Anpassungen in Helligkeit, Kontrast und Schärfe – auf sowohl reale als auch synthetische Bilder. Das zwingt die KI dazu, sich auf echte anatomische Muster statt auf oberflächliche Beleuchtungs‑ oder Rauschunterschiede zu konzentrieren und verbessert ihre Fähigkeit, auf neue Aufnahmen zu generalisieren.

Wie die Teile während der Diagnose zusammenwirken

Bei der Analyse wird ein vorverarbeitetes Mammogramm gleichzeitig in beide Zweige eingespeist. Der Swin Transformer erzeugt eine kompakte Zusammenfassung der globalen Struktur, während DAMFN eine reichhaltige Karte lokaler Merkmale ausgibt. Diese werden anschließend in der Größe angeglichen und zu einer einzigen Repräsentation verschmolzen. Ein leichter „Triplet Attention“‑Block verfeinert diese Fusion zusätzlich, indem er Kanäle und räumliche Dimensionen wechselseitig überprüft und die Modellaufmerksamkeit auf Bereiche lenkt, die am wahrscheinlichsten Krankheit enthalten. Abschließend fasst ein einfacher Klassifikationskopf die Informationen zusammen und erstellt eine Vorhersage über mehrere Klassen hinweg, etwa normales Gewebe, gutartige Befunde oder verschiedene Arten maligner Läsionen.

Was die Ergebnisse in der Praxis bedeuten

Das Team testete Swin‑DAMFN auf zwei weit verbreiteten öffentlichen Datensätzen, CBIS‑DDSM und MIAS, und verglich es mit vielen populären Deep‑Learning‑Modellen. Ihr System erreichte etwa 99 % Genauigkeit auf CBIS‑DDSM und nahezu 99 % auf MIAS, mit ähnlich hoher Sensitivität (Fähigkeit, Krebserkrankungen zu erfassen) und Spezifität (Vermeidung falscher Alarme). Sorgfältige Ablationsstudien zeigten, dass jede Komponente – die dualen Zweige, die auf Attention basierende Fusion und die Datenaugmentationsstrategie – zu diesen Verbesserungen beitrug. Obwohl die Autorinnen und Autoren darauf hinweisen, dass weitergehende Tests an vielfältigen klinischen Daten noch nötig sind, deuten die Ergebnisse darauf hin, dass hybride KI‑Systeme wie Swin‑DAMFN wertvolle Assistenten im Brustkrebs‑Screening werden könnten, indem sie Radiologinnen und Radiologen helfen, gefährliche Läsionen früher und konstanter zu erkennen und gleichzeitig Arbeitsbelastung und Unsicherheit zu reduzieren.

Zitation: Aldawsari, M.A., Aldosari, S.J., Ismail, A. et al. A deep learning framework for breast cancer diagnosis using Swin Transformer and Dual-Attention Multi-scale Fusion Network. Sci Rep 16, 8941 (2026). https://doi.org/10.1038/s41598-026-37969-y

Schlüsselwörter: Brustkrebs, Mammographie, Deep Learning, Transformer‑Modelle, KI in der medizinischen Bildgebung