Clear Sky Science · de

Echtzeit‑Objekterkennung für unbemannte Luftfahrzeuge basierend auf Vision Transformer und Edge Computing

Klügere Augen am Himmel

Unbemannte Luftfahrzeuge – Drohnen – werden zunehmend zu alltäglichen Werkzeugen für Aufgaben wie Brückeninspektion, Verkehrsüberwachung und die Suche nach Vermissten. Damit eine Drohne in diesen zeitkritischen Einsätzen wirklich hilfreich ist, muss sie mehr tun, als nur die Umgebung zu filmen: Sie muss winzige Objekte in Echtzeit erkennen können, während sie mit begrenzter Batterie und einem kleinen Bordcomputer fliegt. Dieses Papier stellt eine neue Methode vor, Drohnen schärfere und schnellere „Augen“ zu verleihen, indem eine fortschrittliche KI‑Technik namens Vision Transformer mit dem gezielten Einsatz nahegelegener Edge‑Computer kombiniert wird, sodass kleine Objekte wie Fußgänger, Fahrräder und Autos aus der Luft schnell und zuverlässig erkannt werden können.

Warum es für Drohnen schwierig ist, kleine Details zu sehen

Aus großer Höhe können Menschen und Fahrzeuge auf nur wenige Dutzend Pixel in einem Videoframe schrumpfen. Traditionelle neuronale Netze, die auf Drohnen eingesetzt werden, sind darauf ausgelegt, schnell auf stromsparenden Chips zu laufen, übersehen aber oft diese winzigen Objekte oder versagen bei wechselnden Lichtverhältnissen oder Blickwinkeln. Neuere Vision‑Transformer‑Modelle, ursprünglich aus der Sprachverarbeitung adaptiert, sind deutlich besser darin, die gesamte Szene gleichzeitig zu verstehen und kleine Details aus unruhigem Hintergrund herauszulösen. Der Haken ist, dass sie in der Regel enorme Rechenleistung benötigen, weit über das hinaus, was eine fliegende Plattform mitführen kann. Die Autoren wollten diese Lücke schließen: die scharfe Sicht des Transformers bewahren, ihn aber so verschlanken, dass er in Echtzeit auf einer Drohne läuft, und zusätzliche Arbeit nur dann an einen nahegelegenen Edge‑Server auslagern, wenn die Bedingungen es erlauben.

Ein geteilter Kopf: Drohne und Edge arbeiten zusammen

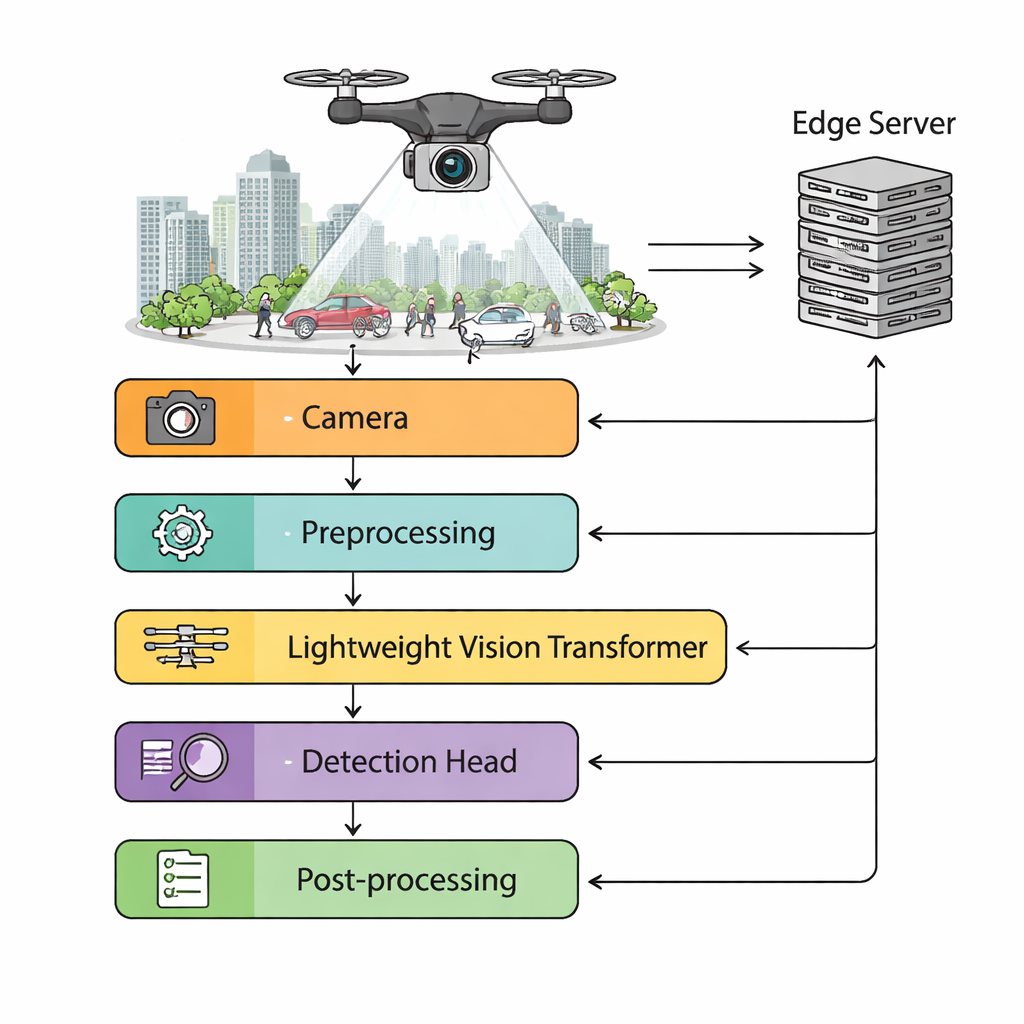

Das vorgeschlagene Framework teilt die Aufgaben zwischen der Drohne und einem bodengestützten Edge‑Computer auf. Die Kamera der Drohne streamt hochauflösendes Video in ein an Bord befindliches Vorverarbeitungsmodul, das verwackeltes Material stabilisiert, die Helligkeit anpasst und Bilder dynamisch skaliert, je nachdem, wie viel Rechenleistung verfügbar ist. Ein leichter Vision Transformer extrahiert dann reichhaltige Merkmale aus jedem Frame und speist einen Erkennungs‑Kopf, der vorhersagt, wo Objekte sind und was sie sind. Ein Scheduler überwacht drahtlose Netzwerkverzögerungen, Batteriestand und Auslastung. Ist die Verbindung zum Boden schnell und stabil, können schwerere Aufgaben – etwa die Verarbeitung von Frame‑Batches oder das Ausführen zusätzlicher genauigkeitssteigernder Modelle – an den Edge‑Server ausgelagert werden. Verschlechtert sich die Verbindung, schaltet das System automatisch auf vollständig autonome Onboard‑Verarbeitung um, sodass die Drohne niemals „blind“ fliegen muss.

Das Modell zuschneiden, ohne seine Sicht zu verlieren

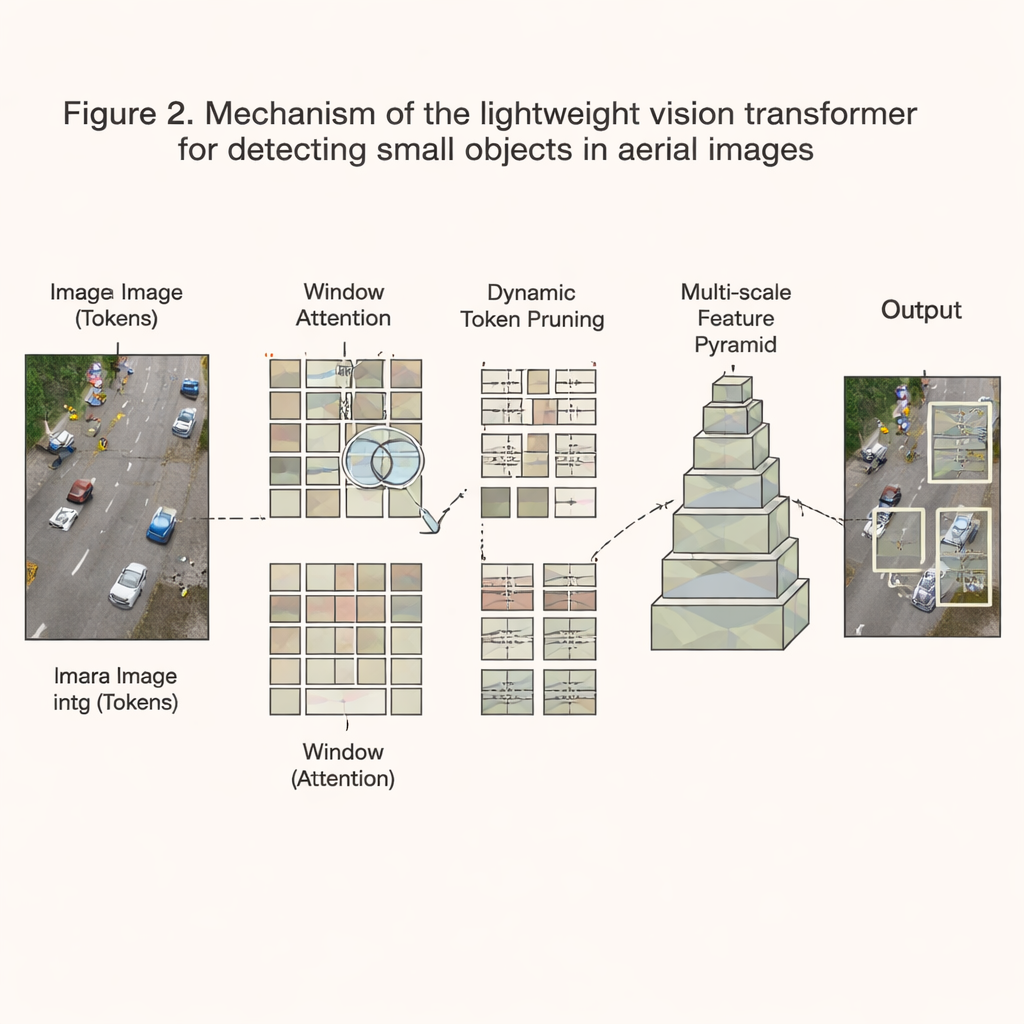

Um den Transformer klein und schnell genug zu machen, überarbeiten die Autoren seine interne Struktur. Anstatt jedem Bildteil zu erlauben, sich mit jedem anderen zu vergleichen – ein Prozess, der mit der Auflösung explosionsartig zunimmt – beschränken sie die Aufmerksamkeit auf lokale Fenster, die über das Bild gleiten, wodurch die Rechenkosten auf ein beherrschbares Niveau sinken. Darüber hinaus bewertet ein dynamisches Pruning‑Schema ständig, welche Bildregionen nützliche Informationen enthalten und welche überwiegend leerer Hintergrund sind. Als uninformativ eingestufte Token werden frühzeitig verworfen, was Zeit und Speicher spart, während komplexe, unruhige Szenen mehr Details behalten. Das Modell baut außerdem eine mehrskalige Merkmals‑Pyramide auf, sodass sowohl winzige Fußgänger als auch größere Fahrzeuge im selben Frame erkannt werden können. In Kombination mit sorgfältiger Quantisierung (mit weniger Bits pro Zahl), Kanal‑Pruning und niedrigstufigen Software‑Optimierungen reduzieren diese Änderungen den Rechenaufwand um etwa zwei Drittel bei Erhalt von über 94 % der ursprünglichen Genauigkeit.

Das System auf die Probe gestellt

Das Team bewertet sein Design anhand eines großen Luftbilddatensatzes, der aus öffentlichen Drohnen‑Benchmarks und tausenden neu erfassten Bildern über Städte, Vororte und ländliche Gebiete in verschiedenen Jahreszeiten und Lichtverhältnissen zusammengestellt wurde. Auf einem populären Embedded‑Computer, der in Drohnen verwendet wird – dem NVIDIA Jetson Xavier NX – läuft ihr System mit etwa 39 Bildern pro Sekunde, schnell genug für den Echtzeitbetrieb, und erzielt gleichzeitig höhere Genauigkeit als weit verbreitete leichte Detektoren wie Varianten von YOLO. Insbesondere ist es deutlich besser beim Erkennen kleiner Objekte und erzielt einen Zugewinn in der mittleren Präzision von etwa sieben Prozentpunkten gegenüber herkömmlichen konvolutionalen Netzwerken. Wöchige Feldversuche auf einer kommerziellen Drohnenplattform zeigen, dass das System die Leistung trotz Kameravibration, wechselnder Beleuchtung und schwankender Funkverbindungen aufrechterhält und dass es während realer Flüge nahtlos zwischen edge‑unterstützten und vollständig an Bord laufenden Modi wechseln kann.

Was das für praktische Drohnenmissionen bedeutet

Kurz gesagt zeigt diese Arbeit, dass es möglich ist, Drohnen schärfere und zuverlässigere Sicht zu geben, ohne ihnen einen rechenzentrumstarken Computer anzuhängen. Durch das Neuentwerfen des Vision Transformers, das selektive Fokussieren auf die informativsten Bildbereiche und die Kombination der Drohne mit einem nahegelegenen Edge‑Server, wenn möglich, liefern die Autoren einen Detektor, der mehr sieht, weniger verpasst und dennoch in Echtzeit innerhalb enger Leistungs‑ und Speichervorgaben läuft. Das macht Einsätze wie Suche und Rettung, Katastrophenbewertung und Infrastrukturinspektion sicherer und effektiver, weil Drohnen kritische kleine Details – etwa eine gestrandete Person oder ein beschädigtes Kabel – besser erkennen können, genau dann, wenn jede Sekunde zählt.

Zitation: Zhu, W., Chen, K. Real-time object detection for unmanned aerial vehicles based on vision transformer and edge computing. Sci Rep 16, 6814 (2026). https://doi.org/10.1038/s41598-026-37938-5

Schlüsselwörter: Drohnen, Objekterkennung, Edge Computing, Vision Transformer, Echtzeit‑Bildgebung