Clear Sky Science · de

Eine leichte Methode auf Basis von YOLOv8n zur Erkennung abnormer Körperhaltungen

Warum das Erkennen ungewöhnlicher Körperhaltungen wichtig ist

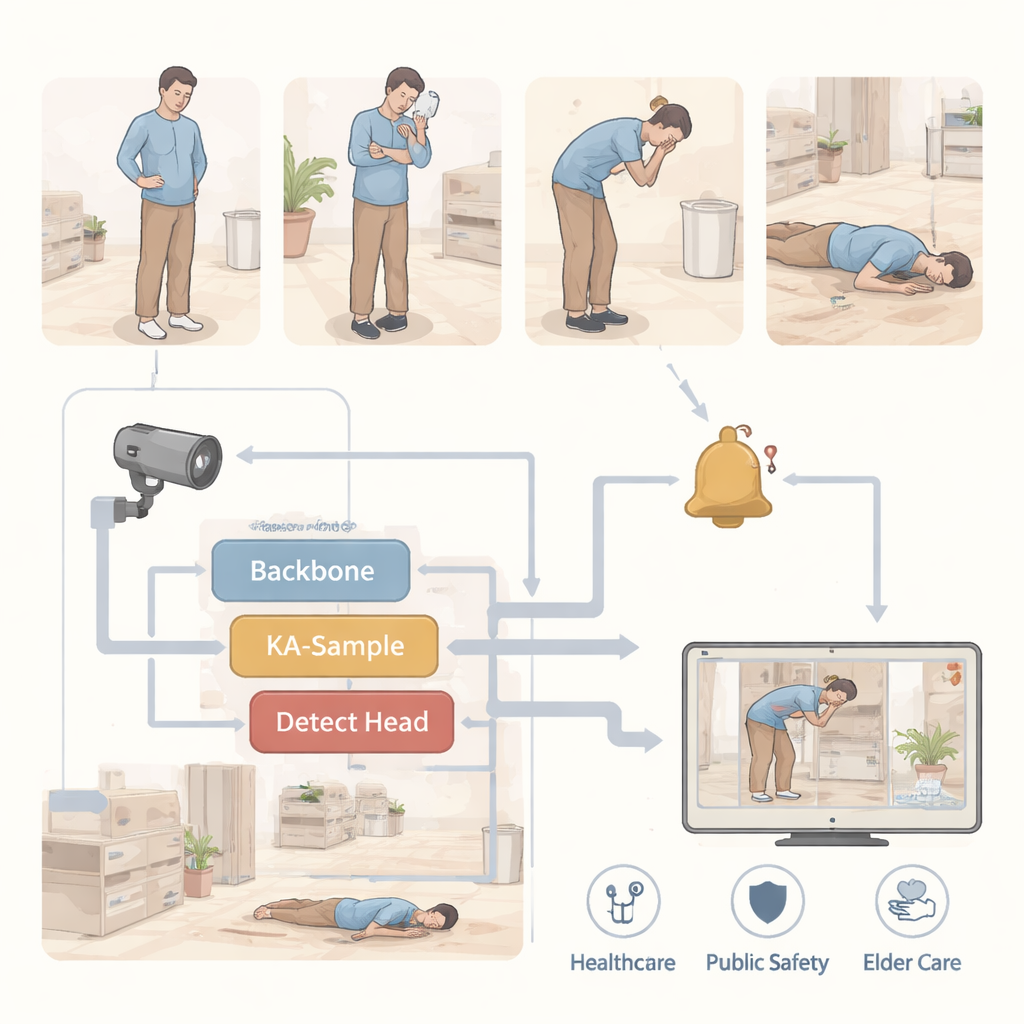

Stürze, plötzliche Brustschmerzen oder das Zusammenbrechen einer Person auf dem Flur ereignen sich oft in Sekunden, und wenn niemand in der Nähe ist, kann Hilfe zu spät kommen. Dieses Papier stellt ein kompaktes System auf Basis künstlicher Intelligenz vor, das gewöhnliche Videoaufnahmen von Sicherheits- oder Pflegeheimkameras in Echtzeit überwachen und gefährliche, abnorme Haltungen automatisch melden kann. Indem die Software sowohl genau als auch ressourcenschonend gestaltet wird, zielen die Forscher darauf ab, zuverlässige Sturz- und Gesundheitsereigniserkennung auf alltägliche Geräte zu bringen – von Krankenhausmonitoren bis zu preiswerten Kameras in Wohnungen älterer Menschen.

Von einfachen Kameras zu aufmerksamerer Beobachtung

Moderne Überwachungssysteme nutzen bereits Computer Vision, um Personen zu erkennen und ihre Bewegungen zu verfolgen, aber ungewöhnliche Haltungen sind besonders schwer zu identifizieren. Eine Person kann sehr unterschiedlich aussehen, wenn sie steht, sich die Brust hält, erbricht oder auf dem Boden liegt; diese Ereignisse sind kurz, vielfältig und oft teilweise durch Möbel verdeckt oder bei schlechten Lichtverhältnissen schwer zu sehen. Bestehende Algorithmen können recht genau sein, sind aber häufig groß und langsam, benötigen leistungsstarke Hardware und sorgfältiges Tuning. Die Autoren konzentrieren sich darauf, die Erkennung sowohl schnell als auch sparsam im Rechenaufwand zu machen, sodass sie auf gängigen Grafikkarten oder sogar eingebetteten Geräten laufen kann, ohne Zuverlässigkeit einzubüßen.

Ein schlankeres „Gehirn“ zur Erkennung riskanter Posen

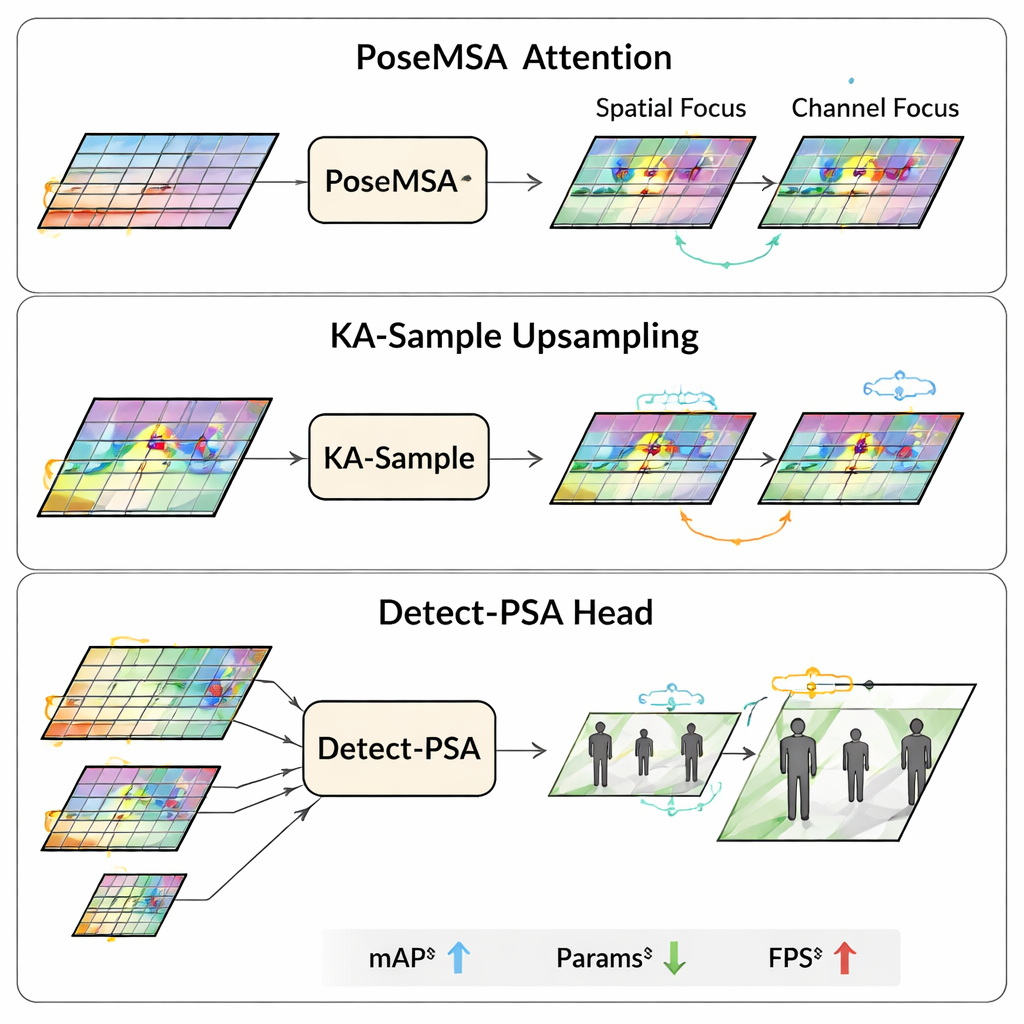

Kern der Arbeit ist eine verbesserte Version eines populären Objekterkennungsmodells namens YOLOv8n. Die Forscher entwickeln eine leichtere, fokussiertere Variante, die sie PSD‑YOLOv8n nennen. Zunächst fügen sie ein neues Aufmerksamkeitsmodul namens PoseMSA hinzu, das dem Netzwerk hilft, sich auf die informativsten Bereiche des Körpers einer Person zu konzentrieren und zugleich unruhige Hintergründe zu ignorieren. Das Modul arbeitet mit schlanken Operationen, die sowohl über das Bild hinweg als auch durch verschiedene Merkmalsebenen schauen, wodurch die für die Haltung relevanten Signale verstärkt werden, während die Anzahl der Berechnungen gering bleibt. Zweitens überarbeiten sie, wie das Modell Details »heranzoomen« kann, durch einen KA‑Sample Upsampling‑Block, der lernt, Bereiche um wichtige Körperpunkte – wie Kopf, Rumpf und Gliedmaßen – zu schärfen, sodass verdrehte oder zusammengebrochene Haltungen klarer hervortreten.

Scharfere Boxen und klarere Entscheidungen

Da abnorme Haltungen häufig mit der Umgebung verschwimmen – denken Sie an eine Person, die teilweise unter einem Tisch liegt – überarbeiten die Autoren auch die finale Entscheidungsstufe, den sogenannten Detection Head. Ihr Detect‑PSA Modul verbindet Informationen aus mehreren Skalen und verwendet eine wahrscheinlichkeitstheoretische Methode zur Bestimmung von Begrenzungsrahmen. Anstatt einen einzelnen harten Rand zu raten, an dem eine Person beginnt und endet, stellt das System jede Seite der Box als kleine Verteilung wahrscheinlicher Positionen dar und mittelt diese dann. Dieser Ansatz macht die Konturen stabiler, wenn Gliedmaßen verkürzt, verdeckt oder längs des Bodens gestreckt sind, und führt zu Boxen, die in schwierigen Szenen den menschlich erstellten Referenzdaten näher kommen.

Das System wird in der Praxis geprüft

Um zu testen, wie gut ihr Entwurf in der Praxis funktioniert, erstellte das Team eine eigene Bildsammlung, das SSHDataset, aufgebaut aus Innenvideos mit mehreren Blickwinkeln, die Personen in vier Zuständen zeigen: normal, Brustschmerzen, Erbrechen und Sturz. Nach sorgfältiger Handannotation und Datenaugmentierung trainierten sie PSD‑YOLOv8n neben einer Reihe konkurrierender Modelle unter identischen Bedingungen. Nach gängigen Genauigkeitsmaßen erreichte ihre Methode eine Trefferquote von 97,8 % bei einem üblichen Überlappungsschwellenwert und behielt auch unter strengeren Kriterien eine starke Leistung bei. Zugleich verwendete sie nur etwa zwei Millionen Parameter und eine 4,5‑Megabyte große Gewichtsdatei – ungefähr ein Drittel weniger Parameter und über ein Drittel weniger Rechenaufwand als das ursprüngliche YOLOv8n – und lief mit mehr als 80 Bildern pro Sekunde. Tests auf einem unabhängigen öffentlichen Sturzerkennungsdatensatz zeigten, dass sich die Verbesserungen auf neue Daten übertragen ließen, mit besonders deutlichen Verbesserungen beim Erkennen tatsächlicher Stürze.

Was das für die alltägliche Sicherheit bedeutet

Vereinfacht gesagt liefert die Studie einen kompakten digitalen „Rettungsschwimmer“, der Live‑Video beobachten und zuverlässig bemerken kann, wenn die Körperhaltung einer Person auf ein Problem hindeutet. Durch das gezielte Überarbeiten, wie das Modell sich auf Körperregionen fokussiert, feine Details rekonstruiert und Personen mit Boxen umgibt, erreichen die Autoren eine seltene Kombination aus hoher Genauigkeit, Geschwindigkeit und kleiner Größe. Ein solches System könnte in Krankenhausmonitoren, Smart‑Home‑Hubs oder Kameras im öffentlichen Raum eingebettet werden, um rechtzeitig Alarme bei Stürzen oder plötzlichen Notfällen auszulösen – selbst in unaufgeräumten Räumen und bei unterschiedlicher Beleuchtung. Wenn der Ansatz weiter verfeinert und auf längere Videosequenzen sowie neue Umgebungen ausgeweitet wird, könnte er die Grundlage für eine neue Generation leiser, ständig aktiver Wächter bilden, die gefährdete Menschen sicherer machen, ohne ständige menschliche Überwachung zu erfordern.

Zitation: Li, G., Zhang, J., Ji, Q. et al. A lightweight YOLOv8n-based method for human abnormal posture detection. Sci Rep 16, 7222 (2026). https://doi.org/10.1038/s41598-026-37903-2

Schlüsselwörter: Sturzerkennung, Menschliche Haltung, Computer Vision, leichte KI, Altenpflege