Clear Sky Science · de

Echtzeit-Industrielle Sicherheitsautomatisierung mit YOLO-Architekturen unter Nutzung unterschiedlicher chromatischer Domänen

Schlauere Augen auf dem Fabrikboden

Verborgene Mängel in Metall schweißnähten können robuste Maschinen, Brücken oder Pipelines in schleichende Gefahren verwandeln. Üblicherweise blicken geschulte Prüfer auf glühende Metallnähte und versuchen, winzige Risse oder Lücken zu entdecken, bevor sie zu Unfällen führen. Diese Arbeit untersucht, wie künstliche Intelligenz einen Großteil dieser Überwachungsaufgabe übernehmen kann, indem sie schnelle Bild-Erkennungssoftware nutzt, um Schweißnähte in Echtzeit zu prüfen, selbst wenn Teile auf einem Förderband vorbeilaufen. Durch den Vergleich mehrerer Versionen eines populären KI-Detektors namens YOLO und die Untersuchung, wie verschiedene Farbrepräsentationen dessen Wahrnehmung beeinflussen, zeigen die Forschenden einen Weg zu sichereren, effizienteren Fabriken auf.

Warum das Erkennen schlechter Schweißnähte so schwierig ist

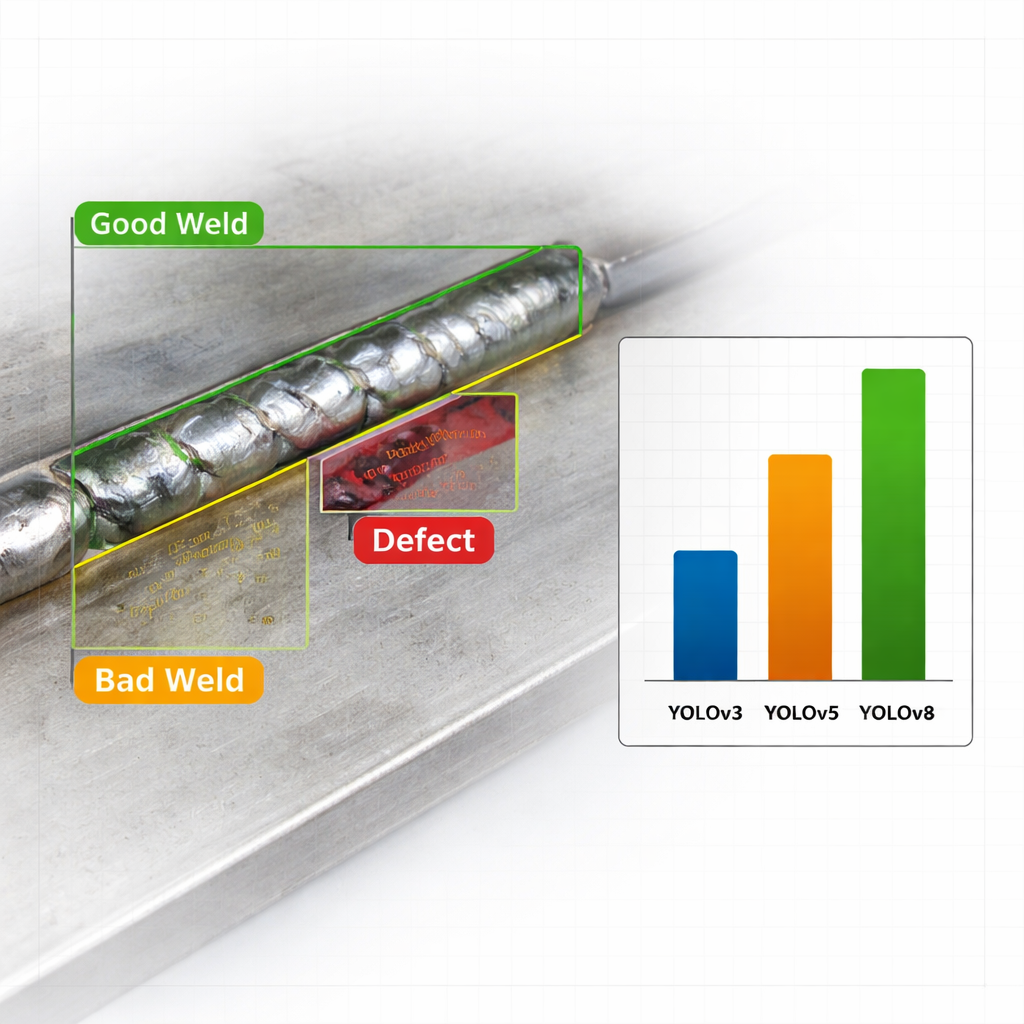

Auf einer stark frequentierten Produktionslinie variieren Schweißnähte in Form, Glanz und Hintergrundunordnung. Ein einzelnes Bild kann mehrere Nähte und Defekte enthalten, wodurch eine einfache Bildklassifikation („gut“ oder „schlecht“ insgesamt) zu grob wäre. Stattdessen muss das System spezifische Problembereiche entlang einer Naht finden und kennzeichnen. Die Autorinnen und Autoren konzentrieren sich auf drei praxisrelevante Kategorien – gute Schweißnaht, schlechte Schweißnaht und offensichtlicher Defekt –, weil jede eine andere Reaktion erfordert, von der Annahme eines Teils bis hin zur sofortigen Nacharbeit. Sie verwenden einen öffentlich verfügbaren Datensatz mit mehr als sechstausend annotierten Schweißnahtbildern, wodurch sichergestellt ist, dass die KI an einer realistischen Bandbreite an Oberflächen, Lichtverhältnissen und Fehlerarten trainiert und getestet wird.

Maschinen beibringen, einmal hinzuschauen und zu entscheiden

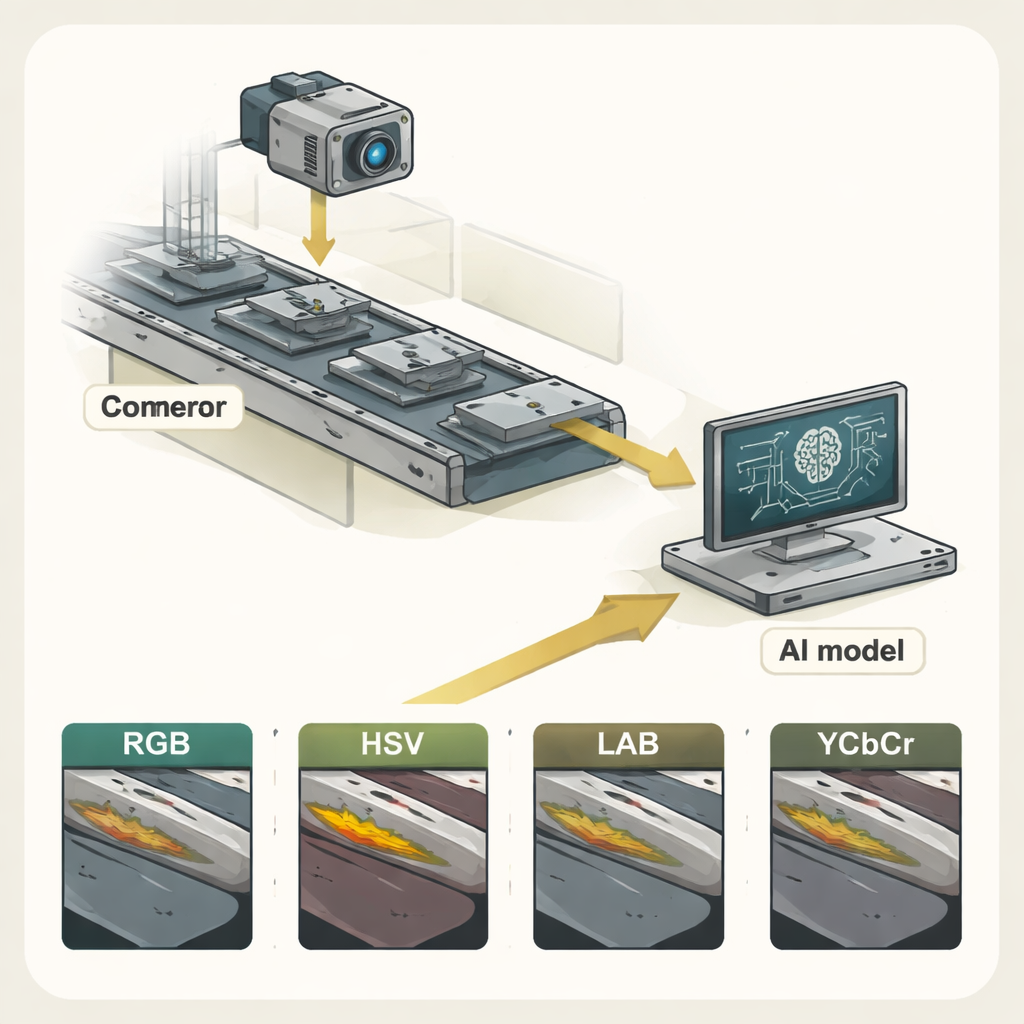

Die Studie konzentriert sich auf die YOLO-Familie („You Only Look Once“) von Objekterkennungsmodellen, die dafür bekannt sind, ein Bild in einem Durchgang zu scannen und um gefundene Objekte Begrenzungsrahmen zu zeichnen. Die Forschenden vergleichen drei Generationen: YOLOv3, YOLOv5 und das neueste YOLOv8. Jede Version verbessert Geschwindigkeit und Genauigkeit durch tiefere Netze und intelligentere Trainingsstrategien. Um die Beleuchtungsherausforderungen realer Fabriken besser nachzubilden, wandelt das Team zudem jedes Schweißnahtbild in vier verschiedene Farbräume um – RGB (das vertraute Rot–Grün–Blau), HSV, LAB und YCbCr – und trainiert separate Modelle für jeden. Dieser multispektrale Ansatz erlaubt die gezielte Frage: Hilft eine andere Farbcodierung der KI, Defekte klarer zu erkennen?

Farbe, Geschwindigkeit und Genauigkeit in Aktion

Über alle Experimente hinweg zeichnet sich ein Muster ab: Das neueste Modell, YOLOv8, übertrifft seine Vorgänger. Wenn es auf Standard-RGB-Bildern trainiert wird, erreicht YOLOv8 eine normalisierte mittlere durchschnittliche Präzision (mAP@0.5) von 0,592, deutlich höher als YOLOv3 und YOLOv5 unter denselben Bedingungen. Praktisch bedeutet das, dass es sowohl besser darin ist, Schweißbereiche zu finden, als auch diese korrekt zu kennzeichnen. Das Modell ist außerdem außerordentlich schnell und verarbeitet auf einer modernen Grafikkarte etwa 138 Bilder pro Sekunde – weit oberhalb der häufig als Echtzeitmaß geltenden 30 Bilder pro Sekunde. Unter den Farbräumen liefert RGB durchgängig die stärksten Ergebnisse für alle drei YOLO-Versionen, während HSV, LAB und YCbCr zurückbleiben. Diese alternativen Codierungen können bestimmte visuelle Merkmale hervorheben, überwiegen in diesem Setting jedoch nicht die Einfachheit und Informationsgehalt von RGB.

Von Labortests bis an den Fertigungsrand

Um die Realisierbarkeit in der Praxis zu demonstrieren, setzen die Autorinnen und Autoren ein gestrafftes YOLOv8-Modell auf einem Raspberry-Pi-basierten Edge-Gerät ein, das mit einem Förderband und einer Kamera verbunden ist. Während verschweißte Teile unter der Linse vorbeifließen, erfasst das System Frames, bereinigt sie durch grundlegende Vorverarbeitung und führt die Erkennung lokal aus, wobei jede Naht als gut, schlecht oder defekt klassifiziert wird. Ergebnisse werden in einer Datenbank protokolliert und auf einem Dashboard für Prüfer angezeigt, die Live-Fehlermarker und langfristige Qualitätsentwicklungen sehen können. Darüber hinaus kann das Framework Empfehlungen generieren, etwa Anpassungen der Schweißgeschwindigkeit oder -spannung vorschlagen oder darauf hinweisen, wann aufgrund wiederkehrender Defekte Wartungsarbeiten am Equipment nötig sein könnten.

Was das für sicherere Fertigung bedeutet

Für Laien ist das wichtigste Ergebnis klar: Diese Arbeit zeigt, dass ein leichtgewichtiges, modernes KI-Modell zuverlässig und sehr schnell riskante Schweißnähte unter realen industriellen Bedingungen erkennen kann, insbesondere bei Verwendung gewöhnlicher RGB-Kamerabilder. YOLOv8 erweist sich als genau genug, um eindeutig schlechte Schweißnähte zu unterscheiden, und schnell genug, um mit Hochgeschwindigkeits-Produktionslinien Schritt zu halten, und das alles auf bescheidener Hardware nahe an den Maschinen. Die Autorinnen und Autoren argumentieren, dass diese Form der automatisierten, farbempfindlichen Inspektion menschliche Fehler reduzieren, Probleme früher aufspüren und zu sichererer, konstanterer Fertigung beitragen kann. Zukünftige Verfeinerungen – etwa reichhaltigere Trainingsdaten und verbesserter Umgang mit subtileren Defektarten – könnten diese digitalen Prüfer zu einem alltäglichen Bestandteil der Industriesicherheit machen.

Zitation: Pati, N., Sharma, A., Gourisaria, M.K. et al. A real-time industrial safety automation using YOLO architectures leveraging diverse chromatic domains. Sci Rep 16, 7253 (2026). https://doi.org/10.1038/s41598-026-37869-1

Schlüsselwörter: Schweißnaht-Fehlererkennung, Automatisierung der Industriesicherheit, YOLOv8, Echtzeit-Computer-Vision, Edge-AI