Clear Sky Science · de

Tiefenverstärkendes Lernen gesteuerte Multi-Ziel-Optimierung und ihre Anwendungen auf Betriebs- und Wartungsstrategien für Beleuchtungsinfrastruktur

Intelligentere Beleuchtung für sicherere Tunnel

Beim Durchfahren eines langen Straßentunnels gehen wir davon aus, dass die Beleuchtung hell und stabil bleibt. Tausende Leuchten zuverlässig und zugleich kosteneffizient zu betreiben ist jedoch ein komplexes Unterfangen. Diese Arbeit stellt einen neuen Ansatz zur Verwaltung von Tunnelbeleuchtung vor, der künstliche Intelligenz nutzt, um kontinuierlich zwei konkurrierende Ziele auszubalancieren: die Beleuchtung für Verkehrsteilnehmer zuverlässig zu halten und die Gesamtkosten im Rahmen zu halten.

Warum Tunnelbeleuchtung schwer zu steuern ist

Tunnelbeleuchtung ist entscheidend für die Verkehrssicherheit. Wenn Leuchten altern oder Stromkreise ausfallen, kann die Lichtstärke plötzlich abfallen, wodurch es für Fahrer schwieriger wird, Abstand und Geschwindigkeit einzuschätzen, und das Unfallrisiko steigt. Traditionelle Wartungsstrategien beruhen auf festen Zeitplänen, einfachen Schwellwerten oder einzieligen Regeln wie »Kosten minimieren« oder »Lebensdauer maximieren«. Solche Ansätze kommen in realen Tunneln schlecht zurecht, in denen sich Bedingungen über die Zeit ändern, tausende Leuchten unterschiedlich altern und Sicherheit und Kosten oft in entgegengesetzte Richtungen wirken. Die Autoren argumentieren, dass ein Verfahren nötig ist, das fortlaufend aus Daten lernt und Entscheidungen anpasst, während sich das System verändert.

Einem digitalen Agenten beibringen, die Beleuchtung zu warten

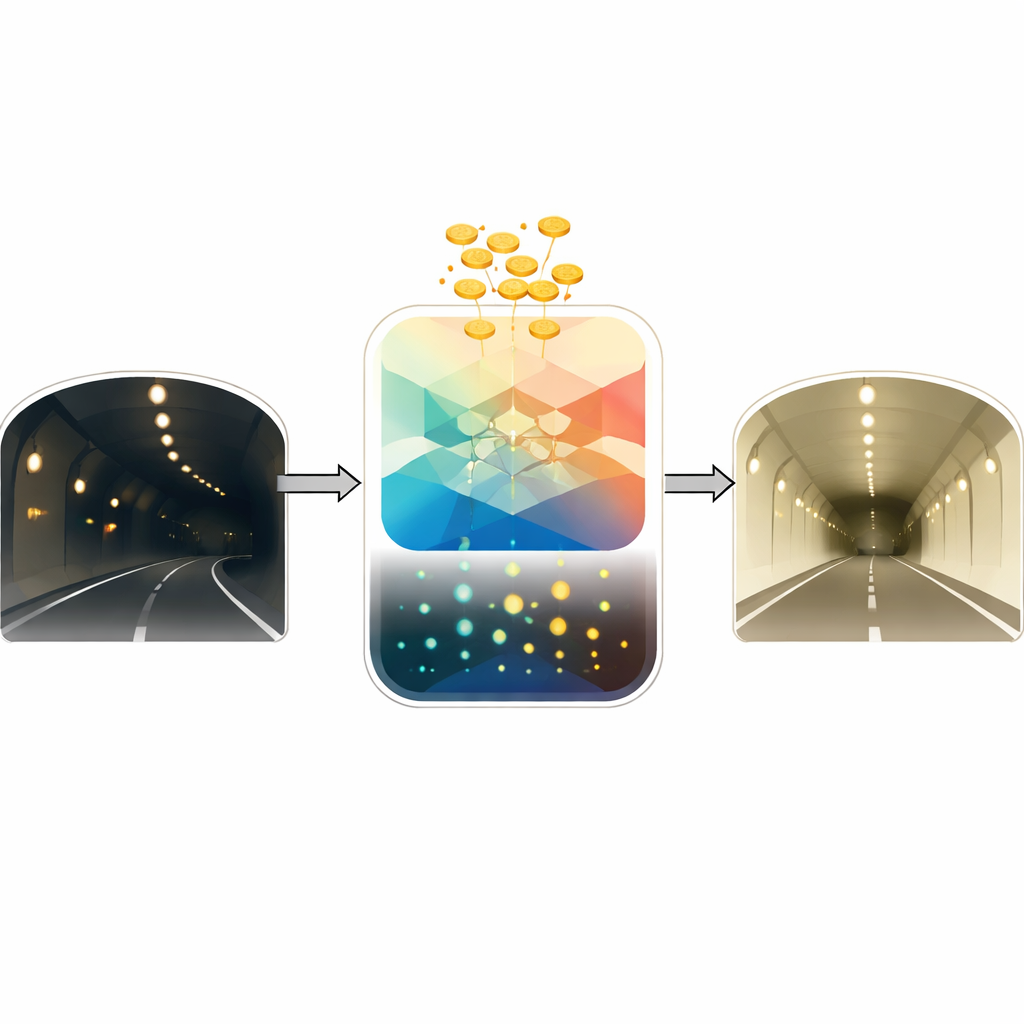

Die Forscher bauen einen digitalen »Agenten«, der lernt, wann und wie Tunnelbeleuchtungen repariert, ausgetauscht oder angepasst werden müssen, indem er mit einem simulierten Tunnel interagiert. Dieser Agent basiert auf Deep Reinforcement Learning, einem Teilgebiet der KI, bei dem ein System Aktionen ausprobiert, die Ergebnisse beobachtet und schrittweise Strategien erlernt, die eine Belohnung maximieren. In diesem Fall kombiniert die Belohnung Betriebskosten (Energieverbrauch, Personal, Ersatzteile und Sicherheitsstrafen) und Systemgesundheit (die Wahrscheinlichkeit, dass Leuchten zuverlässig funktionieren). Der Agent sieht ein detailreiches Abbild des Tunnels: die Helligkeit jeder Leuchte, ob sie ausfällt, die umgebende Lichtumgebung und Anzeichen für Degradation im Zeitverlauf. In jedem Schritt wählt er Aktionen für jede Lampe — nichts tun, aufhellen, dimmen, reparieren oder ersetzen — und erhält Rückmeldung darüber, wie diese Entscheidungen sowohl Kosten als auch Zuverlässigkeit beeinflussen.

Das Nachbilden des Leuchtenverschleißes

Um dem Agenten eine realistische Lernumgebung zu bieten, modellieren die Autoren zunächst mathematisch, wie Tunnelleuchten degradieren. Sie nutzen einen Typ von Zufallsprozess (einen Wiener-Prozess), der sowohl die gleichmäßige Drift in Richtung Ausfall als auch die Unsicherheit aus realen Bedingungen wie Temperaturschwankungen erfasst. Mithilfe von vier Jahren Betriebsdaten von mehr als 2.000 LED-Leuchten in einem 7‑Kilometer-Tunnel in der Provinz Yunnan verdichten sie viele Sensorwerte zu einem einzigen »Gesundheits«-Indikator und zeigen, dass dieses Degradationsmodell die Realität gut abbildet. Es sagt, wie die Ausfallwahrscheinlichkeit mit der Zeit wächst und wie viel Restlebensdauer eine Lampe vermutlich noch hat. Dieses Modell speist die simulierte Umgebung, in der der lernende Agent Wartungsstrategien üben kann, ohne reale Verkehrsteilnehmer zu gefährden.

Kosten und Zuverlässigkeit gleichzeitig ausbalancieren

Ein wesentlicher Beitrag der Arbeit ist, dass Kosten und Zuverlässigkeit als gleich wichtige Ziele behandelt werden, statt sie zu einer einzigen Kennzahl zu verschmelzen. Die Autoren verwandeln das Multi-Ziel-Problem in viele einfachere Teilprobleme, von denen jedes einen anderen Kompromiss zwischen niedrigen Kosten und hoher Zuverlässigkeit repräsentiert. Für jedes Teilproblem findet der lernende Agent eine gute Strategie; zusammen bilden diese Strategien eine »Front« der bestmöglichen Kompromisse. Um diesen Prozess zu beschleunigen, lassen die Forschenden benachbarte Teilprobleme das Gelernte teilen, wann immer ihre Zielkonflikte ähnlich sind, statt jedes Problem von Grund auf neu zu trainieren. Außerdem formen sie die Zuverlässigkeitsmessung so um, dass der Lernprozess besonders empfindlich reagiert, wenn das System nahe gefährlicher Ausfallniveaus liegt, wodurch der Agent eher zu aggressiveren Reaktionen vor einer Sicherheitsgefährdung veranlasst wird.

Was die neue Strategie erreicht

Gegenüber mehreren gängigen Tunnelwartungsstrategien — wie festen Inspektionsintervallen, helligkeitsbasierten Auslösern oder regelsatzbasierten Maßnahmen auf Basis von Ausfallraten — liefert der neue Ansatz ein besseres Gleichgewicht zwischen Sicherheit und Ausgaben. Er senkt die gesamten Wartungs- und Betriebskosten um nahezu 30 Prozent, während er die Zuverlässigkeit hoch hält und verhindert, dass der lernende Agent zu vorsichtig oder zu risikofreudig wird. Das Parameter-Sharing-Schema macht das Training zudem effizienter, reduziert die Rechenzeit und verbessert die Abdeckung möglicher Kosten‑Zuverlässigkeits-Kompromisse. Für Laien lautet die Kernaussage: Diese Methode nutzt Daten und adaptives Lernen, um genau zu entscheiden, wann und wo in einem Tunnel eingegriffen werden sollte, sodass die Beleuchtung für Fahrer sicher bleibt und Betreiber oder Steuerzahler über die Lebenszeit des Systems weniger zahlen.

Zitation: Wang, Z., Tang, J., Wei, P. et al. Deep reinforcement learning-driven multi-objective optimization and its applications on lighting infrastructure operation and maintenance strategy. Sci Rep 16, 8989 (2026). https://doi.org/10.1038/s41598-026-37811-5

Schlüsselwörter: Tunnelbeleuchtung, vorausschauende Wartung, Verstärkungslernen, Zuverlässigkeit von Infrastruktur, Multi-Ziel-Optimierung