Clear Sky Science · de

Adaptives Reinforcement‑Learning‑Framework zur nachhaltigen Optimierung von Mikronetzen in ariden städtischen Umgebungen

Die Lichter am Laufen halten in einer Wüstenstadt

Stellen Sie sich vor, Sie betreiben eine moderne Stadt, in der Sommertage regelmäßig über 40 °C steigen, Klimaanlagen ununterbrochen laufen und Stromleitungen an ihrer Belastungsgrenze arbeiten. So sieht der Alltag an Orten wie Riad in Saudi‑Arabien aus. Dieser Beitrag untersucht, wie ein neues, intelligentes Steuerungssystem — inspiriert von der Art und Weise, wie Computer komplexe Videospiele erlernen — Solarmodule, Windturbinen, Batterien, Dieselmotoren und das Hauptnetz koordinieren kann, um eine solche Stadt kostengünstiger und mit weniger Emissionen mit Strom zu versorgen.

Warum kleine Stromnetze wichtig sind

Anstatt sich nur auf große, entfernte Kraftwerke zu verlassen, setzen viele Städte auf „Mikronetze“ — kleine, lokale Netze, die verschiedene Energiequellen kombinieren und sogar Leistung mit Nachbarn teilen können. In heißen, trockenen Regionen ist das besonders relevant: Der Kühlbedarf schwankt stark mit dem Wetter, Solarenergie fällt tagsüber in Spitzen an, und Wind kann schwach oder unvorhersehbar sein. Traditionelle Steuerungssysteme folgen meist festen Regeln oder Zeitplänen und reagieren schlecht auf plötzliche Änderungen, wie einen Anstieg der Klimaanlagennutzung oder einen staubigen Tag, der die Sonne abschirmt. Das führt zu verschwendeter sauberer Energie, mehr Betrieb von Dieselaggregaten und höheren Kosten.

Ein lernendes Gehirn für das Stromsystem

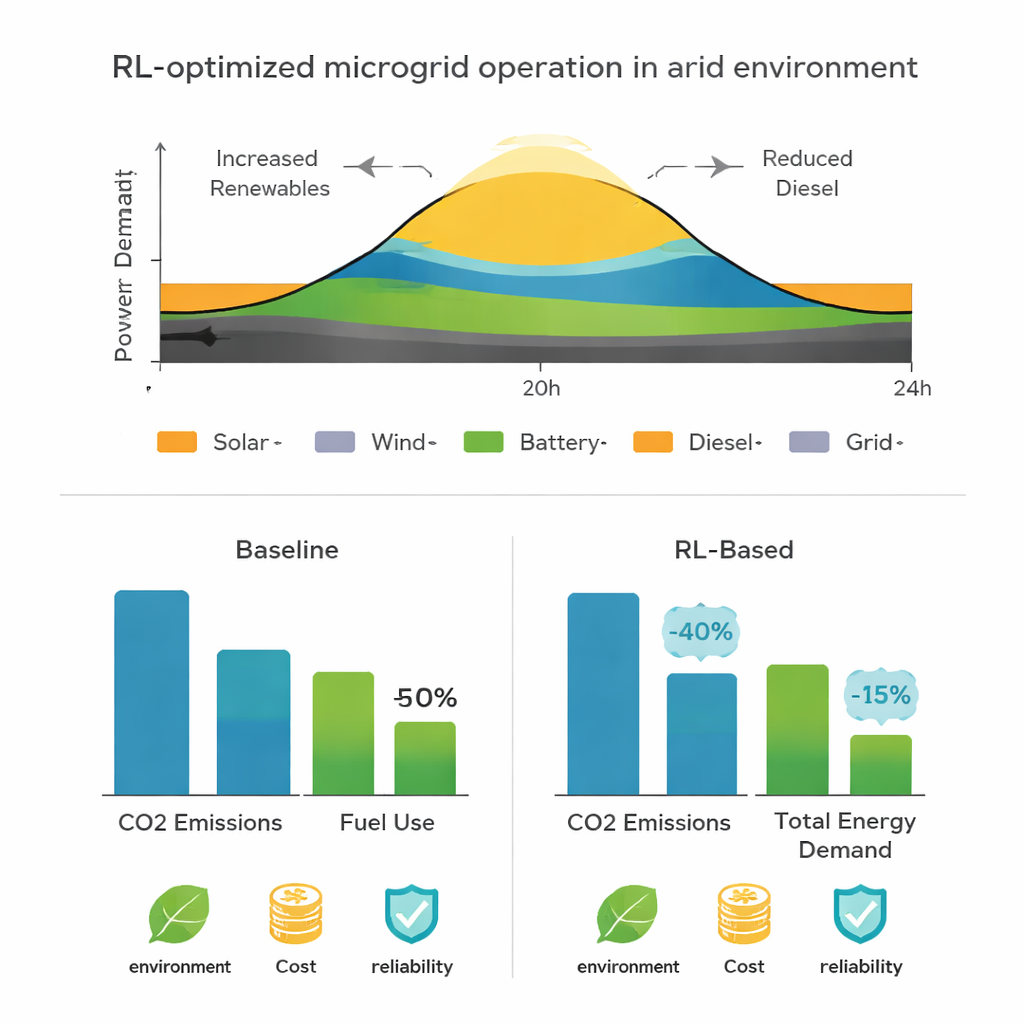

Die Forscher bauten ein detailliertes Computermodell von fünf miteinander verbundenen Mikronetzen, die typische Gebäude und Quartiere Riads repräsentieren — von großen und kleinen Wohnhäusern über gemischt genutzte Blöcke bis zu Gewerbearealen. Jedes Mikronetz verfügte über eine eigene Mischung aus Solarmodulen, kleinen Windturbinen, Diesel‑Backup und Batteriespeichern sowie einer Verbindung zum übergeordneten Stromnetz. Mithilfe von Gebäudeenergiesoftware (EnergyPlus) erzeugten sie stundenweise Daten für ein ganzes Jahr: Verbrauch, Temperatur, Einstrahlung und Windgeschwindigkeit. Darauf setzten sie einen Reinforcement‑Learning‑„Agenten“ — ein Software‑Gehirn, das den Systemzustand beobachtet (Last, Batterieladung, verfügbare Sonne und Wind, Generatorstatus) und Entscheidungen trifft: Batterien laden oder entladen, Dieselaggregate an‑ oder abschalten, Leistung importieren oder exportieren und Energie zwischen Mikronetzen teilen.

Wie das System lernt, bessere Entscheidungen zu treffen

Reinforcement Learning funktioniert durch Versuch und Irrtum. In der Simulation probiert der Agent stundenweise verschiedene Steuerungsmaßnahmen aus und erhält eine Belohnung oder Bestrafung anhand der Folgen. Die Belohnung vereint drei einfache Ziele: Kosten niedrig halten, Versorgung sicherstellen und erneuerbare Energie nicht verschwenden. Führt sein Handeln zu teurem Dieselverbrauch, Stromausfällen oder ungenutzter Solarenergie, wird er bestraft. Wenn er Nachfrage mit mehr Sonne und Wind, weniger Emissionen und stabiler Betriebsführung deckt, wird er belohnt. Über zehntausende Trainingsdurchläufe entdeckt der Agent nach und nach Strategien, die diese Ziele ausbalancieren. Nach dem Training kann er in Echtzeit Entscheidungen in nur wenigen Tausendstelsekunden treffen.

Was passiert, wenn die Wüste zurückschlägt

Um zu prüfen, ob dieser Ansatz in einem rauen Klima wirklich hilft, testete das Team ihn unter realistischen und belastenden Bedingungen. Das Modell reproduzierte Riads jahreszeitliche Schwankungen mit starker Kühllast im Sommer und milderen Lasten im Winter. Der lernbasierte Regler sagte sowohl stunden‑ als auch jahreszeitliche Verbrauchsmuster genau nach (erklärte etwa 90–94 % der Varianz), was für die Vorhersage von Spitzenlasten entscheidend ist. Er reduzierte Energieverluste über einen typischen Tag und verlagerte mehr Versorgung auf Solar- und Windenergie, wobei Batterien genutzt wurden, um Lücken auszugleichen. Bei simulierten Ereignissen wie einem Sandsturm, der plötzlich die Solarleistung dämpft, oder einer Hitzewelle mit stark erhöhtem Verbrauch reagierte das System mit Batterieentladung, koordinierter Dieselnutzung und dem Teilen von Überschussenergie zwischen Mikronetzen — alles ohne Abschaltung von Verbrauchern.

Sauberere Luft und niedrigere Rechnungen

Über die Sicherstellung der Versorgung hinaus untersuchte die Studie die Umweltwirkungen anhand einer Lebenszyklusanalyse, die sich auf den täglichen Betrieb konzentrierte. Im Vergleich zu einer traditionellen, regelbasierten Konfiguration verringerte das adaptive System die CO2‑Emissionen um etwa 14 %, reduzierte säurebildende Schadstoffe um rund 14 % und senkte den Gesamtenergieverbrauch um etwa 10 %. Diese Verbesserungen entstehen hauptsächlich durch selteneren Betrieb von Dieselaggregaten und eine effizientere Nutzung lokaler Erneuerbarer und Speichersysteme. Einfach ausgedrückt: Indem man dem Mikronetz ein lernendes Gehirn gab, konnte es mehr nutzbare Arbeit aus jeder Einheit sauberer Energie herausholen, weniger auf fossile Brennstoffe zurückgreifen und selbst bei widrigem Wüstenklima zuverlässig bleiben.

Zitation: Mohamed, M.A.S., Almazam, K., Alzahrani, M. et al. Adaptive reinforcement learning framework for sustainable microgrid optimization in arid urban environments. Sci Rep 16, 7356 (2026). https://doi.org/10.1038/s41598-026-37752-z

Schlüsselwörter: Mikronetze, Reinforcement Learning, erneuerbare Energien, Energiemanagement, aride Städte