Clear Sky Science · de

Ein Deep-Learning-Ansatz für emotional intelligente KI zur Verbesserung von Lernergebnissen

Warum Gefühle beim Lernen wichtig sind

Wer schon einmal versucht hat zu lernen, während er gestresst oder gelangweilt war, weiß, dass Gefühle Lernen fördern oder verhindern können. Trotzdem behandeln die meisten Bildungsprogramme Lernende noch wie losgelöste Gehirne und reagieren nur auf richtige oder falsche Antworten. Dieser Beitrag untersucht eine neue Art emotional intelligenter KI-Tutorien—eine, die aus Gesicht, Stimme und Worte eines Lernenden erkennen kann, wie er sich fühlt, und diese Einsicht nutzt, um Motivation, Unterstützung und Lernfortschritt zu sichern.

Von Testergebnissen zu echten Gefühlen

Traditionelle KI-Bildungssysteme konzentrieren sich fast ausschließlich auf kognitive Daten: wie viele Fragen ein Schüler richtig beantwortet, wie schnell er reagiert oder welche Themen er verfehlt. Forschung zeigt jedoch, dass Neugier, Frustration, Angst und Zufriedenheit Aufmerksamkeit, Gedächtnis und Durchhaltevermögen stark beeinflussen. Wenn diese Gefühle ignoriert werden, kann das System etwa die Schwierigkeit erhöhen, genau in dem Moment, in dem eine Schülerin kurz davor ist aufzugeben, oder muntere Ermutigungen aussprechen, obwohl der Lernende tatsächlich verwirrt ist. Die Autoren argumentieren, dass effektive Tutorensoftware sowohl lesen als auch reagieren muss—auf das, was Schülerinnen wissen, und darauf, wie sie sich fühlen.

Dem Computer das Lesen von Gesichtern, Stimmen und Worten beibringen

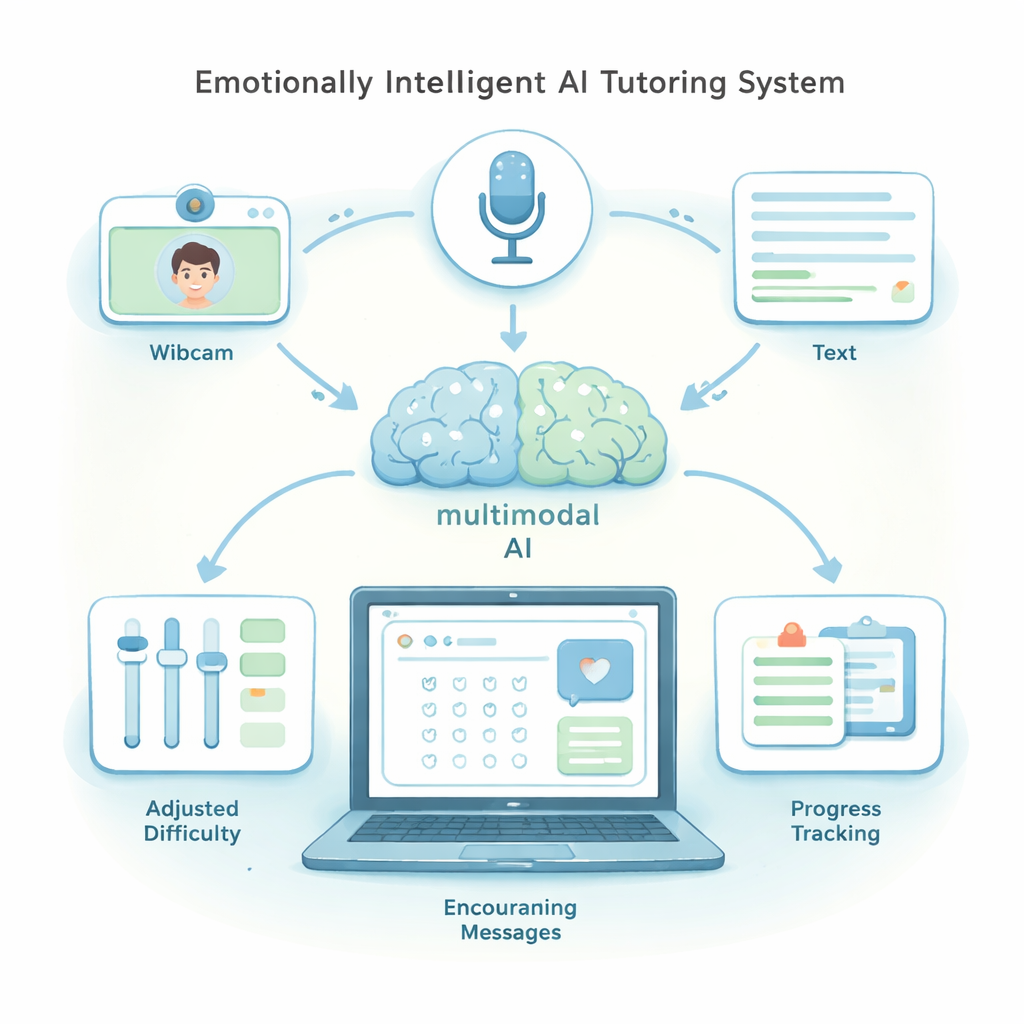

Um einen emotionsbewussten Tutor zu entwickeln, kombinierten die Forschenden drei Informationsströme. Zunächst nutzten sie eine große Bildersammlung mit Gesichtern, die mit Emotionen beschriftet waren, um ein Visionsmodell zu trainieren, das Signale wie Lächeln, Stirnrunzeln und hochgezogene Augenbrauen erkennt. Zweitens griffen sie auf eine Sprachdatenbank mit gespielten Gesprächen zurück, die mit Gefühlen wie Ärger, Freude und Enttäuschung getaggt war, sodass ein Audiomodell Hinweise in Tonlage, Pitch und Sprechtempo erfassen konnte. Drittens trainierten sie ein Sprachmodell an Transkripten, damit es einschätzen kann, ob geschriebene Kommentare oder Antworten selbstbewusst, frustriert oder neutral klingen. Jede dieser Komponenten wandelt rohe Bilder, Klänge oder Worte in einen kompakten „emotionalen Fingerabdruck“ um.

Wie das System Signale zu einer Stimmung vereint

Da keiner der Kanäle die ganze Geschichte erzählt, setzte das Team eine graphbasierte Deep-Learning-Methode ein, um die drei Fingerabdrücke zu verschmelzen. Einfach gesagt behandelt das System jede Modalität—Gesicht, Stimme und Text—als verbundenen Knoten in einem Netzwerk. Während des Trainings lernt das Netzwerk, wie diese Teile typischerweise zusammenhängen: etwa ob eine angespannte Stimme oft mit einem ernsten Gesichtsausdruck auftritt oder ob eine positive Wortwahl einen müden Blick ausgleichen kann. Indem Nachrichten entlang dieser Verbindungen ausgetauscht werden, gelangt das Modell zu einer gemeinsamen Einschätzung des emotionalen Zustands des Lernenden, selbst wenn eine Informationsquelle verrauscht oder fehlend ist. Diese zusammengeführte Schätzung steuert dann die Antworten des Tutors, wie das Verlangsamen des Tempos, das Anbieten von Hinweisen oder das Hinzufügen von Ermutigungen.

Hilft emotionsbewusste KI Schülern wirklich?

Die Forschenden bewerteten ihr System mit standardisierten Emotionsdatensätzen und verglichen es mit herkömmlichen Modellen, die nur Bilder, nur Audio oder einfache Fusionsmethoden nutzten. Über Emotionen wie Freude, Traurigkeit, Ärger und Neutralität hinweg war der neue Rahmenwerk genauer und besser ausbalanciert—insbesondere bei positiven und neutralen Zuständen, die für gleichmäßiges Lernen wichtig sind. In Nutzungsstudien, die Lernsituationen nachstellten, berichteten die Teilnehmenden, dass sich das emotionsbewusste System unterstützender und reaktiver anfühlte. Messbare Ergebnisse stützten diese Aussagen: Lernende blieben länger engagiert, regulierten negative Gefühle effektiver und erledigten mehr Aufgaben als diejenigen, die nur KI-Werkzeuge mit kognitivem Fokus verwendeten.

Versprechen, Fallstricke und Ausblick

Da emotionale Daten sensibel sind, widmen die Autoren dem Thema Ethik große Aufmerksamkeit. Sie betonen die Notwendigkeit von informierter Einwilligung, strengen Datenschutzmaßnahmen und Schutz gegen Verzerrungen über Kulturen und Altersgruppen hinweg. Mit Blick auf die Zukunft stellen sie sich Klassenzimmersysteme vor, die subtile Gefühle in Echtzeit wahrnehmen und in Tools wie intelligente Tutoren oder Virtual-Reality-Lektionen integrieren können. Für nicht Fachleute ist die wichtigste Botschaft einfach: Indem man nicht nur auf Antworten, sondern auch auf Mimik, Ton und Formulierungen achtet, können KI-Tutoren weniger wie Benotungsmaschinen und mehr wie aufmerksame menschliche Lehrkräfte agieren—und so bessere Lernresultate ermöglichen, indem sie verstehen, wie Lernende sich beim Lernen fühlen.

Zitation: Wu, X., Lee, T., Lilhore, U.K. et al. A deep learning approach to emotionally intelligent AI for improved learning outcomes. Sci Rep 16, 7431 (2026). https://doi.org/10.1038/s41598-026-37750-1

Schlüsselwörter: emotionsbewusstes Lernen, KI-Tutoren, Schülerengagement, multimodale Emotionserkennung, Bildungstechnologie