Clear Sky Science · de

Autonome Wegplanung für interkostale robotergestützte Ultraschallbildgebung mittels Reinforcement Learning

Roboter, die Ärzten einen Blick zwischen die Rippen ermöglichen

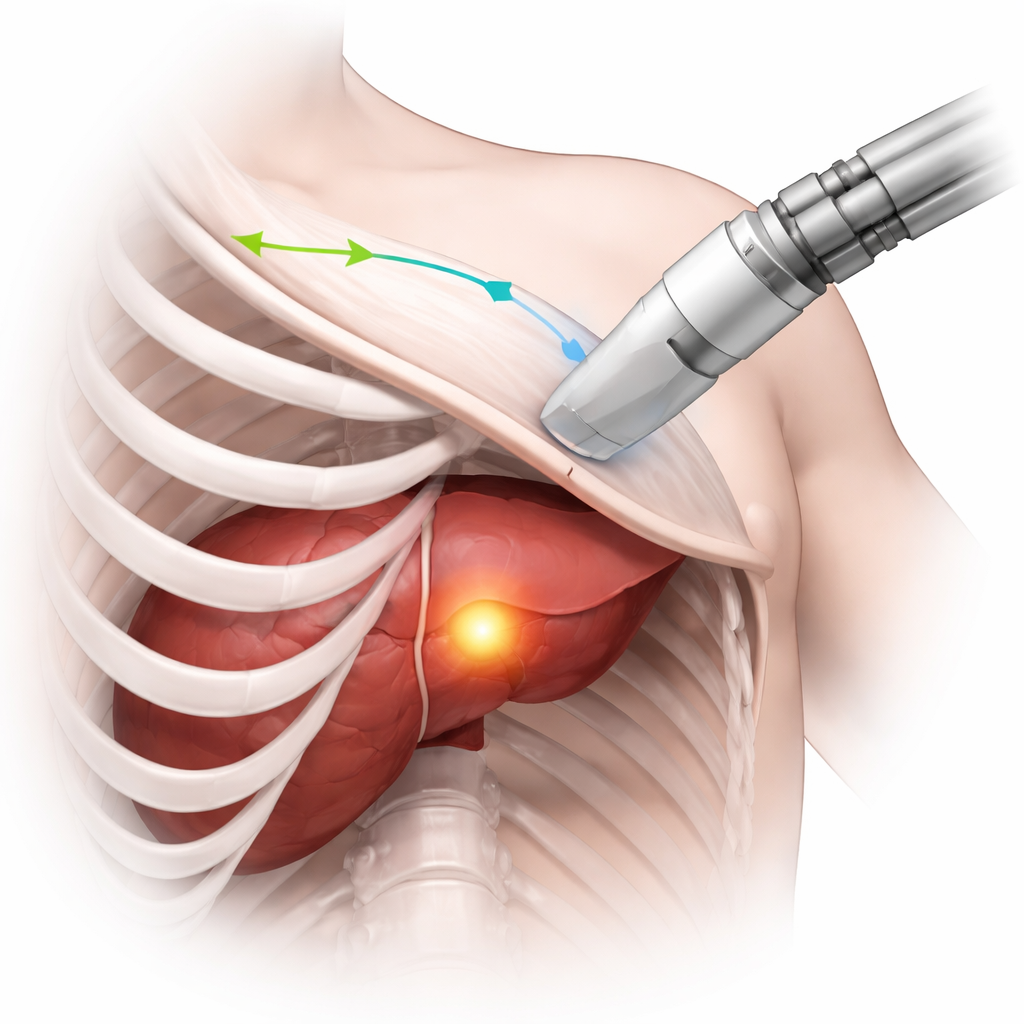

Wenn Ärztinnen und Ärzte Ultraschall einsetzen, um Organe wie Leber oder Herz zu überwachen, stehen häufig die Rippen im Weg und werfen dunkle Schatten, die wichtige Details verbergen. Eine klare Sicht hängt stark von Können und Erfahrung der Person ab, die die Sonde hält. Diese Studie untersucht, wie ein Roboter, gesteuert durch künstliche Intelligenz, automatisch einen Ultraschall-Scanpfad zwischen den Rippen planen kann, sodass Tumore und andere Zielstrukturen klar und reproduzierbar zu sehen sind – unabhängig davon, wer das Gerät bedient.

Warum das Sehen zwischen den Rippen so schwierig ist

Ultraschall ist beliebt, weil er sicher, kostengünstig ist und Live-Bilder liefert. Um jedoch Organe hinter dem Brustkorb darzustellen, muss die Sonde sorgfältig durch die engen Lücken zwischen den Rippen geführt werden. Treffen die Schallwellen auf Knochen, werden sie blockiert, wodurch große schwarze Bereiche im Bild entstehen, in denen nichts zu erkennen ist. Menschliche Bedienerinnen und Bediener lernen durch Training und Erfahrung, wie sie die Sonde so neigen und bewegen, dass diese Schatten vermieden werden und zugleich der Bereich von Interesse im Blick bleibt. Das ist besonders wichtig bei Eingriffen wie der Ablation von Lebertumoren, bei denen Chirurgen wiederholt prüfen müssen, ob der gesamte Tumor behandelt wurde. Die Herausforderung besteht darin, diese empfindliche, dreidimensionale Fertigkeit in etwas zu überführen, das ein Roboter eigenständig leisten kann.

Den Roboter mit virtuellen Patienten lehren

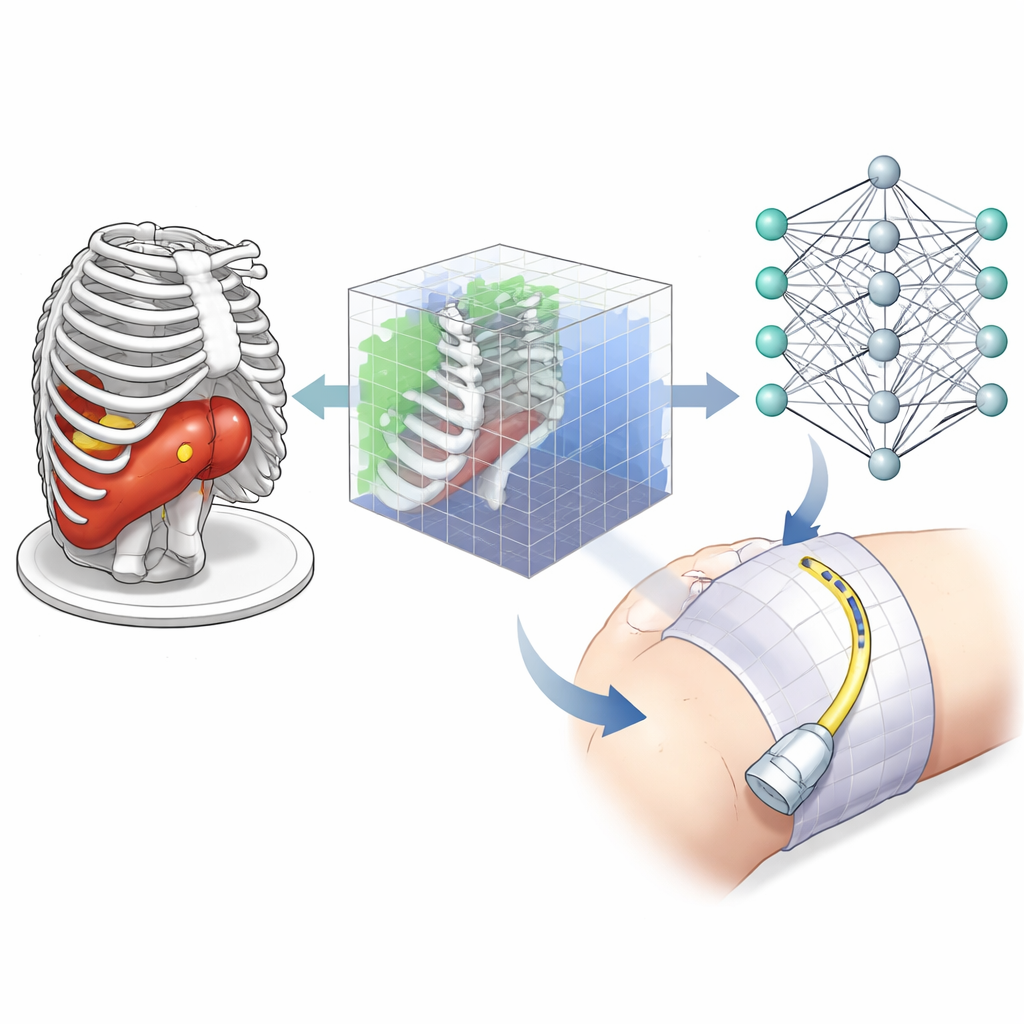

Anstatt direkt aus verrauschten und variablen Ultraschallbildern zu lernen, bauten die Forschenden ein virtuelles Trainingsfeld auf Basis von Computertomographie(CT)-Scans. CT liefert eine scharfe dreidimensionale Karte von Knochen, Haut und Leber; Tumore können mit unterschiedlichen Formen und Lagen eingefügt werden, um viele realistische Szenarien zu erzeugen. In diesem Simulator bewegt sich eine virtuelle Ultraschallsonde über die Hautoberfläche über den Rippen, und die Verläufe der Ultraschallstrahlen werden als Strahlen modelliert, die durch Weichgewebe laufen, aber von Knochen blockiert werden. Dieses einfache, aber realistische Modell sagt dem System, welche Teile eines Tumors sichtbar sind, wie stark der Schall auf dem Weg abgeschwächt wird und wo Schatten entstehen.

Wie das Lernsystem entscheidet, wo gescannt wird

Das Team verwendete eine Form der künstlichen Intelligenz namens Reinforcement Learning, bei dem ein „Agent“ durch Versuch und Irrtum lernt, Aktionen zu wählen, die zu höheren Belohnungen führen. In jedem Schritt sieht der Agent eine kompakte 3D-Darstellung der Szene um den Tumor: welche kleinen Volumenelemente Tumor enthalten, welche Knochen enthalten und welche von den simulierten Ultraschallstrahlen durchquert werden. Er kann die virtuelle Sonde dann in kleinen Schritten verschieben oder neigen oder zwischen einem „Erkundungs“-Modus und einem „Aufnahme“-Modus wechseln, der zum Aufbau der finalen 3D-Ansicht dient. Die erhaltene Belohnung kombiniert drei Ziele: möglichst viel der Zielstruktur abdecken, die Sonde nahe genug halten, um Signalverlust zu verringern, und Bereiche vermeiden, in denen Strahlen durch Knochen blockiert werden und damit nutzlose, verschattete Bilder entstehen.

Das Verfahren auf die Probe gestellt

Um zu prüfen, ob die erlernte Strategie über die Trainingsbeispiele hinaus generalisiert, testeten die Forschenden sie an neuen CT-Scans und neuen Tumorformen, die der Agent nie gesehen hatte. In diesen Tests galt ein Scanplan als erfolgreich, wenn innerhalb einer begrenzten Anzahl von Schritten mindestens 95 % des Zielvolumens erfasst wurden. Über kleine, mittlere und große Ziele erzielte das System Erfolgsraten von bis zu 95 %, während es gleichzeitig einen hohen Anteil schattenfreier Ansichten und vernünftige Abstände zwischen Sonde und Tumor beibehielt. Die Methode funktionierte auch bei mehreren zu erfassenden Zielen, etwa verstreuten Resttumoren in der Leber, wobei die Leistung mit zunehmender Aufgabenkomplexität erwartungsgemäß leicht nachließ.

Von der Simulation in den Operationssaal

Vorerst konzentriert sich die Arbeit auf die Planung des Pfads und nicht auf die physische Bewegung eines echten Roboters. Die Pfade werden auf patientenspezifischen CT-Scans oder auf generischen CT-„Atlanten“ erzeugt, die später mit bereits existierenden Registrierungsverfahren an die Anatomie einer Einzelperson angepasst werden können. Zukünftig soll dieses Planungselement mit roboterischer Steuerung, Bewegungs-kompensation für die Atmung und realistischeren Ultraschallbildsimulationen kombiniert werden. Für Laien ist die zentrale Erkenntnis, dass dieser Ansatz die Ultraschallüberwachung bei Eingriffen wie der Behandlung von Lebertumoren zuverlässiger und weniger abhängig von der Bedienerexpertise machen könnte, indem ein Roboter intelligente, schattenfreie Routen zwischen den Rippen findet, um das gesamte Ziel im Blick zu halten.

Zitation: Bi, Y., Qian, C., Zhang, Z. et al. Autonomous path planning for intercostal robotic ultrasound imaging using reinforcement learning. Sci Rep 16, 6356 (2026). https://doi.org/10.1038/s41598-026-37702-9

Schlüsselwörter: robotergestützter Ultraschall, Reinforcement Learning, Lebertumorbildgebung, interkostales Scannen, medizinische Robotik