Clear Sky Science · de

Algorithmen zur Fusion von Infrarot- und Sichtbildern basierend auf NSCT und verbesserter FT-Salienzerkennung

Im Dunkeln und im Durcheinander sehen

Moderne Kameras liefern uns scharfe, farbenfrohe Ansichten der Welt, haben jedoch Probleme bei Nebel, Dunkelheit oder Blendung – genau dann, wenn wir für Fahren, Überwachung, Suche und Rettung oder Drohnen zuverlässige Sicht benötigen. Infrarotsensoren, die Wärme statt Farbe erfassen, sind unter diesen widrigen Bedingungen überlegen, erzeugen aber oft unscharfe Bilder mit wenigen Details. Diese Arbeit stellt eine Methode vor, Infrarot- und sichtbare Bilder intelligent zu kombinieren, sodass das endgültige Bild sowohl klare Details als auch deutlich hervorgehobene Personen oder Objekte zeigt, selbst in schwierigen Szenen.

Warum zwei Augen besser sind als eines

Sichtbare Lichtkameras zeichnen feine Texturen und reichhaltige Hintergründe auf, versagen jedoch bei Nacht oder in starken Schatten, und Ziele können sich in ähnlich gefärbten Umgebungen auflösen. Infrarotkameras machen das Gegenteil: Sie erfassen warme Körper und wärmeabstrahlende Objekte vor dunklem Hintergrund, bei Tag wie bei Nacht, verlieren dabei jedoch oft subtile Strukturen von Gebäuden, Bäumen und Straßen. Die Fusion dieser beiden Bildarten kann prinzipiell das Beste aus beiden Welten liefern. Allerdings verwischen viele bestehende Fusionsverfahren den Kontrast, verwässern Objektkanten oder lassen verrauschte Infrarotmuster die nützlichen Details des Sichtbildes überdecken.

Die Kernidee: Die wichtigen Bereiche hervorheben

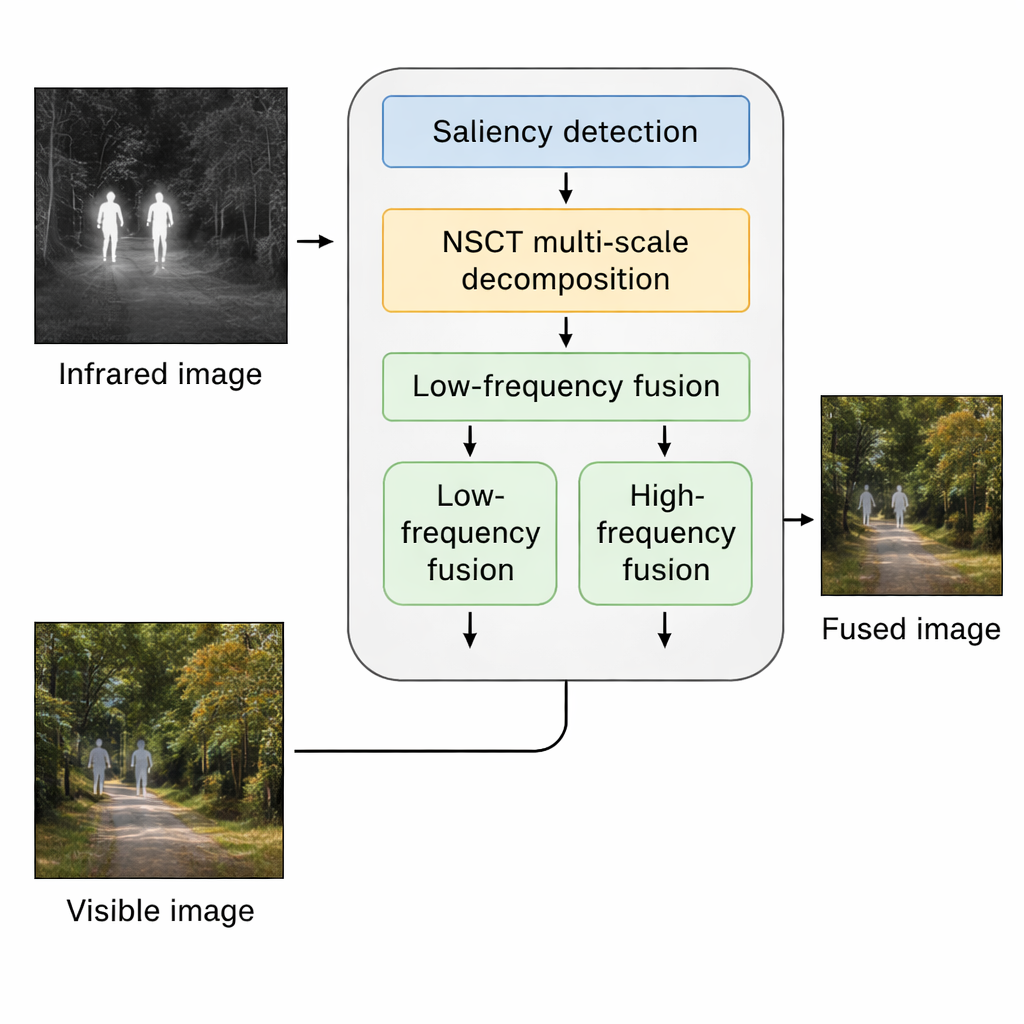

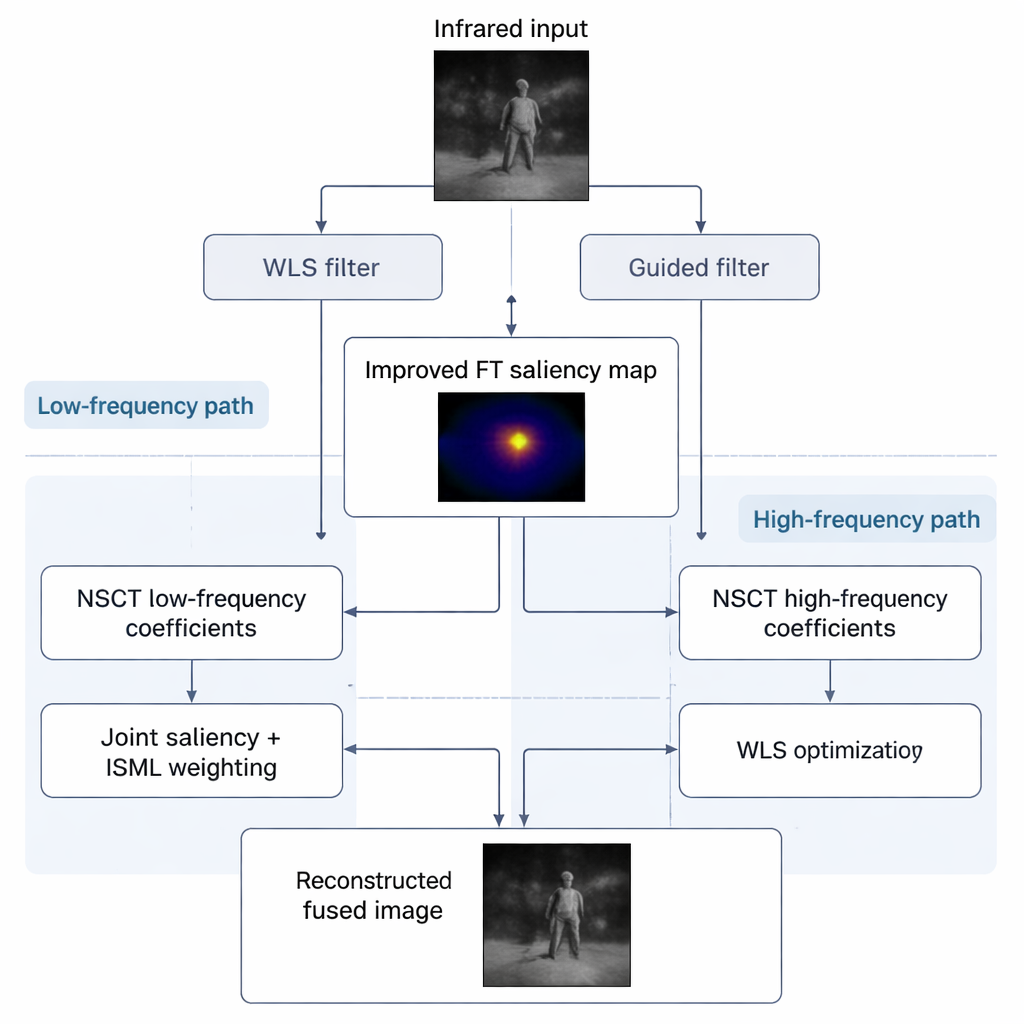

Die Autoren betrachten Fusion als ein Problem der Konfliktauflösung zwischen den beiden Bildtypen. Sie konzentrieren sich auf drei wiederkehrende Aspekte: das Erkennen, welche Regionen wirklich wichtig ("salient") sind, das Ausbalancieren der Helligkeit zwischen heißen Infrarotzielen und hellen sichtbaren Hintergründen sowie das Bewahren feiner Texturen bei gleichzeitiger Unterdrückung von Infrarotrauschen. Zur Lösung verfeinern sie eine verbreitete Technik namens frequency-tuned Salienzerkennung, die versucht, das menschliche visuelle System zu imitieren, indem sie Bereiche hervorhebt, die natürlicherweise unsere Aufmerksamkeit auf sich ziehen. Anstatt sich auf eine einfache Unschärfe zu stützen, verwenden sie ein Paar intelligenterer Filter – einen, der glättet und dennoch Kanten bewahrt, und einen anderen, der den Kontrast verstärkt – um eine sauberere, schärfere Karte der interessanten Infrarotziele zu erstellen.

Grobe Formen und feine Details trennen

Sobald der Algorithmus weiß, wo die wichtigsten Infrarotziele liegen, zerlegt er sowohl die Infrarot- als auch die Sichtbilder in Schichten, die grobe Strukturen von feinen Details trennen, mithilfe eines mathematischen Werkzeugs namens Non-Subsampled Contourlet Transform. Die Niederfrequenzschichten enthalten breite Helligkeitsmuster wie Himmel, Straßen oder Wände, während die Hochfrequenzschichten Kanten, Texturen und kleine Merkmale erfassen. Für die groben Schichten mischt die Methode Informationen unter Verwendung sowohl der verbesserten Infrarotsalienzkarte als auch einer laplace-basierten Messung der Schärfe lokaler Strukturen. Das hilft, ausgewaschene Bilder zu vermeiden, in denen entweder die warmen Objekte die Szene dominieren oder der sichtbare Hintergrund wichtige Ziele überflutet.

Texturen scharf halten, Rauschen unter Kontrolle

Für die Hochfrequenzschichten ist eine andere Strategie erforderlich, denn hier liegen sowohl nützliche Texturen als auch störendes Rauschen. Zuerst wählt die Methode regionenweise jeweils den Sensor, der lokal stärkere Details bietet. Dann verfeinert sie diese erste Wahl mit einem gewichteten Kleinste-Quadrate-Verfahren, das zu den saubereren, informationsreicheren sichtbaren Texturen tendiert, während es trotzdem sinnvolle Infrarotmuster durchlässt. Das Ergebnis ist ein fusioniertes Bild, in dem Baumzweige, Gebäude- kanten und Straßenmarkierungen scharf erscheinen, während körnige Infrarotartefakte reduziert sind.

Bessere Bilder, bessere automatische Entscheidungen

Das Team testete seinen Ansatz auf mehreren öffentlichen Datensätzen und eigenen Aufnahmen bei schlechten Lichtverhältnissen und verglich ihn mit traditionellen Techniken sowie modernen Deep-Learning-Methoden. Menschliche Begutachtungen zeigten, dass ihre fusionierten Bilder klarere Hintergründe, höheren Kontrast und deutlichere Ziele aufwiesen, besonders in dunklen Korridoren, nächtlichen Straßen und unübersichtlichen Außenbereichen. Objektive Messgrößen für Informationsgehalt, Schärfe und Kontrast sprachen meist für die neue Methode oder zeigten ein ausgewogenes Ergebnis über verschiedene Metriken. Entscheidend ist, dass bei Einspeisung dieser fusionierten Bilder in ein populäres Objekterkennungssystem (YOLOv5s) Genauigkeit, Präzision und Recall deutlich zunahmen. Einfach ausgedrückt: Der Algorithmus erzeugt nicht nur ansprechendere Bilder, sondern hilft automatisierten Systemen auch, Personen und Objekte zuverlässiger zu finden. Das legt nahe, dass eine intelligentere Fusion von Infrarot- und Sichtbildern eine Schlüsselrolle für sichereres autonomes Fahren, effektivere Überwachung und verlässlichere Roboter in der Dunkelheit oder visuellen Komplexität spielen könnte.

Zitation: Fan, X., Kong, F., Shi, H. et al. Infrared and visible image fusion algorithm based on NSCT and improved FT saliency detection. Sci Rep 16, 7144 (2026). https://doi.org/10.1038/s41598-026-37670-0

Schlüsselwörter: Infrarot-Sicht-Fusion, Bildsalienz, Multi-Sensor-Bildgebung, Nachtsicht, Computer Vision