Clear Sky Science · de

Maximierung zeitlicher Einflussnahme mittels kontinuierlicher Graph-Neuronaler Netze und Deep Reinforcement Learning

Warum Timing in unserer vernetzten Welt zählt

Von viralen Videos bis zur Ausbreitung von Krankheiten hängt Vieles im modernen Leben davon ab, wie Ereignisse durch Netzwerke von Menschen laufen. Unternehmen wollen wissen, wen sie ansprechen sollten, damit sich eine Werbekampagne selbst verstärkt. Gesundheitsbehörden möchten wissen, wen sie zuerst impfen sollten, um einen Ausbruch zu stoppen. Die meisten Werkzeuge zur Auswahl dieser Schlüsselpersonen behandeln Netzwerke jedoch so, als wären sie zeitlich eingefroren, obwohl reale Interaktionen von Moment zu Moment entstehen und verschwinden. Dieses Papier stellt einen neuen Ansatz vor, TempRL-IM, der dem Fluss der Zeit Rechnung trägt und zeigt, wie die präzise Berücksichtigung des Zeitpunkts von Verbindungen unsere Fähigkeit, Information und Einfluss in schnell veränderlichen sozialen Systemen zu steuern, deutlich verbessert.

Von statischen Landkarten zu lebendigen Netzwerken

Traditionelle Studien zum Einfluss in Netzwerken beginnen mit einer einfachen Frage: Wenn man eine kleine Gruppe von Menschen „aktivieren“ könnte – etwa durch Gratisproben oder wichtige Benachrichtigungen – welche würden die größte Kettenreaktion auslösen? Frühere Methoden beantworteten dies, indem sie nur einen festen Schnappschuss davon betrachteten, wer mit wem verbunden ist. Sie gehen davon aus, dass eine Verbindung zwischen Person A und B immer verfügbar ist, damit Einfluss übertragen werden kann. In realen Systemen ist das jedoch selten so stabil. E‑Mails, Telefonate, Online‑Nachrichten und persönliche Begegnungen schwanken im Tagesverlauf. Diese Rhythmik zu ignorieren kann zu schlechten Entscheidungen führen, etwa jemanden auszuwählen, der auf dem Papier zentral erscheint, in dem entscheidenden Zeitfenster aber tatsächlich inaktiv ist, wenn der Einfluss sich ausbreiten muss.

Dem Herzschlag der Interaktion lauschen

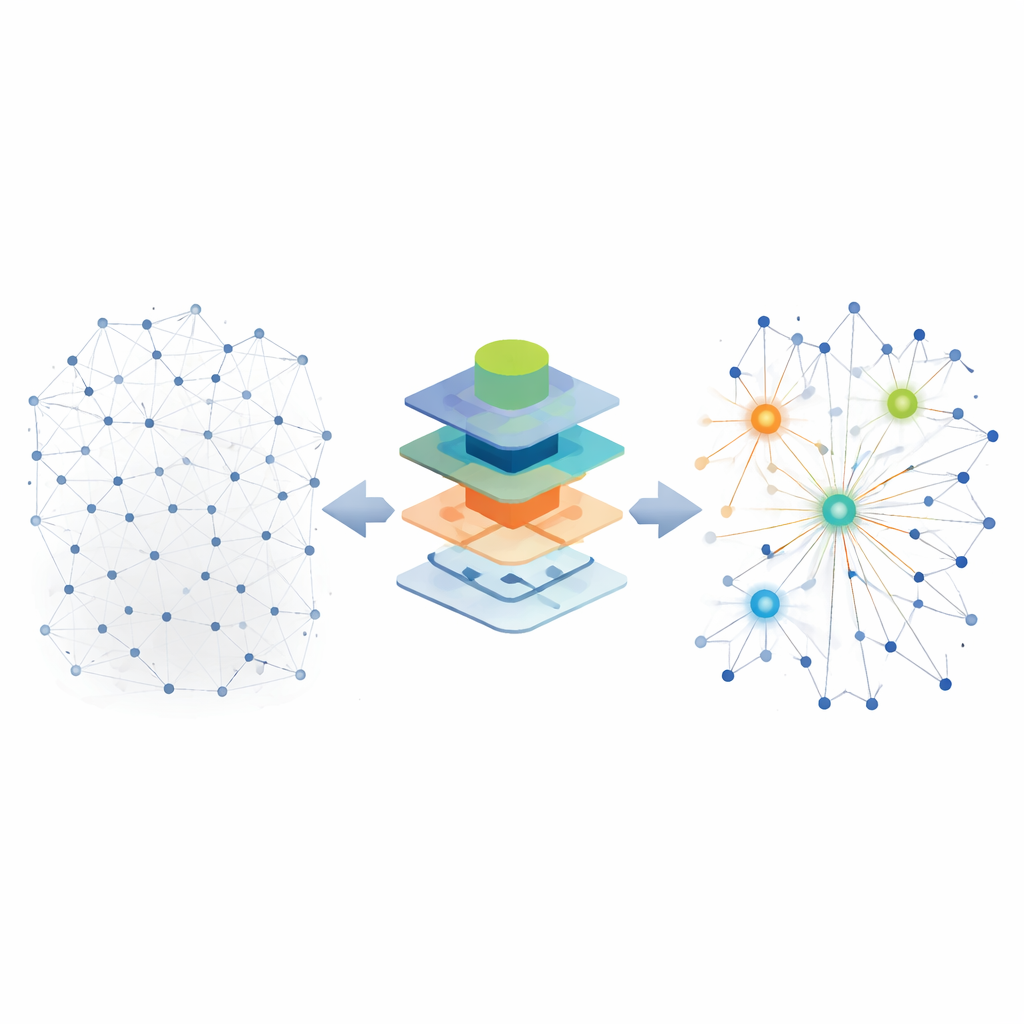

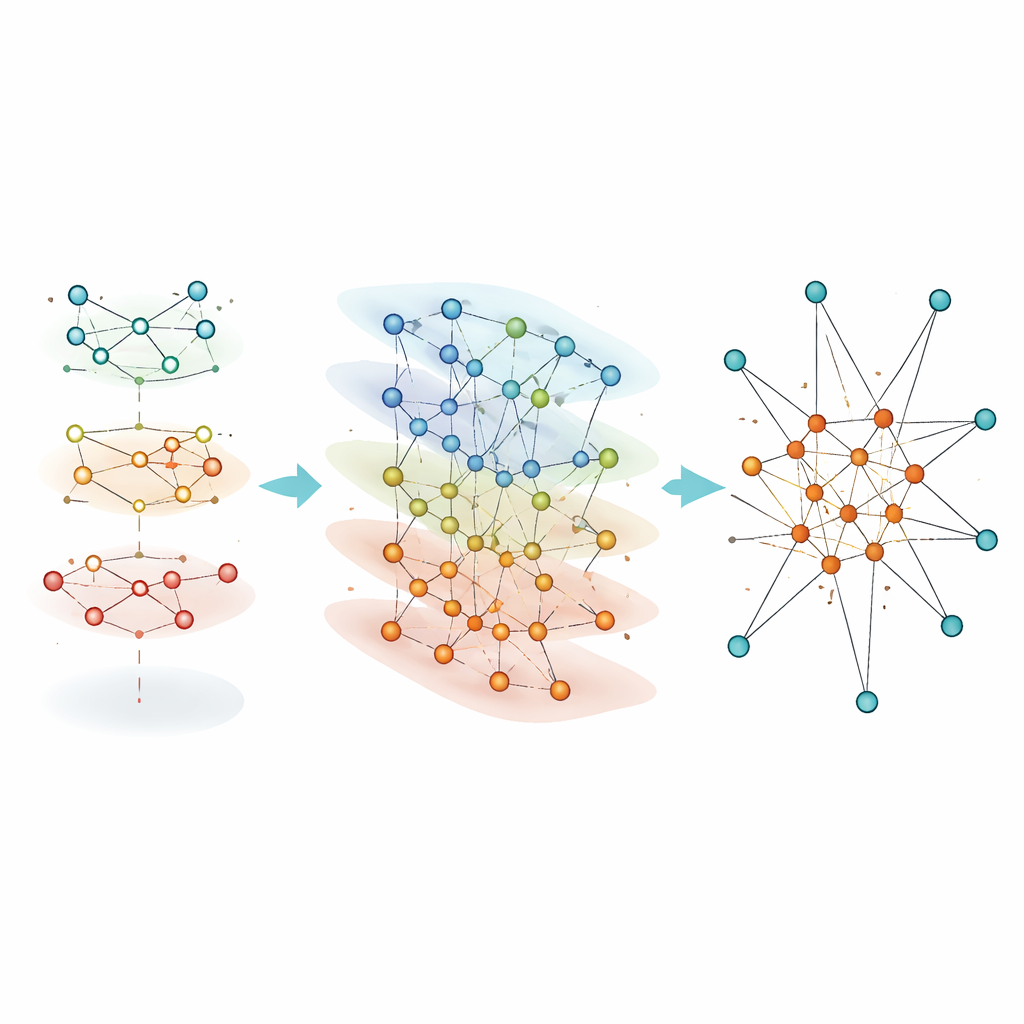

Die Autoren argumentieren, dass die genauen Zeitpunkte, zu denen Menschen interagieren – bis hin zur Reihenfolge und Abfolge von Ereignissen – wichtige Hinweise darauf liefern, wer tatsächlich einflussreich ist. Ihr Rahmenwerk TempRL-IM behandelt jeden Kontakt im Netzwerk als zeitgestempeltes Ereignis, ähnlich einem Eintrag in einem detaillierten Logbuch. Anstatt die Zeit in grobe Scheiben zu zerschneiden, verwendet es ein kontinuierliches Graph‑Neuronales Netz, eine Art maschinellen Lernmodells, das für jede Person im Netzwerk ein Gedächtnis vorhält. Jedes Mal, wenn zwei Personen interagieren, werden beide Gedächtnisse aktualisiert und berücksichtigen nicht nur, wer mit wem kommuniziert hat, sondern auch, wie jüngst und wie häufig. Ein zeitlicher Aufmerksamkeitsmechanismus richtet dann den Fokus auf die relevantesten vergangenen Nachbarn und Zeitpunkte und destilliert den sich entwickelnden "Zustand" jeder Person in einen kompakten numerischen Fingerabdruck.

Eine KI darin schulen, die richtigen Botschafter auszuwählen

Sobald die sich verschiebenden Muster des Netzwerks kodiert sind, übermittelt TempRL-IM diese Fingerabdrücke an ein Entscheidungsmodul, das auf Deep Reinforcement Learning basiert. Dort lernt ein KI‑Agent durch Trial‑and‑Error, zu einem bestimmten Beobachtungszeitpunkt eine kleine Menge von „Seed“-Personen auszuwählen. In Simulationen, die zeigen, wie sich Einfluss nach diesem Zeitpunkt ausbreiten würde, erhält der Agent höhere Belohnungen, wenn seine gewählten Seeds große Kaskaden auslösen. Über viele Durchläufe entdeckt er subtile zeitliche Strategien – zum Beispiel Personen zu bevorzugen, die gerade dann aktiv werden, wenn eine Kampagne gestartet wird, oder solche, deren Kontakte sich in kritischen Perioden bündeln. Entscheidend ist, dass das Modell Ursache und Wirkung respektiert: Es blickt beim Treffen seiner Entscheidungen niemals in die Zukunft, sondern stützt sich nur auf vergangene und gegenwärtige Ereignisse.

Die Vorteile auf realen Daten nachweisen

Um TempRL-IM zu testen, wendeten die Forschenden es auf sechs reale temporale Netzwerke an, darunter E‑Mail‑Austausch in Unternehmen, Privatnachrichten auf universitären sozialen Plattformen, Vertrauensbeziehungen in einem Kryptowährungsmarktplatz und physische Nähe zwischen Mobiltelefonnutzern. Sie verglichen ihre Methode mit populären statischen und schnappschussbasierten Algorithmen sowie mit neueren Deep‑Learning‑Ansätzen. Über alle Datensätze und für verschiedene Anzahlen von Seeds aktivierte TempRL-IM durchgängig mehr Personen – typischerweise 15 bis 28 Prozent mehr als die stärksten lernbasierten Konkurrenten – und wählte die Seeds zur Entscheidungszeit drei- bis zehnmal schneller aus. Die Methode hielt zudem unter rauen Bedingungen stand, in denen einige Interaktionen entfernt, falsch terminiert oder plötzlich verstärkt wurden, und sie übertrug sich gut von einem Netzwerk auf ein anderes mit ähnlichen Aktivitätsmustern.

Was das für alltägliche Anwendungen bedeutet

Einfach gesagt zeigt diese Studie, dass die Wahl der Personen, die man beeinflussen möchte, nicht nur davon abhängt, wo sie im Netzwerk sitzen, sondern wann sie verbunden sind. Indem Netzwerke als lebendige, zeitbewusste Strukturen modelliert und eine KI darauf trainiert wird, diese zeitlichen Muster zu nutzen, kann TempRL-IM bessere Fürsprecher für Marketing, frühere Zielpersonen für Impf‑ oder Informationskampagnen und effektivere Kontrollpunkte in Kommunikations‑ oder Transportsystemen identifizieren. Die zentrale Schlussfolgerung ist schlicht: Timing und Reihenfolge sind entscheidend, und Werkzeuge, die die gesamte Zeitachse unserer Interaktionen einbeziehen, können in den komplexen, sich ständig wandelnden Netzen unseres Lebens intelligentere und schnellere Entscheidungen treffen.

Zitation: Wang, Y., Alawad, M.A., Alfilh, R.H.C. et al. Temporal influence maximization via continuous-time graph neural networks and deep reinforcement learning. Sci Rep 16, 8987 (2026). https://doi.org/10.1038/s41598-026-37640-6

Schlüsselwörter: Einflussmaximierung, dynamische soziale Netzwerke, Graph-Neuronale Netze, Reinforcement Learning, Informationsdiffusion