Clear Sky Science · de

Untersuchung anatomischer Ähnlichkeit beim Zero-Shot-Lernen zur Erkennung von Knochenanomalien

Warum cleverere Röntgenbilder wichtig sind

Gebrochene Knochen gehören zu den häufigsten Verletzungen, doch die Bestätigung eines Bruchs auf einem Röntgenbild beruht weiterhin stark auf dem geschulten Blick einer Radiologin oder eines Radiologen. Diese Expertise ist wertvoll, aber sie ist zeitaufwendig und in vielen Krankenhäusern und Kliniken weltweit knapp. Die Studie stellt eine einfache, aber folgenreiche Frage: Kann ein KI-System lernen, Probleme an Knochen in einem Körperbereich — etwa am Ellenbogen — zu erkennen und dann ähnliche Probleme in anderen Bereichen, wie am Handgelenk oder an den Fingern, zu finden, ohne jemals für diese neuen Regionen nachtrainiert worden zu sein?

Dem Computer beibringen, Knochen zu lesen

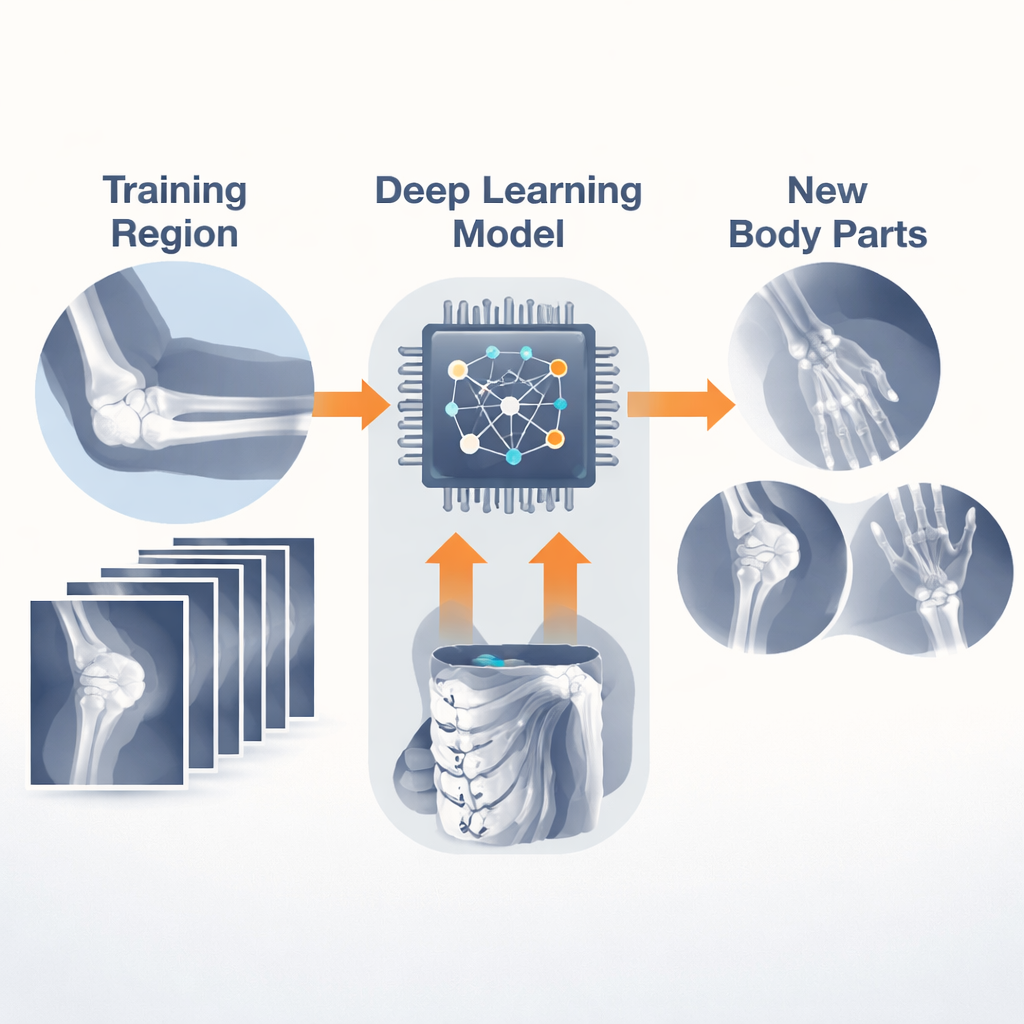

Um diese Idee zu untersuchen, nutzten die Forschenden eine große öffentliche Sammlung von Röntgenaufnahmen des oberen Arms, das MURA-Datenset. Statt sich nur auf Brüche zu konzentrieren, kennzeichnet MURA jede Patientenstudie schlicht als „normal“ oder „abnormal“. Das Team trainierte ein kompaktes Deep-Learning-Modell auf Röntgenbildern aus einer bestimmten Region des Arms, etwa Ellenbogen oder Handgelenk, und ließ es dann beurteilen, ob Aufnahmen aus anderen Regionen gesund wirkten oder nicht. Wichtig ist, dass das Modell während des Trainings niemals Beispielbilder aus diesen neuen Regionen zu sehen bekam — ein Ansatz, der als „Zero-Shot“- oder Out-of-Domain-Lernen bekannt ist.

Jede Kombination von Körperteilen testen

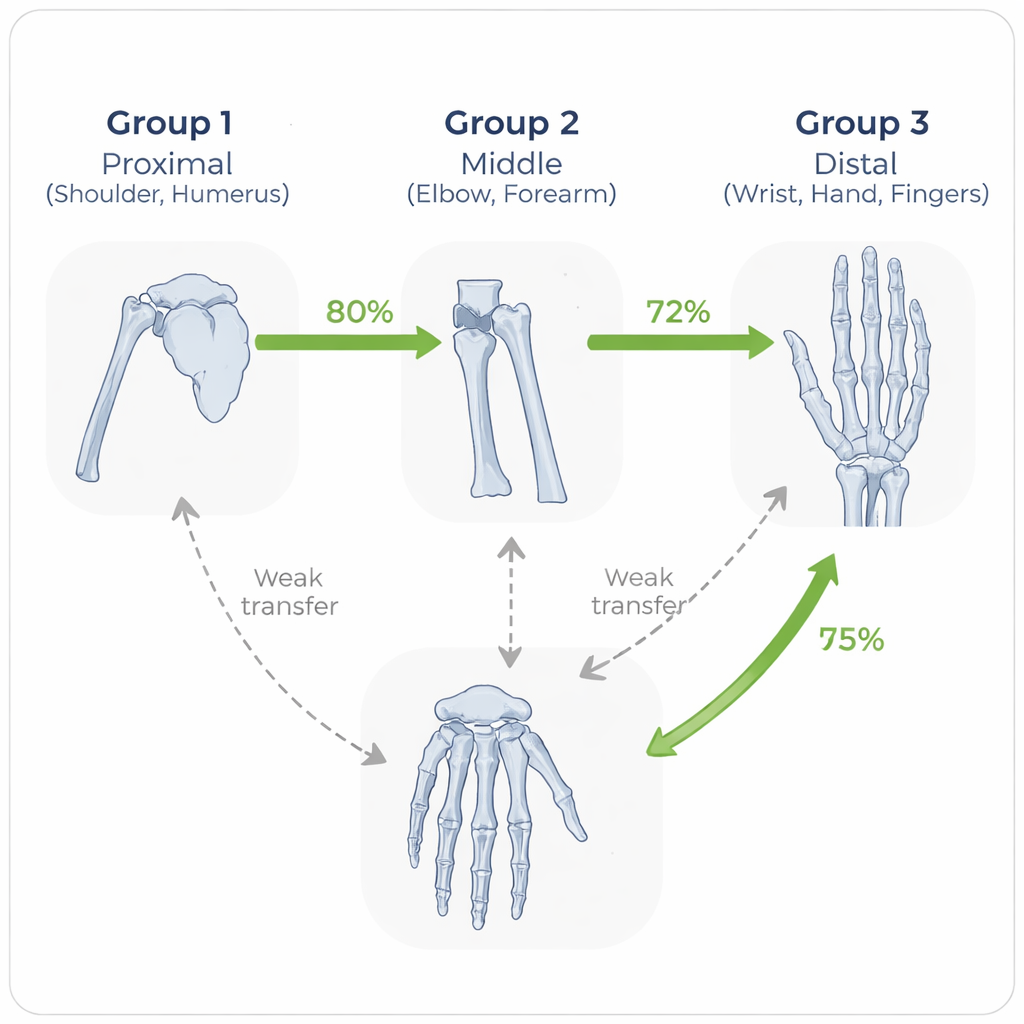

Statt bei einigen wenigen Tests Halt zu machen, probierten die Autorinnen und Autoren systematisch jede mögliche Trainings–Test-Paarung über sieben Regionen des oberen Gliedmaßes aus: Schulter, Humerus, Ellenbogen, Unterarm, Handgelenk, Hand und Finger. Sie behandelten außerdem jeden Patientenbesuch, der mehrere Röntgenansichten umfassen kann, als eine einzelne Entscheidungseinheit, indem sie die Modellkonfidenz über die Bilder mittelten — näher an der klinischen Betrachtungsweise von Ärztinnen und Ärzten. Für jede Paarung berechneten sie Genauigkeit und strenge Konfidenzintervalle und wiederholten wichtige Experimente sogar mit einem zweiten, ausdrucksstärkeren neuronalen Netz, um zu prüfen, ob sich die Trends unabhängig vom Modellaufbau zeigten.

Wenn sich ähnliche Knochen gegenseitig helfen

Ein auffälliges Muster trat zutage: Das Modell erzielte die besten Ergebnisse, wenn es auf demselben Körperteil getestet wurde, auf dem es trainiert worden war, und die nächstbesten, wenn Trainings- und Testregion anatomisch ähnlich waren. Zum Beispiel ließ sich ein auf Unterarmbildern trainiertes Modell gut auf Ellenbogenbilder übertragen, und ein am Handgelenk trainiertes Modell schnitt relativ gut bei Hand- und Fingeraufnahmen ab. Im Gegensatz dazu nahm die Leistung ab, wenn das Modell zwischen sehr unterschiedlichen Regionen springen musste, etwa von der Hand zum Humerus. Durch die Gruppierung der Knochen in proximal (Schulter, Humerus), mittig (Ellenbogen, Unterarm) und distal (Handgelenk, Hand, Finger) zeigte das Team, dass Übertragungen innerhalb einer Gruppe durchweg stärker waren als zwischen Gruppen.

Über ein einzelnes Datenset oder Netzwerk hinaus

Um zu prüfen, dass diese Beobachtungen keine Eigenheiten eines Datensets oder Modells sind, testeten die Forschenden ihre trainierten Systeme an einer zweiten Sammlung von Röntgenbildern namens FracAtlas, die Hand-, Schulter-, Hüft- und Beinaufnahmen aus verschiedenen Krankenhäusern enthält. Ohne Feintuning schnitt ein auf MURA-Handbildern trainiertes Modell bei Beinfrakturen gut ab, zeigte jedoch schwächere Leistung bei Hüfte und Schulter. Einige Experimente wurden außerdem mit einer anderen neuronalen Netzwerkarchitektur wiederholt und zeigten ähnliche überregionale Muster. Zusatzanalysen variierten die Bildauflösung und untersuchten mittels Heatmaps, wo das Modell im Röntgenbild „hinguckte“; dabei zeigte sich, dass erfolgreiche Vorhersagen oft auf klinisch sinnvollen Knochenregionen fokussierten, während Fehler manchmal durch Ablenkungen wie Beschriftungen oder Bildränder verursacht wurden.

Was das für die Versorgung in der Praxis bedeutet

Für Nicht-Spezialisten und Gesundheitssysteme mit begrenzten Ressourcen ist die Botschaft ermutigend und zugleich warnend. Die Studie zeigt, dass ein KI-Werkzeug, das an einem gut beschrifteten Röntgensatz trainiert wurde, sinnvoll dabei helfen kann, andere, ähnliche Körperteile zu beurteilen, ohne jedes Mal riesige neue Datensätze zu benötigen. Seine Zuverlässigkeit lässt jedoch nach, wenn die neuen Regionen zu stark von dem abweichen, was es zuvor gesehen hat. In einfachen Worten: Ein System, das Frakturen am Handgelenk lernt, kann eine nützliche Unterstützung für Hand und Finger sein, sollte aber nicht blind auf Schulter oder Hüfte angewendet werden. Das Verständnis dieser Grenzen kann eine effizientere Datenerhebung leiten — mit Priorität auf wichtigen anatomischen Gruppen — und eine sicherere Einführung von KI in Kliniken unterstützen, die wenige Radiologinnen und Radiologen haben, sodass mehr Patientinnen und Patienten zeitnahe und genaue Beurteilungen von Knochenverletzungen erhalten.

Zitation: Kutbi, M., Shaban, K. & Khogeer, A. Exploring anatomical similarity in zero-shot learning for bone abnormality detection. Sci Rep 16, 6390 (2026). https://doi.org/10.1038/s41598-026-37516-9

Schlüsselwörter: Knochenbruch-Erkennung, KI in der medizinischen Bildgebung, Zero-Shot-Lernen, Röntgenanalyse, Transferlernen