Clear Sky Science · de

Ein klinisch anwendbares und generalisierbares Deep-Learning-Modell für vordere Mediastinaltumoren in CT-Bildern über mehrere Institutionen hinweg

Warum das Erkennen seltener Brustkorbstumoren wichtig ist

Die wenigsten von uns werden in einer Klinik jemals den Ausdruck „vorderer Mediastinaltumor“ hören, weil diese Wucherungen – häufig die Thymusdrüse vor dem Herzen betreffend – selten sind. Wenn sie jedoch auftreten, sind sie schwer zu erkennen und noch schwerer auf CT-Scans genau zu vermessen; solche Aufgaben erfordern meist Spezialisten an großen Krebszentren. Diese Studie untersucht, ob ein sorgfältig trainiertes System der künstlichen Intelligenz (KI) Ärzten in vielen Krankenhäusern dabei helfen kann, solche schwer fassbaren Tumoren zuverlässig auf Routine-CT-Bildern zu finden und zu umreißen, und damit möglicherweise Diagnostik und Therapieplanung für Patienten zu verbessern, die sonst übersehen würden.

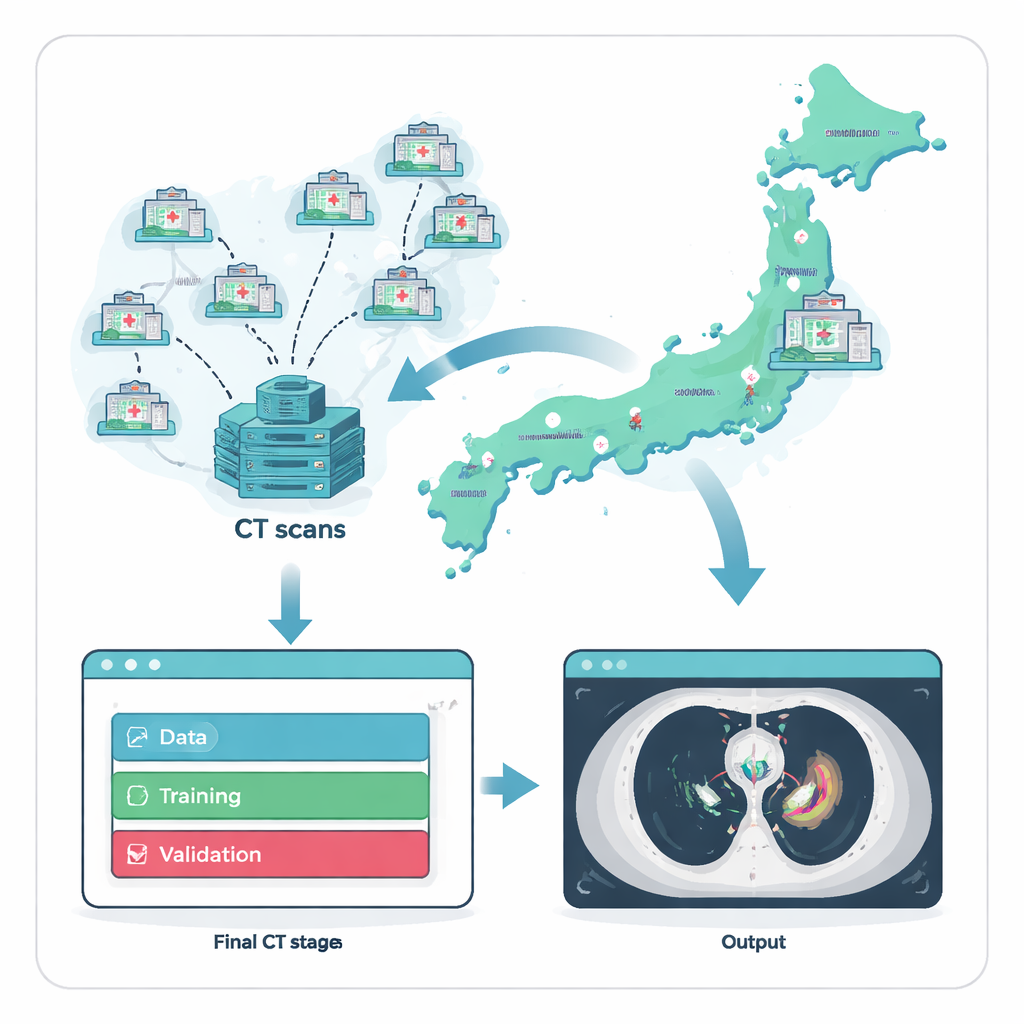

Seltene Fälle aus dem ganzen Land zusammentragen

Da vordere Mediastinaltumoren ungewöhnlich sind, besteht die erste Hürde darin, genügend Fälle für das KI-Training zu finden. Die Forschenden gingen dieses Problem an, indem sie mit dem National Cancer Center Hospital in Japan und 135 überweisenden Krankenhäusern im ganzen Land zusammenarbeiteten. Über zwei Jahrzehnte sammelten sie 711 Thorax-CT-Scans, jeweils von verschiedenen erwachsenen Patientinnen und Patienten, deren Tumordiagnose histologisch gesichert war. Um einen fairen und realistischen Test zu gewährleisten, teilten sie die Daten in drei Gruppen: einen großen Satz zum Training, einen kleineren zum Finetuning und einen vollständig separaten externen Testsatz mit 164 Scans aus 121 Krankenhäusern, die keine Trainingsbilder beigesteuert hatten. Diese strikte Trennung ahmt nach, wie das System in neuen Krankenhäusern, die es nie „gesehen“ hat, performen würde.

Scans in verlässliches Lehrmaterial verwandeln

Ein KI-Modell ist nur so gut wie die Beispiele, von denen es lernt, daher investierte das Team stark in Expertenannotation. Für jeden CT-Scan zeichneten Fachleute die exakten Tumorgrenzen im vorderen Thorax nach. Ein Thoraxchirurg oder ein radiologischer Technologe fertigte die ersten Konturen an, die anschließend von zwei erfahrenen diagnostischen Radiologinnen und Radiologen überprüft wurden. Unstimmigkeiten wurden durch Diskussion beigelegt, wodurch eine hochwertige Referenz entstand, die widerspiegelt, wie Expertinnen und Experten die Bilder in der Praxis interpretieren würden. Mithilfe einer kommerziellen No-Code-KI-Plattform bauten und trainierten Klinikerinnen und Kliniker – ohne Programmcode zu schreiben – ein dreidimensionales Modell, das diese Expertenkonturen nachahmt und medizinischem Personal erlaubt, die Entwicklung direkt zu steuern.

Wie die KI Tumoren dreidimensional sieht

Das Kernstück des Systems ist eine 3D-Version einer neuronalen Netzwerkarchitektur, die als U-Net bekannt ist und ganze CT-Volumina statt einzelner Schnitte analysiert. Sie verarbeitet einen Stapel von Thoraxbildern und sagt für jedes winzige Volumenelement voraus, ob es zum Tumor oder zum normalen Gewebe gehört, und übermalt so effektiv eine 3D-Maske über den Tumor. Während des Trainings wurde das Modell zufälligen Rotationen, Skalierungen und Zuschnitten der Bilder ausgesetzt, damit es gegen geringe Unterschiede in Patientenlage und Scanner-Einstellungen robust wird. Die Forschenden maßen dann, wie genau die vom Modell vorhergesagten Tumorregionen mit den Expertenzeichnungen übereinstimmen, mithilfe gängiger Überlappungsmaße, die sowohl eine präzise Grenzplatzierung als auch die vollständige Abdeckung des Tumorvolumens belohnen.

Leistung über viele Krankenhäuser und Tumortypen hinweg

Im externen Testsatz aus 121 unabhängigen Krankenhäusern zeigte das KI-Modell eine starke Übereinstimmung mit den Expertensegmentierungen. Im Mittel lag sein Überlappungsmaß (Dice) bei 0,82, mit einem verwandten Maß, dem Intersection over Union, bei 0,72; Präzision und Sensitivität bewegten sich beide in etwa im Bereich 0,82–0,85, was bedeutet, dass das Modell selten normales Gewebe fälschlich als Tumor kennzeichnete und den Großteil des Tumorgewebes erfasste. Wichtig ist, dass diese Ergebnisse über verschiedene Scannerhersteller, Tumorgrößen und Tumortypen hinweg stabil blieben, was darauf hindeutet, dass das System mit der in der klinischen Praxis vorkommenden Vielfalt umgehen kann. Wenn es als Detektor bewertet wurde – also nur darauf geprüft, ob es jeden Herd überhaupt findet – erreichte das Modell unter einer strengen Zuordnungsregel eine Sensitivität von etwa 0,87 bei deutlich unter einer Fehlalarmrate von eins pro Scan im Durchschnitt, ein Profil, das insbesondere für die Unterstützung des Krebsscreenings attraktiv ist.

Wo das System hilft und wo Menschen unverzichtbar bleiben

Ein genauer Blick auf Erfolge und Fehler zeigte ein klares Muster: Die KI arbeitete am zuverlässigsten bei größeren Tumoren und tat sich schwer mit sehr kleinen oder schwach sichtbaren Herden, die sie teilweise verpasste oder mit benachbarten normalen Strukturen wie Gefäßen oder Flüssigkeitsansammlungen verwechselte. Das entspricht der alltäglichen Erfahrung in der Radiologie, in der winzige oder kontrastarme Befunde am ehesten übersehen werden. Die Autorinnen und Autoren argumentieren daher, dass das Werkzeug am besten in einem „Human-in-the-loop“-Setting eingesetzt wird. Es kann als effizienter Erstleser dienen, der wahrscheinliche Tumoren markiert und deren Grenzen umreißt und so sofort nutzbare Volumina für Aufgaben wie Therapieplanung und Operation liefert, während Radiologinnen und Radiologen ihre Aufmerksamkeit auf das Nachprüfen kleiner, subtiler oder ambivalenter Bereiche konzentrieren.

Was das für Patientinnen und Patienten und künftige Werkzeuge bedeutet

Für Laien ist die Kernbotschaft, dass ein auf einer seltenen, aber ernsthaften Gruppe von Brustkorbstumoren trainiertes KI-System Ärztinnen und Ärzte zuverlässig dabei unterstützen kann, diese Krebserkrankungen in CT-Scans zu finden und zu umreißen – selbst in Krankenhäusern, die keine Trainingsdaten beigesteuert haben. Durch die Bereitstellung genauer 3D-Tumorkarten bei gleichzeitig niedriger Fehlalarmrate könnte das Modell die Diagnosestellung beschleunigen, eine präzisere Strahlen- und OP-Planung unterstützen und eine zusätzliche Sicherheitsstufe gegen übersehene Herde bieten. Zugleich macht die Arbeit deutlich, dass KI kein Ersatz für fachliche Urteilsbildung ist – insbesondere bei den kleinsten und schwächsten Tumoren – sondern ein vielversprechender Assistent, der leistungsfähiger wird, wenn Klinikpersonal, Bilddaten und benutzerfreundliche KI-Plattformen zusammengeführt werden.

Zitation: Takemura, C., Miyake, M., Kobayashi, K. et al. A clinically applicable and generalizable deep learning model for anterior mediastinal tumors in CT images across multiple institutions. Sci Rep 16, 6774 (2026). https://doi.org/10.1038/s41598-026-37504-z

Schlüsselwörter: vordere Mediastinaltumoren, Deep Learning in der CT-Bildgebung, medizinische Bildsegmentierung, Unterstützung bei Krebsdiagnosen, Radiologie Künstliche Intelligenz