Clear Sky Science · de

Ein erklärbares Deep-Learning-Framework zur Few-Shot-Erkennung von Pflanzenkrankheiten bei Reis und Zuckerrohr mittels CNN-basierter Merkmalsextraktion

Warum das Erkennen kranker Blätter wichtig ist

Reis und Zuckerrohr ernähren Milliarden Menschen und sichern den Lebensunterhalt vieler Landwirtinnen und Landwirte. Befallen die Blätter von Krankheiten, können ganze Ernten schrumpfen, Lebensmittelpreise steigen und Existenzen verloren gehen. Frühe Diagnosen sind jedoch schwierig: Probleme beginnen oft als kleine Flecken oder Farbveränderungen, die vielbeschäftigte Landwirtinnen und Landwirte übersehen können, und Expertinnen sind nicht immer in der Nähe. Diese Studie stellt ein computergestütztes System vor, das aus nur wenigen Blattfotos lernen, Krankheiten automatisch erkennen und den Nutzenden sogar zeigen kann, welche Bildbereiche zur Diagnose geführt haben — so können Landwirte früher und mit größerer Sicherheit handeln.

Intelligente Augen für das Feld

Die Forschenden konzentrieren sich auf zwei Grundnahrungsmittel: Reis und Zuckerrohr. Sie nutzen zwei öffentliche Bildsammlungen von Blättern: eine in echten Zuckerrohrfeldern mit vielen verschiedenen Smartphones aufgenommene Sammlung und einen kleineren, stärker kontrollierten Satz von Reisblattfotos. Jedes Bild zeigt entweder ein gesundes Blatt oder eines mit einer bestimmten Erkrankung, etwa braune Flecken, rostfarbene Pusteln oder gelbe Streifen. Indem sie auf diesen frei zugänglichen Datensätzen aufbauen statt auf privaten Sammlungen, zielen die Autorinnen und Autoren auf Verfahren, die andere Gruppen testen, wiederverwenden und schließlich in reale Landwirtschaftswerkzeuge einbetten können — von Smartphone-Apps bis zu vernetzten Sensoren in intelligenten Feldern.

Maschinen mit sehr wenigen Beispielen lehren

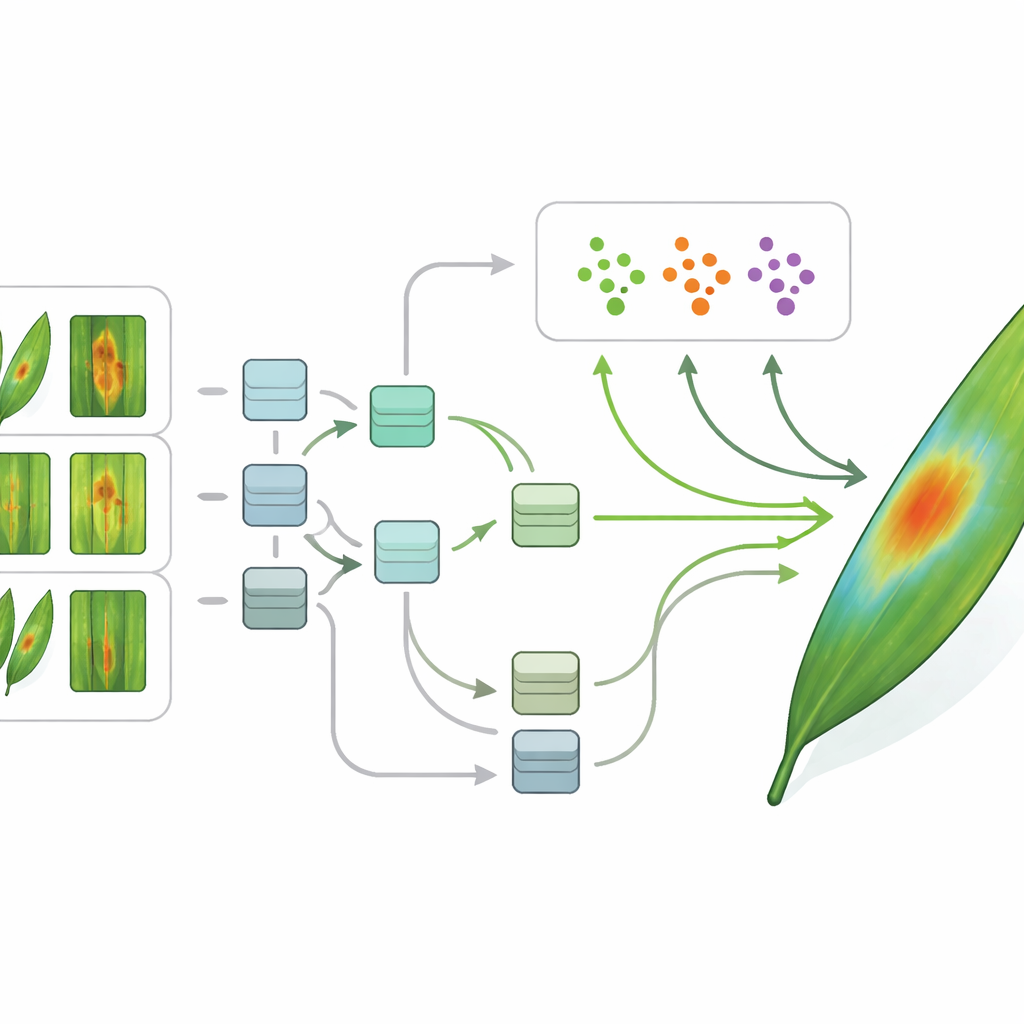

Moderne künstliche Intelligenz ist ausgesprochen gut darin, Pflanzenkrankheiten zu erkennen, verlangt dafür aber meist Tausende gelabelter Bilder pro Zustand — eine hohe Hürde in der Landwirtschaft, besonders bei neuen oder seltenen Ausbrüchen. Um dieses Problem zu umgehen, verwenden die Autorinnen und Autoren Few-Shot-Learning, eine Familie von Techniken, die aus nur wenigen Beispielen lernen sollen. Ihr Framework beginnt mit üblichen Bildverarbeitungsschritten: Bereinigung, Größenanpassung und Normierung, sodass der Rechner eine einheitliche Sicht erhält. Ein Typ von Deep-Learning-Modell, ein Convolutional Neural Network, wandelt dann jedes Blattbild in einen kompakten Satz numerischer Merkmale um, die Formen, Farben und Texturen erfassen, die für Krankheiten relevant sind.

Die Diagnose nachvollziehbar machen

Auf diesen Merkmalen aufbauend trainiert das Team zwei fortgeschrittene Few-Shot-Methoden namens Prototypical Networks und Model-Agnostic Meta-Learning. Die eine lernt eine Art "Zentrum" für jede Krankheit im Merkmalsraum und ordnet neue Blätter dem nächstgelegenen Zentrum zu; die andere lernt, sich mit nur wenigen Trainingsschritten schnell an neue Aufgaben anzupassen. Entscheidend ist, dass die Autorinnen und Autoren diese Methoden mit Werkzeugen der erklärbaren KI kombinieren. Mittels heatmapähnlicher Techniken kann das System hervorheben, welche Teile eines Blattbildes die Entscheidung am stärksten beeinflusst haben — etwa ein Cluster dunkler Flecken, ein gelber Streifen entlang der Mittelrippe oder das Ausbleiben offensichtlicher Läsionen bei einer gesunden Pflanze. Das macht die Begründung des Modells sichtbar und ermöglicht Agronominnen und Agronomen zu prüfen, ob sich der Rechner auf medizinisch sinnvolle Merkmale statt auf Hintergrundstörungen konzentriert.

Wie gut das System arbeitet

Um zu beurteilen, ob ihr Ansatz tatsächlich nützlich ist, vergleichen die Forschenden ihn mit mehreren bekannten Deep-Learning-Modellen, die zur Erkennung von Pflanzenkrankheiten eingesetzt wurden. Sie teilen jeden Datensatz in Trainings- und Testanteile und messen, wie oft jede Methode den Krankheitstyp korrekt identifiziert. Bei im Feld aufgenommenen Zuckerrohrblättern erreicht das neue Framework etwa 92 Prozent korrekte Klassifikationen und übertrifft damit Standardarchitekturen wie VGG, ResNet, Xception und EfficientNet. Im Reisdatensatz ist die Leistung noch höher: Rund 98 Prozent der Testbilder werden korrekt erkannt. Statistische Werkzeuge, die das Verhältnis von Fehlalarmen zu verpassten Fällen analysieren, zeigen, dass die neue Methode eher wie ein exzellentes Screening-Instrument als wie ein zufälliger Treffer agiert.

Was das für Landwirtinnen und Landwirte bedeutet

Kurz gesagt zeigt die Studie, dass ein Computer lernen kann, mehrere Reis- und Zuckerrohrkrankheiten mit hoher Genauigkeit aus nur einer kleinen Anzahl von Beispielbildern zu erkennen, und dass er zugleich die genauen Flecken und Streifen auf dem Blatt benennen kann, die zu seiner Entscheidung geführt haben. Diese Kombination aus Daten‑Effizienz und Transparenz ist entscheidend für den Praxiseinsatz: Sie senkt die Hürde beim Aufbau von Werkzeugen für neue Kulturen und aufkommende Krankheiten und liefert Landwirtinnen, Landwirten und Expertinnen visuelle Belege, denen sie vertrauen können. Mit weiteren Tests in realen Feldern und benutzerfreundlicheren Schnittstellen könnten solche erklärbaren Few-Shot-Systeme alltägliche Partner in der smarten Landwirtschaft werden, Ernten schützen und den unnötigen Einsatz von Pflanzenschutzmitteln reduzieren.

Zitation: El-Behery, H., Attia, AF. & Rezk, N.G. An explainable deep learning framework for few shot crop disease detection in rice and sugarcane using CNN based feature extraction. Sci Rep 16, 8272 (2026). https://doi.org/10.1038/s41598-026-37501-2

Schlüsselwörter: Erkennung von Pflanzenkrankheiten, Reis und Zuckerrohr, Deep Learning, erklärbare KI, intelligente Landwirtschaft