Clear Sky Science · de

Mu-Rhythmus Motor–Auditiver Verzögerung bei vorgestellter Sprache spiegelt das Timing gesprochener Sprache wider

Die Stimme im Kopf hören

Wenn Sie leise eine Präsentation proben oder diese Worte „in Ihrem Kopf“ lesen, verhält sich Ihr Gehirn, als würden Sie tatsächlich sprechen. Diese Studie stellt eine auf den ersten Blick einfache Frage: Folgt unsere innere Stimme demselben Timing und denselben physikalischen Beschränkungen wie echte, laut gesprochene Sprache, oder ist sie eine beschleunigte, ungebundene mentale Abkürzung? Die Antwort ist wichtig, um zu verstehen, wie das Gehirn Bewegung und Wahrnehmung verknüpft, und könnte letztlich Technologien informieren, die vorgestellte Sprache für Menschen ohne Sprechfähigkeit dekodieren.

Wie das Gehirn Mundbewegungen und Klänge verknüpft

Sprechen erfordert, dass das Gehirn geplante Bewegungen von Zunge, Lippen und Kiefer in die Klänge übersetzt, die wir hören. Diese Übersetzung braucht Zeit, weil motorische Signale und Klänge in unterschiedlichen neuronalen „Sprachen“ repräsentiert werden. Frühere Arbeiten mit Personen, die tatsächlich sprechen, haben gezeigt, dass das Gehirn das, was es zu sagen beabsichtigt, mit dem, was es hört, innerhalb eines Fensters von etwa einem Zehntel Sekunde vergleicht. Bei vorgestellter Sprache gibt es jedoch keine reale Bewegung und keinen Klang — nur interne Simulationen. Die Autorinnen und Autoren fragten, ob dieser interne Prozess dennoch dasselbe Timing wie die äußere Sprache respektiert oder ob das Gehirn die Abfolge zusammenzieht oder beschleunigt, wenn nichts den Mund verlässt.

Leise Silben und empfindliche Hirnaufnahmen

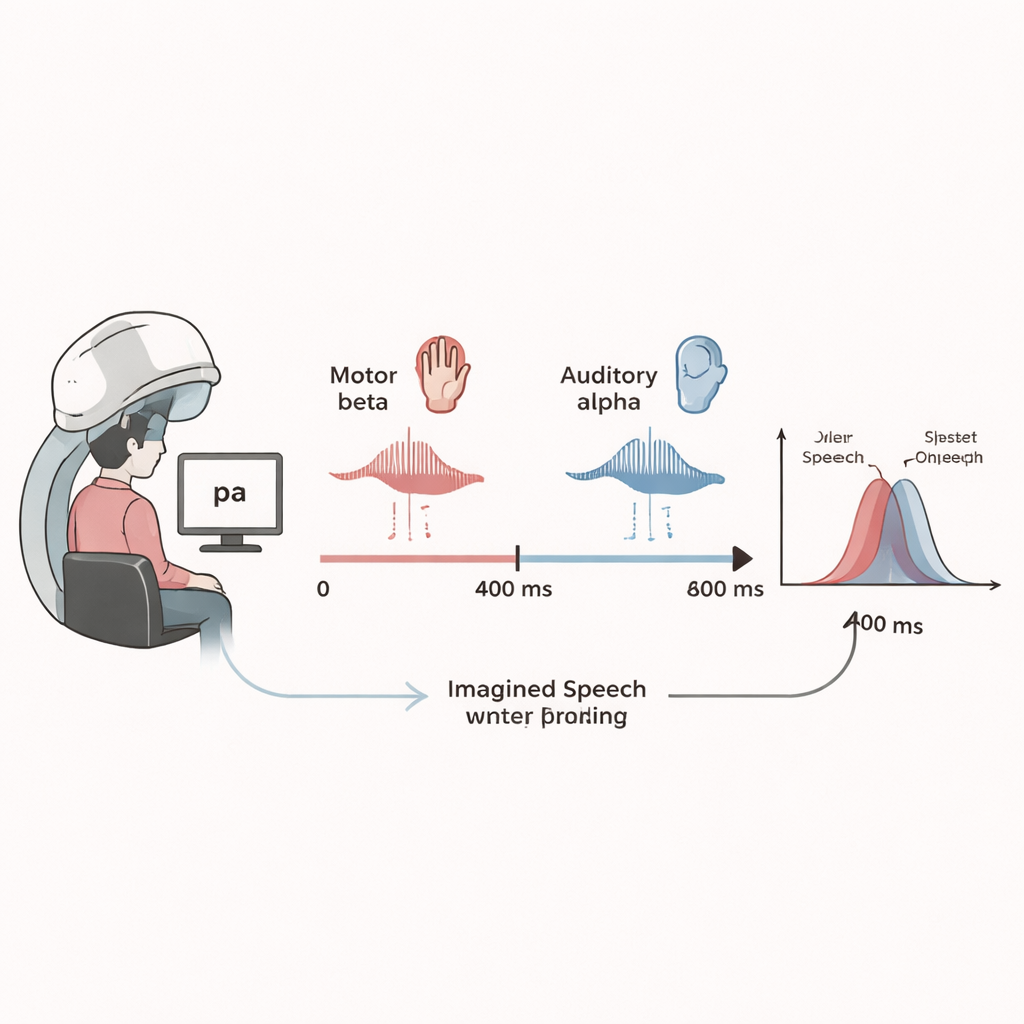

Um Sprache auf das Wesentliche zu reduzieren, sahen die Teilnehmenden einfache Silben — pa, ta und ka — und wurden gebeten, sie entweder laut auszusprechen (in einem Pretest) oder sich vorzustellen, sie so schnell wie möglich zu sagen, während sie völlig still blieben. Der gesprochene Pretest zeigte, dass die Leute im Mittel etwa 0,4 Sekunden nach Sicht der Silbe mit der Lautproduktion begannen, mit überraschend konsistentem Timing über die Durchgänge hinweg. Während des Hauptexperiments zeichneten die Forschenden die Hirnaktivität mit Magnetenzephalographie (MEG) auf, einer Methode, die die winzigen Magnetfelder verfolgt, die von Gruppen von Neuronen mit Millisekundenauflösung erzeugt werden. Sie überwachten außerdem winzige Gesichtsmuskelsignale, um zu verifizieren, dass die Teilnehmenden sich nicht tatsächlich bewegten, wenn sie nur das Sprechen imaginierten.

Zwei Rhythmen, zwei Hirnregionen, eine Verzögerung

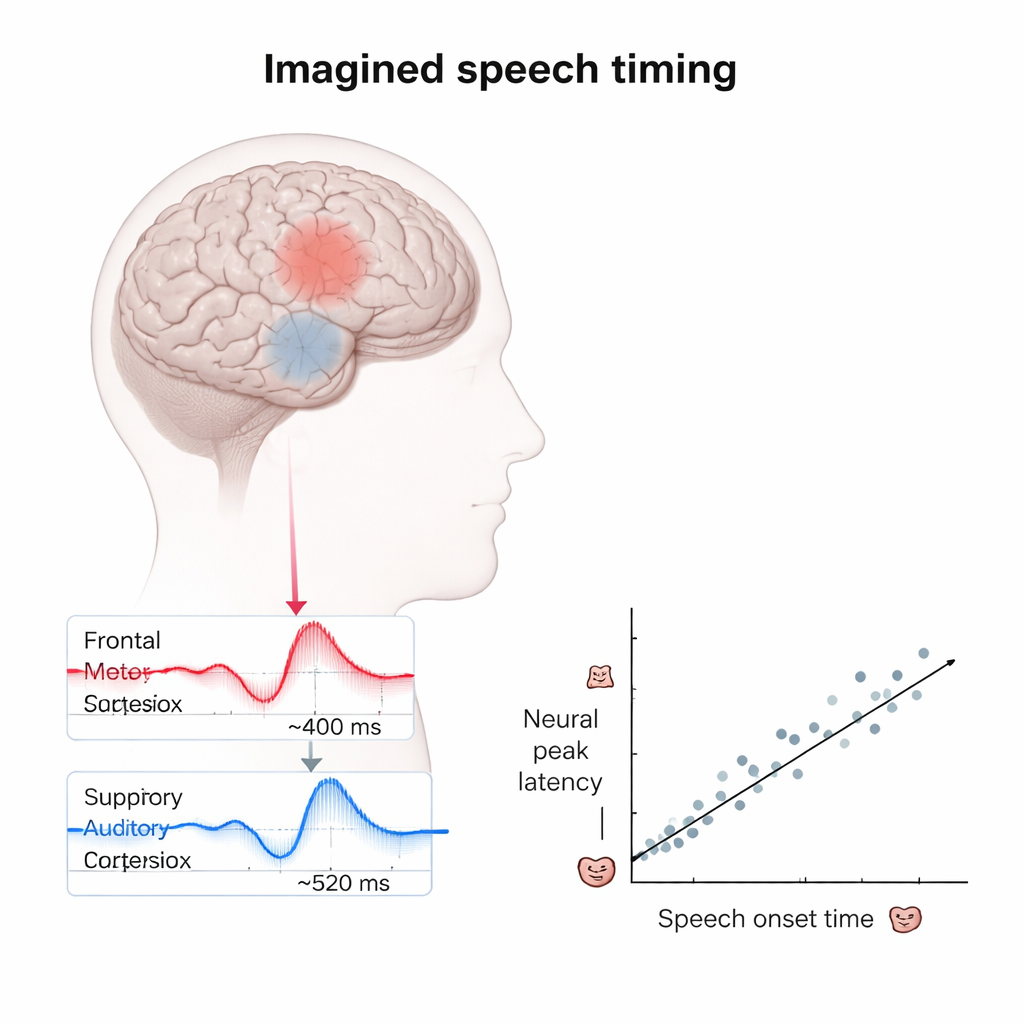

Das Team konzentrierte sich auf einen bestimmten Hirnrhythmus, der als Mu‑Rhythmus bekannt ist und zwei Frequenzbänder umfasst: Beta (15–30 Hz) und Alpha (8–12 Hz). Wenn Menschen sich bewegen — oder sich auch nur bewegen vorstellen — tendiert die Beta‑Power dazu, in motorischen Regionen abzunehmen, und wenn sie Klänge verarbeiten, nimmt die Alpha‑Power in auditorischen Regionen ab. Durch die Untersuchung von Veränderungen dieser Rhythmen relativ zu einer Ruhebaseline fanden die Forschenden eine klare Abfolge während vorgestellter Sprache. Zuerst nahm die Beta‑Power in frontalen Motorbereichen ab; später nahm die Alpha‑Power in temporalen auditorischen Bereichen ab. Im Mittel begann der motorbezogene Beta‑Abfall etwa 120 Millisekunden vor dem auditorisch‑bezogenen Alpha‑Abfall, und diese Reihenfolge zeigte sich zuverlässig über die Teilnehmenden hinweg.

Innere Sprache spiegelt äußere Sprache wider

Wesentlich ist, dass diese 120‑Millisekunden‑Lücke zwischen motorischen und auditorischen Ereignissen im Gehirn dem Zeitfenster nahekam, das zuvor berichtet wurde, wenn Menschen tatsächlich sprechen und ihre eigene Stimme hören. Die Autorinnen und Autoren gingen weiter und verglichen die individuelle Sprechgeschwindigkeit jeder Person im lauten Pretest mit dem Timing ihrer Hirnrhythmen während der Imagination. Personen, die schneller sprachen, zeigten auch frühere Peaks sowohl in der motorischen Beta‑ als auch in der auditorischen Alpha‑Unterdrückung während der vorgestellten Sprache. Diese enge Übereinstimmung legt nahe, dass die interne Simulation von Artikulation und Klang dem natürlichen Sprechrhythmus jeder Person folgt, selbst wenn kein Ton produziert wird.

Was das für die Stimme in unserem Kopf bedeutet

Die Befunde deuten darauf hin, dass innere Sprache kein lose getaktetes, komprimiertes Schema des Sprechens ist. Stattdessen ist sie, zumindest für einfache Silben, eine treue Wiedergabe derselben Motor‑zu‑Klang‑Abfolge, die auch bei realer Sprache verwendet wird, sich auf derselben Zeitskala entfaltet, jedoch mit weitgehend gehemmter Muskulatur. Die unterscheidbaren, aber koordinierten Veränderungen in Beta‑ und Alpha‑Rhythmen liefern einen neuronalen Marker dafür, wie das Gehirn geplante Bewegungen mit erwarteten Klängen verknüpft, ohne sich auf tatsächliches Feedback zu stützen. Dieser Marker könnte Forschenden helfen zu untersuchen, wie wir unsere eigene Sprache überwachen, und eines Tages Gehirn‑Computer‑Schnittstellen unterstützen, die vorgestellte Wörter bei Menschen interpretieren, die nicht sprechen können.

Zitation: Mantegna, F., Poeppel, D. & Orpella, J. Mu rhythm motor–auditory delay in imagined speech mirrors overt speech timing. Sci Rep 16, 6528 (2026). https://doi.org/10.1038/s41598-026-37421-1

Schlüsselwörter: innerer Dialog, Sprach‑Timing, Sensorimotorische Koordination, Hirnrhythmen, vorgestellte Sprache